Clear Sky Science · es

Explotando modelos de análisis de temas para explorar dimensiones psicológicas en datos de redes sociales

Por qué importan nuestras palabras en línea

Millones de personas hablan de sus sentimientos en las redes sociales cada día, a menudo con más franqueza que en persona. Ocultos en este mar de comentarios informales hay pistas valiosas sobre la salud mental, incluidos indicios de depresión o autolesiones. Este estudio plantea una pregunta simple con implicaciones importantes: ¿puede la inteligencia artificial moderna filtrar el ruido de las conversaciones en línea, encontrar temas significativos y ayudar a los profesionales a comprender mejor los riesgos psicológicos—sin leer cada publicación una por una?

Convertir el caos en temas

Los investigadores se centraron en una gran colección de publicaciones de Reddit del proyecto eRisk, que incluye personas que dijeron haber sido diagnosticadas con depresión y un grupo de control sin diagnósticos conocidos. Su objetivo no era diagnosticar a individuos, sino ver si el análisis de temas—técnicas que agrupan textos por temas compartidos—podía revelar patrones relevantes para la salud mental. Dado que el lenguaje en redes sociales es desordenado, lleno de jerga, errores tipográficos y cambios abruptos de tema, es una prueba realista pero muy desafiante para estos métodos.

Tres maneras de descubrir de qué habla la gente

El estudio comparó tres familias diferentes de modelos de temas. El primero, Latent Dirichlet Allocation (LDA), es un método clásico que observa con qué frecuencia aparecen juntas las palabras en los documentos. El segundo, BERTopic, utiliza potentes modelos de lenguaje modernos para convertir cada publicación en una representación numérica rica, luego agrupa publicaciones similares y extrae palabras clave para cada grupo. El tercero, TopClus, también se basa en redes neuronales, combinando mecanismos de atención y clustering en un espacio matemático compartido. Los tres se ejecutaron con configuraciones estándar para producir 50 temas cada uno, imitando cómo muchos investigadores los usarían tal cual.

Preguntar a humanos, no solo a fórmulas

Para juzgar qué temas eran realmente significativos, el equipo no se basó únicamente en puntuaciones automáticas. Seis anotadores entrenados examinaron 150 temas, cada uno representado por sus palabras principales y un puñado de publicaciones centrales. Para cada tema, evaluaron cuán coherente era la lista de palabras, cuán coherentes eran las publicaciones de ejemplo y si las palabras y las publicaciones se correspondían entre sí. También intentaron dar a cada tema un nombre breve e intuitivo cuando fue posible. Este enfoque centrado en humanos reveló un hallazgo clave: las métricas numéricas de “coherencia”, populares en la investigación, a menudo discrepaban con el juicio humano, especialmente en textos desordenados de redes sociales.

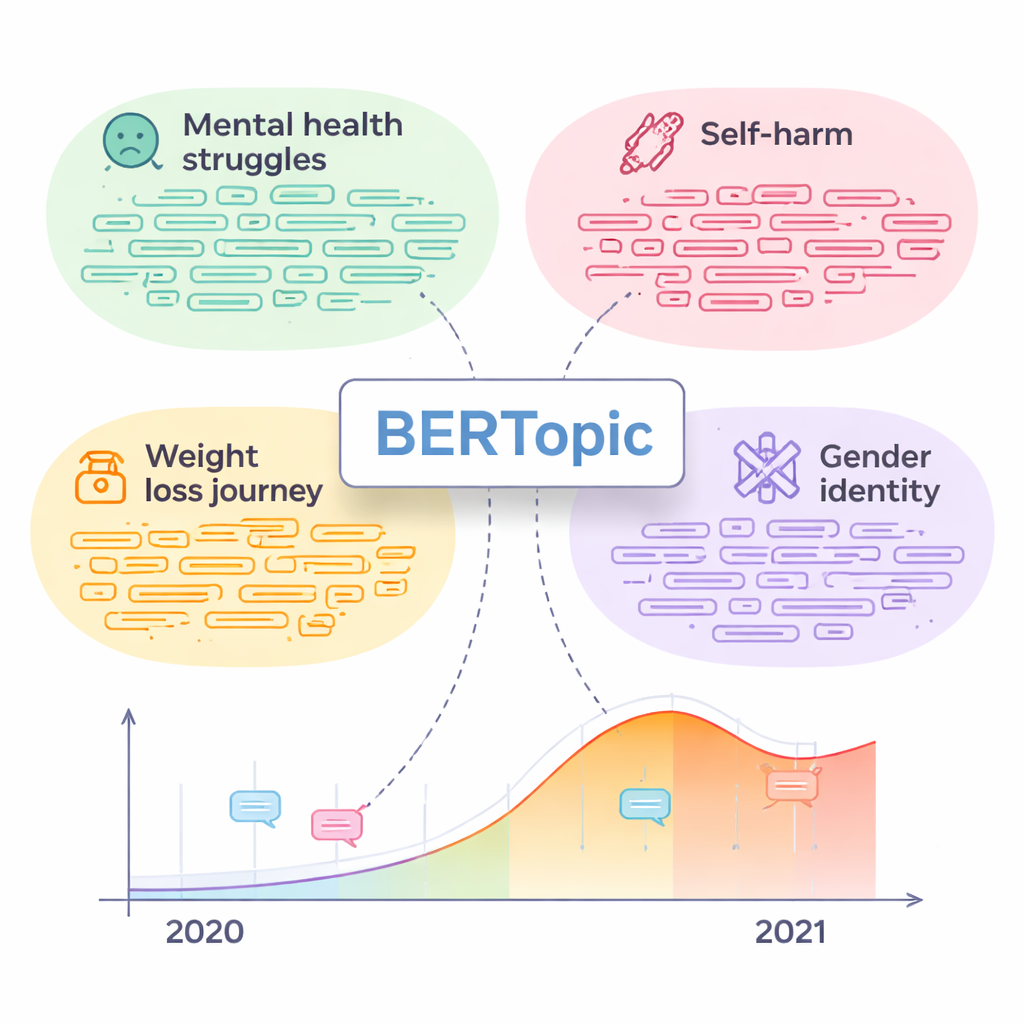

El claro ganador y lo que reveló

Considerando todas las valoraciones humanas, BERTopic produjo claramente los temas más comprensibles y específicos. Los anotadores pudieron nombrar sus temas con mucha más frecuencia que los de los otros modelos, y mostraron un nivel de acuerdo entre ellos sólido y moderado. LDA, en contraste, a menudo agrupaba palabras y publicaciones no relacionadas que resultaban casi aleatorias para los revisores. Una vez seleccionados los mejores temas, los investigadores profundizaron en lo que la gente realmente estaba comentando. Algunos temas, como «Luchas de salud mental» y «Autolesiones», se asociaron fuertemente con usuarios con depresión y contenían muchas publicaciones que expresaban angustia. Otros eran menos obviamente clínicos—como «Proceso de pérdida de peso», «Identidad de género», «Sueños sexuales» y «Etiqueta del consumo social de alcohol»—pero resultaron tener una alta proporción de publicaciones de usuarios deprimidos y muchas señales de dolor emocional. Un simple análisis temporal mostró que la actividad en algunos de estos temas sensibles aumentó drásticamente durante la pandemia de COVID-19, reflejando informes más amplios sobre el empeoramiento de la salud mental.

De patrones en línea a ayuda en el mundo real

Para entender mejor la gravedad potencial de algunas de estas publicaciones, los autores emplearon un modelo de lenguaje separado para mapear de forma aproximada el contenido a ítems de un conocido cuestionario de depresión (el Inventario de Depresión de Beck). Este paso exploratorio sugirió que ciertos temas, especialmente los relacionados con luchas de salud mental, autolesiones, imagen corporal e identidad de género, a menudo contienen lenguaje asociado con síntomas depresivos de moderados a severos. Los autores enfatizan que tales lecturas automatizadas no son diagnósticos clínicos, pero pueden ayudar a resaltar dónde la atención de expertos es más urgentemente necesaria.

Qué significa esto para la salud mental y la tecnología

En términos sencillos, el estudio muestra que los modelos de temas más avanzados de hoy, especialmente BERTopic, pueden convertir conversaciones caóticas en redes sociales en temas claros que se alinean con preocupaciones psicológicas reales. También demuestra que confiar a ciegas en puntuaciones automáticas de calidad es arriesgado; la revisión humana sigue siendo esencial cuando el objetivo es apoyar decisiones sobre salud mental. En el futuro, herramientas similares podrían ayudar a clínicos, agencias públicas e investigadores a monitorizar tendencias amplias, detectar riesgos emergentes y diseñar mejores esfuerzos de prevención—sin dejar de reservar el juicio final y la atención a los profesionales humanos.

Cita: Couto, M., Parapar, J. & Losada, D.E. Exploiting topic analysis models to explore psychological dimensions in social media data. Sci Rep 16, 6047 (2026). https://doi.org/10.1038/s41598-026-36339-y

Palabras clave: redes sociales y depresión, modelado de temas, patrones de salud mental, señales de autolesiones en línea, modelos de lenguaje en psicología