Clear Sky Science · es

Arquitectura adaptativa ADAT consciente de series temporales para la traducción de lengua de señas

Acortando la brecha comunicativa

Para millones de personas sordas y con problemas de audición, tareas cotidianas como acudir al médico o ver el parte meteorológico pueden resultar más difíciles de lo necesario, simplemente porque hay pocos intérpretes de lengua de señas con capacitación. Este artículo presenta un nuevo sistema de inteligencia artificial llamado ADAT que convierte videos en lengua de señas en oraciones escritas con mayor precisión y eficiencia que muchos sistemas existentes, acercándonos a una traducción en tiempo real y de amplio acceso en teléfonos, tabletas y equipos hospitalarios.

Por qué la lengua de señas es difícil para los ordenadores

Las lenguas de señas son ricas y complejas, con gramáticas propias, y dependen de mucho más que del movimiento de las manos. Las expresiones faciales, la postura corporal y la sincronización sutil cambian el significado de una oración signada. Los sistemas de traducción modernos suelen usar un diseño potente conocido como transformer, muy eficaz para comprender oraciones largas en lenguaje hablado o escrito. Pero cuando se trata de vídeo a alta velocidad —30 a 60 fotogramas por segundo— estos sistemas pueden volverse lentos y tener dificultades para captar los movimientos rápidos y de detalle que distinguen un signo de otro. Además requieren mucha potencia computacional y tiempo de entrenamiento, lo que dificulta mantenerlos actualizados conforme evolucionan las lenguas de señas.

Una forma más inteligente de leer la señalización

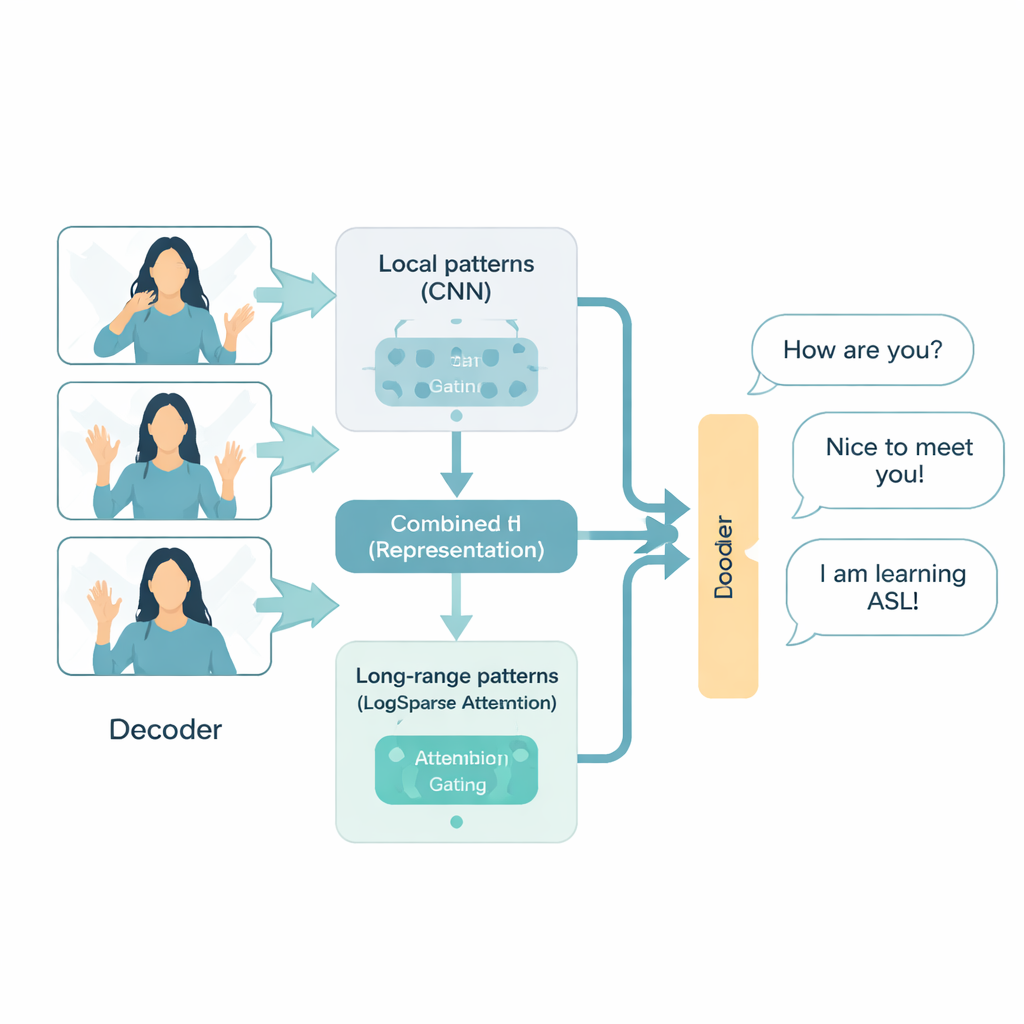

La arquitectura ADAT está diseñada específicamente para vídeo de lengua de señas, tratándolo como una serie temporal: un flujo rápido de eventos visuales que se desarrollan en el tiempo. Combina tres ideas. Primero, emplea redes neuronales convolucionales, una técnica probada en imágenes, para centrarse en patrones locales como la forma de las manos y las pistas faciales. Segundo, utiliza una forma de atención más eficiente, que mira selectivamente hacia momentos clave del vídeo en lugar de comparar cada fotograma con todos los demás. Tercero, una "puerta" adaptativa aprende a mezclar información detallada a corto plazo con contexto amplio a largo plazo, decidiendo sobre la marcha qué es más relevante para cada parte de la oración. Juntas, estas piezas permiten que ADAT capture tanto el rápido movimiento de un dedo como la estructura global de una conversación sin malgastar cómputo.

De los signos a las palabras de dos maneras

La traducción de lengua de señas puede organizarse en dos pasos principales: primero reconocer las unidades básicas del signing, conocidas como glosses, y luego convertir esos glosses en texto hablado o escrito. Esto se llama sign-to-gloss-to-text. Alternativamente, un sistema puede intentar ir directamente del vídeo al texto en un solo paso, llamado sign-to-text. Los autores prueban ADAT en ambos enfoques. Lo comparan con varios baselines basados en transformer potentes, incluido un sistema conocido como SLTUNET, en tres conjuntos de datos: un gran corpus alemán de pronósticos meteorológicos, una colección de lengua de señas india y un nuevo conjunto de datos médicos en American Sign Language que los autores crearon para reflejar conversaciones realistas entre médico y paciente.

Entrenamiento más rápido y traducciones más nítidas

En estas pruebas, ADAT iguala o supera a los mejores modelos competidores en calidad de traducción, medida con las puntuaciones BLEU estándar, mientras entrena de forma visiblemente más rápida. En la configuración de dos pasos sign-to-gloss-to-text, ofrece puntuaciones similares o ligeramente mejores que un transformer clásico, pero reduce el tiempo de entrenamiento en aproximadamente una quinta parte en promedio. En la más exigente configuración directa sign-to-text, ADAT supera claramente a los baselines basados en encoder-only, decoder-only y transformers unificados, a menudo mejorando la precisión en alrededor de un punto porcentual o más, nuevamente con un entrenamiento aproximadamente un 20% más rápido. Un análisis detallado de la matemática subyacente muestra que la atención más selectiva y el diseño de doble vía de ADAT reducen sustancialmente el número de operaciones requeridas, especialmente al trabajar con vídeos largos o de alta tasa de fotogramas.

Datos nuevos para conversaciones críticas

Para asegurar que estos métodos vayan más allá de entornos de laboratorio, los autores presentan MedASL, el primer conjunto de datos en American Sign Language centrado en la comunicación médica. Consiste en 500 oraciones únicas, cuidadosamente diseñadas, que simulan interacciones reales entre pacientes y profesionales sanitarios e incluye anotaciones tanto de gloss como de texto. Este enfoque médico es importante porque los malentendidos en un hospital o clínica pueden tener consecuencias graves, y los conjuntos de datos existentes rara vez cubren este dominio. ADAT tiene un rendimiento sólido en MedASL, aunque los resultados también ponen de manifiesto lo difícil que resulta para cualquier sistema generalizar perfectamente a oraciones nuevas del mundo real.

Qué supone esto para la vida cotidiana

En términos sencillos, el estudio demuestra que podemos construir sistemas de traducción de lengua de señas que sean a la vez más inteligentes y más ligeros: necesitan menos tiempo y potencia de cálculo para entrenarse y, aun así, captan mejor las sutilezas del signing. ADAT aún no es un intérprete plug-and-play para todas las lenguas de señas en cualquier situación, y todavía queda por detrás de sistemas que se apoyan en modelos gigantes preentrenados. Pero al centrarse en patrones de vídeo sensibles al tiempo y en la eficiencia, señala el camino hacia herramientas prácticas que algún día podrían ejecutarse en dispositivos habituales, admitir múltiples lenguas de señas y ayudar a las personas sordas a comunicarse con mayor facilidad en contextos críticos como la sanidad, la respuesta a emergencias y los servicios públicos.

Cita: Shahin, N., Ismail, L. ADAT novel time-series-aware adaptive transformer architecture for sign language translation. Sci Rep 16, 6551 (2026). https://doi.org/10.1038/s41598-026-36293-9

Palabras clave: traducción de lengua de señas, transformer adaptativo, atención en series temporales, ASL médico, IA accesible