Clear Sky Science · es

Decisión jerárquica de NBV basada en información mutua para SLAM visual semántico activo en entornos dinámicos

Robots que pueden pensar por adelantado

A medida que los robots salen de las fábricas y entran en casas, hospitales y oficinas, deben navegar por espacios llenos de personas y otros objetos en movimiento. Este artículo presenta una nueva forma para que un robot “piense por adelantado” sobre dónde mirar y cómo moverse para poder construir un mapa fiable de su entorno, incluso cuando ese entorno se niega a quedarse quieto. El trabajo es relevante para cualquiera interesado en robots de servicios más seguros, mensajeros autónomos más inteligentes o futuros asistentes domésticos que deben compartir espacio con humanos en vez de con pasillos vacíos.

Por qué la gente en movimiento confunde a los robots

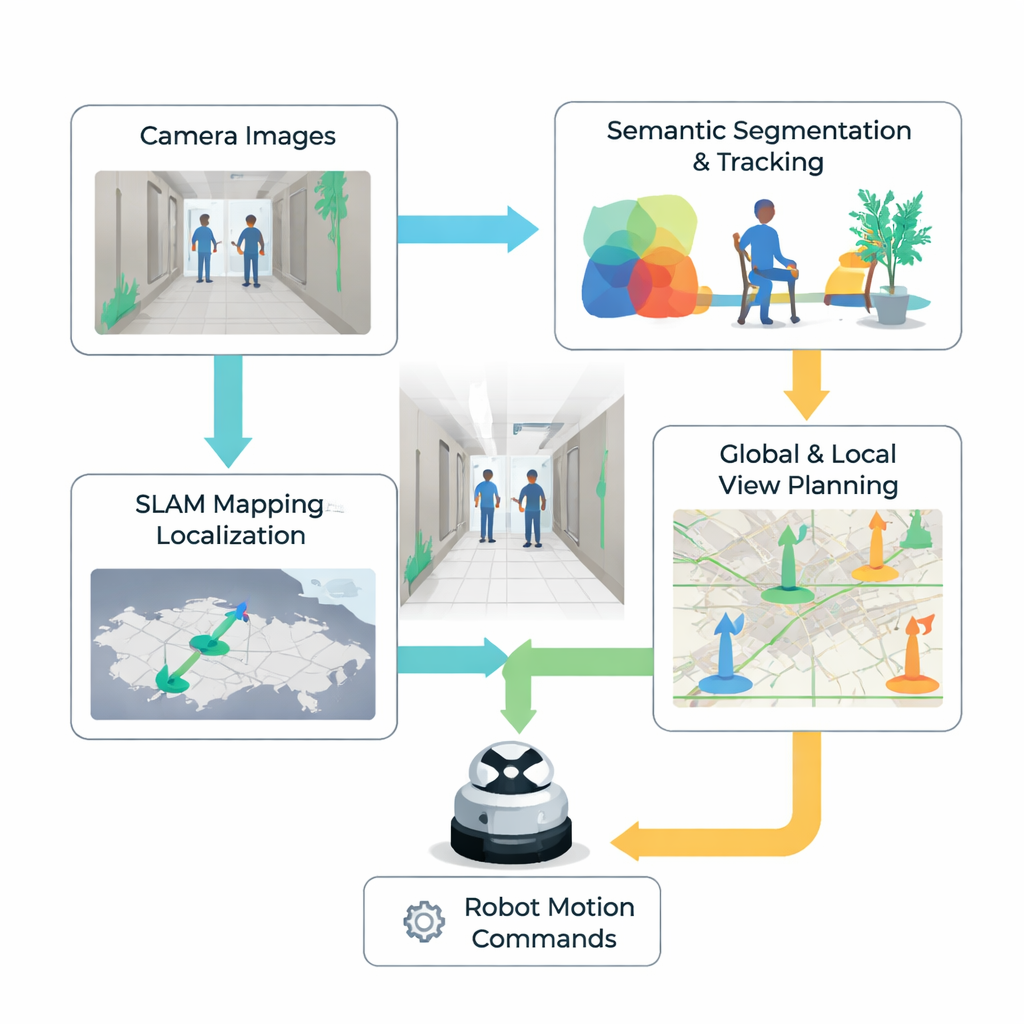

Para desplazarse por su cuenta, muchos robots usan una técnica llamada SLAM visual, en la que una cámara les ayuda a construir un mapa y estimar su posición al mismo tiempo. Esto funciona bien en entornos estáticos, pero se deteriora rápidamente cuando la gente pasa caminando, bloquea la vista o carga objetos. Una solución habitual es usar visión “semántica” para que el robot reconozca personas, coches y sillas y simplemente los ignore al construir el mapa. Sin embargo, esto crea un nuevo problema para robots activos que eligen sus propias trayectorias: si descartan demasiadas pistas visuales, pueden perder la referencia de dónde están por completo. El campo de visión limitado de la cámara hace esto aún más difícil, porque una sola persona que pase cerca puede ocultar la mayor parte del paisaje útil a los ojos del robot.

Una estrategia de dos niveles para elegir dónde mirar a continuación

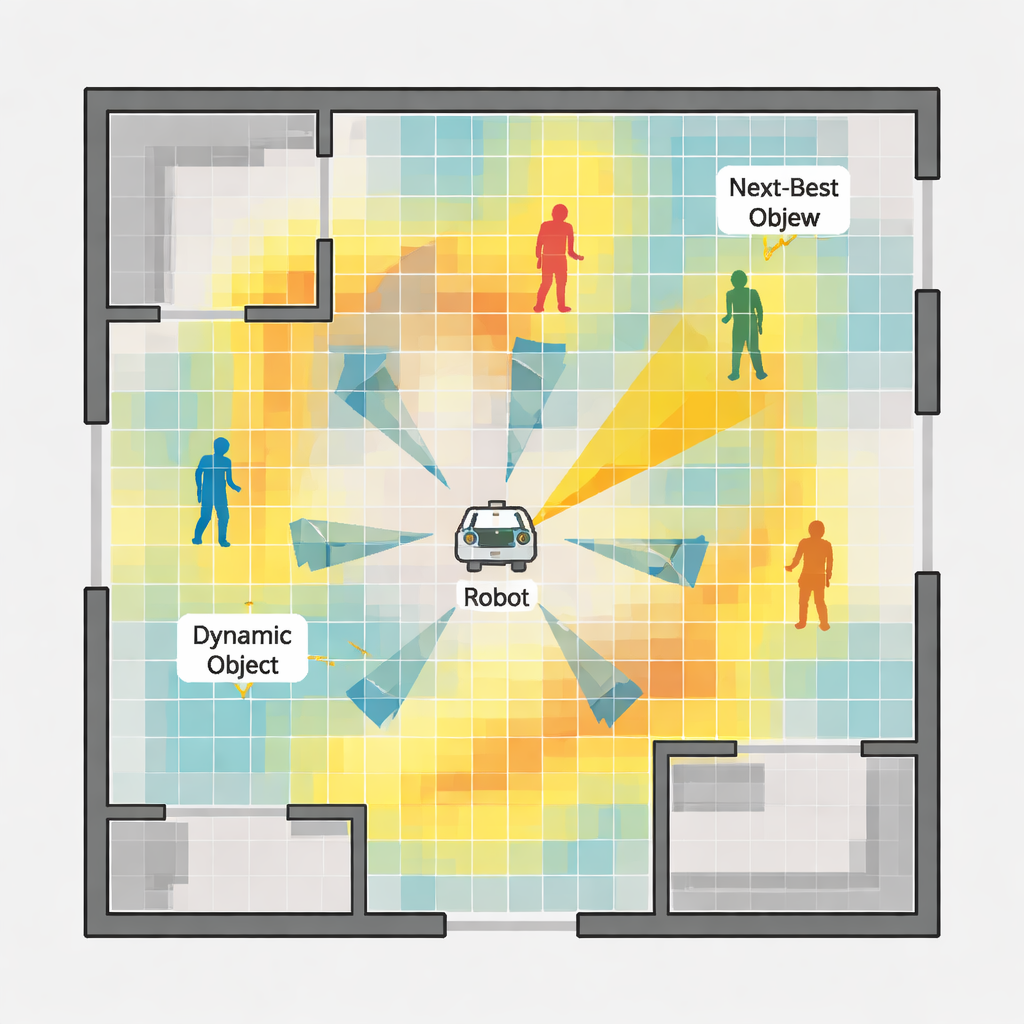

Los autores proponen un sistema de decisión jerárquico que ayuda al robot a decidir sus siguientes puntos de vista de forma más informada. En el nivel superior, el robot mantiene un mapa en cuadrícula visto desde arriba de zonas libres, ocupadas y desconocidas. Evalúa posibles vistas lejanas estimando cuánto reduciría cada una la incertidumbre en ese mapa, un concepto tomado de la teoría de la información. El robot prefiere puntos que revelen grandes regiones inexploradas, considerando también la distancia que debe recorrer y cuánto necesita girar la cámara. Una vez elegida un área prometedora, un proceso de nivel inferior toma el control para afinar exactamente cómo debe moverse y orientarse dentro de ese vecindario para poder ver realmente suficiente detalle útil con su estrecho campo de visión.

Ver lo que es estable y esquivar lo que no lo es

En el núcleo del proceso de decisión local hay un “mapa de probabilidad de características” construido a partir de cada imagen de la cámara. Primero, el sistema detecta hitos visuales—esquinas y patrones en la escena—que probablemente se mantendrán estables en el tiempo y son útiles para el seguimiento del movimiento. Luego usa un detector de objetos moderno para encontrar objetos potencialmente móviles, como personas, y los rastrea a través de los fotogramas. Al analizar cómo se mueven estos objetos, el sistema estima no solo dónde están ahora, sino dónde es probable que estén en un futuro próximo. Estas dos fuentes de información se fusionan en un mapa de calor sobre la imagen: las regiones brillantes indican una alta probabilidad de ver hitos fiables, mientras que las regiones más oscuras señalan lugares que son pobres en características o que probablemente queden cubiertos por objetos en movimiento. El robot usa este mapa para juzgar qué pequeño movimiento—girar a la izquierda, a la derecha o avanzar—le dará la vista más nítida y estable a continuación.

Pruebas en mundos virtuales y en el real

Los investigadores probaron su enfoque en dos espacios interiores simulados de diferente tamaño y complejidad, cada uno poblado por peatones virtuales errantes, y luego en un robot físico que recorría un entorno interior real. Compararon su método con varias estrategias de exploración consolidadas que se centran principalmente en cubrir espacio o acortar la distancia de desplazamiento. En las simulaciones, el nuevo sistema produjo mapas con menos distorsión y logró mejor precisión de posicionamiento mientras exploraba en un tiempo similar o menor. También fue menos probable que perdiera la referencia de su posición o que se acercara incómodamente a personas en movimiento. En el experimento del mundo real, el método funcionó en tiempo real en un ordenador comercial del robot, confirmando que es práctico para su despliegue fuera del laboratorio.

Qué significa esto para los robots de todos los días

En términos sencillos, este trabajo enseña a un robot a ser selectivo sobre dónde mira y a dónde va cuando hay personas alrededor. Al combinar comprensión de la escena, predicción de movimiento y una medida de ganancia de información, el robot puede dirigirse hacia vistas que son a la vez informativas y seguras, en lugar de simplemente marchar hacia la esquina inexplorada más cercana. Esto hace su mapa interno más fiable y sus movimientos más previsibles, que son ingredientes clave para robots que deben compartir espacios concurridos con humanos. Aún quedan desafíos—como grandes aglomeraciones repentinas que bloqueen la cámara—pero el enfoque supone un paso hacia robots domésticos y de servicio que puedan manejar con gracia la naturaleza desordenada y dinámica de la vida real.

Cita: Yang, Z., Sang, A.W.Y., Muthugala, M.A.V.J. et al. Mutual information-based hierarchical NBV decision for active semantic visual SLAM under dynamic environments. Sci Rep 16, 5847 (2026). https://doi.org/10.1038/s41598-026-36259-x

Palabras clave: SLAM activo, navegación robótica, entornos dinámicos, mapeo semántico, mejor vista siguiente