Clear Sky Science · es

Segmentación de glándulas colorrectales con supervisión débil mediante aprendizaje auto-supervisado y pseudoetiquetado basado en atención

Por qué esto importa para el diagnóstico del cáncer

Cuando un patólogo examina una biopsia de colon al microscopio, una de las pistas más importantes sobre la gravedad del cáncer es la forma y organización de unas pequeñas estructuras tubulares llamadas glándulas. Delinear cada glándula a mano es lento, caro y difícil de estandarizar entre hospitales. Este estudio muestra cómo la inteligencia artificial puede aprender a trazar estas glándulas casi tan bien como expertos humanos utilizando etiquetas humanas mucho menos detalladas, lo que podría acelerar y mejorar el diagnóstico del cáncer colorrectal.

El desafío de dibujar cada pequeño contorno

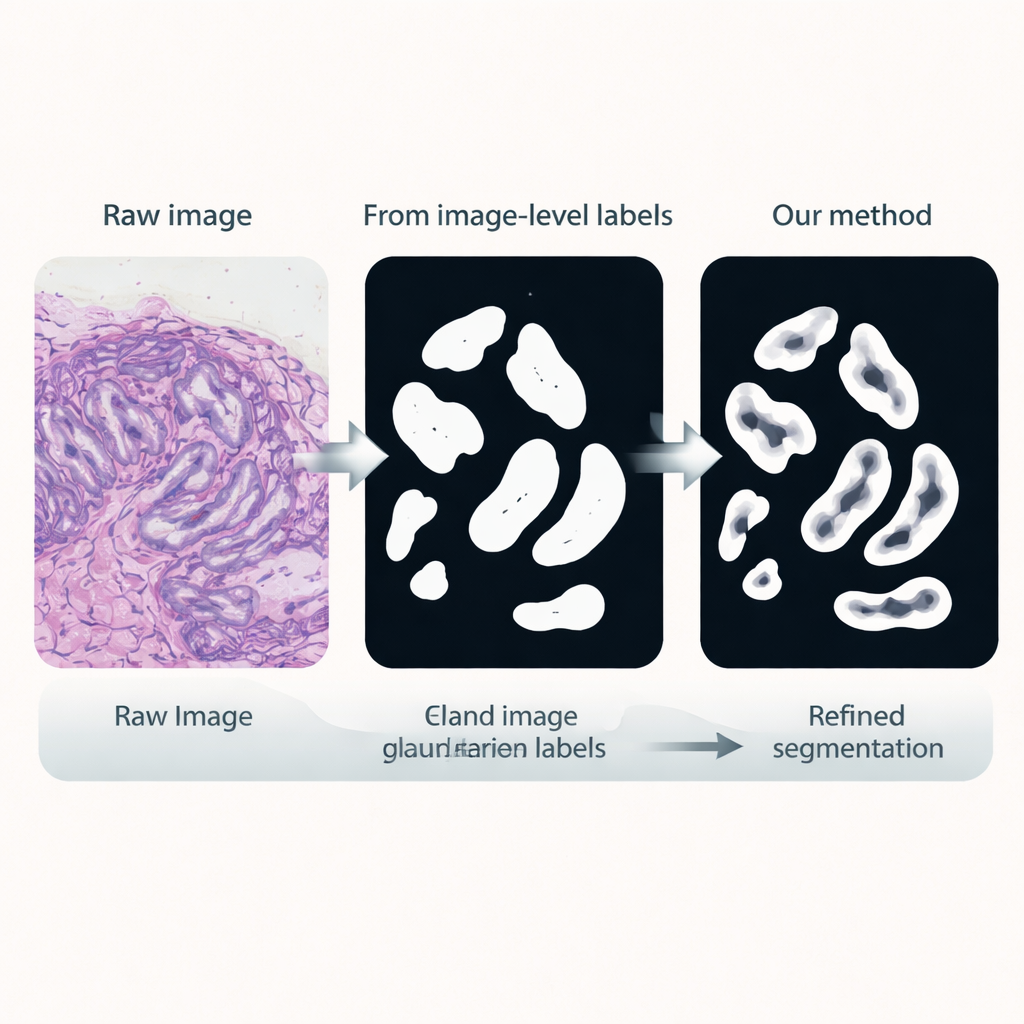

El cáncer colorrectal está entre los cánceres más comunes y mortales del mundo, y la clasificación de su gravedad depende en gran medida de la apariencia de las glándulas. En tejido sano o en estadios tempranos, las glándulas tienen aspecto de tubos redondeados y ordenados; en tumores agresivos se vuelven dentadas, fusionadas o apenas reconocibles. Se puede entrenar a los ordenadores para segmentar, o “colorear”, cada glándula para permitir mediciones automáticas, pero los sistemas de aprendizaje profundo tradicionales requieren contornos laboriosos píxel a píxel dibujados por patólogos expertos. En la práctica clínica real, mucho más fácil de obtener son etiquetas a nivel de imagen, como si un fragmento de tejido contiene o no glándulas, o si es benigno o maligno.

Enseñar a la IA a partir de láminas no etiquetadas y con etiquetas débiles

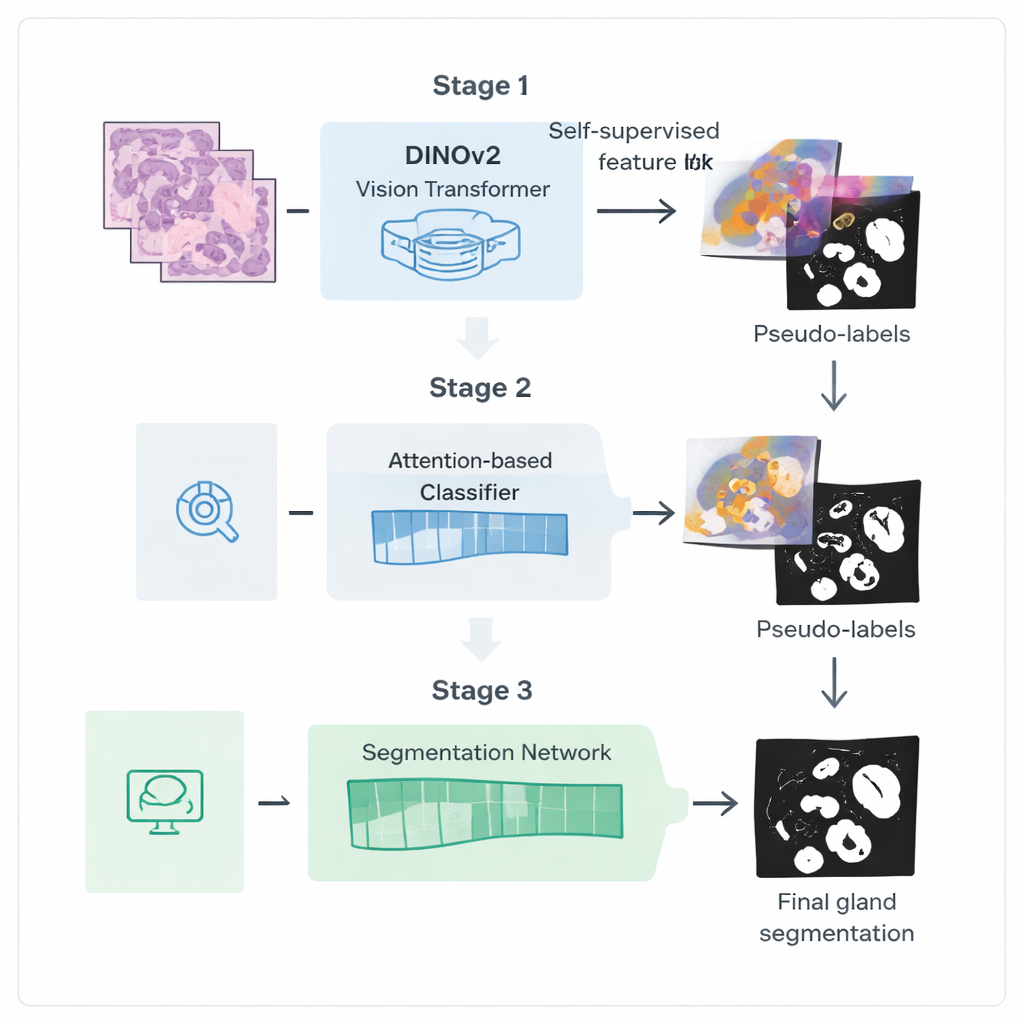

Los autores presentan una tubería de entrenamiento en tres pasos diseñada para extraer más valor de estas etiquetas más débiles. Primero, parten de un potente modelo de visión llamado DINOv2, entrenado originalmente con fotografías naturales, y lo exponen a miles de imágenes de biopsias colorrectales no etiquetadas. Al pedir al modelo que empareje diferentes vistas del mismo parche de tejido, aprende características visuales adaptadas a los colores y texturas de las láminas histológicas sin necesitar anotaciones. Este paso crea un “codificador” especializado que transforma las imágenes crudas en representaciones internas ricas que capturan estructuras similares a glándulas.

Dejar que la IA muestre dónde está mirando

En la segunda etapa, este codificador se incorpora a una red de clasificación que solo necesita etiquetas a nivel de imagen, como la presencia de glándulas. Un mecanismo de atención dentro de la red aprende a asignar mayor peso a las regiones de la imagen que más influyen en su decisión. Estos mapas de atención resaltan efectivamente dónde la red “cree” que se localizan las glándulas. Los investigadores convierten estos mapas difusos en máscaras binarias aproximadas mediante mezcla y umbralización, y luego las limpian con una técnica de suavizado probabilístico llamada Campo Aleatorio Condicional (Conditional Random Field). El resultado es un conjunto de pseudoetiquetas refinadas: contornos de glándulas generados por ordenador que no son perfectos, pero sí lo bastante buenos para guiar un modelo de segmentación más especializado.

Afinando los límites de las glándulas

En la tercera etapa, se entrena una red de segmentación dedicada utilizando estas pseudoetiquetas como sustitutos de las anotaciones manuales. Reutiliza el codificador afinado y añade una cabeza decodificadora ligera que convierte las características de nuevo en una máscara detallada de glándulas. Crucialmente, la función de pérdida empleada durante el entrenamiento presta atención adicional a los bordes: los errores que distorsionan los contornos de las glándulas se penalizan más que los pequeños fallos en el interior. Este entrenamiento consciente de los límites fomenta contornos nítidos y anatómicamente realistas, esenciales para medir con precisión la forma y la separación de las glándulas.

¿Qué tan bien funciona en la práctica?

El equipo evaluó su método en dos bancos de prueba estándar de tejido colorrectal. En el conjunto GlaS, su enfoque con supervisión débil no solo superó a otros métodos que también usan etiquetas limitadas, sino que en varias métricas se aproximó o incluso superó a sistemas clásicos con supervisión completa que dependían de anotaciones a nivel de píxel. En un conjunto más exigente llamado CRAG, cargado de glándulas altamente irregulares y malignas, el rendimiento cayó para todos los métodos, pero el nuevo marco todavía superó a otros competidores con etiquetas débiles y redujo la brecha con los modelos totalmente supervisados. Estudios de ablación mostraron que cada componente —afinamiento auto-supervisado, pseudoetiquetado basado en atención con posprocesamiento y pérdida consciente de los límites— contribuyó de forma significativa a las mejoras.

Qué significa esto para las herramientas de patología del futuro

Para un lector no especialista, la conclusión clave es que este trabajo apunta hacia sistemas de IA capaces de ofrecer mapas de alta calidad y con límites precisos de estructuras glandulares microscópicas usando principalmente etiquetas simples a nivel de lámina que ya son comunes en los archivos hospitalarios. Al reducir la dependencia de trazados manuales minuciosos, el enfoque podría facilitar que el análisis cuantitativo y la clasificación avanzada basados en imágenes sean más factibles en muchos centros, ayudando a los patólogos a diagnosticar el cáncer colorrectal de forma más consistente y eficiente, y potencialmente extendiéndose a otros tipos de tejidos y estructuras en el futuro.

Cita: Wen, H., Wu, Y., Huang, D. et al. Weakly supervised colorectal gland segmentation through self-supervised learning and attention-based pseudo-labeling. Sci Rep 16, 5771 (2026). https://doi.org/10.1038/s41598-026-36256-0

Palabras clave: cáncer colorrectal, patología digital, segmentación de glándulas, aprendizaje con supervisión débil, visión auto-supervisada