Clear Sky Science · es

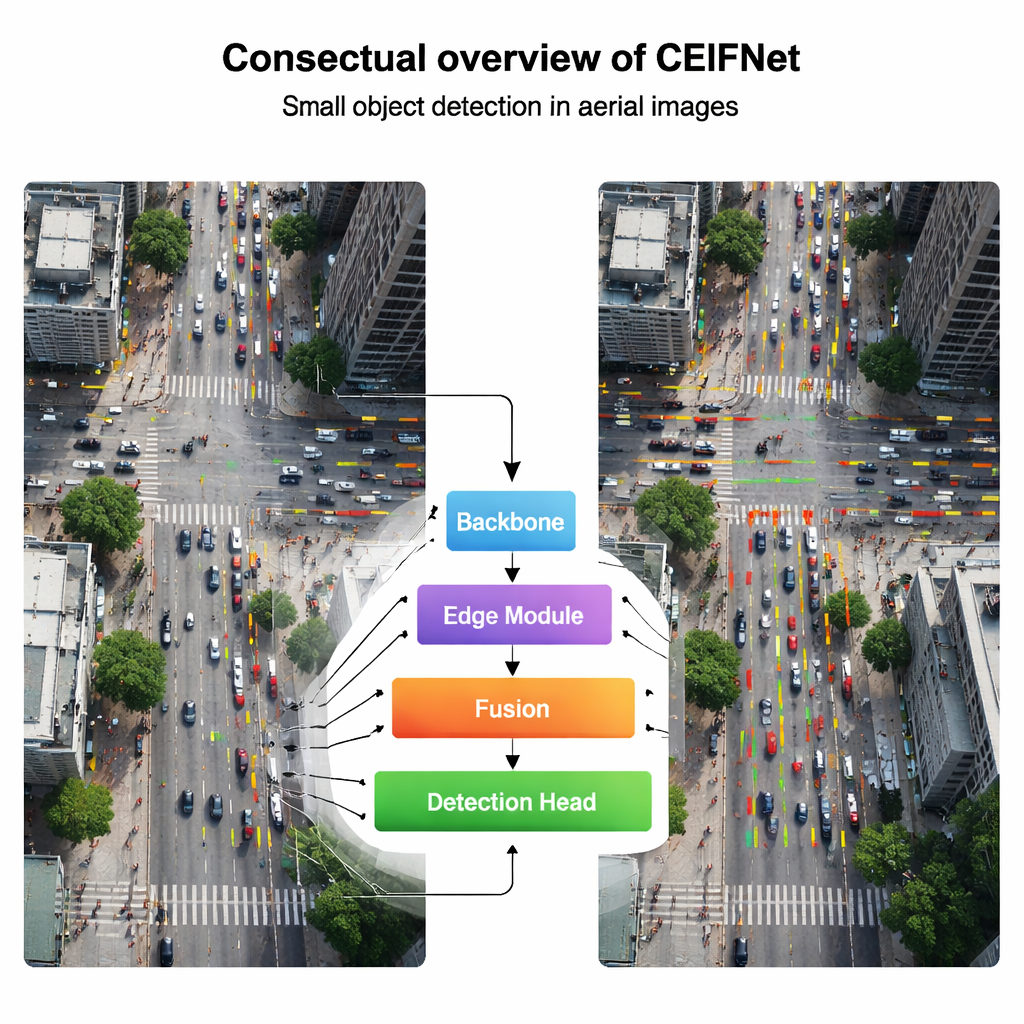

Red de fusión de información de bordes entre etapas para la detección de objetos pequeños en imágenes aéreas

Por qué importa detectar detalles diminutos desde el cielo

Desde la monitorización del tráfico y la respuesta a desastres hasta el cuidado de cultivos, cada vez más partes de nuestro entorno se vigilan desde el aire con drones. Sin embargo, muchas de las cosas que más nos importan en estas imágenes aéreas—personas, coches o animales—aparecen como apenas unos píxeles. Este artículo presenta un nuevo sistema de visión por computador, CEIFNet, diseñado específicamente para localizar estos objetos minúsculos con mayor precisión y rapidez, incluso cuando están rodeados de calles abarrotadas, campos o ruido nocturno.

Ver objetos pequeños en una imagen amplia

Los sistemas estándar de detección de objetos se construyeron principalmente para fotos a nivel del suelo, donde un coche o una persona suele ocupar una parte notable del encuadre. En imágenes de dron, sin embargo, la cámara puede estar a cientos de metros, por lo que cada objetivo es minúsculo y se difumina o se pierde fácilmente cuando la imagen se reduce dentro de una red neuronal. Los autores explican que detectores de un solo paso populares, como la familia YOLO, funcionan bien en escenas cotidianas pero tienen dificultades cuando los objetos son a la vez diminutos y muy variados en tamaño. El muestreo hacia abajo repetido, diseñado para comprender toda la escena, tiende a borrar las señales débiles de estos objetivos pequeños.

Combinar visión en primer plano con contexto de conjunto

Para abordarlo, CEIFNet combina dos formas complementarias de ver. Un camino utiliza filtros convolucionales clásicos, buenos para captar patrones locales nítidos como esquinas y texturas. El otro camino emplea un mecanismo de atención al estilo Transformer, que sobresale en relacionar partes distantes de la imagen y entender la escena en su conjunto. Dentro del bloque central, llamado bloque transformador entre etapas, las características entrantes de la imagen se dividen: la mayoría de los canales pasan por una vía convolucional ligera, mientras que una porción menor atraviesa una vía de atención que razona sobre relaciones a larga distancia. Luego se recombinan, dando a la red tanto detalles finos como conciencia global sin disparar su coste computacional.

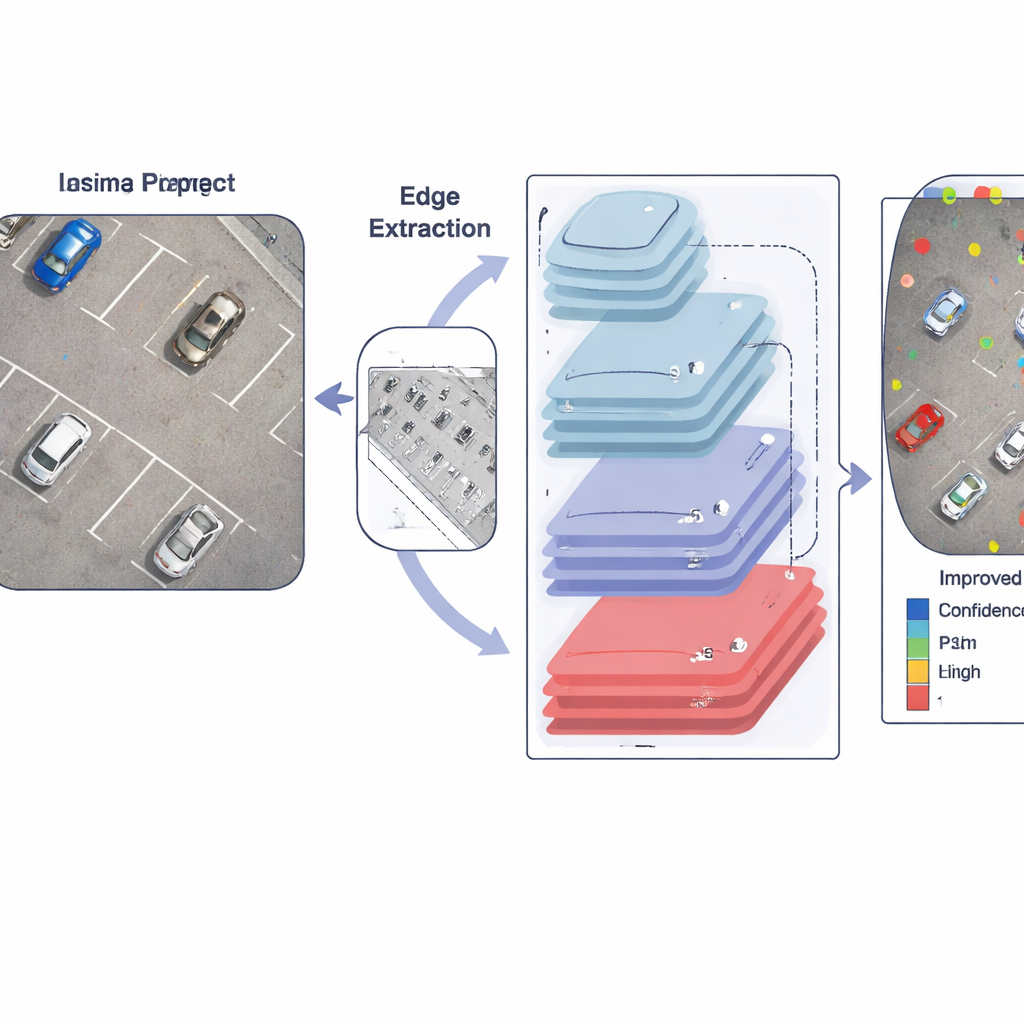

Usar bordes como mapa para objetivos diminutos

Una idea clave del artículo es que los contornos de los objetos—los bordes—son especialmente valiosos cuando los objetivos ocupan solo unos pocos píxeles. En lugar de confiar únicamente en filtros aprendidos, los autores inyectan deliberadamente información de bordes en la red. Un módulo dedicado aplica primero un operador Sobel, un detector de bordes simple pero robusto, para resaltar dónde cambian bruscamente las intensidades, por ejemplo alrededor de los contornos de coches o personas. Estos mapas de bordes se agregan luego en varios tamaños para coincidir con diferentes escalas de característica y se fusionan mediante un módulo intercanal. A medida que la imagen avanza por la red, estas señales de borde reforzadas se alimentan repetidamente a capas posteriores, ayudando al modelo a seguir dónde comienzan y terminan los objetos pequeños a pesar del habitual difuminado y reducción.

Adaptarse al tamaño, la posición y la complejidad de la escena

En la salida, CEIFNet utiliza una cabeza de detección dinámica que puede ajustar su comportamiento según lo que observa. En lugar de usar filtros fijos, esta etapa final aplica tres formas de atención a la vez: puede preferir ciertos tamaños de objeto, centrarse en las ubicaciones más prometedoras de la imagen y enfatizar los canales de características más informativos. Junto con una estructura de pirámide de características que conserva una capa extra de gran detalle, esto hace que el sistema responda mejor a objetivos diminutos y densamente agrupados en metraje de dron realista, desde intersecciones concurridas hasta aparcamientos llenos y escenas térmicas por infrarrojo nocturno.

Demostrando las mejoras en escenarios reales con drones

Los investigadores probaron CEIFNet en dos conjuntos de datos exigentes de drones: VisDrone2019, compuesto por escenas urbanas y suburbanas diurnas, y HIT-UAV, una colección infrarroja térmica donde muchos objetivos son tenues y pequeños. En ambos, el nuevo sistema detectó objetos con mayor precisión que una sólida línea base basada en YOLO y frente a una variedad de otros detectores modernos, mientras seguía siendo lo bastante rápido para uso en tiempo real en una GPU potente. Experimentos de ablación cuidadosamente diseñados mostraron que cada componente—el bloque híbrido, el módulo de bordes, la capa fina adicional y la cabeza dinámica—contribuyó a la mejora global.

Qué significa esto para la tecnología cotidiana

Para el público general, la conclusión es que CEIFNet ofrece una forma más inteligente para que los drones «noten las cosas pequeñas» en escenas grandes y complejas. Al preservar la información de bordes, mezclar detalle local con contexto global y adaptar su atención de forma dinámica, la red puede detectar objetos pequeños que otros sistemas pasan por alto o colocan mal. Esto hace que la monitorización aérea sea más fiable para tareas como la seguridad vial, la búsqueda y rescate y la agricultura de precisión, y apunta hacia sistemas futuros capaces de extraer información confiable desde vistas cada vez más altas y amplias de nuestro mundo.

Cita: Xiao, J., Li, C., Chen, H. et al. Cross-stage edge information fusion network for small object detection in aerial images. Sci Rep 16, 7639 (2026). https://doi.org/10.1038/s41598-026-36251-5

Palabras clave: detección de objetos aéreos, objetos pequeños, imágenes con drones, aprendizaje profundo