Clear Sky Science · es

Monitorización del entorno agrícola e identificación de objetos basada en YOLO optimizado y configuraciones SSD de un solo disparo usando imágenes combinadas visuales y térmicas

Ojos más inteligentes para máquinas agrícolas más seguras

Los tractores y cosechadoras modernos son más grandes, rápidos y están más automatizados, lo que plantea una pregunta sencilla pero grave: ¿cómo asegurarse de que no golpeen a personas, animales u otras máquinas ocultas por polvo, niebla u oscuridad? Este artículo describe un sistema de seguridad práctico que proporciona a los equipos agrícolas una especie de “supervisión” al combinar cámaras de vídeo convencionales y térmicas, y compara distintas configuraciones de inteligencia artificial para ver cuál detecta peligros con mayor precisión y rapidez.

Por qué el trabajo agrícola necesita mejor visión

La agricultura depende cada vez más de grandes máquinas potentes que trabajan muchas horas, a menudo por la noche o con mal tiempo. Una cámara de vídeo básica puede ayudar al operador a ver alrededor de un tractor, pero las imágenes ordinarias fallan cuando hay niebla, lluvia, deslumbramiento o oscuridad. Las cámaras térmicas, que captan calor en lugar de luz, funcionan bien en esas condiciones difíciles y hacen que los cuerpos calientes—personas y animales—resalten sobre el fondo. Los autores sostienen que combinar ambos tipos de imágenes es la mejor forma de construir un sistema de aviso asequible que pueda instalarse en máquinas existentes y integrarse con los paneles de control estándar del tractor.

Cómo funcionan los sistemas dual y unificado

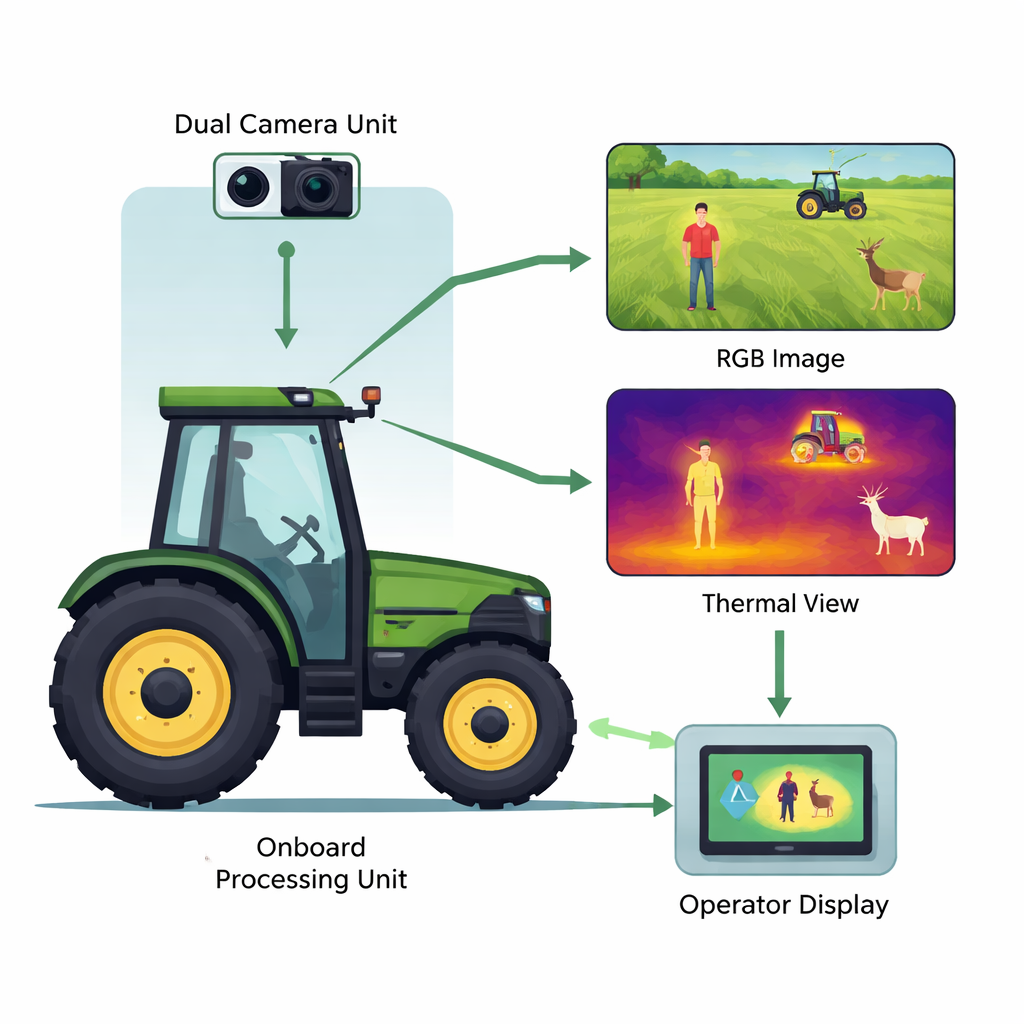

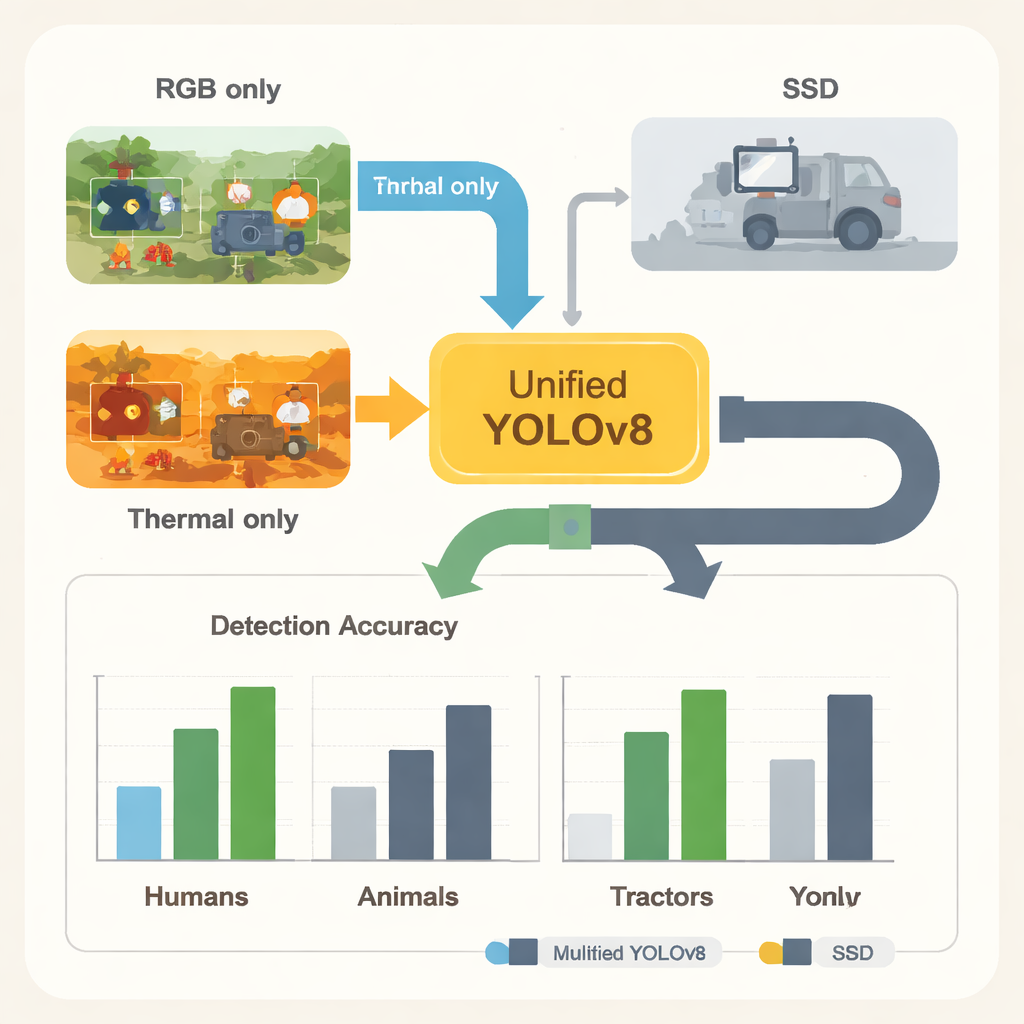

El equipo montó una unidad combinada de cámara RGB (color normal) y térmica en el techo de un tractor y envió ambas corrientes de imagen a una unidad de procesamiento de bajo coste en la cabina. Exploraron dos formas principales de usar inteligencia artificial para detectar objetos en esas imágenes. En el primer enfoque, «red dual», una red neuronal se entrenó solo con imágenes normales y una segunda red solo con imágenes térmicas; sus resultados se fusionaron después. En el segundo enfoque, «unificado», las dos imágenes se alinearon cuidadosamente, se apilaron y se introdujeron en una única red que aprendió de ambas a la vez. Ambos diseños se implementaron con una familia de modelos de detección de objetos rápidos conocida como YOLOv8 y con un diseño alternativo llamado SSD, adaptado para pequeños ordenadores embebidos.

Construir y entrenar la visión de la máquina del campo

Para enseñar a estas redes qué buscar, los investigadores reunieron un gran conjunto de datos a partir de bibliotecas de imágenes públicas y sus propias grabaciones de cámaras. Las imágenes incluían personas, animales silvestres y domésticos, tractores, cosechadoras, camiones, autobuses y otras máquinas agrícolas, en vistas tanto visibles como térmicas. Cada objeto fue rodeado por un recuadro dibujado a mano y etiquetado, y las imágenes se aumentaron—se voltearon, rotaron o desenfocaron ligeramente—para imitar la variedad vista en campos reales. Los datos se dividieron en conjuntos de entrenamiento, validación y prueba para que las redes pudieran aprender con una porción y ser evaluadas de forma justa con imágenes que nunca habían visto. Se prestó especial atención a medir no solo la precisión bruta, sino también cuántas operaciones de cálculo y cuántos fotogramas por segundo necesitaba cada modelo, ya que cualquier sistema real para tractores debe funcionar rápida y fiablemente en el campo.

¿Qué ojos digitales funcionaron mejor?

En miles de imágenes de prueba, todas las configuraciones de YOLOv8 detectaron la mayoría de los objetivos muy bien, especialmente máquinas agrícolas grandes y animales de sangre caliente. El modelo unificado que integró datos RGB y térmicos en una única corriente alcanzó una puntuación global (precisión media) de alrededor de 0,90, ligeramente por delante del enfoque de red dual con 0,88. En otras palabras, fusionar ambos tipos de visión dentro de una sola red dio una mejora pequeña pero real en el rendimiento sin hacer el sistema más complejo de operar. Las mayores ganancias de la imagen térmica aparecieron para personas y animales en condiciones de poca luz, mientras que las imágenes normales seguían siendo mejores para formas detalladas como los tractores. Cuando el equipo sustituyó YOLOv8 por su modelo SSD simplificado, el rendimiento cayó de forma notable para la mayoría de las clases, aunque SSD entrenó mucho más rápido. YOLOv8, especialmente su versión más pequeña «Nano», ofreció mayor precisión al tiempo que alcanzaba velocidades en tiempo real de alrededor de 27 fotogramas por segundo en hardware modesto.

Convertir las detecciones de la IA en avisos sencillos

En lugar de abrumar al conductor con transmisiones de vídeo, el sistema convierte las detecciones en una vista de tablero sencilla que sigue un estándar de comunicación común en tractores (ISOBUS). En un panel verde simple, iconos muestran si hay una persona, un animal o un vehículo frente a la máquina, junto con la distancia, la dirección y el grado de confianza del sistema. Esta interfaz simplificada puede ejecutarse en terminales de operador existentes y está diseñada para condiciones agrícolas duras, con cámaras protegidas, montajes estabilizados y control de polvo y temperatura previsto para versiones futuras.

Qué significa esto para la agricultura cotidiana

Para un público no especializado, la conclusión es que dotar a los tractores de “dos tipos de ojos” y un cerebro de IA bien elegido puede mejorar sustancialmente la seguridad sin requerir hardware exótico. Una única red YOLOv8 cuidadosamente ajustada que mezcle vistas normales y térmicas ofrece la mejor combinación de precisión, velocidad y simplicidad entre las opciones probadas, superando claramente al diseño SSD. Aunque el sistema todavía tiene dificultades para reconocer humanos en todas las situaciones—en parte porque había menos ejemplos de ellos en los datos de entrenamiento—el estudio muestra que los sistemas de aviso prácticos basados en cámaras para maquinaria agrícola son tanto factibles como casi listos para el campo. Con datos más equilibrados y métodos de fusión refinados, versiones futuras podrían ayudar a prevenir accidentes, proteger la fauna y hacer la agricultura a gran escala más segura para todos en y alrededor del campo.

Cita: Tarasiuk, K., Mystkowski, A., Ostaszewski, M. et al. Agriculture surrounding monitoring and object identification based on optimized you only look once and single shot multibox detector setups using combined vision and thermal images. Sci Rep 16, 5129 (2026). https://doi.org/10.1038/s41598-026-36181-2

Palabras clave: seguridad agrícola, imágenes térmicas, visión por ordenador, detección de objetos, YOLOv8