Clear Sky Science · es

Fusión de características espacio-temporales guiada por atención para la detección robusta de anomalías en videovigilancia

Por qué importan las cámaras más inteligentes

Desde estaciones de tren abarrotadas hasta centros comerciales, la vida moderna está llena de cámaras de seguridad que graban en silencio todo lo que ocurre. Sin embargo, la mayoría de estos vídeos siguen siendo vigilados —si acaso— por ojos humanos cansados que pueden pasar por alto un momento crucial. Este artículo explora un nuevo tipo de sistema de vigilancia “inteligente” que puede detectar automáticamente comportamientos inusuales o riesgosos, como robos o actos de vandalismo, en tiempo real al comprender tanto qué aparece en una escena como cómo cambia con el tiempo.

Ver más que píxeles

Un flujo de cámara tradicional es solo una secuencia de imágenes. Los sistemas informáticos antiguos trataban de detectar problemas mirando cada fotograma por separado, buscando formas y contornos que se asemejaran a personas u objetos. Los autores primero prueban una versión moderna de esta idea que utiliza una red compacta de reconocimiento de imágenes combinada con detectores clásicos de bordes. Esta configuración funciona razonablemente bien en escenas bien encuadradas, especialmente para notar señales visuales claras como alguien agarrando un objeto. Pero, al centrarse en instantáneas individuales, tiene dificultades cuando las personas se tapan entre sí, cuando las multitudes son densas o cuando la misma postura puede significar un comportamiento normal o sospechoso según cómo evolucione en el tiempo.

Comprender el movimiento y el comportamiento

Para capturar la historia detrás de una acción, no solo la apariencia de un único fotograma, el estudio evalúa a continuación un modelo orientado al vídeo que analiza pequeños fragmentos en lugar de imágenes fijas. Este modelo aprende cómo fluye el movimiento a lo largo de varios fotogramas y puede identificar mejor cambios repentinos como correr, pelear o arrebatar. Demuestra ser bueno captando muchos eventos anómalos, lo que conduce a alta sensibilidad. Sin embargo, también sufre un problema clásico del mundo real: los sucesos verdaderamente inusuales son raros en comparación con la actividad cotidiana. Como resultado, el modelo puede volverse inestable, generando demasiadas falsas alarmas y requiriendo segmentos de vídeo cuidadosamente recortados que no reflejan la naturaleza desordenada y continua de las grabaciones de vigilancia reales.

Mezclando el dónde y el cuándo

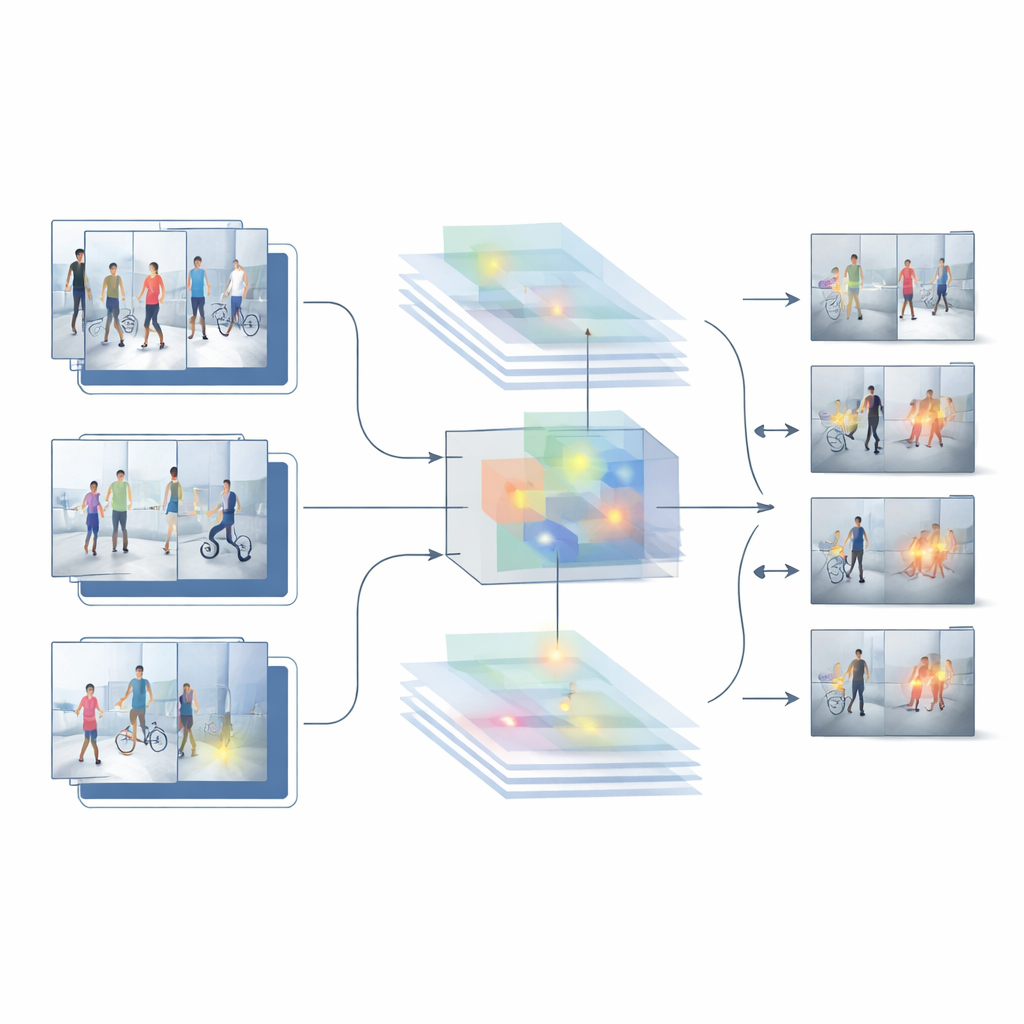

Basándose en las fortalezas y debilidades de estas dos referencias, los autores proponen un nuevo sistema híbrido llamado HybridModel-1 que pretende “pensar” en espacio y tiempo a la vez. Combina una red muy buena en entender qué objetos están presentes en cada fotograma con un detector rápido que localiza esos objetos en la escena. Un módulo de fusión especial aprende a enfatizar los detalles visuales más informativos —como personas y objetos clave— mientras atenúa el desorden de fondo como paredes, árboles o coches que pasan. Al mismo tiempo, una nueva estrategia de entrenamiento penaliza suavemente al sistema cuando su confianza salta de forma abrupta de un fotograma a otro, empujándolo hacia decisiones más suaves y consistentes a lo largo de todo un vídeo.

Poniendo el sistema a prueba

Para comprobar si este diseño funciona fuera del laboratorio, los investigadores lo prueban en varios conjuntos de datos públicos desafiantes de metraje de vigilancia real. Estas colecciones incluyen desde escenas de robo en interiores hasta paseos al aire libre en campus, con posiciones de cámara, iluminación, tamaños de multitud y tipos de incidentes variados. En estos bancos de prueba, el modelo híbrido supera tanto a las referencias basadas solo en imagen como a las basadas solo en vídeo. Logra una mayor precisión global, genera muchas menos falsas alarmas y mantiene un rendimiento sólido incluso al evaluarse con metraje en el que no fue entrenado. Comparaciones detalladas y estudios de ablación —donde se eliminan o modifican partes del sistema— muestran que tanto el módulo de fusión de características como el paso de entrenamiento enfocado en la suavidad contribuyen de manera significativa a estas mejoras.

Qué significa esto para la seguridad cotidiana

En términos sencillos, este trabajo muestra que los sistemas de vigilancia son más fiables cuando aprenden a prestar atención a las partes adecuadas de una escena y a mantenerse firmes en sus juicios a lo largo del tiempo. En lugar de tratar cada fotograma como una imagen aislada o depender únicamente del movimiento bruto, el enfoque propuesto combina el “qué” y el “cuándo” en un único marco cuidadosamente ajustado. Si bien persisten desafíos en vistas extremadamente oscuras o muy obstruidas, los resultados sugieren un camino práctico hacia redes de cámaras que puedan filtrar en silencio grandes cantidades de vídeo, destacar eventos realmente sospechosos y reducir la carga de falsas alarmas para los operadores humanos. Para el público, eso podría significar espacios más seguros vigilados por sistemas que no solo miran, sino que realmente entienden lo que ven.

Cita: Nivethika, S.D., Joshi, S., Verma, K. et al. Attention-guided saptio-temporal feature fusion for robus video surveillance anomaly detection. Sci Rep 16, 8027 (2026). https://doi.org/10.1038/s41598-026-36130-z

Palabras clave: videovigilancia, detección de anomalías, cámaras inteligentes, detección de delitos, aprendizaje automático