Clear Sky Science · es

Seguridad y eficacia de modelos que preservan la privacidad para crear resúmenes en lenguaje sencillo de informes de RM cerebral

Por qué su informe de exploración puede resultar tan confuso

Cada vez más pacientes pueden leer sus propios resultados de pruebas en línea, incluidos informes detallados de radiología de exploraciones cerebrales. Pero estos documentos están redactados para médicos, no para pacientes, y están llenos de términos desconocidos que pueden alimentar la inquietud en lugar de ofrecer tranquilidad. Este estudio plantea si los programas modernos de inteligencia artificial (IA) pueden transformar de forma segura informes reales de RM cerebral de urgencias —escritos en francés para personas con cefalea— en resúmenes en lenguaje llano que los pacientes puedan entender, sin enviar datos médicos sensibles a servidores comerciales remotos.

Convertir el lenguaje médico en palabras cotidianas

Los investigadores se centraron en los “resúmenes para legos”: explicaciones breves que conservan los hechos médicos pero los traducen a un lenguaje cotidiano y relacionan directamente los hallazgos con los síntomas del paciente. Emplearon tres grandes modelos de lenguaje (LLM): Llama 3.3, Athene V2 y Mistral Small, ejecutados íntegramente en ordenadores dentro de un hospital universitario francés, de modo que ningún informe salió de la red segura del hospital. Cada sistema de IA recibió la misma instrucción: redactar un resumen de 4–6 frases en francés para un paciente, abarcando todos los puntos clave, explicando términos complejos y conectando los hallazgos de la exploración con la cefalea del paciente.

Cómo valoraron los médicos la exactitud y la seguridad

A partir de casi 600 informes de RM cerebral redactados en 2022 para pacientes de urgencias con cefalea, el equipo seleccionó aleatoriamente 105. Tres neurorradiólogos experimentados leyeron cada informe original junto con tres resúmenes generados por IA de forma anónima (uno por cada modelo). Los valoraron en términos de corrección médica, exhaustividad, utilidad para explicar a los pacientes y si el texto era lo suficientemente bueno para mostrarse directamente en el portal en línea del paciente. En promedio, las valoraciones fueron altas: los médicos juzgaron que los resúmenes eran en gran medida precisos y completos, y a menudo aptos para uso clínico. Aun así, aproximadamente uno de cada cinco resúmenes contenía al menos un problema, como una explicación errónea de una abreviatura, una descripción anatómica ligeramente imprecisa, frases torpes o un detalle inventado que no figuraba en el informe original.

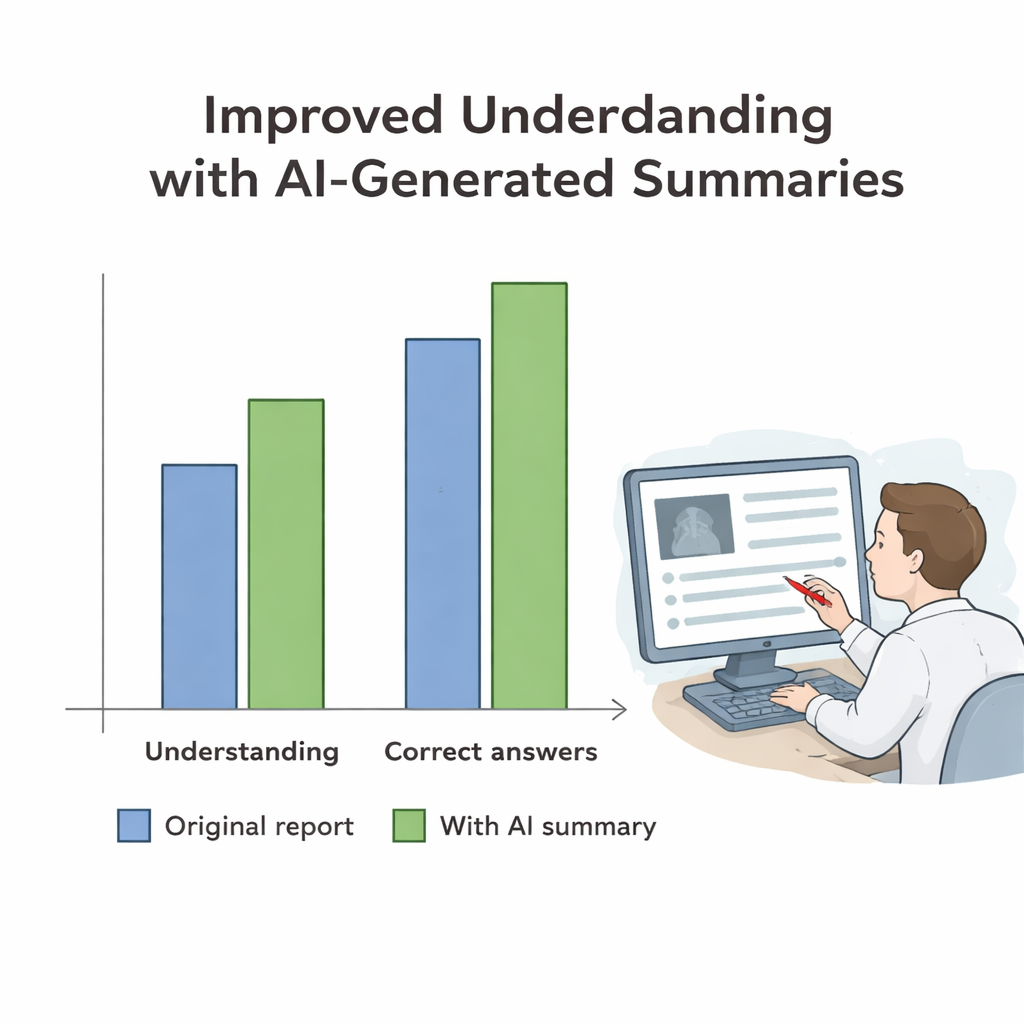

Lo que realmente entendieron las personas no médicas

Para comprobar si estos resúmenes realmente ayudaban a lectores legos, los investigadores reclutaron a 11 no médicos que trabajan en informática médica y manejan datos sanitarios con regularidad, pero que no son médicos. Este grupo valoró 30 informes de RM, algunos en su forma original y otros con un resumen de IA añadido. Puntualizaron cuánto creían haber entendido cada informe, cuánta confianza tendrían para explicar los resultados a amigos o familiares y cuánta ansiedad sentirían si el informe fuera el suyo. También respondieron preguntas sencillas de sí/no: ¿hay alguna anomalía en este informe? y ¿hay algún hallazgo que pueda explicar razonablemente la cefalea del paciente?

Informes más claros, ganancias modestas pero reales en comprensión

Agregar resúmenes generados por IA aumentó de forma notable la sensación de comprensión de los participantes, elevando la comprensión autoevaluada media de niveles “moderados” a “altos”. Su confianza para poder comentar los resultados con otros también aumentó, mientras que la ansiedad reportada disminuyó ligeramente. En cuanto a la comprensión objetiva, el efecto fue más modesto pero aún significativo. Los participantes mejoraron en identificar cuándo una exploración era anómala y en reconocer hallazgos que podrían realmente causar la cefalea, con mejoras concentradas en los informes que contenían anomalías reales. Para exploraciones normales, las personas ya estaban casi perfectas en reconocer que no se había hallado nada grave, por lo que los resúmenes aportaron poco beneficio adicional.

Por qué la supervisión humana sigue siendo importante

Aunque estas herramientas de IA que preservan la privacidad mejoraron sustancialmente la claridad percibida y ofrecieron ganancias pequeñas pero importantes en la comprensión fáctica, no fueron infalibles. Aproximadamente el 20 % de los resúmenes contenía errores médicos o lingüísticos, a menudo vinculados a abreviaturas médicas complejas o a palabras en inglés y chino que se colaban en oraciones en francés. Dado que incluso pequeños errores pueden inducir a engaño a los pacientes, los autores sostienen que la IA debe usarse en un esquema de “humano en el bucle”: el modelo redacta un resumen accesible para el paciente y un radiólogo lo revisa y corrige rápidamente antes de que llegue al paciente. Usada de este modo, el estudio sugiere que la IA local podría ayudar a los hospitales a ofrecer explicaciones más claras y tranquilizadoras de los resultados de RM cerebral, manteniendo los datos sanitarios sensibles de forma segura dentro de sus instalaciones.

Cita: Le Guellec, B., Bentegeac, R., Shorten, L. et al. Safety and efficacy of privacy-preserving models to create Lay summaries of brain MRI reports. Sci Rep 16, 6316 (2026). https://doi.org/10.1038/s41598-026-36081-5

Palabras clave: informes de radiología, comunicación con el paciente, RM cerebral, grandes modelos de lenguaje, privacidad médica