Clear Sky Science · es

M6: bases de datos de detección de música generada por máquina multi-generador, multi-dominio, multilingüe y multicultural, multi-géneros, multi-instrumental

Por qué importa el auge de la música creada por IA

Las plataformas de streaming musical se están llenando discretamente de canciones no escritas por personas, sino por algoritmos. Estas pistas generadas por máquinas pueden ser herramientas útiles para la terapia, bandas sonoras o listas de reproducción cotidianas, pero también difuminan la línea entre la creatividad humana y la producción automatizada. Este artículo presenta M6, una gran colección musical nueva creada para ayudar a los investigadores a distinguir entre música hecha por humanos y por IA y a comprender qué las hace diferentes. Su objetivo es apoyar un reconocimiento justo de los artistas sin impedir que la IA desempeñe un papel constructivo en la creación musical.

Construyendo un gran banco de pruebas musical

Los autores sostienen que el progreso en la detección de música generada por IA se ha visto limitado por la falta de datos adecuados. Las colecciones existentes se centran en otras tareas, como emparejar música con descripciones textuales, o cubren solo una porción reducida de estilos musicales. M6 está diseñado para llenar ese vacío. Combina miles de pistas hechas por humanos con miles creadas por varios sistemas de IA, empaquetadas en un formato de audio estándar. El conjunto de datos es intencionalmente amplio: abarca muchos instrumentos, idiomas, culturas, géneros, duraciones de canciones y tanto piezas vocales como instrumentales de fondo. Esta rica variedad permite a los científicos comprobar si los métodos de detección funcionan en entornos musicales realistas y en constante cambio.

Reuniendo canciones de personas y máquinas

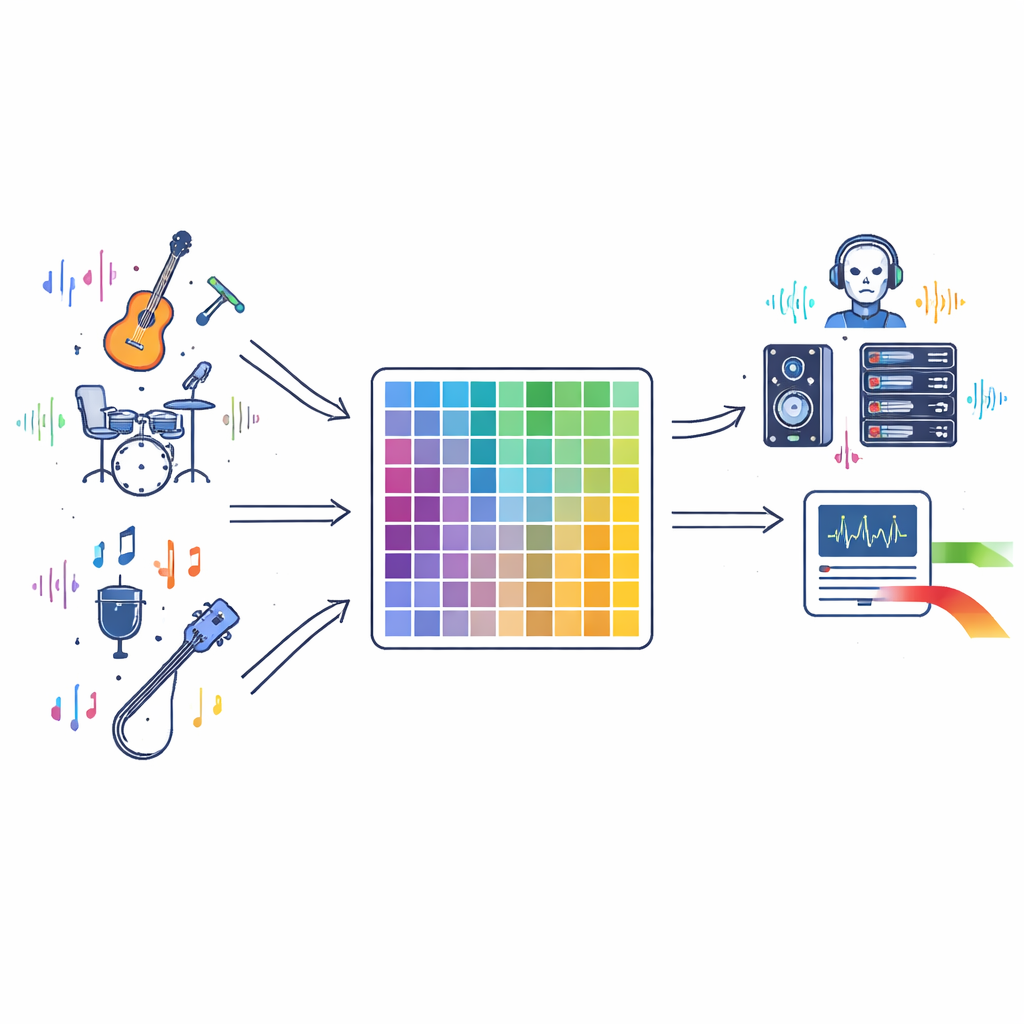

Para ensamblar la parte humana de M6, el equipo recurrió a colecciones abiertas bien conocidas como GTZAN (para géneros musicales), el Free Music Archive, COSIAN (música vocal japonesa) y un conjunto de datos de sonidos de instrumentos individuales. También muestrearon canciones adicionales de plataformas de streaming cuando las licencias lo permitieron, eligiendo fragmentos que mostraran claramente la idea musical principal en lugar de meros interludios breves. En el lado de las máquinas, generaron música nueva usando varios sistemas de última generación, incluidos modelos de investigación abiertos y herramientas comerciales. Indicaciones cuidadosamente diseñadas, algunas producidas por un modelo de lenguaje, pidieron a estos sistemas crear música en estilos, tempos o con instrumentos específicos, de modo que las pistas de IA replicaran la diversidad de la música humana.

Comprobando la calidad y detectando diferencias sutiles

Dado que los juicios sobre la calidad musical son subjetivos, los autores combinaron opiniones de oyentes con medidas objetivas. Calculaban descriptores numéricos sencillos para cada pista, capturando aspectos como la complejidad rítmica, la amplitud melódica, el brillo del espectro sonoro y la energía global de la señal. En promedio, las piezas hechas por IA diferían de las humanas en estas medidas—por ejemplo, con rangos de altura ligeramente más estrechos o menor energía total—pero las diferencias eran lo suficientemente pequeñas como para que la mayoría de los oyentes no las notaran sin una comparación cuidadosa. En pruebas de audición con 50 voluntarios, la gente identificó correctamente si un clip era humano o generado por IA solo en aproximadamente la mitad de los casos, esencialmente sin mejorar la probabilidad de acertar por azar. Esto sugiere que la música de IA ya ha alcanzado un nivel de pulido que puede engañar con facilidad a oyentes casuales.

Poniendo a prueba los métodos de detección

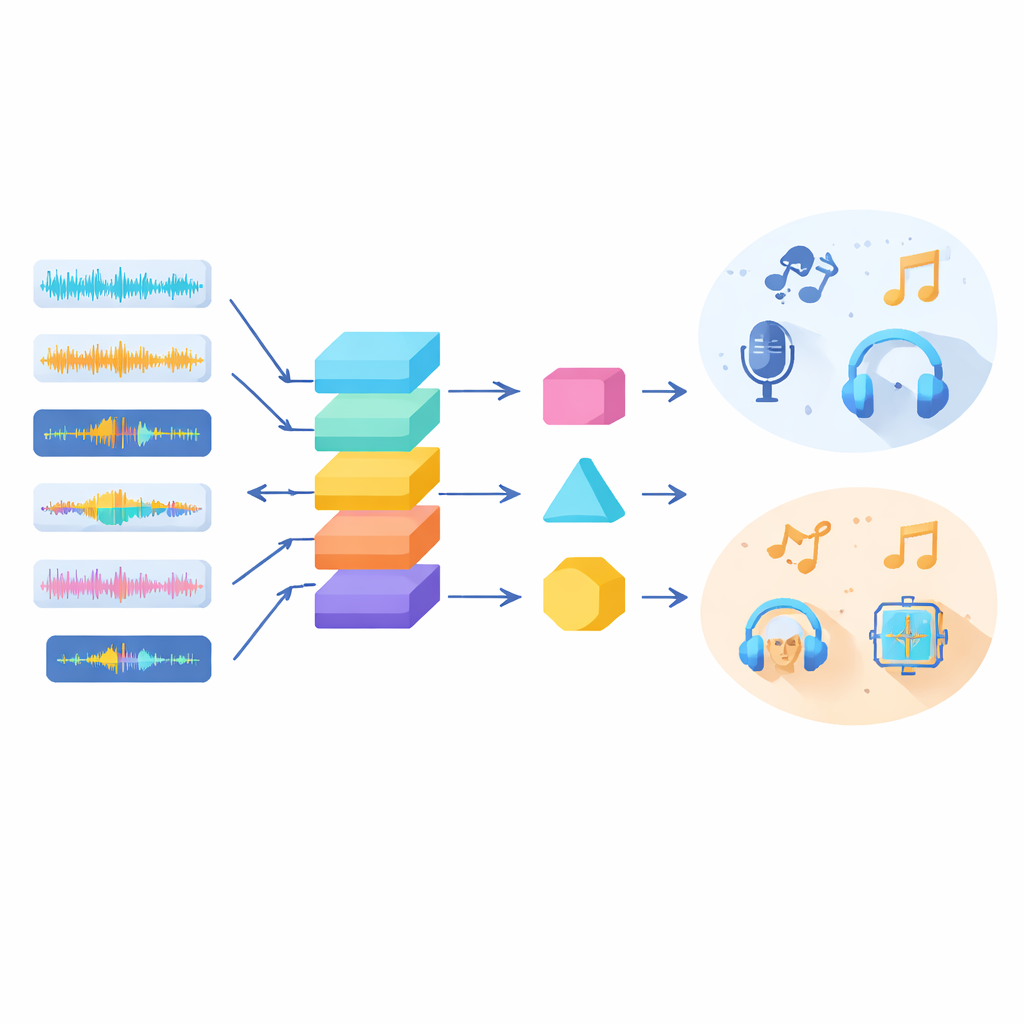

Con M6 disponible, los investigadores evaluaron una variedad de modelos informáticos para ver qué tan bien podían detectar música generada por IA. Probaron aprendizaje automático clásico, redes neuronales tipo imagen que procesan espectrogramas, modelos transformadores y sistemas de audio modernos diseñados originalmente para detectar discurso falso. Cuando los modelos se entrenaron y evaluaron en tipos de música similares, varios alcanzaron alta precisión, especialmente las redes convolucionales centradas en patrones en la representación tiempo–frecuencia del sonido. Sin embargo, el rendimiento cayó drásticamente cuando los modelos se enfrentaron a música «fuera de dominio»: estilos, idiomas o generadores que no habían visto antes. El estudio también reveló que distintos sistemas de música por IA dejan «huellas» acústicas diferentes, lo que hace que algunos generadores sean más fáciles de detectar que otros y plantea la preocupación de que los detectores puedan sobreajustarse a herramientas concretas en lugar de captar rasgos más profundos de la música generada por máquinas.

Qué implica esto para la música y la IA

El proyecto M6 muestra que, si bien los ordenadores suelen ser capaces de señalar con precisión la música generada por IA en entornos conocidos, la detección robusta en condiciones reales sigue siendo un gran desafío. Los oyentes humanos ya tienen dificultades para distinguirlas, y los algoritmos actuales flaquean cuando la música cambia de género, idioma, duración o método de generación. Al publicar un conjunto de datos grande, diverso y de acceso abierto, los autores esperan impulsar el desarrollo de herramientas de detección más fiables y transparentes. A su vez, esas herramientas podrían ayudar a mantener la confianza en las plataformas musicales digitales, apoyar el reconocimiento justo de los artistas humanos y orientar a futuros sistemas de IA hacia la colaboración con músicos en lugar de su sustitución silenciosa.

Cita: Li, Y., Li, H., Specia, L. et al. M6: multi-generator, multi-domain, multi-lingual and cultural, multi-genres, multi-instrument machine-generated music detection databases. Sci Rep 16, 9237 (2026). https://doi.org/10.1038/s41598-026-36044-w

Palabras clave: Música generada por IA, audio deepfake, detección de música, aprendizaje automático, creatividad digital