Clear Sky Science · es

Navegación autónoma en entornos exteriores no estructurados mediante aprendizaje por refuerzo guiado por segmentación semántica

Robots que aprenden a recorrer el bosque

Imagínese un pequeño robot capaz de recorrer un sendero forestal por sí mismo, sorteando árboles y rocas sin GPS ni un humano con un joystick. Este artículo presenta un sistema que enseña a esos robots a «ver» los caminos en bosques densos y a decidir, momento a momento, cómo avanzar con seguridad. El trabajo es relevante para futuros robots que podrían ayudar en monitorización forestal, prevención de incendios, búsqueda y rescate e incluso reparto al aire libre en zonas donde las señales satelitales son débiles o inexistentes.

Por qué los bosques son tan difíciles para los robots

Los bosques son algunos de los entornos más exigentes para máquinas autónomas. Los senderos pueden ser estrechos y sinuosos, el terreno es irregular, ramas y arbustos a menudo obstruyen la vista, y los árboles altos hacen que las señales GPS sean poco fiables. Los métodos tradicionales de navegación dependen de mapas precisos, GPS fuerte o sensores láser costosos, y con frecuencia suponen espacios claros y estructurados como calles urbanas o naves industriales. En el bosque, esas suposiciones se frustran: sombras, estaciones cambiantes y vegetación espesa confunden los sistemas de visión simples, mientras que los controladores basados en reglas luchan por manejar todas las situaciones desordenadas e inesperadas que surgen en un sendero real.

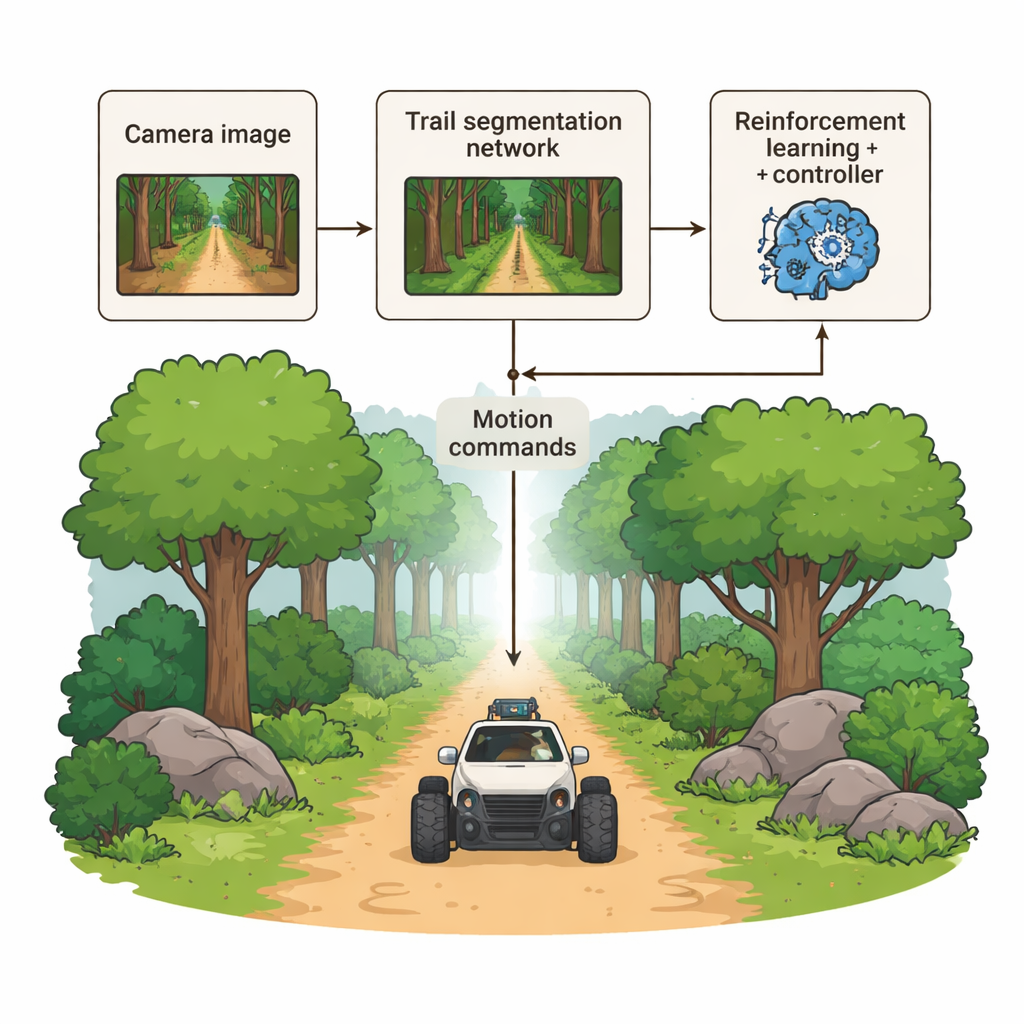

Tres «cerebros» que trabajan juntos

Los autores proponen un sistema de navegación híbrido que dota a los robots de tres «cerebros» complementarios. Primero, un módulo de visión profunda examina cada imagen de la cámara y marca, casi píxel a píxel, qué partes pertenecen al sendero transitable. Segundo, un módulo de decisión basado en aprendizaje utiliza aprendizaje por refuerzo para elegir comandos suaves de dirección y velocidad, recompensando el comportamiento que se mantiene en el sendero, evita colisiones y alcanza el objetivo de forma eficiente. Tercero, un controlador clásico convierte la forma del sendero predicha en movimientos de ruedas estables, alisando movimientos bruscos y manteniendo la trayectoria del robot elegante en lugar de entrecortada. En lugar de una única red de extremo a extremo opaca, estos módulos son independientes pero estrechamente vinculados, lo que permite a los ingenieros comprender y depurar cada etapa.

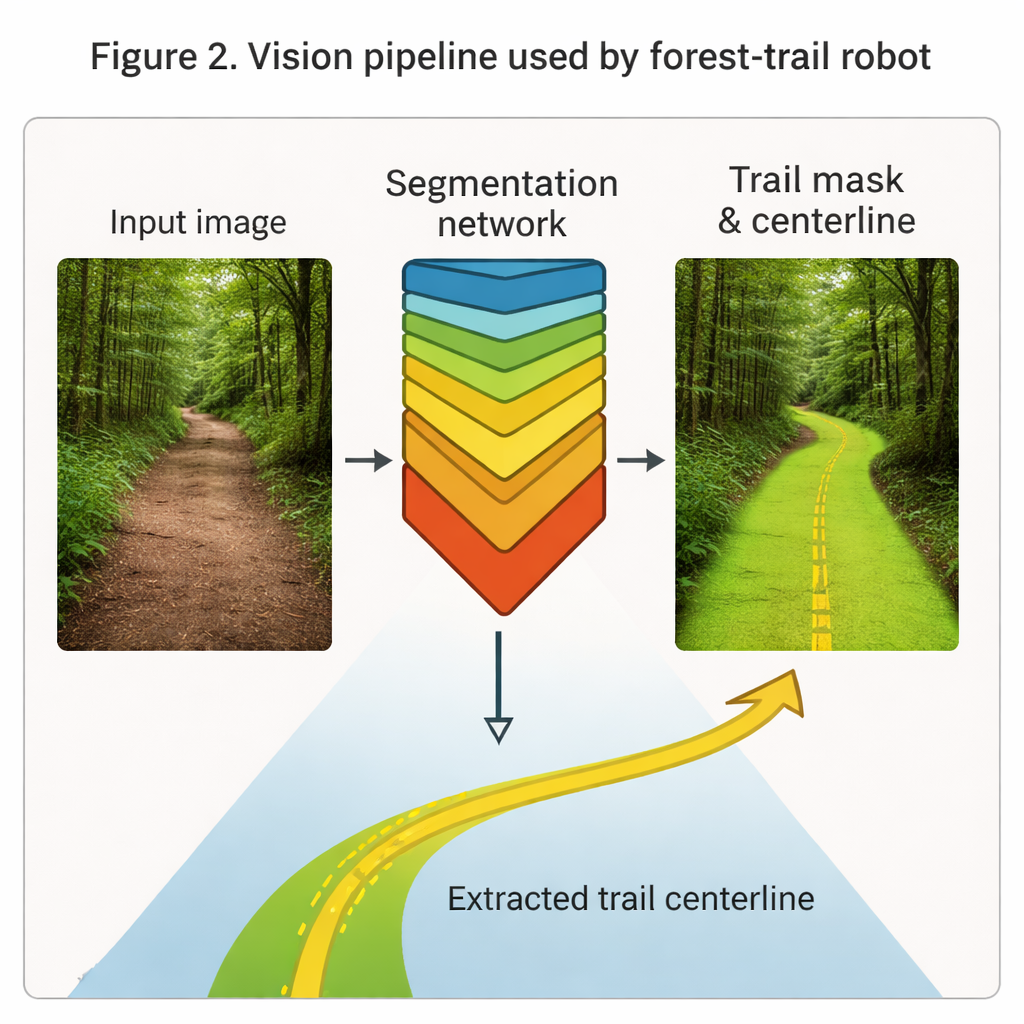

Enseñar a la visión a reconocer senderos

En el núcleo de los «ojos» del robot hay una red profunda conocida como Mask R-CNN, aquí afinada para resaltar los senderos forestales en imágenes en color ordinarias. Entrenada con casi 24 000 fotogramas etiquetados de grabaciones reales tomadas a altura humana bajo luz, clima y tipos de sendero variados, el sistema aprende a pintar la región del sendero en cada fotograma como una máscara limpia. A partir de esta máscara extrae una curva de línea central delgada que captura la dirección y la curvatura del camino por delante. En las pruebas, el módulo de visión logra una alta superposición con etiquetas dibujadas por humanos y más del 90 % de precisión a nivel de píxel, delineando de forma robusta los senderos incluso cuando ramas o sombras ocultan parcialmente la vía. Estas señales geométricas alimentan directamente tanto al módulo de aprendizaje como al de control como una descripción compacta de «dónde está el camino».

Entrenar a un robot para tomar buenas decisiones

La segunda pieza clave es el módulo de decisión, que utiliza una técnica llamada aprendizaje por refuerzo. En lugar de que le digan exactamente qué hacer, el robot prueba acciones en un bosque simulado realista y recibe recompensas por buenos resultados y penalizaciones por los malos. Avanzar por el sendero es bueno; desviarse, chocar con obstáculos o quedarse atascado es malo. Tras unos 150 000 pasos de entrenamiento, el sistema descubre gradualmente estrategias que lo mantienen centrado en el sendero, gestionan las curvas con elegancia y reaccionan de forma sensata cuando aparecen ramas o rocas en su camino. Para mantener los movimientos suaves y seguros, las acciones aprendidas pueden mezclarse con las del controlador clásico, lo que resulta especialmente útil en curvas cerradas o condiciones ruidosas.

Poner el sistema a prueba

Para evaluar qué tan bien funciona esta combinación, los investigadores construyeron tres bosques virtuales detallados: uno con senderos estrechos y abarrotados, otro con terreno empinado e irregular y grandes obstáculos, y un tercero lleno de bifurcaciones, callejones sin salida y senderos falsos distractores. En 90 pruebas en estos mapas, el robot alcanzó su objetivo sin colisiones en cerca del 87 % de los episodios, con un promedio de solo 0,2 golpes por ejecución y normalmente manteniéndose a unos 30 centímetros del centro del sendero. También completó las rutas de forma rápida y consistente. Cuando los autores eliminaron o simplificaron un módulo a la vez, el rendimiento cayó drásticamente—demostrando que los tres componentes son necesarios. En comparación con otros sistemas recientes, incluidos los que usan escáneres láser, este enfoque híbrido basado solo en visión ofreció la mejor combinación general de tasa de éxito, precisión y seguridad.

Qué significa esto para robots en el mundo real

Para un lector no especialista, la conclusión es que los robots están mejorando para recorrer senderos como usuarios cautelosos y competentes. Al combinar un fuerte sentido del contexto visual («esto es el camino»), toma de decisiones basada en la práctica («estos movimientos funcionaron bien antes») y un mecanismo de dirección estable, el sistema propuesto permite a un pequeño robot con ruedas navegar bosques complejos sin mapas ni GPS. Aunque el trabajo se probó en simulación y todavía enfrenta desafíos como iluminación extrema y tipos de sendero raros, ofrece un plan práctico para futuros robots de campo que puedan compartir entornos salvajes con personas, ayudándonos a inspeccionar bosques, apoyar equipos de rescate y gestionar los recursos naturales con mayor eficacia.

Cita: Tibermacine, A., Tibermacine, I.E., Akrour, D. et al. Autonomous navigation in unstructured outdoor environments using semantic segmentation guided reinforcement learning. Sci Rep 16, 2633 (2026). https://doi.org/10.1038/s41598-026-36022-2

Palabras clave: navegación autónoma, robótica forestal, visión por computador, aprendizaje por refuerzo, segmentación semántica