Clear Sky Science · es

Comprender el discurso sobre salud mental en Reddit con transformers y explicabilidad

Por qué importa hablar de sentimientos en línea

Muchas personas que luchan con ansiedad, depresión, trastorno bipolar o trastorno límite de la personalidad recurren a Internet antes de hablar con un profesional. Reddit, con sus comunidades anónimas, se ha convertido en un gran punto de encuentro para compartir miedos, pedir ayuda y apoyar a otros. Este estudio examina cómo son miles de estas conversaciones y cómo la inteligencia artificial puede clasificarlas y resaltar las palabras que la gente usa con más frecuencia cuando habla de distintos desafíos de salud mental.

Una mirada a las comunidades de apoyo

Los investigadores se centraron en cuatro grandes comunidades de Reddit dedicadas a la ansiedad, la depresión, el trastorno bipolar y el trastorno límite de la personalidad (a menudo abreviado como TLP). Cada publicación en su conjunto de datos estaba simplemente etiquetada por la comunidad de la que procedía, no por un diagnóstico médico. El equipo trató estas comunidades como “espacios de preocupación”, donde personas con problemas similares se reúnen para desahogarse, buscar consejos y ofrecer consuelo. Al estudiar cómo varía el lenguaje entre estos espacios, esperaban entender cómo las personas describen sus experiencias con sus propias palabras, fuera de una clínica.

Enseñar a los ordenadores a clasificar conversaciones

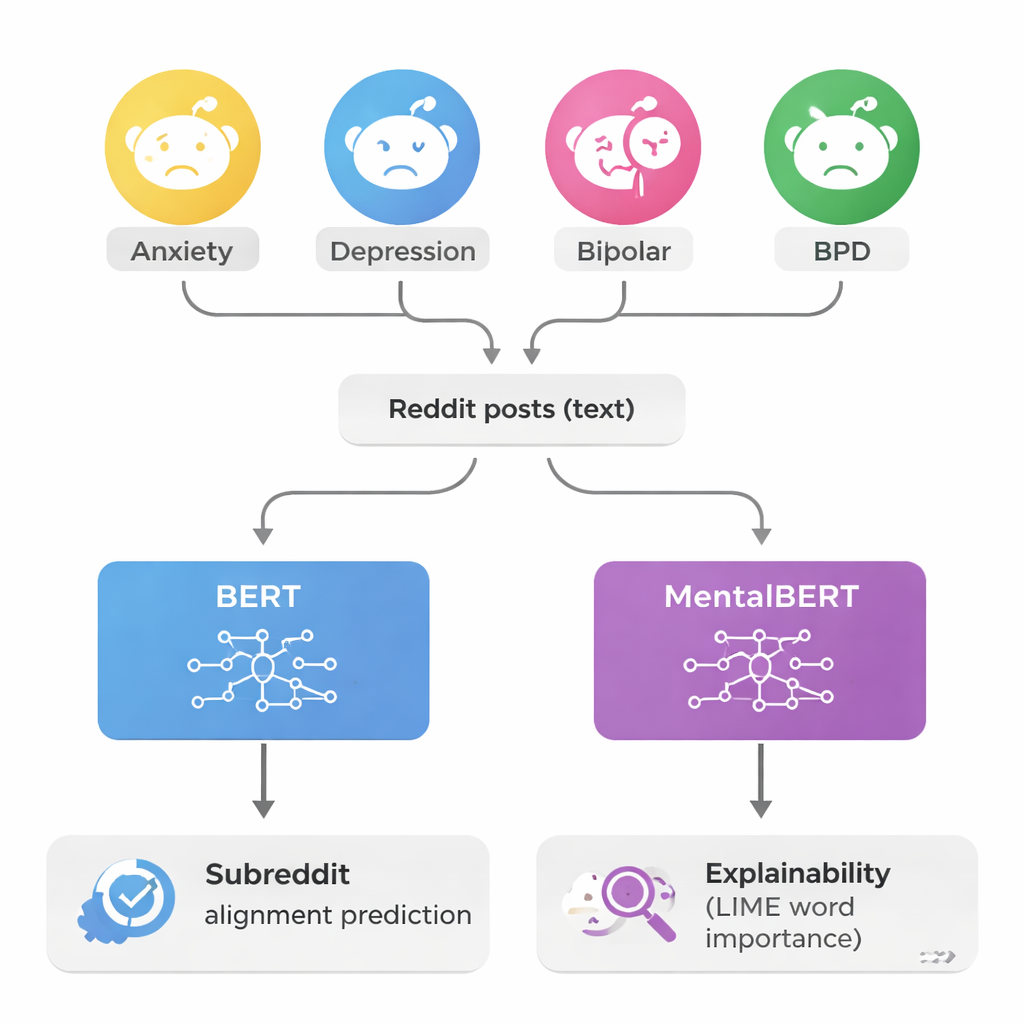

Para dar sentido a más de 150 000 publicaciones, los autores utilizaron potentes modelos de lenguaje llamados transformers, específicamente BERT y una versión centrada en salud mental llamada MentalBERT. Estos modelos leyeron cada publicación e intentaron adivinar a cuál de las cuatro comunidades pertenecía. Como algunas comunidades tenían muchas más publicaciones que otras, el equipo equilibró cuidadosamente el conjunto de datos para que cada grupo estuviera igualmente representado. Esto hizo la tarea más difícil pero más justa, obligando a los modelos a aprender realmente las diferencias en el lenguaje en lugar de favorecer simplemente las comunidades más comunes. En las pruebas, los modelos etiquetaron las publicaciones correctamente alrededor del 82 por ciento del tiempo —una mejora notable sobre el azar, que acertaría solo una cuarta parte de las veces.

Abrir la caja negra de la IA

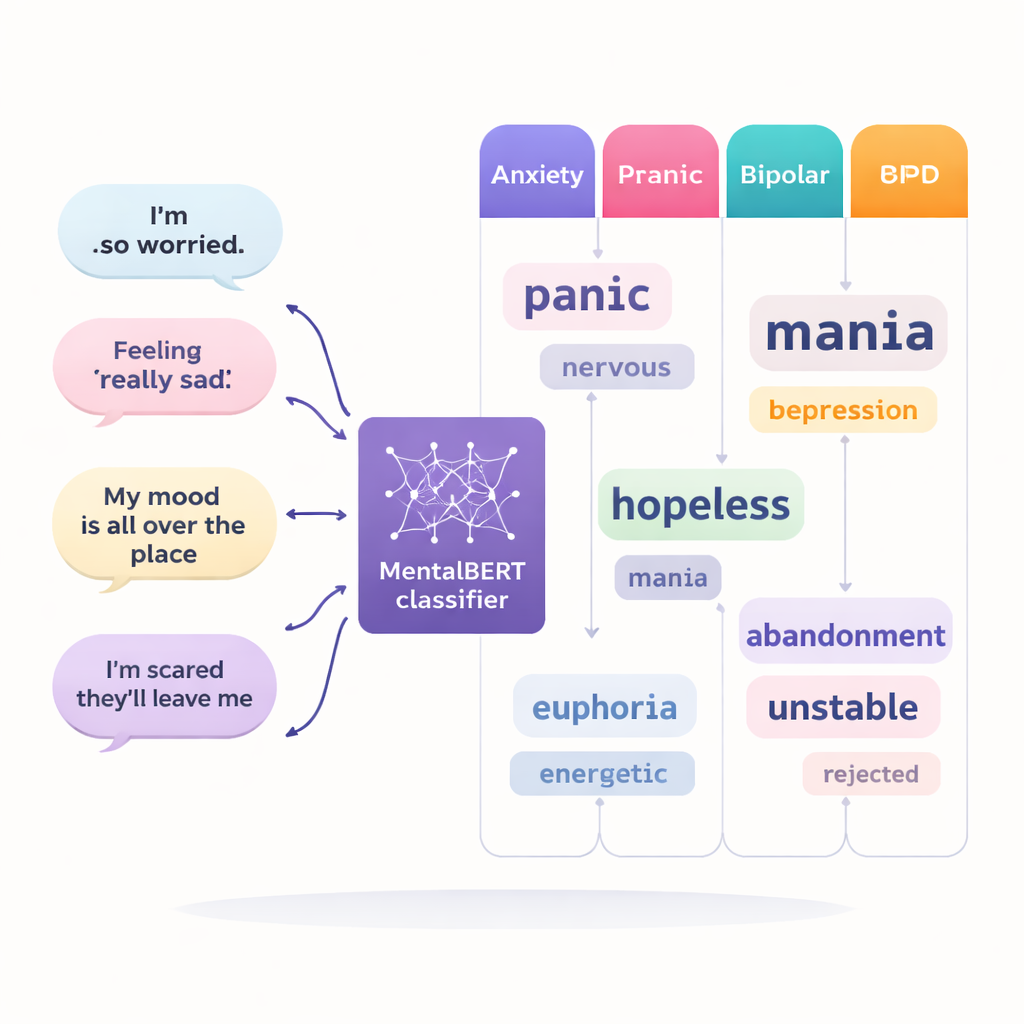

Una preocupación importante en la tecnología aplicada a la salud mental es que los sistemas informáticos pueden parecer «cajas negras» misteriosas que ofrecen predicciones sin razones claras. Para abordar esto, los investigadores utilizaron un enfoque llamado LIME que revela qué palabras impulsaron al modelo hacia una decisión concreta. En términos sencillos, LIME oculta o modifica fragmentos de una publicación y observa cómo cambia la respuesta del modelo. Si eliminar una palabra como «pánico» cambia de forma radical la comunidad predicha, esa palabra se considera importante. Al repetir este proceso miles de veces en muchas publicaciones, el equipo construyó listas de las palabras más influyentes para cada comunidad y comprobó que esas palabras concordaban con lo que los clínicos saben sobre cada condición.

Voces distintas para distintas luchas

Las explicaciones sacaron a la luz patrones claros en el lenguaje. En las comunidades de ansiedad, destacaban palabras como «pánico», «ataque» y «preocupación», a menudo vinculadas a síntomas físicos y a oleadas repentinas de miedo. Las publicaciones sobre depresión incluían con frecuencia términos como «sin esperanza», «inútil», «vida» y «ya no», que reflejan una tristeza profunda y la sensación de que las cosas no mejorarán. En las discusiones sobre TLP, las palabras clave se desplazaban hacia las relaciones y las emociones, como «abandono», «relación», «apego» y «fp» (abreviatura de «favorite person», término común en esos grupos). Las publicaciones sobre bipolaridad resaltaban los cambios de ánimo y el lenguaje relacionado con el tratamiento, con palabras como «manía», «maníaco», «hipomanía», «estado de ánimo» y nombres de medicamentos como «litio» y «lamictal». Los modelos también mostraron dónde las condiciones se solapan: por ejemplo, las publicaciones de ansiedad y depresión pueden centrarse ambas en el malestar y los sentimientos negativos, lo que las hace más fáciles de confundir, tal como ocurre en el diagnóstico en la vida real.

De las publicaciones en línea al impacto en el mundo real

Para un público no especialista, el mensaje clave es que los ordenadores pueden clasificar de forma fiable las conversaciones sobre salud mental por temas y explicar qué palabras impulsan sus elecciones, pero aún no pueden ni deben diagnosticar a nadie. Los modelos de este estudio actúan más como bibliotecarios de los espacios de apoyo en línea: ayudan a comprobar si las discusiones en una comunidad concreta encajan con su foco declarado. Esto podría ayudar a los moderadores a mantener las conversaciones relevantes y a investigadores o clínicos a comprender mejor cómo la gente describe sus dificultades fuera de las citas formales. Con una supervisión humana cuidadosa y atención a la privacidad y el estigma, dichas herramientas podrían algún día favorecer espacios en línea más acogedores y mejor organizados para hablar sobre salud mental.

Cita: Sánchez Rodríguez, I., Bianchi, J., Pinelli, F. et al. Understanding mental health discourse on Reddit with transformers and explainability. Sci Rep 16, 6796 (2026). https://doi.org/10.1038/s41598-026-35918-3

Palabras clave: salud mental, redes sociales, Reddit, IA explicable, clasificación de texto