Clear Sky Science · es

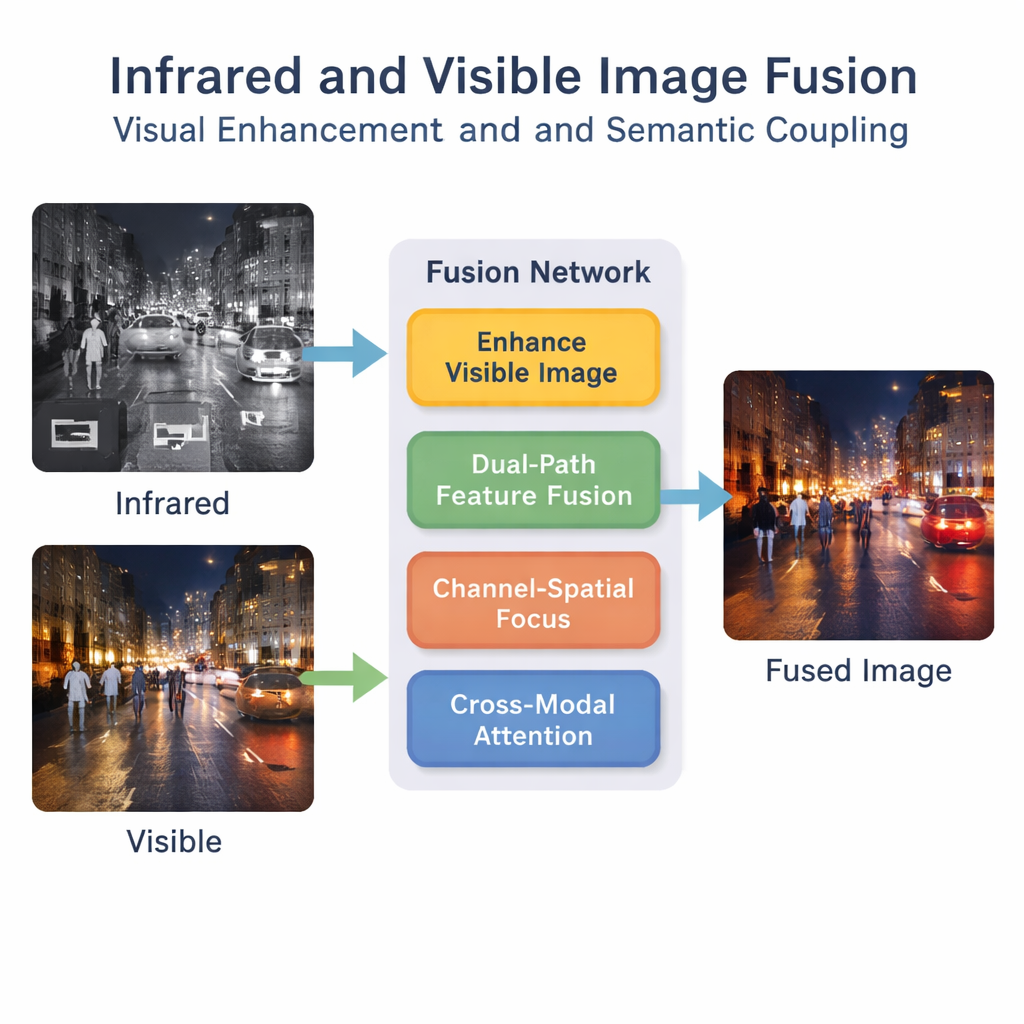

Fusión de imágenes infrarrojas y visibles mediante realce visual y acoplamiento semántico

Visión más nítida con cámaras diurnas y nocturnas

Los coches modernos, drones y sistemas de seguridad suelen llevar dos tipos de “ojos”: una cámara convencional que capta color y textura, y una cámara infrarroja que detecta calor. Cada una tiene fortalezas y debilidades, y combinarlas en una sola imagen clara resulta sorprendentemente difícil. Este artículo presenta un nuevo método para fusionar esas dos visiones en una imagen que no solo es más cómoda de mirar, sino también más comprensible para los programas informáticos.

Por qué dos ojos son mejor que uno

Las cámaras de luz visible capturan detalles nítidos como marcas viales, bordes de edificios y ropa, pero tienen dificultades de noche, en niebla o cuando los objetos se confunden con el fondo. Las cámaras infrarrojas hacen lo contrario: resaltan objetos cálidos como personas y vehículos incluso en la oscuridad, aunque sus imágenes suelen aparecer borrosas y con menos detalles finos. Fusionar estas dos visiones en una imagen “lo mejor de ambos mundos” puede ayudar en tareas que van desde la detección de peatones en sistemas de asistencia al conductor hasta la vigilancia y el rescate. Sin embargo, muchos métodos de fusión existentes se centran solo en características superficiales—puntos brillantes del infrarrojo y texturas de la imagen visible—mientras descuidan el significado más profundo a nivel de escena que importa para las máquinas inteligentes.

Una forma más inteligente de mezclar imágenes

Los autores proponen un marco de aprendizaje profundo que trata la fusión como algo más que una simple superposición. Primero, un paso especial de realce ilumina y equilibra la imagen visible, sobre todo en escenas con poca luz, para que los detalles valiosos no se pierdan antes de que empiece la fusión. Luego, una red de doble vía procesa en paralelo las entradas infrarrojas y visibles. Una vía se concentra en patrones locales como bordes y texturas, mientras la otra observa el contexto más amplio de la escena. Al combinar estas vías, el sistema produce una descripción interna más rica de lo que ocurre en las imágenes.

Enseñar a la red a qué prestar atención

Extraer muchas características no basta; la red debe aprender cuáles son importantes. Un módulo “canal–espacial” ayuda al modelo a resaltar regiones críticas y tipos de información, como peatones o faros brillantes, al tiempo que atenúa el ruido de fondo menos útil. Además, un mecanismo de atención interactiva bimodal fomenta que las corrientes infrarroja y visible se comuniquen entre sí. Aprende cómo se alinean las firmas térmicas y las texturas visuales a lo largo de la escena, capturando conceptos de nivel superior como “este parche brillante en infrarrojo corresponde a esa persona en la imagen visible”. Este acoplamiento semántico ayuda a que la imagen fusionada se mantenga coherente a nivel lógico y no solo mezclada visualmente.

Poner el método a prueba

Para comprobar si las imágenes fusionadas son no solo atractivas sino también realistas, los autores añaden una red discriminadora similar a las usadas en las redes generativas antagónicas. Esta red adicional aprende a distinguir imágenes visibles reales de las fusionadas, presionando al proceso de fusión para producir salidas que parezcan naturales tanto para humanos como para máquinas. El método se entrena y prueba en tres colecciones exigentes de pares de imágenes infrarrojo–visible, que abarcan carreteras diurnas y nocturnas y escenas de estilo militar. En una variedad de métricas estándar de calidad, el nuevo enfoque generalmente supera a diez técnicas de fusión existentes, produciendo imágenes con bordes más nítidos, mejor contraste y contenido más informativo.

Mejores imágenes para máquinas más seguras

Más allá de la calidad visual, los autores plantean una pregunta práctica: ¿estas imágenes fusionadas ayudan a las máquinas a tomar mejores decisiones? Usando un sistema de detección de objetos popular para localizar peatones, muestran que sus imágenes fusionadas mejoran la precisión de detección en comparación tanto con imágenes de un solo sensor como con métodos de fusión anteriores. En términos cotidianos, la técnica crea imágenes que son más fáciles de interpretar para humanos y algoritmos, especialmente en condiciones difíciles como la conducción nocturna. Aunque el sistema aún requiere ajustes para su uso en tiempo real en dispositivos con recursos limitados, ofrece un paso prometedor hacia una visión más segura y fiable en vehículos automatizados, vigilancia y otras tecnologías que deben ver con claridad cuando más importa.

Cita: Yang, Y., Li, Y., Li, J. et al. Infrared and visible image fusion via visual enhancement and semantic coupling. Sci Rep 16, 5666 (2026). https://doi.org/10.1038/s41598-026-35763-4

Palabras clave: fusión de imágenes, imágenes infrarrojas, visión en condiciones de poca luz, aprendizaje profundo, detección de objetos