Clear Sky Science · es

YOLO12 mejorado con agrupación piramidal espacial para la detección en tiempo real de insectos en algodón

Por qué es importante detectar insectos diminutos

El algodón puede parecer una planta sencilla, pero su papel a escala global es enorme: viste a miles de millones de personas, sostiene millones de empleos y alimenta industrias que van desde el aceite de cocina hasta los cosméticos. Sin embargo, campos enteros de algodón pueden verse socavados silenciosamente por insectos que apenas son más grandes que un grano de arroz. Los agricultores suelen confiar en recorridos frecuentes por el campo y en un uso intensivo de pesticidas para mantener a raya a estas plagas, métodos que consumen tiempo, son costosos y dañinos para el medio ambiente. Este estudio explora cómo una nueva forma de inteligencia artificial puede vigilar los campos de algodón en tiempo real, detectando automáticamente insectos perjudiciales en las hojas para que los tratamientos se apliquen de forma más precisa y con mucho menos desperdicio.

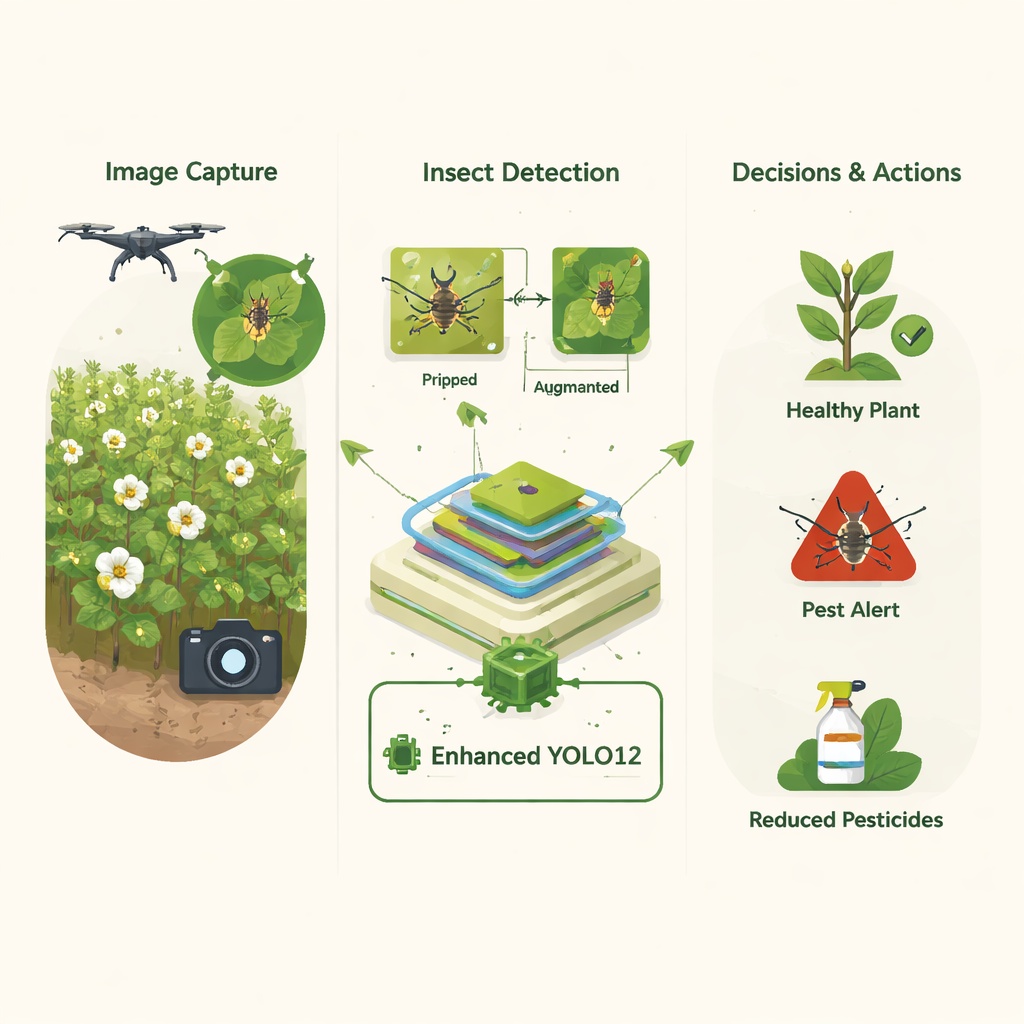

De la inspección manual a las cámaras inteligentes

Hoy en día, muchos agricultores o trabajadores de campo aún recorren las hileras de algodón, revisando visualmente hojas y flores en busca de plagas. Ese enfoque está limitado por la fatiga humana, la cobertura desigual y las condiciones cambiantes de luz y clima. Los pesticidas de amplio espectro, a menudo pulverizados según un calendario en lugar de en respuesta a una necesidad real, pueden matar insectos beneficiosos, contaminar el suelo y el agua y aumentar los costes de producción. Los autores sostienen que un camino más sostenible es permitir que los ordenadores «vean» los insectos directamente en las fotos de campo, proporcionando a los agricultores un sistema automatizado de alerta temprana que pueda enfocar los controles exactamente donde hay plagas.

Enseñar a los ordenadores a reconocer bichos diminutos

Para construir ese sistema, los investigadores recurrieron al aprendizaje profundo, una rama de la IA que destaca en reconocer patrones en imágenes. Usaron una familia de modelos llamada YOLO («You Only Look Once»), que puede escanear una imagen y dibujar cuadros alrededor de los objetos en una fracción de segundo. Partiendo del último modelo YOLO12, montaron una nueva versión mejorada adaptada a las plagas del algodón. Primero, seleccionaron y refinaron un conjunto de datos abierto y de alta calidad de 3.225 fotos de campos reales de algodón, que cubren 13 tipos comunes de insectos como mariquitas, chinches y taladros del algodón. Convirtieron las etiquetas originales a un formato estándar que el modelo pueda leer y equilibraron cuidadosamente el número de imágenes por clase de insecto para que la IA no se sesgara hacia las especies más comunes.

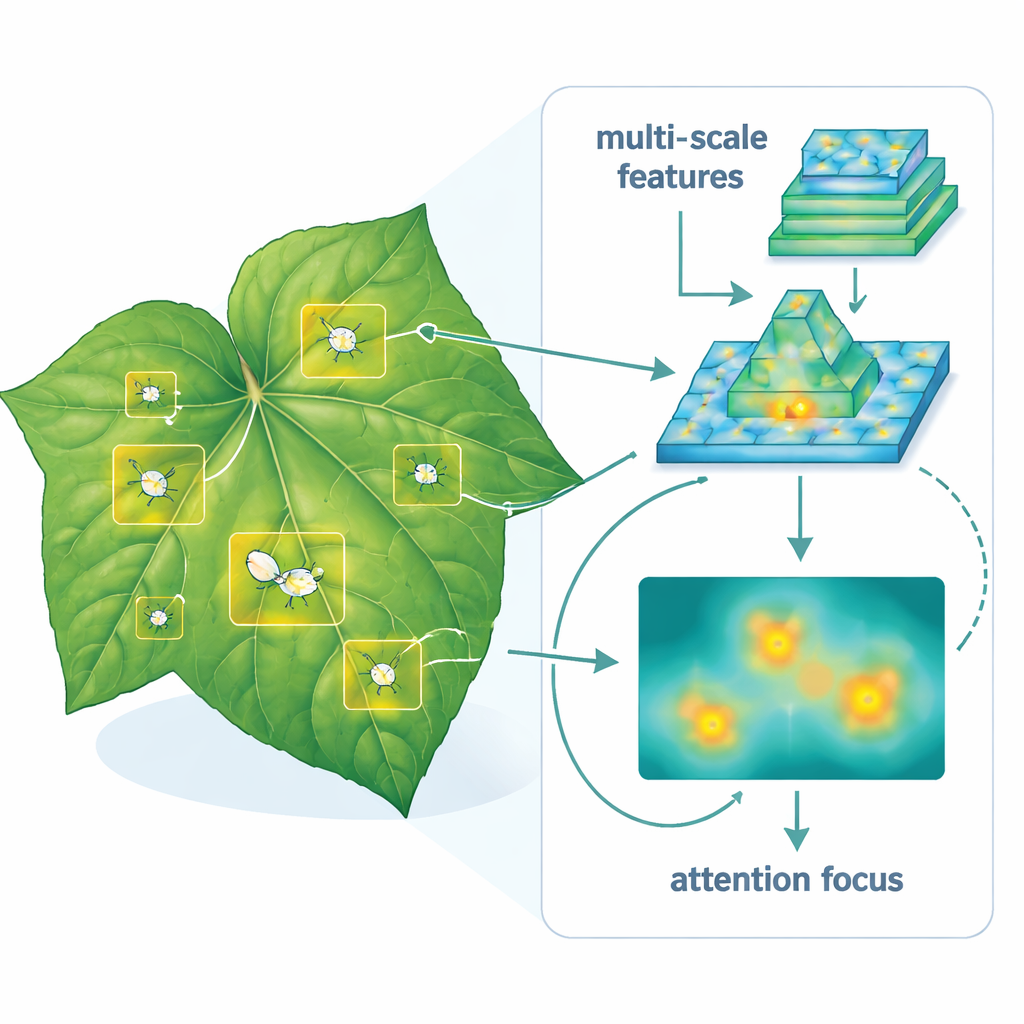

Hacer que los insectos pequeños destaquen

Detectar insectos en las hojas es mucho más difícil que detectar objetos grandes como coches o personas. Los insectos son diminutos, a menudo están camuflados y pueden aparecer a muchas escalas y ángulos. Para abordarlo, el equipo mejoró la arquitectura YOLO12 de varias maneras. Añadieron bloques especializados que ayudan al modelo a captar detalles finos a la vez que comprende la escena en su conjunto. Un módulo de «agrupación piramidal espacial» permite a la red observar la misma región en múltiples escalas simultáneamente, lo cual es crucial para ver tanto insectos muy pequeños como algo más grandes en la misma imagen. Un mecanismo de atención ayuda al modelo a enfatizar las partes más informativas de la imagen —formas, colores y texturas sutiles que distinguen un insecto de otro— mientras ignora el ruido de fondo.

Poner los modelos a prueba

Los autores no se limitaron a proponer un único modelo; construyeron y compararon seis diseños diferentes basados en YOLO, incluidos YOLO11 y YOLO12 estándar y varias variantes personalizadas. Todos fueron entrenados y evaluados con el mismo conjunto de datos de insectos de algodón para garantizar una comparación justa. El modelo destacado, llamado Enhanced Hybrid YOLO12, alcanzó puntuaciones muy altas en medidas estándar de calidad de detección, equilibrando la frecuencia con la que encuentra insectos correctamente y la precisión con la que traza sus cuadros delimitadores. En comparación con el YOLO12 original, mejoró tanto la calidad global de detección como la consistencia en muchas condiciones de prueba, sin dejar de funcionar lo suficientemente rápido para uso en tiempo real en hardware gráfico moderno. Aunque este modelo mejorado requiere algo más de computación, los autores muestran que la ganancia en fiabilidad es especialmente valiosa en la agricultura real.

Qué significa esto para los agricultores y el medio ambiente

En términos prácticos, el estudio demuestra que una cámara junto con un modelo de IA entrenado puede actuar como un explorador digital incansable, inspeccionando las hojas de algodón en busca de plagas día y noche. Dado que el sistema Enhanced Hybrid YOLO12 evita mejor las falsas alarmas en comparación con versiones anteriores, puede ayudar a los agricultores a aplicar herbicidas solo donde y cuando realmente hay insectos, reduciendo el uso de químicos, ahorrando dinero y disminuyendo el daño a especies beneficiosas y a los ecosistemas circundantes. Aunque se necesita trabajo adicional para ejecutar el modelo en dispositivos de menor coste y ampliarlo a más especies de insectos y regiones de cultivo, esta investigación apunta hacia un futuro en el que la agricultura de precisión convierte el control de plagas de una conjetura a una acción basada en datos.

Cita: Saif, D., Askr, H., Sarhan, A.M. et al. Enhanced YOLO12 with spatial pyramid pooling for real-time cotton insect detection. Sci Rep 16, 4806 (2026). https://doi.org/10.1038/s41598-026-35747-4

Palabras clave: plagas del algodón, agricultura de precisión, aprendizaje profundo, detección de objetos, agricultura sostenible