Clear Sky Science · es

Sinapsis Neohebbiánas para acelerar el entrenamiento en línea de hardware neuromórfico

Enseñar a los chips a aprender de la experiencia

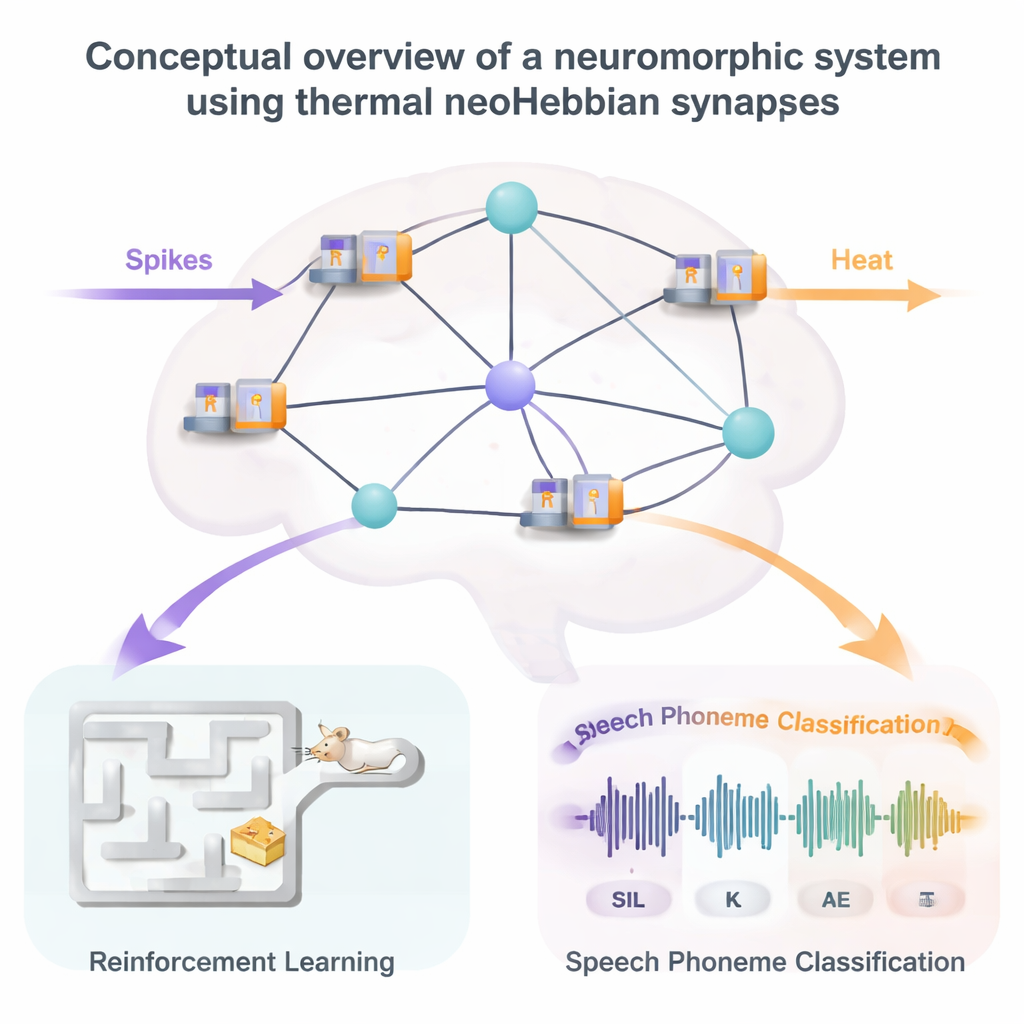

La inteligencia artificial moderna es extraordinariamente potente, pero todavía está lejos de igualar la habilidad del cerebro para aprender a partir de señales escasas y retrasadas —como recordar qué atajo por la ciudad realmente ahorró tiempo. Este artículo presenta un nuevo tipo de «sinapsis» artificial, las conexiones entre neuronas artificiales, que permite a los chips neuromórficos aprender de forma más parecida al cerebro y en tiempo real, manteniéndose compacta y eficiente energéticamente. Para quienes se interesan por el futuro del hardware de IA, muestra cómo el propio calor puede convertirse en una señal útil para el aprendizaje dentro de diminutos dispositivos de memoria.

Por qué los cerebros neuromórficos necesitan mejores sinapsis

La computación neuromórfica pretende imitar cómo el cerebro procesa la información: usando redes neuronales de pulsos, donde breves picos eléctricos atraviesan vastas redes de sinapsis. El hardware actual ya puede implementar sinapsis usando componentes memristivos como ReRAM, cuya conductancia eléctrica puede ajustarse para almacenar un peso. Sin embargo, las reglas de aprendizaje puramente “hebbianas” —donde las sinapsis se fortalecen o debilitan solo por la sincronía local de los pulsos— tienen dificultades en tareas realistas que requieren vincular eventos separados en el tiempo, como comprender el habla o resolver problemas de navegación. Las técnicas estándar de aprendizaje profundo afrontan esto con retropropagación a través del tiempo, pero ese método consume demasiada memoria y energía para hardware de tipo cerebral. Por ello, la comunidad se ha orientado hacia reglas de aprendizaje de “tres factores” y algoritmos como la elegibilidad‑propagación (e‑prop), que introducen una huella de memoria local adicional en cada sinapsis para que una señal global de recompensa retardada todavía pueda ajustar las conexiones correctas.

Almacenar una memoria efímera en el calor

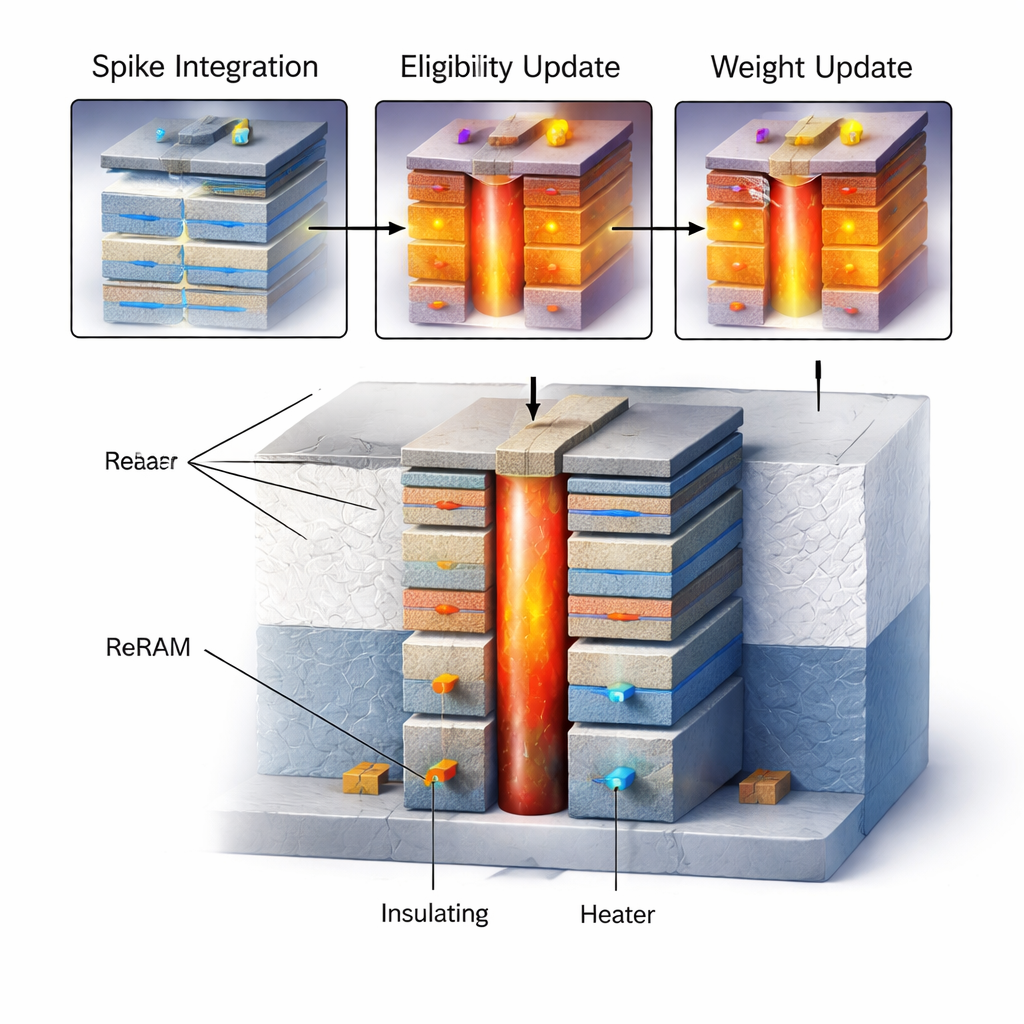

La idea central de este trabajo es una sinapsis “neohebbiana” que posee dos variables de estado internas: un peso de acoplamiento a largo plazo y una traza de elegibilidad a corto plazo que recuerda la actividad reciente. El peso se codifica, como es habitual, en la conductancia de un dispositivo ReRAM. La traza de elegibilidad, en contraste, se almacena en la temperatura local de ese dispositivo, controlada por un calentador resistivo a escala nanométrica integrado directamente encima o al lado. Durante el procesamiento normal de pulsos, la ReRAM simplemente multiplica los pulsos entrantes por su peso almacenado. Durante el aprendizaje, señales generadas por las neuronas que corresponden a «qué disparó antes» y «cuán sensible está actualmente la neurona postsináptica» hacen circular corriente por el diminuto calentador. Dado que el calentador y la ReRAM están acoplados térmicamente, esa potencia eleva la temperatura del dispositivo en proporción al producto de esas dos señales —la traza de elegibilidad matemática requerida por el algoritmo e‑prop.

Cómo el calor altera la memoria

Una vez que se ha procesado una secuencia de entrada corta —denominada dataframe—, el aumento de temperatura acumulado codifica cuán «elegible» es esa sinapsis para cambiar. A continuación se aplica un pulso de programación fijo a través de la ReRAM. Es crucial que experimentos detallados muestran que el cambio de conductancia resultante depende fuertemente de la temperatura: los dispositivos más calientes cambian más, y la dirección y magnitud de ese cambio dependen del estado de conductancia inicial y de si el dispositivo se está impulsando hacia una conductancia mayor o menor. Al elegir cuidadosamente las amplitudes de los pulsos y explotar esta sensibilidad a la temperatura, los autores logran que el cambio de peso sea aproximadamente proporcional a la elegibilidad almacenada. Modelos numéricos del flujo de calor en una pila 3D integrada de calentador más ReRAM confirman que la temperatura puede elevarse y dejarse decaer en escalas temporales ajustables, y que la estructura puede diseñarse para potenciar el auto‑calentamiento deseado mientras limita el «crosstalk» térmico hacia sinapsis vecinas.

Poner a prueba las sinapsis térmicas

Para evaluar si esta sinapsis exótica es realmente útil, los autores simulan sistemas neuromórficos completos que incluyen comportamientos realistas de los dispositivos, como la decaída de temperatura, la variabilidad entre dispositivos y la precisión incompleta. En una demostración, una red de pulsos controla un ratón virtual que debe aprender a navegar un laberinto en forma de cuadrícula para encontrar queso mientras evita trampas. Aquí, la refrigeración térmica natural —que erosiona lentamente la elegibilidad almacenada— actúa como el «factor de descuento» conocido del aprendizaje por refuerzo: los pares estado‑acción recientes importan más que los antiguos. Las simulaciones muestran que el aprendizaje es más rápido cuando esta decadencia no es ni demasiado rápida ni demasiado lenta, y que la variabilidad en el comportamiento de la ReRAM degrada el rendimiento solo de forma gradual. En una segunda prueba, más exigente, una red recurrente de pulsos con sinapsis neohebbianas térmicas se entrena en línea en el banco de pruebas de clasificación de fonemas TIMIT, una tarea estándar de reconocimiento del habla. Con suficiente resolución de conductancia (equivalente a alrededor de 8 bits), el modelo consciente del hardware alcanza una precisión dentro de unos pocos puntos porcentuales de una implementación ideal en coma flotante.

Qué significa esto para el hardware de IA futuro

En conjunto, el estudio demuestra que la temperatura local puede servir como una memoria interna práctica y controlable para reglas de aprendizaje avanzadas, permitiendo un entrenamiento rápido en chip sin una gran sobrecarga digital. La sinapsis propuesta ocupa aproximadamente la misma huella que una celda ReRAM convencional, pero aporta tanto un peso estable como una traza efímera, y su coste energético por paso de aprendizaje está en el rango de picojulios. Aunque recurrir al calor plantea desafíos reales —la temperatura es difícil de medir directamente y puede acelerar el desgaste del dispositivo—, el trabajo sugiere que abrazar, en lugar de combatir, los efectos electro‑térmicos podría desbloquear nuevas clases de hardware de aprendizaje compacto. Para quienes no son expertos, la conclusión es que los chips de IA del futuro quizá no se limiten a mover electrones: también podrían calcular con patrones de calor cuidadosamente diseñados, acercando al aprendizaje automático a la eficiencia y adaptabilidad del cerebro humano.

Cita: Pande, S., Bezugam, S.S., Bhattacharya, T. et al. NeoHebbian synapses to accelerate online training of neuromorphic hardware. Sci Rep 16, 6836 (2026). https://doi.org/10.1038/s41598-026-35641-z

Palabras clave: computación neuromórfica, redes neuronales de pulsos, sinapsis ReRAM, aprendizaje en línea, IA eficiente en hardware