Clear Sky Science · es

CRFusion: una nueva red de fusión LiDAR-cámara para la construcción de mapas BEV

Mapas digitales más inteligentes para coches autónomos

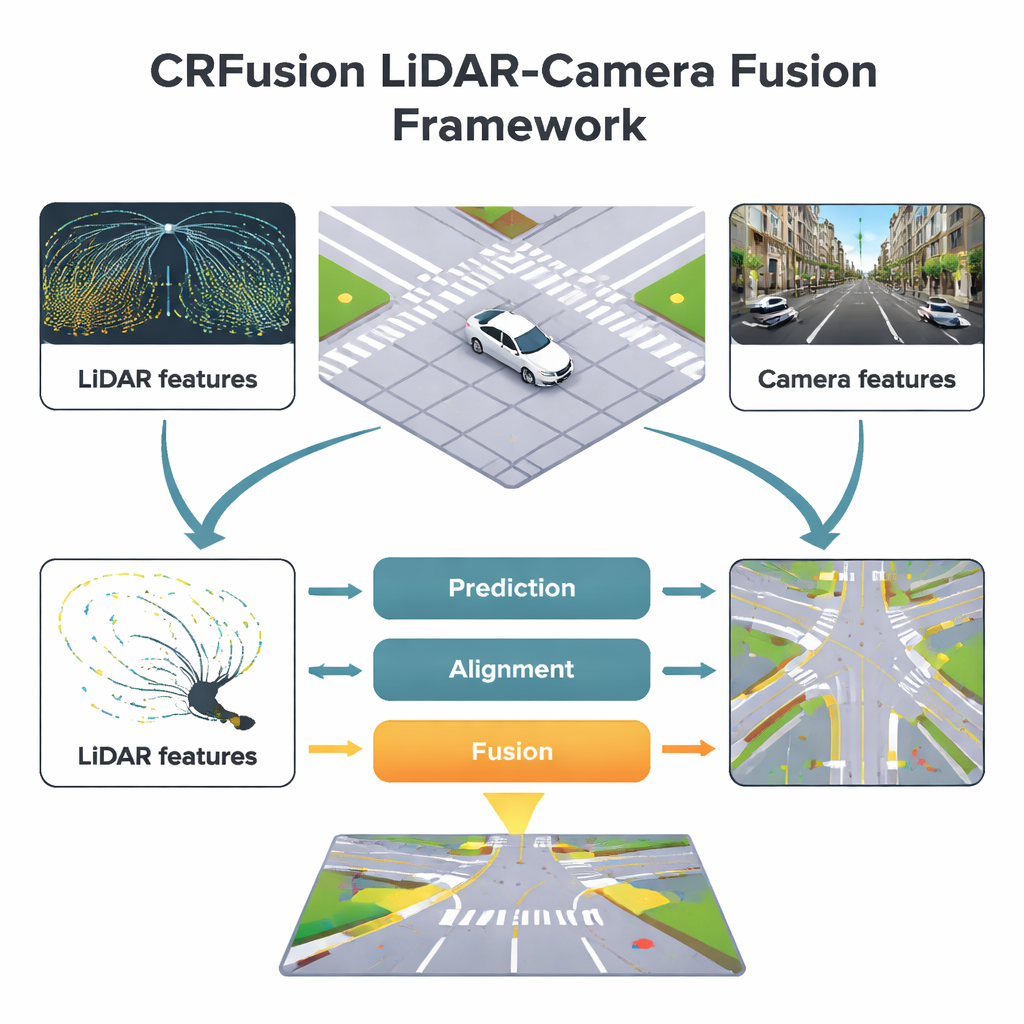

Para un coche autónomo, entender la carretera por delante es como leer un mapa que cambia constantemente. El vehículo debe saber con precisión dónde están los carriles, los pasos de peatones y los bordes de la calzada, incluso cuando hay poca luz, llueve o algo bloquea la vista. Este artículo presenta CRFusion, un nuevo sistema que combina escáneres láser y cámaras para construir mapas cenitales de calles urbanas más limpios y fiables, ayudando a los coches autónomos a mantenerse en su carril y a evitar peatones con mayor seguridad.

Por qué dos “ojos electrónicos” son mejor que uno

Los coches autónomos modernos dependen en gran medida de dos sensores principales. Las cámaras capturan imágenes ricas en color, lo que facilita detectar la pintura de los carriles, señales de tráfico y pasos de peatones a larga distancia. Los escáneres láser, o LiDAR, emiten pulsos de luz y miden su retorno, construyendo una imagen 3D precisa de las distancias y formas alrededor del coche. Cada uno tiene puntos débiles: las imágenes de cámara pueden engañarse con mala iluminación o mal tiempo, mientras que las medidas LiDAR se vuelven escasas e incompletas con la distancia. CRFusion está diseñado para combinar estas fortalezas y debilidades en una sola vista cenital, un mapa desde arriba donde cada píxel representa un pequeño parche de suelo etiquetado como carril, separador o paso de peatones.

Rellenando los huecos en la visión a larga distancia

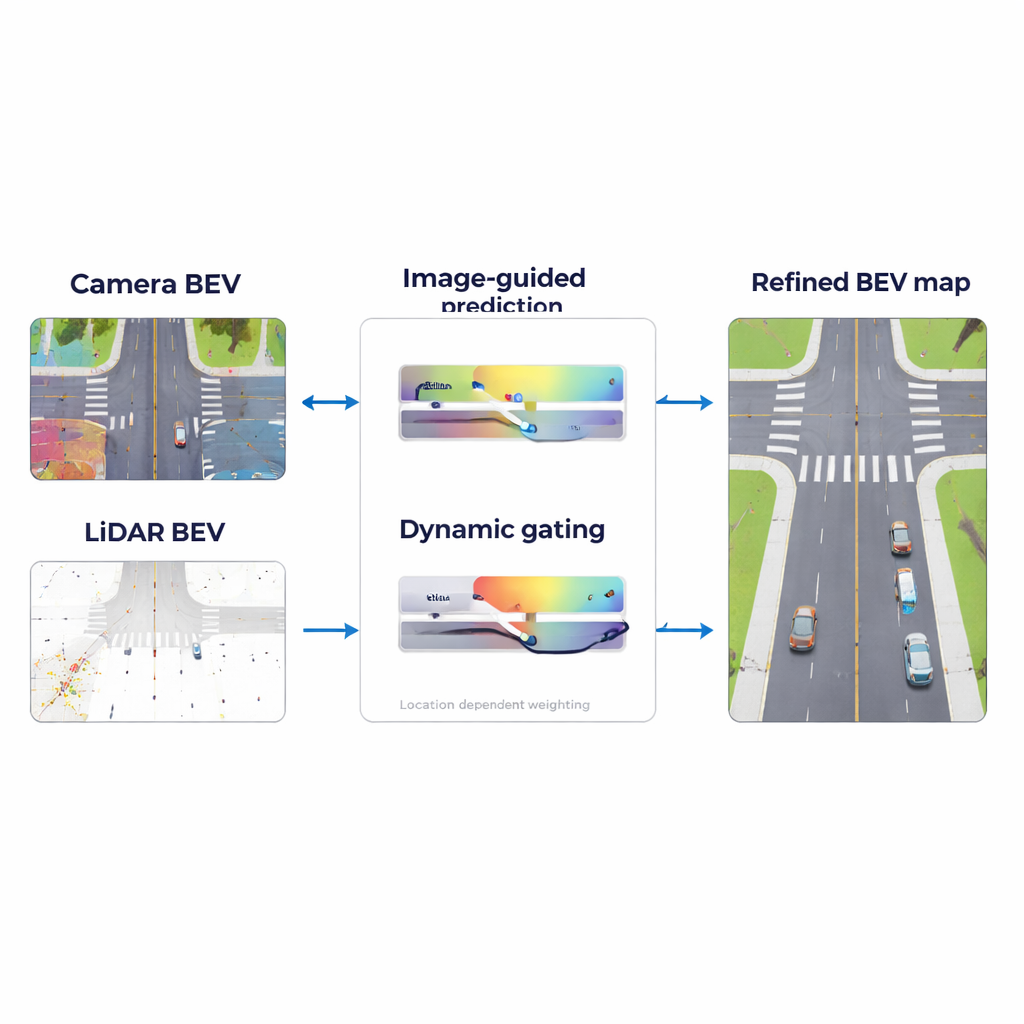

Un desafío clave en la cartografía de carreteras es que el LiDAR a menudo pierde detalles lejos del coche, justo donde la planificación anticipada es más importante. CRFusion aborda esto con un “Predictor de Alcance LiDAR”. En términos sencillos, el sistema observa lo que la cámara ve más adelante en la carretera y usa esa información para adivinar qué habría medido el LiDAR si hubiera sido denso y completo. Un mecanismo llamado atención ayuda al modelo a decidir qué partes de la vista de la cámara explican mejor las zonas vacías o inciertas en el mapa basado en LiDAR. Luego refina esa predicción comparando regiones cercanas en el mapa, reforzando patrones consistentes como líneas de carril continuas y reduciendo el ruido aleatorio.

Haciendo que los sensores coincidan en la misma imagen

Incluso cuando la cámara y el LiDAR funcionan, no se alinean perfectamente. Pequeños errores en las estimaciones de distancia o en la colocación de los sensores pueden provocar que las marcas de carril vistas por la cámara aparezcan ligeramente desplazadas respecto a las lecturas del LiDAR. CRFusion introduce un paso de alineación que “deforma” suavemente las características cenitales de la cámara para que coincidan mejor con la vista LiDAR. Esto se hace mediante una red de corrección ligera que predice cómo debe desplazarse cada punto en el mapa de la cámara. Como resultado, las dos vistas de sensores describen las mismas posiciones físicas de la carretera, haciendo que la fusión posterior sea mucho más fiable.

Adaptarse al día, la noche y el mal tiempo

Una vez que las dos vistas de los sensores están alineadas, el sistema aún debe decidir cuánto confiar en cada una en cada ubicación. Una autopista soleada con pintura de carril clara es muy diferente de una noche lluviosa en una ciudad concurrida. CRFusion aborda esto con un módulo de “Fusión con Puerta Dinámica” que asigna pesos flexibles a las características de la cámara y el LiDAR a lo largo del mapa. Donde las respuestas del LiDAR son fuertes, como en bordes de carretera cercanos u objetos sólidos, el sistema se apoya más en el LiDAR. Donde las pistas visuales son más claras, como franjas de pasos de peatones brillantes a distancia, confía más en la cámara. Estos pesos se aprenden automáticamente a partir de datos, permitiendo que la estrategia de fusión cambie de forma fluida según las condiciones.

Demostrando los beneficios con datos del mundo real

Los investigadores probaron CRFusion en un conjunto de datos ampliamente usado para conducción autónoma llamado NuScenes, que incluye muchas escenas de conducción en diferentes ciudades, climas y horas del día. En comparación con métodos anteriores de vanguardia, CRFusion produjo límites de carril, separadores y pasos de peatones más precisos, especialmente a distancias medias y largas de hasta 90 metros. Mejoró las medidas estándar de calidad tanto para la superposición con mapas de referencia como para la capacidad de detectar segmentos individuales de carril, y un estudio de “ablación” mostró que cada componente principal —la predicción a largo alcance, la red de alineación y la fusión dinámica— aportó ganancias significativas. Ejemplos visuales revelaron una continuidad de carril más suave y pasos de peatones más nítidos, confirmando que los mapas del sistema se parecen más a planos de carretera cuidadosamente trazados.

Qué significa esto para la conducción cotidiana

Para no especialistas, la conclusión principal es que CRFusion ayuda a los coches autónomos a construir mapas de calles más limpios y dependibles permitiendo que cámaras y LiDAR “se comuniquen” de forma más inteligente. Al predecir la información LiDAR faltante a partir de las vistas de la cámara, alinear las dos perspectivas de los sensores y ajustar cuánto confiar en cada una según la situación, el sistema reduce puntos ciegos y conjeturas. Esto acerca a los vehículos autónomos un paso más a manejar calles urbanas complejas y congestionadas con la misma confianza que un conductor humano cuidadoso que sigue carriles y pasos bien señalizados.

Cita: Guan, Y., Wang, T., Cheng, Q. et al. CRFusion: a novel LiDAR-camera fusion network for BEV map construction. Sci Rep 16, 5169 (2026). https://doi.org/10.1038/s41598-026-35551-0

Palabras clave: conducción autónoma, fusión LiDAR-cámara, mapas semánticos HD, percepción en vista cenital, cartografía de calles urbanas