Clear Sky Science · es

Un enfoque multimodal para reconocer noticias falsas y nodos influyentes en su difusión mediante aprendizaje profundo y análisis de redes

Por qué esto importa en la vida cotidiana

Cada día, millones de personas navegan por las redes sociales y ven publicaciones sobre salud, política, dinero y más. Entre la información útil se mezclan rumores y noticias falsas que pueden provocar miedo, confusión o incluso daños en el mundo real. Este estudio presenta una forma potente de hacer dos cosas a la vez: primero, detectar automáticamente publicaciones falsas o engañosas; y segundo, mapear quiénes son los más responsables de propagarlas dentro de una comunidad en línea. El trabajo se centra en mensajes de Twitter sobre la Covid‑19, pero las ideas podrían ayudar a plataformas, periodistas y al público a responder más rápido y con mayor precisión ante la desinformación dañina en muchos ámbitos de la vida.

Cómo se propagan los rumores entre multitudes en línea

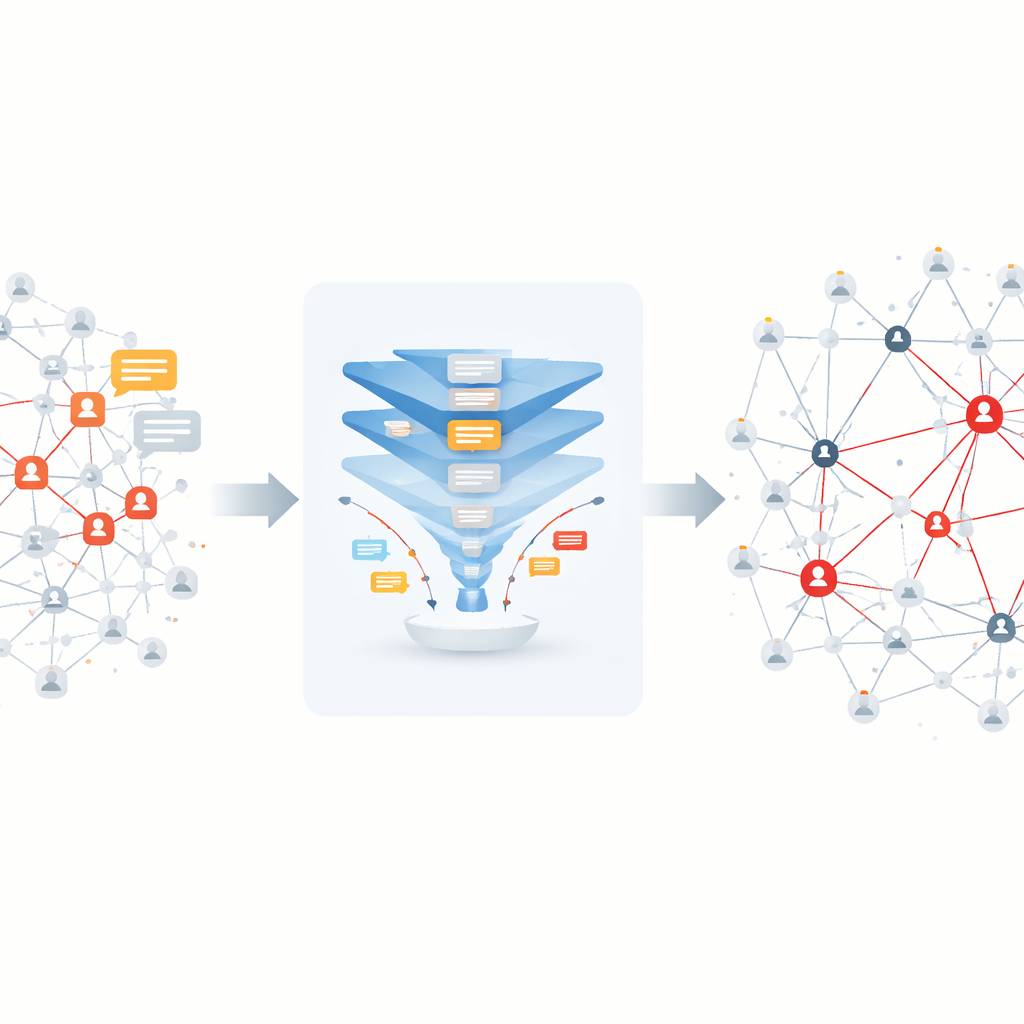

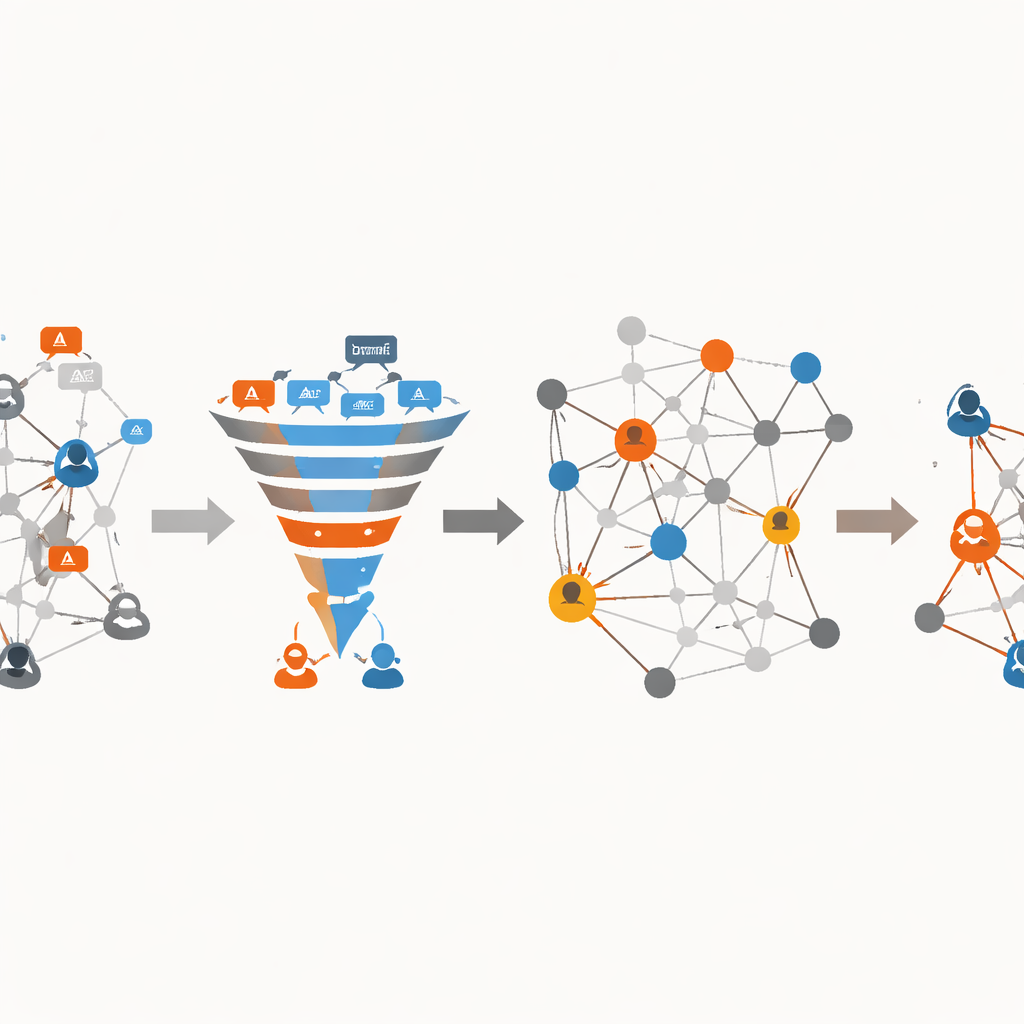

Las redes sociales como Twitter, Facebook o las aplicaciones de mensajería pueden concebirse como enormes telarañas de personas (nodos) conectadas por sus interacciones (enlaces). Cuando un usuario publica un mensaje y otros responden o lo comparten, esa información puede propagarse rápidamente por la red. Los rumores —afirmaciones no verificadas o falsas— se comportan de manera similar a las enfermedades contagiosas: pueden saltar de persona a persona, crecer rápidamente y resultar difíciles de detener. Investigaciones previas a menudo han tratado dos preguntas por separado: cómo determinar si una publicación es un rumor y cómo identificar a los “difusores” clave que ayudan a que ese rumor alcance a muchas personas. Los autores sostienen que abordar ambas preguntas conjuntamente, prestando además atención a la estructura de la red y a cómo cambia la actividad en el tiempo, ofrece una imagen mucho más clara de cómo se mueven las historias falsas.

Enseñar a un ordenador a leer y marcar publicaciones dudosas

La primera parte del método se centra en el contenido de cada tuit. Los investigadores tratan cada tuit como un documento corto y lo limpian eliminando ruido como símbolos extra, reemplazando enlaces web y direcciones de correo por etiquetas simples y suprimiendo palabras comunes de relleno que aportan poco significado. Luego traducen cada palabra a un vector numérico mediante una técnica ampliamente usada llamada GloVe, que captura cómo tienden a aparecer las palabras juntas en grandes colecciones de texto. Al promediar estos vectores de palabras, cada tuit se convierte en un resumen numérico compacto de su significado. Estos resúmenes se introducen después en una red neuronal convolucional unidimensional —un tipo de modelo de aprendizaje profundo capaz de detectar patrones sutiles— para decidir si un tuit es un mensaje genuino o un rumor.

Encontrar a los difusores clave dentro de la red

Tras separar los tuits de rumor de los reales, la segunda parte del enfoque se ocupa de la estructura de la red social en sí. Cada usuario es un punto en un grafo dirigido y ponderado, y cada respuesta o retuit se convierte en un enlace cuya intensidad refleja con qué frecuencia un usuario reacciona a los mensajes de otro. Con esta información, los autores primero agrupan a los usuarios en comunidades —grupos que interactúan más entre sí que con externos— construyendo una representación en forma de árbol especial de la red y luego fusionando subgrupos estrechamente conectados según lo bien que encajan. Dentro de estas comunidades calculan con qué frecuencia cada usuario aparece en los caminos más importantes entre otros, una medida conocida como intermediación (betweenness). Los usuarios que aparecen una y otra vez en caminos de alto valor se tratan como difusores influyentes. A continuación, se actualizan las ponderaciones de las conexiones para reflejar tanto la frecuencia de interacción como la centralidad de los usuarios conectados, revelando las rutas más probables por las que los rumores circulan a través de la red a lo largo del tiempo.

Qué reveló el estudio de caso sobre la Covid‑19

Para probar su marco, los investigadores lo aplicaron a un enorme conjunto de datos de Twitter sobre la Covid‑19: casi 100 millones de tuits que involucraban a más de 150.000 usuarios, de los que extrajeron más de 14.000 mensajes únicos etiquetados como información auténtica o rumores. En estos datos, su modelo de aprendizaje profundo clasificó correctamente alrededor del 99 por ciento de los tuits, superando a varios métodos existentes, incluidos otros detectores avanzados de noticias falsas. En la segunda fase compararon su lista de usuarios influyentes con un modelo matemático bien conocido de propagación de información, encontrando el mayor grado de acuerdo entre los métodos probados. También mostraron que cuando analizaron periodos de tiempo más largos —120, 240 y luego 360 días— la capacidad del modelo para identificar a los difusores clave y las principales rutas de rumor mejoró, y lo hizo con un tiempo de procesamiento menor que técnicas competidoras basadas en la red.

Qué significa esto para combatir la desinformación

En pocas palabras, el estudio demuestra que es posible construir un sistema que no solo detecte con muy alta precisión las noticias probablemente falsas, sino que también trace cómo viajan y quiénes son los más responsables de su difusión. En lugar de tratar a todos los usuarios y conexiones por igual, el método destaca un conjunto más reducido de comunidades e individuos cuyo comportamiento importa más para controlar historias dañinas. Aunque el trabajo se realizó con datos anonimizados de Twitter sobre la Covid‑19 y puede no generalizarse directamente a toda plataforma o tema, sugiere un camino hacia respuestas más dirigidas y basadas en datos frente a los rumores en línea —como orientar la verificación de hechos, advertencias o intervenciones de la plataforma donde puedan tener mayor impacto—, manteniendo al mismo tiempo la privacidad individual y un uso ético en perspectiva.

Cita: Zhang, W., Qian, M. & Zhang, Q. A multi-modal approach for recognizing fake news and influential nodes in spreading them using deep learning and network analysis. Sci Rep 16, 9775 (2026). https://doi.org/10.1038/s41598-026-35342-7

Palabras clave: noticias falsas, redes sociales, propagación de rumores, aprendizaje profundo, usuarios influyentes