Clear Sky Science · es

YOLOv11n mejorado para la detección de objetos pequeños en imágenes de UAV: mayor precisión con menos parámetros

Por qué importa detectar cosas diminutas desde el cielo

Los pequeños robots voladores se están integrando rápidamente en la vida cotidiana, desde la monitorización del tráfico y la respuesta a desastres hasta la entrega de paquetes. Pero hay un problema persistente: cuando un dron mira hacia abajo desde cientos de metros de altura, personas, coches y embarcaciones se reducen a apenas unos píxeles. Los sistemas habituales de visión por ordenador a menudo pasan por alto estas motas o las confunden con el ruido de fondo. Este artículo presenta una versión más inteligente y compacta de un sistema de detección popular, YOLOv11n, especialmente afinada para encontrar esos objetos diminutos en imágenes de drones y, al mismo tiempo, funcionar eficientemente en ordenadores embarcados de bajo consumo.

Ver más en detalles pequeños y borrosos

Las imágenes de dron son entornos difíciles para los algoritmos. La mayoría de los objetivos son más pequeños de 32×32 píxeles, y muchos miden menos de 16 píxeles. El movimiento, la vibración, la variación de la luz, la bruma y fondos urbanos complejos hacen que esos objetivos diminutos sean aún más difíciles de distinguir. Al mismo tiempo, los drones suelen depender de procesadores modestos y energía limitada, por lo que los modelos pesados son impracticables. Los autores parten de YOLOv11n, un detector compacto en tiempo real, y rediseñan sus componentes internos para extraer más información útil de regiones pequeñas y de bajo contraste sin inflar el modelo. Su objetivo es sencillo pero exigente: una precisión significativamente mayor en objetos pequeños, con igual o menor número de parámetros entrenables y una velocidad aceptable en hardware en el borde.

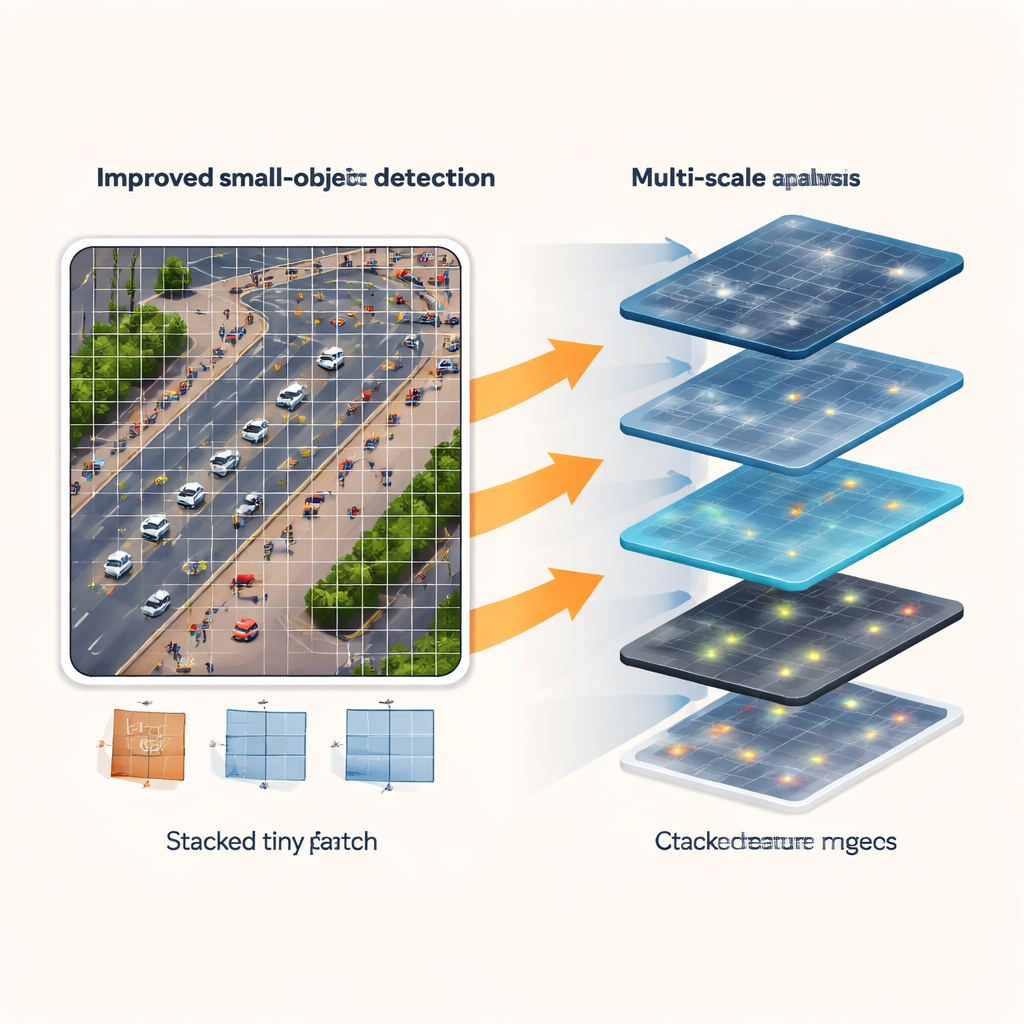

Aprender de la escena a muchas escalas

La primera mejora se centra en cómo la red “ve” la escena. En lugar de mirar a través de una única ventana de tamaño fijo, el nuevo módulo Multiscale Edge-Feature Adaptive Selection (MSEAF) observa la imagen a varias escalas a la vez. Las vistas más gruesas capturan la disposición general de carreteras, edificios y multitudes, mientras que las vistas más finas rastrean coches o personas individuales. Un paso de realce de bordes enfatiza contornos y formas que son fáciles de ver para los humanos pero que a menudo se desvanecen en parches de imagen diminutos. Un mecanismo de fusión inteligente potencia las regiones más informativas mientras suprime el ruido de fondo. Esta representación multiescala y consciente de los bordes proporciona al resto de la red un punto de partida más rico para encontrar objetos difíciles de ver.

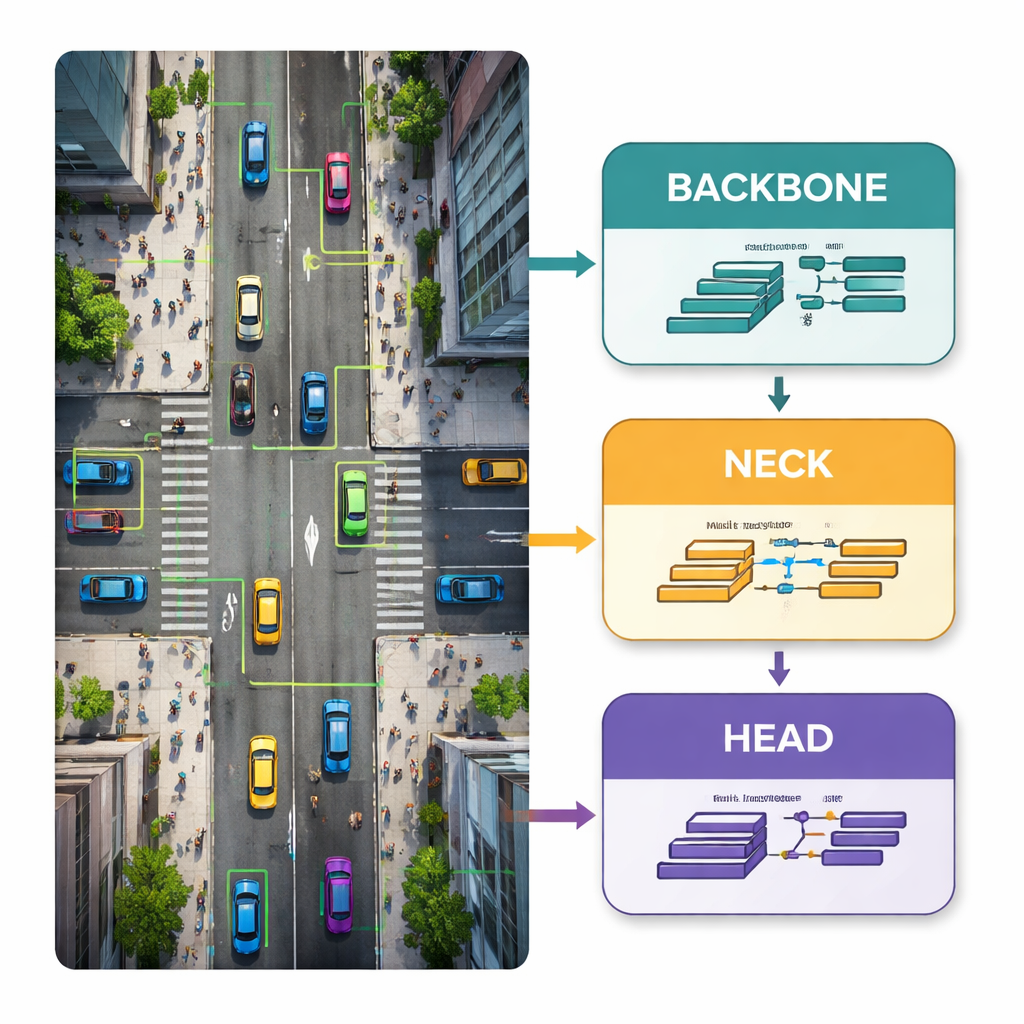

Conservar los objetos pequeños a lo largo del procesamiento

Las redes YOLO tradicionales encogen repetidamente los mapas de características a medida que la información fluye de la entrada a la salida. Para objetos grandes esto está bien, pero para los diminutos puede ser fatal: después de varias reducciones, un peatón puede ocupar solo uno o dos píxeles en un mapa interno, o desaparecer por completo. Para evitarlo, los autores reconfiguran la parte media —el “neck”— de la red y añaden una nueva cabeza de detección P2 que opera sobre características de mayor resolución. Módulos personalizados llamados ScalCat y Scal3DC combinan cuidadosamente información de distintas capas para que los detalles finos de las capas superficiales y el contexto más rico de las capas profundas se refuercen mutuamente. El resultado es un detector que sigue a coches y personas pequeños a través de múltiples escalas, en lugar de sacrificarlos por velocidad.

Decisiones más acertadas con menos parámetros

El paso final consiste en simplificar la etapa de predicción, conocida como la cabeza de detección. En el diseño original, las capas más profundas con muchos canales se dedicaban principalmente a objetos grandes, que son relativamente raros en escenas de dron. La nueva cabeza Shared Re-parameterized Detection (SRepD) iguala el número de canales entre escalas y emplea un truco de entrenamiento inteligente: durante el aprendizaje, varias ramas convolucionales especializadas exploran distintas formas de resaltar características; en tiempo de inferencia, estas ramas se combinan matemáticamente en una única convolución simple. Este diseño compartido y reparametrizado mejora la fusión de características mientras reduce el número de parámetros y mantiene los cálculos manejables para dispositivos de borde.

Qué dicen los números en pruebas del mundo real

El modelo mejorado se prueba en tres conjuntos de datos públicos desafiantes: VisDrone2019 (escenas urbanas mixtas), TinyPerson (personas extremadamente pequeñas sobre tierra y mar) y HazyDet (vehículos en fuerte bruma desde la perspectiva de un dron). En VisDrone2019, el nuevo diseño aumenta una medida clave de precisión (mAP50) y la precisión en 4,6 puntos porcentuales respecto al YOLOv11n original, mientras reduce los parámetros en alrededor de un 8,5 %. En TinyPerson, las mejoras son aún mayores: aproximadamente 5,9 puntos porcentuales en mAP50 y 5,6 en precisión, con una reducción de parámetros similar, y el modelo compacto incluso supera a un YOLOv11s mucho más grande que usa cuatro veces más parámetros. En condiciones brumosas, el detector mejorado también supera la línea base en medidas de precisión y robustez, todo manteniendo velocidades en tiempo real en una placa de borde de bajo consumo Huawei Atlas 200 DK.

Por qué esto importa para el uso cotidiano de drones

Para el público general, la conclusión principal es que esta investigación demuestra que los drones pueden volverse al mismo tiempo más agudos y más eficientes en recursos. Al replantear dónde y cómo la red busca detalles, conservar la información de alta resolución para objetivos diminutos y simplificar la maquinaria de predicción, los autores rompen la habitual compensación entre precisión y tamaño. El sistema resultante detecta mejor a personas y vehículos pequeños y distantes en escenas abarrotadas, brumosas o complejas sin exigir hardware voluminoso. Este tipo de avance acerca el monitoreo aéreo fiable y en tiempo real para seguridad vial, búsqueda y rescate y observación ambiental a un despliegue cotidiano más accesible.

Cita: Zhu, H., Xie, X. Enhanced YOLOv11n for small object detection in UAV imagery: higher accuracy with fewer parameters. Sci Rep 16, 5536 (2026). https://doi.org/10.1038/s41598-026-35301-2

Palabras clave: detección de objetos con drones, reconocimiento de objetos pequeños, red neuronal YOLO, análisis de imágenes aéreas, IA en el borde para UAV