Clear Sky Science · es

Segmentación automática y clasificación basadas en aprendizaje profundo para la detección del cáncer de cuello uterino usando un U-Net mejorado y métodos de conjunto

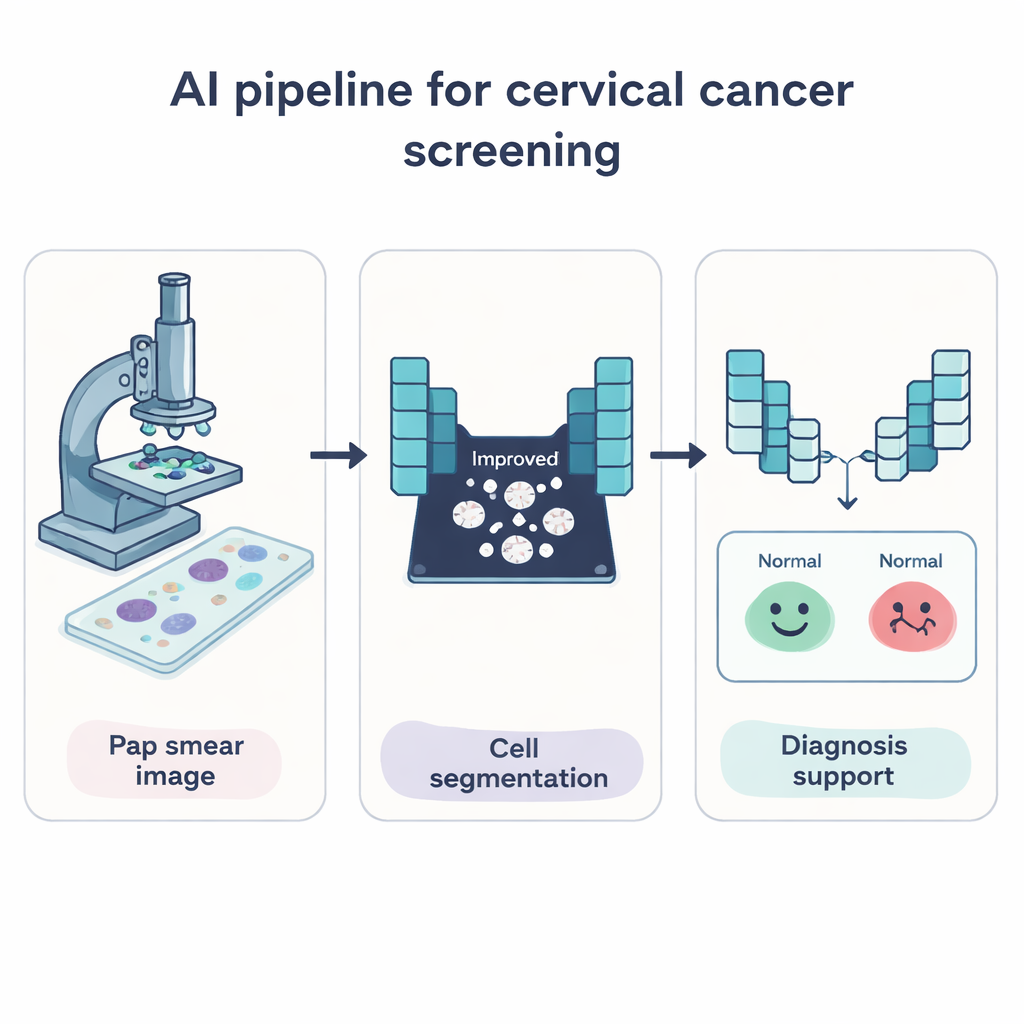

Por qué las pruebas de Papanicolaou siguen necesitando una ayuda digital

El cáncer de cuello uterino es uno de los pocos cánceres que es altamente prevenible si se detecta a tiempo, pero muchas mujeres siguen falleciendo porque los cambios celulares peligrosos se pasan por alto o se detectan demasiado tarde. La conocida prueba de Papanicolaou ya salva vidas, pero revisar miles de imágenes celulares a simple vista es un trabajo lento y fatigoso, y hasta los expertos pueden discrepar. Este artículo explora cómo la inteligencia artificial moderna puede actuar como un asistente incansable, encontrando y clasificando automáticamente las células cervicales en las imágenes de citologías para ayudar a los médicos a detectar señales tempranas con mayor rapidez y fiabilidad.

Enseñar a las máquinas a ver las células problemáticas

Los investigadores se propusieron construir un sistema informático que realice dos tareas clave: primero, separar cada célula cervical del fondo de una imagen de citología, y segundo, decidir si la célula parece normal o muestra signos asociados al cáncer. Para ello usaron aprendizaje profundo, una forma de IA que aprende patrones directamente a partir de un gran número de imágenes de ejemplo en lugar de usar reglas escritas a mano. Su sistema se centra en la célula completa—tanto en el núcleo oscuro como en el material circundante (citoplasma)—porque los cambios en tamaño, forma y textura en toda la célula pueden indicar enfermedad.

Una forma más inteligente de delinear las células

En el corazón del sistema hay una versión mejorada de un modelo popular en imagen médica llamado U-Net, especialmente eficaz para trazar contornos precisos de objetos en imágenes. Los autores modificaron U-Net para que pueda analizar detalles de la imagen a varias escalas a la vez y mantenerse estable incluso cuando se entrena con pequeños lotes de datos, una limitación habitual en trabajos médicos. Esta red mejorada aprende a pintar una máscara simple sobre cada imagen: blanco donde hay una célula, negro para el fondo. Al aislar solo las áreas celulares, las etapas posteriores del proceso pueden centrarse en lo que importa en lugar de distraerse con colorantes, restos o espacios vacíos.

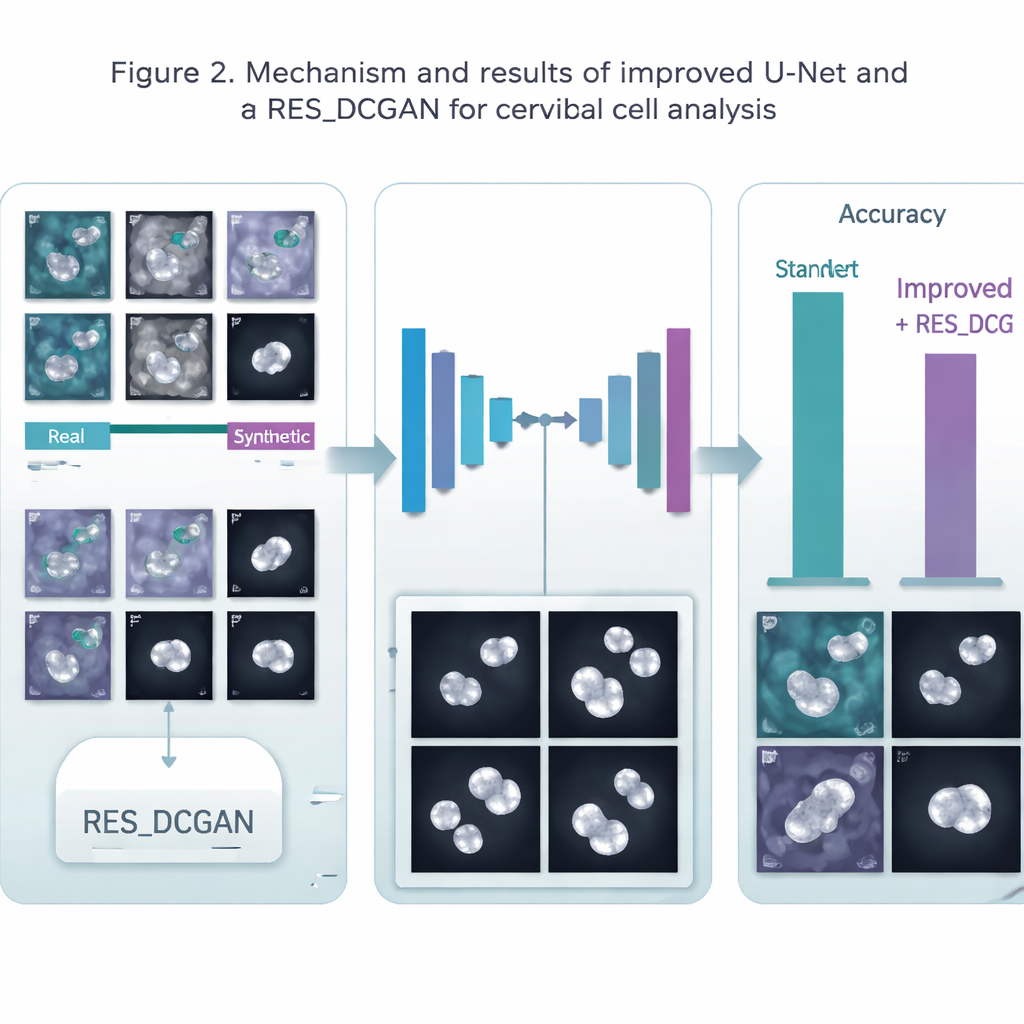

Crear más ejemplos de entrenamiento de la nada

Un reto importante en medicina es que las imágenes etiquetadas de alta calidad son escasas y costosas de obtener. Para abordarlo, el equipo utilizó un modelo generativo llamado RES_DCGAN, que aprende a crear imágenes sintéticas de citologías realistas basadas en las reales. Estas imágenes adicionales “inventadas pero convincentes” se mezclan en el proceso de entrenamiento, tanto antes de la etapa de segmentación como después, en la de clasificación. Al ver muchas más variaciones de células—incluidos patrones raros y sutiles—la IA se vuelve más robusta y menos propensa a sobreajustarse a un conjunto pequeño de pacientes o condiciones de imagen.

De los contornos a las alertas tempranas

Una vez segmentadas las células, un segundo grupo de modelos de aprendizaje profundo se encarga de clasificar cada célula como normal o en distintas categorías anormales. Los autores utilizaron un potente modelo de reconocimiento de imágenes llamado ResNet50V2 y lo combinaron con varias otras redes conocidas en un “conjunto”, donde múltiples modelos votan para la decisión final. Probaron seis canales de procesamiento diferentes en tres conjuntos de datos de Polonia (Pomeranian), Dinamarca (Herlev) y Grecia (SIPaKMeD), abarcando tanto casos simples de normal vs. anormal como problemas multicategoría más detallados. En todas estas pruebas, segmentar las células primero mejoró de forma consistente la exactitud de la clasificación, y añadir imágenes sintéticas tendió a aumentar el rendimiento, especialmente en el delineado de las células.

¿Qué tan bien rindió el asistente digital?

El sistema alcanzó puntuaciones muy altas. Para el delineado de células, la precisión llegó a aproximadamente 99,5% en un conjunto de datos y alrededor de 98% en otro, superando claramente a un U-Net estándar. Para la determinación del tipo celular, el conjunto de modelos etiquetó correctamente alrededor del 95–96% de las células en las tareas más complejas y hasta el 99% en decisiones más sencillas de riesgo sí/no. Estos resultados igualan o superan a muchos estudios anteriores, y además muestran que una única cadena de procesamiento unificada puede funcionar en distintos laboratorios y fuentes de datos. Las ganancias fueron más modestas en un conjunto de datos particularmente heterogéneo, lo que subraya que la diversidad del mundo real sigue siendo un desafío.

Qué significa esto para pacientes y médicos

En términos prácticos, este trabajo demuestra que un asistente de IA puede aprender a trazar con cuidado las células cervicales y clasificarlas en grupos de riesgo con una consistencia notable. No sustituye al patólogo, pero puede preseleccionar portaobjetos, resaltar células sospechosas y reducir la probabilidad de que se pasen por alto señales tempranas en clínicas concurridas o en regiones con pocos especialistas. Con pruebas adicionales en muestras más grandes y complejas y máscaras validadas por expertos, sistemas como este podrían ayudar a llevar un cribado fiable del cáncer de cuello uterino a más mujeres en todo el mundo, detectando cambios peligrosos antes y mejorando las probabilidades de un tratamiento exitoso.

Cita: Wubineh, B.Z., Rusiecki, A. & Halawa, K. Deep learning-based automatic segmentation and classification for cervical cancer detection using an improved U-Net and ensemble methods. Sci Rep 16, 5184 (2026). https://doi.org/10.1038/s41598-026-35299-7

Palabras clave: cribado de cáncer de cuello uterino, imágenes de citologías (Pap), aprendizaje profundo, segmentación de imágenes médicas, diagnóstico asistido por ordenador