Clear Sky Science · es

Modelos MobileNetV2 con atención para la detección y clasificación robusta de incendios forestales

Por qué importan las alertas de incendio más rápidas

En todo el mundo, los incendios forestales son cada vez más intensos, extensos y costosos de combatir. Unos minutos pueden marcar la diferencia entre un fuego pequeño y contenible y un desastre regional que daña ecosistemas, llena de humo las ciudades y cuesta miles de millones de dólares. Este estudio explora cómo modelos compactos de inteligencia artificial (IA) pueden detectar los primeros indicios de incendios forestales en imágenes y vídeo comunes, con la rapidez suficiente para ejecutarse en drones, cámaras de seguridad y sensores de bajo consumo distribuidos por paisajes vulnerables.

Vigilando el bosque con cámaras inteligentes

Las torres de vigilancia tradicionales y los operadores humanos que examinan transmisiones de vídeo en directo tienen dificultades para cubrir extensas áreas boscosas, especialmente de noche o en condiciones de humo y niebla. Los autores abordan este problema convirtiendo la detección de incendios forestales en una sencilla pregunta de sí o no: ¿contiene esta imagen fuego o no? Reúnen una colección equilibrada de 5.121 imágenes que muestran escenas con y sin fuego, procedentes de bosques, zonas urbanas y sitios industriales, capturadas de día, de noche y a través de humo o niebla. Al equilibrar cuidadosamente el conjunto de datos y verificar las etiquetas manualmente, pretenden enseñar a los sistemas de IA cómo son las llamas reales en el entorno, no solo en ejemplos ideales de laboratorio.

IA ligera diseñada para el terreno

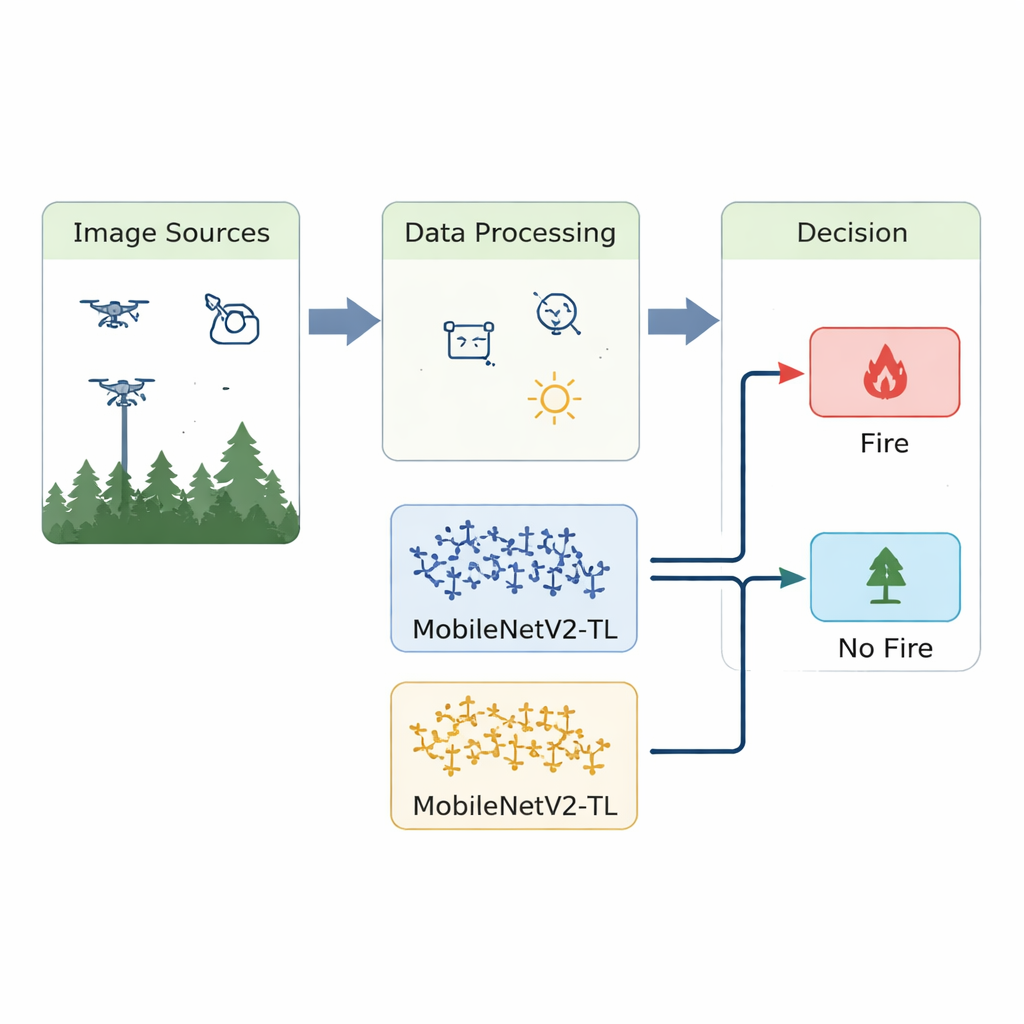

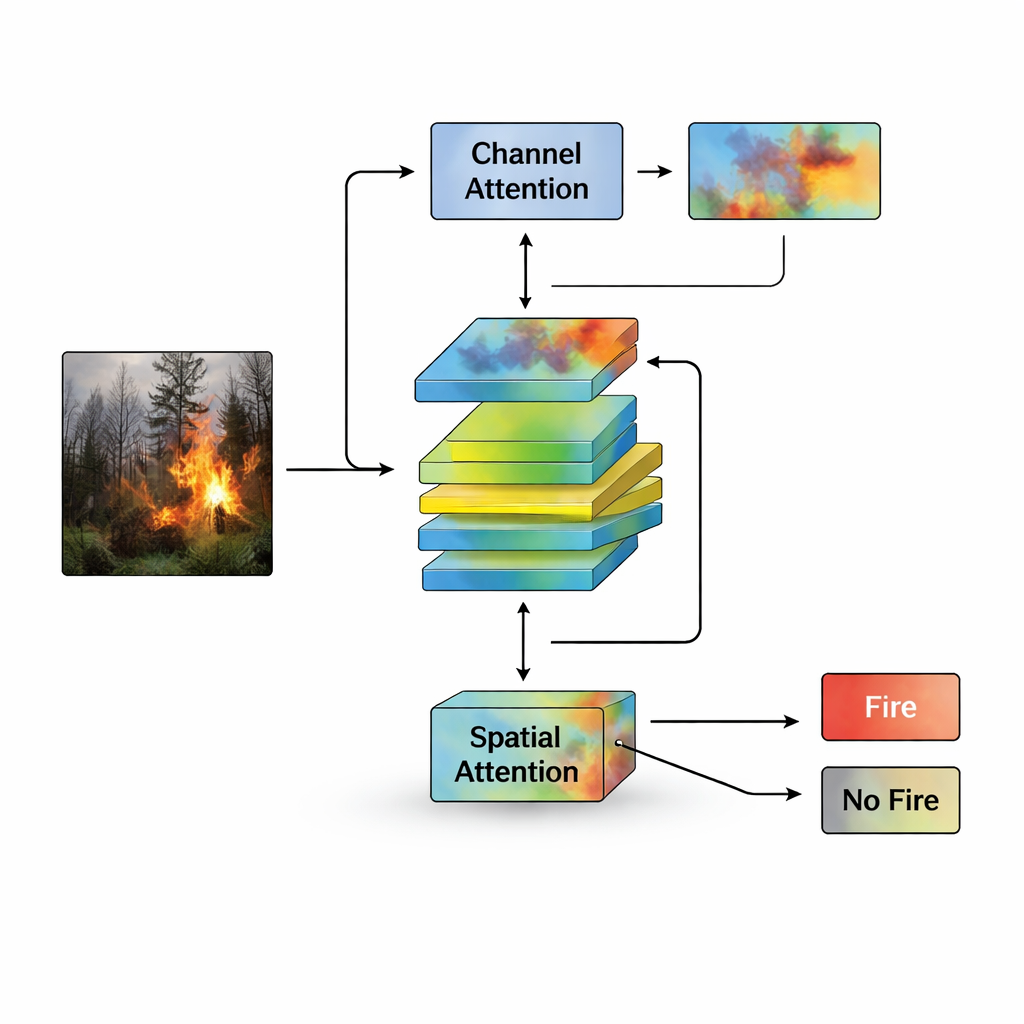

Muchos sistemas poderosos de reconocimiento de imágenes son demasiado pesados para ejecutarse en los pequeños ordenadores de los drones o en cámaras de vigilancia de bajo coste. Para evitar ese problema, el estudio se basa en MobileNetV2, una familia de redes neuronales diseñada para ser rápida y comedida con la memoria. El primer modelo, llamado Att-MobileNetV2, añade un mecanismo de “atención” que ayuda a la red a concentrarse en colores, texturas y bordes característicos de las llamas, ignorando el ruido como nubes iluminadas por el sol o luces brillantes de edificios. El segundo modelo, MobileNetV2-TL, se apoya en el aprendizaje por transferencia: reutiliza habilidades visuales aprendidas a partir de millones de fotos generales y entrena únicamente una pequeña cabeza específica para la tarea de fuego frente a no fuego, manteniendo bajo el tiempo de procesamiento y el consumo de energía.

Entrenamiento para condiciones reales difíciles

Para imitar las condiciones desordenadas del monitoreo real de incendios, los investigadores hacen algo más que recopilar imágenes variadas. También aplican ajustes controlados a cada imagen de entrenamiento—como pequeñas rotaciones, volteos y cambios en brillo o contraste—para simular distintos ángulos de cámara e iluminaciones. Ambos modelos se entrenan y evalúan bajo las mismas reglas, usando medidas estándar como precisión, exactitud y recall, y comprobando con qué frecuencia fallan en detectar incendios o generan falsas alarmas. Att-MobileNetV2 alcanza una exactitud de aproximadamente 99,6%, mientras que MobileNetV2-TL alcanza alrededor de 98,4%. De manera crucial, estos resultados se logran con solo unos pocos millones de parámetros y una fracción de mil millones de operaciones por imagen, permitiendo decisiones en solo 10–12 milisegundos en un único procesador gráfico.

Superando a sistemas más grandes con menos recursos

Los dos modelos compactos se comparan tanto con métodos clásicos de aprendizaje automático como con redes profundas más complejas. Bajo condiciones idénticas de entrenamiento y prueba, Att-MobileNetV2 ofrece el mejor equilibrio general entre detecciones correctas de incendios y decisiones correctas de “todo despejado”, mientras que MobileNetV2-TL consigue un recall particularmente alto, lo que significa que rara vez pasa por alto incendios reales—una propiedad importante para sistemas de alerta temprana. Un ensamblaje que combina ambos modelos obtiene un rendimiento ligeramente superior, lo que sugiere que las formas en que “ven” una escena son complementarias. Las pruebas en un conjunto de datos público independiente muestran que los modelos mantienen un rendimiento sólido en nuevas imágenes, indicando que se generalizan más allá de las fotografías específicas con las que se entrenaron.

Qué supone esto para la seguridad contra incendios en el futuro

En términos sencillos, este trabajo muestra que modelos de IA pequeños y eficientes pueden detectar incendios forestales de forma temprana y fiable, incluso cuando se ejecutan en hardware modesto montado en drones, torres o cámaras junto a la carretera. Al usar atención para centrarse en las partes adecuadas de una imagen y aprendizaje por transferencia para reutilizar conocimientos visuales previos, los sistemas propuestos alcanzan una precisión que iguala o supera a modelos mucho más pesados. Aunque quedan desafíos en la niebla más densa, el enfoque apunta hacia redes de sensores inteligentes y asequibles que podrían emitir alarmas antes, ayudando a los bomberos a responder más rápido y potencialmente evitar que pequeñas chispas se conviertan en incendios forestales catastróficos.

Cita: Ul Haq, I., Husnain, G., Iqbal, A. et al. Attention-enhanced MobileNetV2 models for robust forest fire detection and classification. Sci Rep 16, 4805 (2026). https://doi.org/10.1038/s41598-026-35207-z

Palabras clave: detección de incendios forestales, monitoreo de incendios, aprendizaje profundo, IA en el borde, visión por ordenador