Clear Sky Science · es

Evaluación de ChatGPT-4o y Gemini para el manejo de la gota: un análisis comparativo basado en las guías de la EULAR

Por qué importan los chatbots inteligentes y las articulaciones doloridas

La gota, una forma dolorosa de artritis que a menudo afecta al dedo gordo del pie, se está volviendo más frecuente en todo el mundo. Los médicos ya disponen de guías científicas claras sobre cómo diagnosticarla y tratarla, pero muchos pacientes siguen sin recibir una atención ideal. Al mismo tiempo, potentes chatbots de inteligencia artificial como ChatGPT-4o y Gemini empiezan a aparecer en entornos clínicos, lo que plantea una pregunta simple pero crucial: ¿pueden estas herramientas ofrecer consejos seguros y coherentes con las guías sobre la gota, o podrían inducir a error a médicos y pacientes?

Comprobando cuánto siguen los chatbots el manual

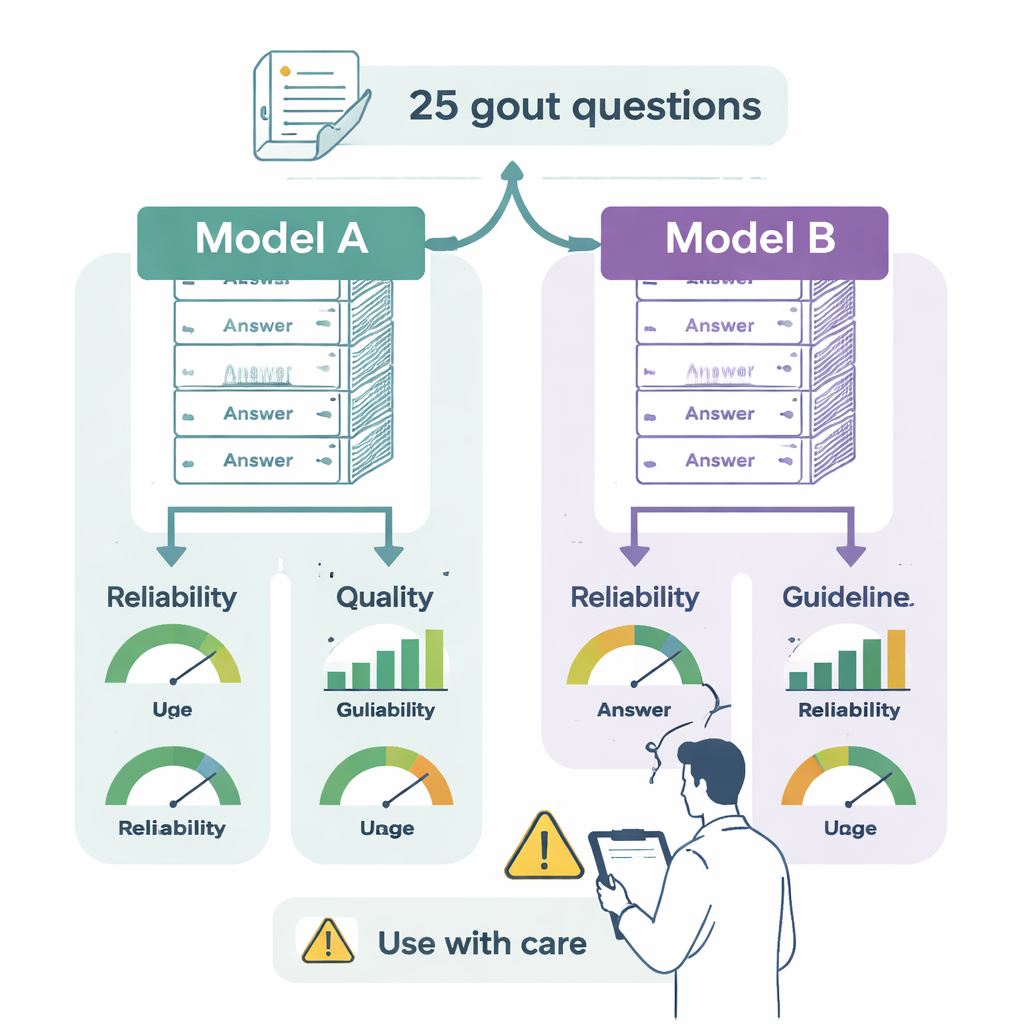

Los investigadores se propusieron evaluar dos modelos de lenguaje líderes —ChatGPT-4o y Gemini 2.0 Flash— frente a las guías oficiales europeas (EULAR) para la gota. Dos especialistas convirtieron 25 recomendaciones clave de las guías en preguntas de tipo clínico sobre situaciones del mundo real: cómo diagnosticar la gota, cuándo iniciar fármacos reductores de urato, cómo manejar las crisis, qué objetivos perseguir en las pruebas sanguíneas y cómo ajustar el estilo de vida u otros medicamentos. Ambos chatbots recibieron las mismas preguntas en sesiones separadas y limpias para que las respuestas previas no influyeran en las nuevas.

Criterios de valoración de las respuestas

Cada respuesta fue valorada por dos clínicos experimentados en gota, que desconocían qué modelo había generado cada texto. Evaluaron tres aspectos. Primero, fiabilidad: ¿la respuesta parece equilibrada, objetiva y fiable, o omite hechos clave o exagera beneficios? Segundo, calidad: ¿la respuesta es clara, bien organizada y útil para un especialista que toma decisiones? Tercero, alineación con las guías: ¿coincide con lo que EULAR recomienda, está parcialmente de acuerdo con lagunas, o contradice directamente las normas? El equipo también comprobó la dificultad de lectura de las respuestas mediante pruebas de legibilidad estándar que estiman el nivel educativo necesario para comprender un texto.

ChatGPT vs. Gemini: ¿quién lo hizo mejor?

Ambos chatbots produjeron respuestas generalmente sensatas y bien redactadas, y con frecuencia recordaron a los lectores que consultaran a un profesional de la salud. Pero surgieron diferencias importantes. ChatGPT-4o coincidió plenamente con las guías de la gota en el 76% de los casos y ofreció respuestas mayormente correctas pero incompletas en otro 20%, con solo una respuesta que contenía un error médico claro. Gemini estuvo completamente alineado en el 48% de las respuestas y fue parcialmente correcto pero incompleto en el 32%. Más preocupante, el 12% de sus respuestas mezclaron ideas correctas con información errónea y el 8% contradijo abiertamente las guías —por ejemplo, sugiriendo el uso amplio de una potente clase antiinflamatoria (inhibidores de IL‑1) donde EULAR las reserva para pacientes selectos y de difícil tratamiento, o recomendando iniciar de forma rutinaria fármacos reductores de urato durante una crisis aguda, un ámbito en el que los expertos aconsejan mayor prudencia.

Legible, pero no fácil de leer

En cuanto al estilo, los dos sistemas fueron sorprendentemente similares. En múltiples escalas de lectura, ambos produjeron textos que requerían al menos un nivel universitario para seguirlos con comodidad. Eso puede ser aceptable para médicos especialistas, pero es demasiado complejo para la mayoría de los pacientes. Ninguno de los modelos ofreció referencias o enlaces a las fuentes salvo que se lo solicitaran explícitamente, lo que dificulta verificar el origen de la información. La concordancia entre los revisores fue calificada de buena a excelente, lo que sugiere que la puntuación fue consistente y que las diferencias entre los chatbots eran reales y no una cuestión de opinión.

Qué significa esto para las personas que viven con gota

En conjunto, el estudio sugiere que los chatbots avanzados pueden ser asistentes útiles para los médicos que manejan la gota, pero no están preparados para funcionar de forma autónoma. ChatGPT-4o fue más fiable, más completo y más fiel a las guías de expertos que Gemini, aunque incluso sus errores poco frecuentes podrían tener importancia cuando están en juego fármacos y seguridad. Ambos sistemas se expresaron a un nivel demasiado complejo para la mayoría de los pacientes y carecían de transparencia incorporada sobre sus fuentes. Por ahora, sostienen los autores, la IA debería verse como una herramienta de apoyo prometedora que puede ayudar a clínicos y educadores, pero solo cuando sus recomendaciones se contrasten con guías actualizadas y el juicio de expertos, especialmente en condiciones como la gota donde pequeños detalles de dosis y decisiones sobre el momento pueden marcar una gran diferencia en el dolor, el daño a largo plazo y la calidad de vida.

Cita: Meral, H.B., Kolak, E. Evaluation of ChatGPT-4o and Gemini for gout management: a comparative analysis based on EULAR guidelines. Sci Rep 16, 4831 (2026). https://doi.org/10.1038/s41598-026-35166-5

Palabras clave: gota, guías clínicas, inteligencia artificial, modelos de lenguaje amplio, reumatología