Clear Sky Science · es

Un enfoque multimodal de aprendizaje y simulación para la percepción en sistemas de conducción autónoma

Coches autónomos más inteligentes

Los coches autónomos prometen carreteras más seguras y menos congestión, pero sólo si realmente pueden comprender el mundo que les rodea. Este artículo explora una nueva manera de ayudar a los vehículos autónomos a “ver”, “sentir” y “anticipar” su entorno de forma más parecida a un conductor humano cuidadoso: combinando distintos sensores, probando de forma segura en una copia virtual del mundo real y haciendo las decisiones del coche más transparentes para las personas.

Ver la carretera con muchos “sentidos”

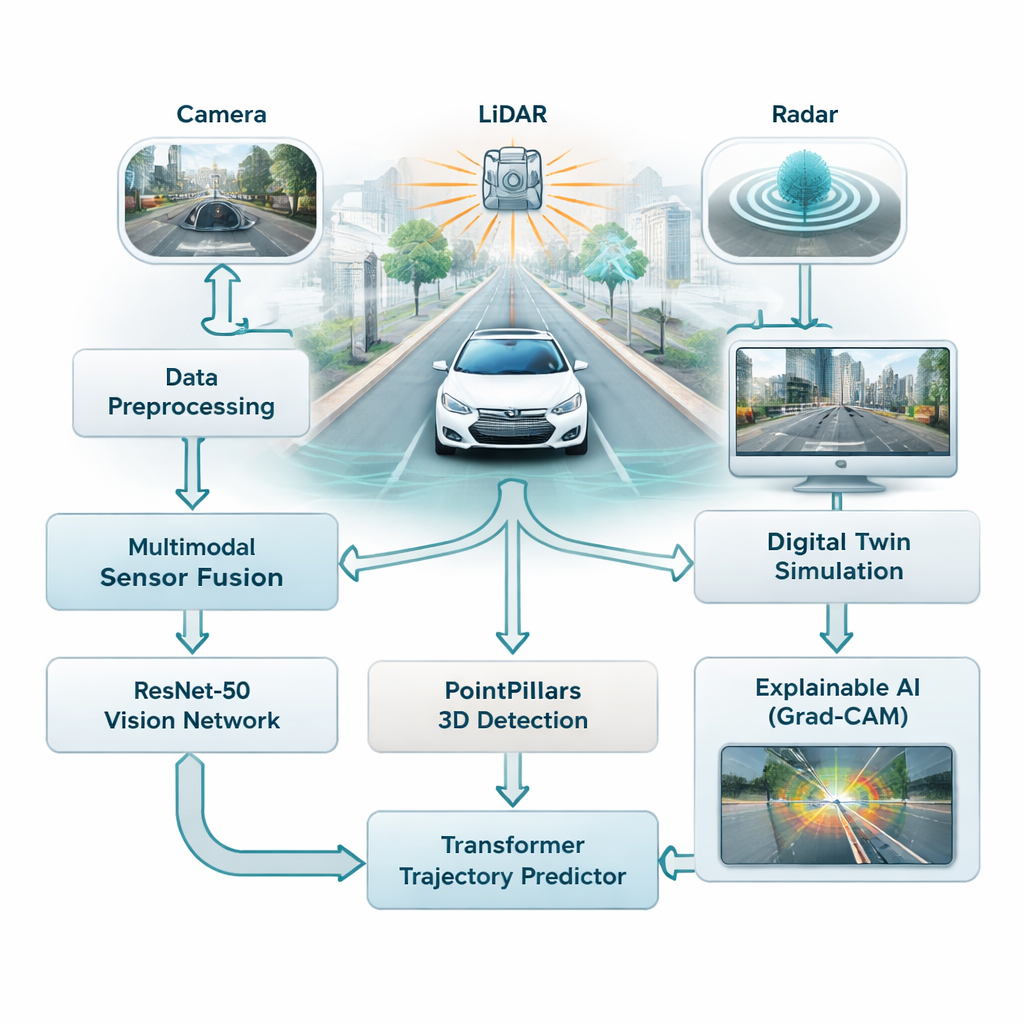

La mayoría de los sistemas de ayuda al conductor actuales se apoyan en gran medida en cámaras, que funcionan bien con buena iluminación pero tienen problemas con niebla, lluvia o de noche. Este estudio combina tres tipos de sensores—cámaras, escáneres láser (LiDAR) y radar—para que el coche no dependa de una única y frágil fuente de información. Las cámaras capturan color y detalle ricos, el LiDAR construye una imagen 3D precisa de la escena y el radar sigue siendo fiable en malas condiciones meteorológicas. Los autores fusionan las tres corrientes en una única visión del tráfico, dotando al vehículo de una comprensión más completa y fiable de las carreteras, los peatones y otros coches.

Enseñar al coche a reconocer y anticipar

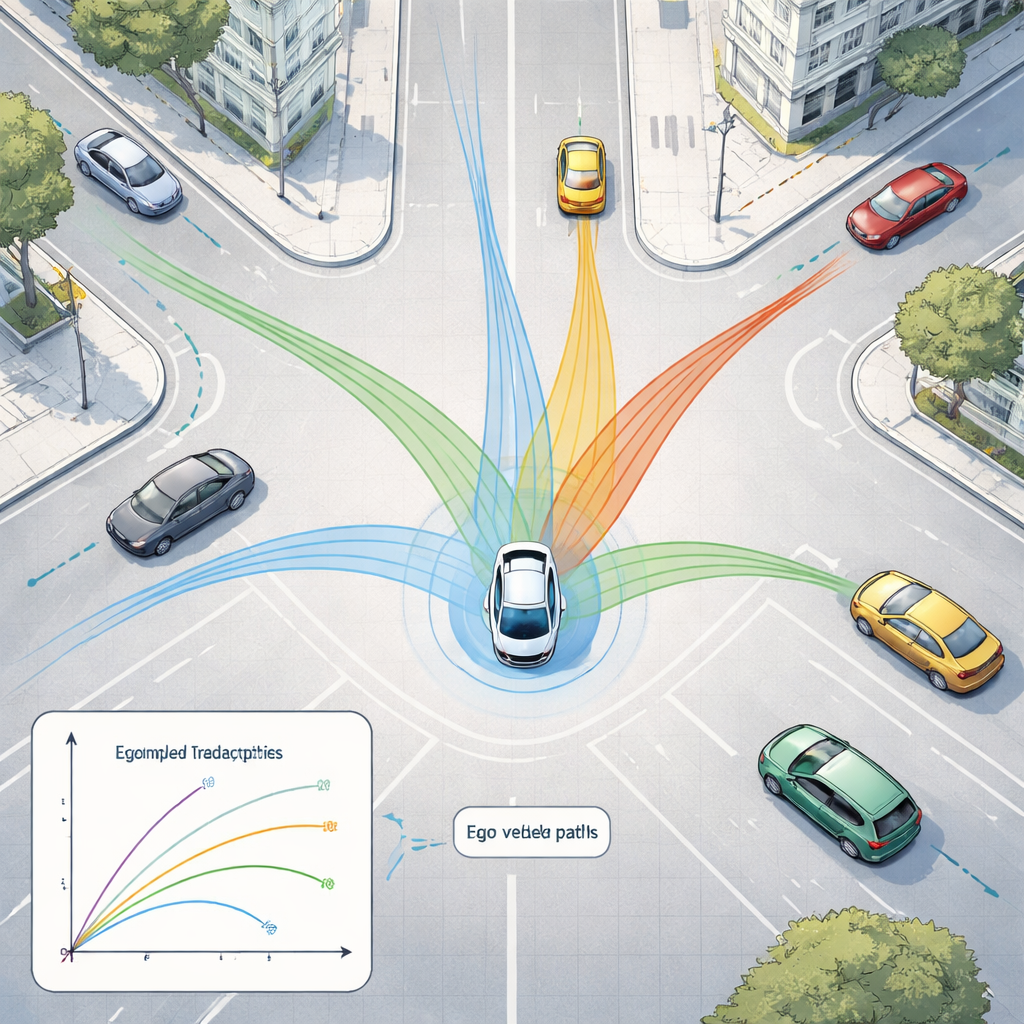

Para dar sentido a este aluvión de datos, el marco utiliza dos familias de modelos de IA modernos. Primero, una red profunda de imágenes llamada ResNet-50 analiza las imágenes de las cámaras para capturar la situación general—qué tan concurrida está la vía, dónde son visibles los carriles y cómo está distribuida la escena. Al mismo tiempo, un modelo 3D llamado PointPillars interpreta las nubes de puntos del LiDAR para localizar vehículos y otros objetos en tres dimensiones. Estas señales se alimentan luego a un Transformer, un tipo de IA originalmente diseñado para el lenguaje, que sobresale en comprender cómo cambian las cosas a lo largo del tiempo. Aquí aprende a predecir cómo es probable que se muevan en los próximos segundos los vehículos cercanos y otros objetos en movimiento, teniendo en cuenta tanto su trayectoria pasada como la estructura de la vía.

Construir una pista de pruebas virtual segura

En lugar de probar situaciones de riesgo directamente en vías públicas, los investigadores conectan su sistema a un gemelo digital—una réplica virtual de calles reales de ciudad basada en un gran conjunto de datos públicos de Boston y Singapur. En este mundo simulado, los sensores, el movimiento y el entorno del coche se reproducen y modifican a voluntad, mientras la IA intenta rastrear objetos y prever sus trayectorias futuras. El sistema puede ejecutar estos escenarios de “qué pasaría si” en tiempo real, con tiempos de respuesta por debajo de 50 milisegundos, lo que permite a los ingenieros explorar casos límite como frenadas repentinas, giros bruscos o intersecciones concurridas sin poner en peligro a nadie.

Echar un vistazo dentro de la “caja negra” de la IA

Una crítica frecuente al aprendizaje profundo es que puede ser difícil entender por qué el modelo tomó una decisión concreta. Para abordar esto, los autores utilizan un método llamado Grad-CAM, que resalta las partes de una imagen que más influyeron en la salida del modelo. Estos mapas de calor muestran, por ejemplo, si la red se está concentrando en otro coche, un peatón o una señalización vial al estimar trayectorias. Aunque este paso explicativo se ejecuta fuera de la línea temporal en tiempo real del coche, ayuda a ingenieros y revisores de seguridad a verificar que el sistema está prestando atención a las pistas correctas, lo cual es crucial para generar confianza pública.

¿Cuánto mejor conduce?

Al probarse en cientos de escenas urbanas, el marco propuesto detecta objetos 3D con precisión y predice el movimiento con mayor exactitud que reglas físicas simples que asumen velocidad constante o aceleración uniforme. Sus errores de predicción—cuánto se desvían las posiciones previstas de la realidad—son significativamente menores que los de tales aproximaciones básicas y se acercan a los de un potente modelo recurrente de IA, a la vez que siguen siendo lo bastante rápidos para uso en tiempo real. Experimentos cuidadosos que comparan distintos diseños de redes muestran que un modelo de imagen más profundo y un detector 3D de profundidad media consiguen el mejor equilibrio entre precisión y velocidad, y que el sistema puede desplegarse en ordenadores a bordo más pequeños después de comprimir los modelos.

Qué significa esto para los conductores de a pie

Para los no especialistas, el mensaje es que los coches autónomos más seguros y fiables probablemente provengan de un enfoque que combine múltiples sensores, prediga cómo evolucionará la escena y sea probado a fondo en mundos virtuales realistas. Al unir percepción, predicción, simulación y explicaciones comprensibles por humanos en un único diseño, este trabajo acerca los vehículos autónomos a comportarse como compañeros cautelosos y transparentes en la carretera en vez de máquinas misteriosas.

Cita: Almadhor, A., Al Hejaili, A., Alsubai, S. et al. A multimodal learning and simulation approach for perception in autonomous driving systems. Sci Rep 16, 5505 (2026). https://doi.org/10.1038/s41598-026-35095-3

Palabras clave: conducción autónoma, fusión de sensores, predicción de trayectorias, detección de objetos 3D, simulación de gemelo digital