Clear Sky Science · es

Rellenado automático de imágenes para la restauración de artefactos históricos mediante la hibridación de transfer learning con modelos generativos profundos

Por qué importa arreglar el arte antiguo con IA

Museos y arqueólogos de todo el mundo compiten contra el tiempo. Murales antiguos, frescos y paredes pintadas se desmoronan, se decoloran y agrietan tras siglos de exposición a la humedad, la contaminación y el manejo inadecuado. Restaurarlos a mano es lento, costoso y en ocasiones irreversible. Este estudio presenta un nuevo sistema de inteligencia artificial que puede reparar digitalmente imágenes dañadas de obras históricas, ofreciendo a conservadores e investigadores una forma segura de visualizar cómo podrían haber sido las escenas perdidas y de preservarlas para las generaciones futuras.

Paredes agrietadas, pintura faltante y una red de seguridad digital

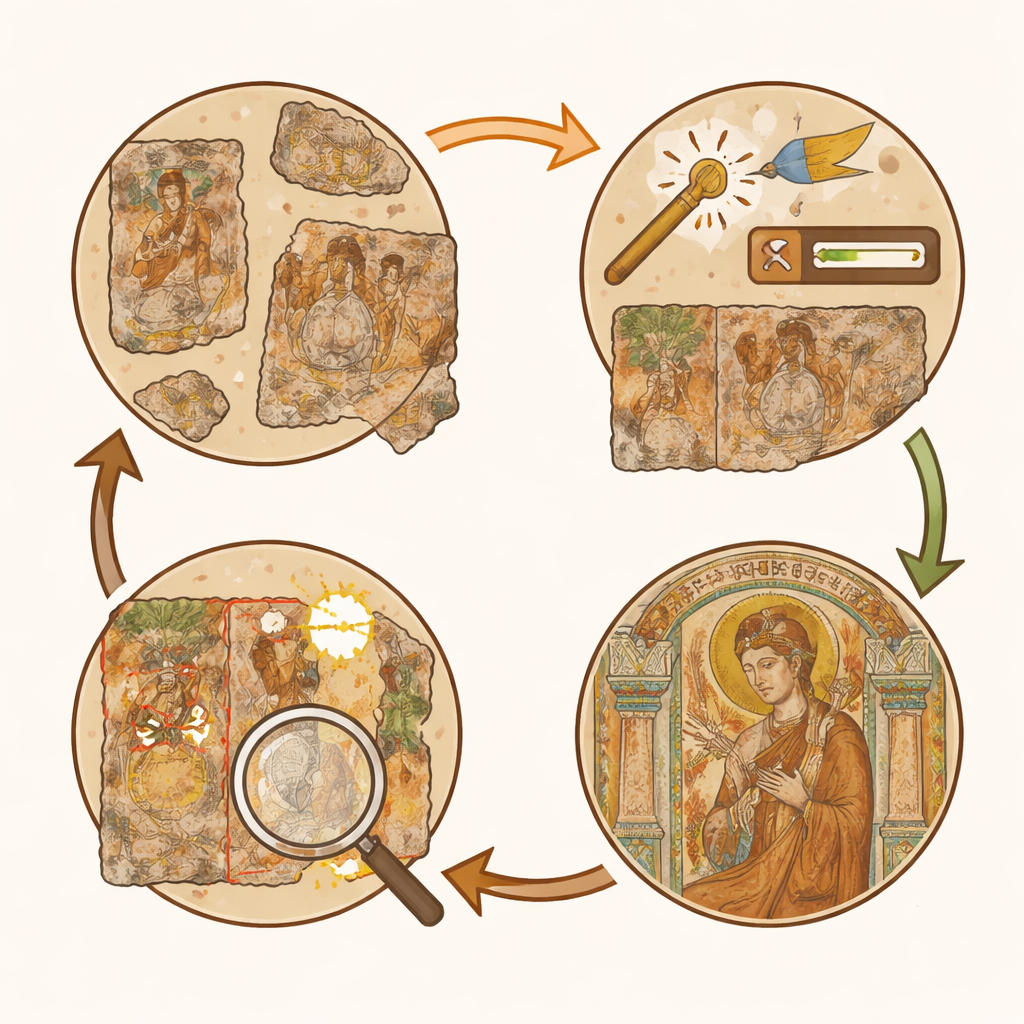

La restauración tradicional suele implicar que un conservador retoque físicamente la obra, añadiendo pintura nueva donde la antigua falta. Aunque se haga con cuidado, estos cambios no se deshacen con facilidad y pueden introducir sesgos modernos. La restauración digital sigue un camino distinto: fotografías de alta resolución de murales dañados son procesadas por algoritmos informáticos que sugieren cómo podrían rellenarse las zonas perdidas. Al ocurrir todo en software, las propuestas de restauración pueden compararse, revisarse o descartarse por completo sin tocar el objeto físico. Los autores se centran en murales de Dunhuang, en China, un célebre complejo de templos en cuevas cuyas pinturas murales han sufrido grietas, desprendimientos, moho y grandes faltantes. Su objetivo es construir un sistema que pueda reparar tales imágenes automáticamente conservando el estilo original, los colores y los detalles finos tanto como sea posible.

De fotos ruidosas a puntos de partida nítidos

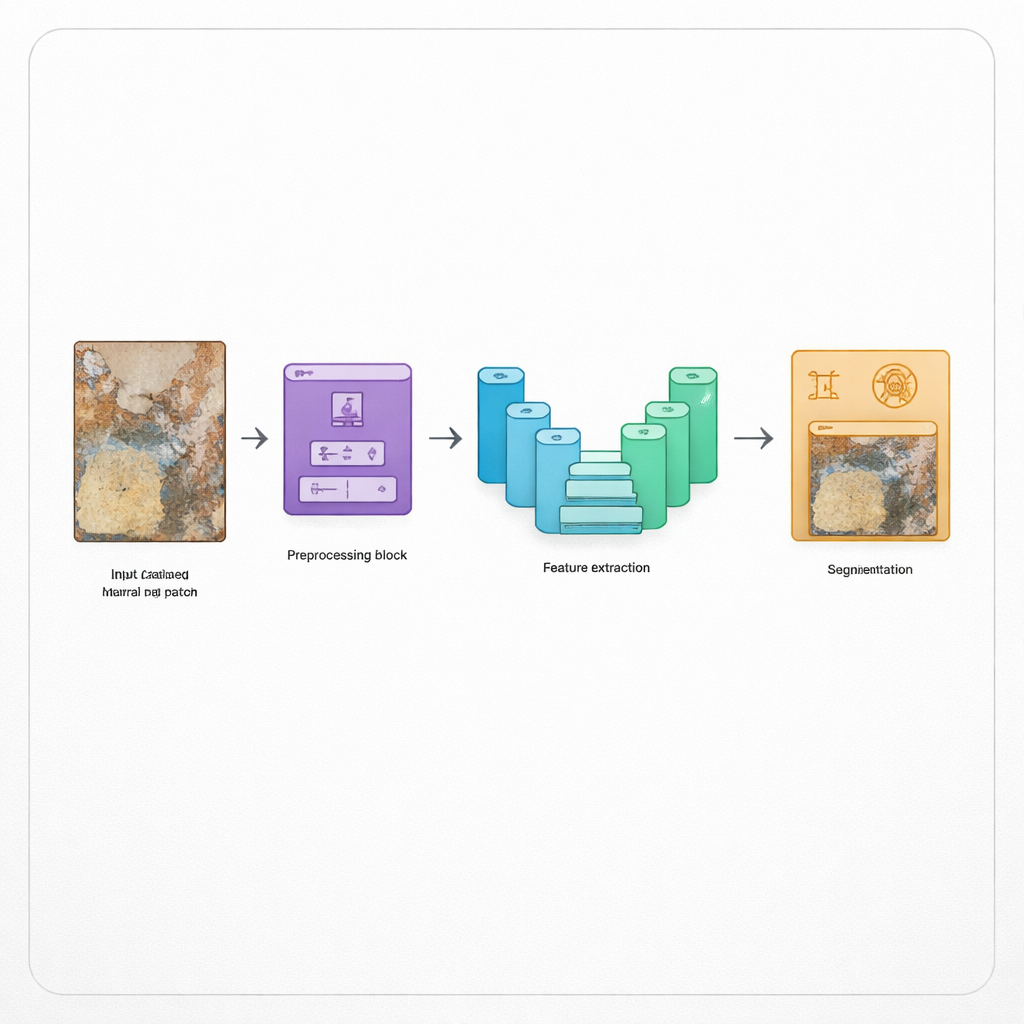

El primer paso del sistema es limpiar las fotografías de entrada para que el procesamiento posterior no se vea engañado por el ruido de la cámara o la iluminación deficiente. El método emplea un filtro mediano adaptativo, una técnica que suaviza motas y píxeles aleatoriamente claros u oscuros preservando a la vez bordes nítidos, como los contornos en una escena mural. A continuación realza el contraste para que líneas tenues y colores desvaídos sean más fáciles de distinguir. Estos ajustes actúan como pulir suavemente una lente polvorienta: no inventan contenido nuevo, pero hacen más visibles los detalles existentes. Al afinar cuidadosamente esta etapa, los autores evitan el sobre-suavizado, que podría borrar trabajos de pincel delicados que son importantes para los estudiosos.

Enseñar al sistema a entender el daño

Una vez limpia la imagen, el modelo debe decidir qué partes de un mural están intactas y cuáles están dañadas. Para ello, los autores usan una red neuronal compacta pero potente llamada SqueezeNet, ajustada con un mecanismo de atención para que se concentre en las regiones informativas. Esta red aprende a leer el lenguaje visual de los murales: texturas del yeso, patrones de pigmento y formas de grietas o paredes desnudas. Su salida alimenta otra red llamada U-Net, diseñada para tareas precisas de tipo “recorte”. U-Net etiqueta cada píxel como pintura sana, parche faltante u otras formas de deterioro. Gracias a las conexiones de salto y a bloques residuales y de atención añadidos, rastrea tanto la disposición amplia (dónde se sitúa una figura o un marco) como los rasgos diminutos (como cabellos o adornos), marcando exactamente dónde se necesita el rellenado.

Dejar que un pintor IA rellene los huecos

Con las regiones dañadas señaladas, la etapa final es imaginar cómo podrían haber sido originalmente esas zonas. Aquí los autores combinan dos ideas de vanguardia: redes generativas antagónicas (GAN), que son expertas en crear imágenes realistas, y redes transformer, que sobresalen en capturar relaciones de largo alcance. Su híbrido “GAN basado en transformer” observa la pintura intacta circundante y el mural en su conjunto para inferir texturas, formas y colores plausibles para las zonas faltantes. No se limita a copiar y pegar píxeles cercanos; en su lugar sintetiza contenido nuevo que se funde suavemente con la escena y respeta la composición global, como la simetría de patrones o la continuidad de túnicas y líneas arquitectónicas.

Qué tan bien funciona el restaurador digital

Para evaluar su sistema, los investigadores usaron un conjunto de datos especializado de imágenes de murales de Dunhuang que incluye versiones dañadas artificialmente y los originales de referencia. Esto les permite medir cuán cercana está la restauración digitalizada al original sin daños. Informan que su método, llamado HDLIP-SHAR, supera a varias técnicas existentes de rendimiento sólido en múltiples métricas de calidad, incluyendo claridad general (PSNR), similitud estructural (SSIM) y una medida perceptual moderna (LPIPS) que refleja mejor el juicio visual humano. El modelo también es eficiente en su ejecución, requiriendo menos recursos informáticos y menos tiempo que muchos enfoques rivales, lo cual es importante si los museos desean procesar grandes colecciones.

Qué significa esto para salvar la historia

Para los no especialistas, la conclusión clave es que este sistema de IA actúa como un asistente cuidadoso y reversible en lugar de un pintor demasiado seguro. Puede sugerir cómo podrían completarse rostros, patrones o escenas faltantes en murales antiguos, ofreciendo a los investigadores una potente herramienta de visualización sin poner en riesgo los originales. Al mismo tiempo, los autores señalan limitaciones: el método sigue dependiendo de disponer de material de referencia razonablemente claro, tiene dificultades con daños extremadamente severos y aún no incorpora la erudición histórica o el análisis material en sus conjeturas. Aun así, enfoques híbridos como HDLIP-SHAR representan un paso importante hacia el uso de la IA no solo para mejorar imágenes estéticamente, sino para ayudar a salvaguardar un patrimonio cultural irreemplazable de forma transparente, comprobable y no invasiva.

Cita: Swathi, B., Rao, D.B.J. Automated image inpainting for historical artifact restoration using hybridisation of transfer learning with deep generative models. Sci Rep 16, 4810 (2026). https://doi.org/10.1038/s41598-026-35056-w

Palabras clave: restauración digital de murales, rellenado de imágenes, aprendizaje profundo, patrimonio cultural, modelos GAN y transformer