Clear Sky Science · es

Un estudio sobre el diseño y la evaluación multimodal de interfaces intuitivas para sistemas de información complejos en cooperación tripulada/no tripulada

Por qué las pantallas más inteligentes importan en misiones de alta presión

Las misiones militares modernas dependen cada vez más de equipos de aeronaves tripuladas que operan junto con enjambres de drones. Los comandantes deben filtrar pantallas de radar y paneles de estado abarrotados en segundos, donde la confusión puede significar amenazas no detectadas o errores de fuego amigo. Este estudio plantea una pregunta simple con grandes implicaciones: si rediseñamos estas pantallas complejas para que resulten más “evidentes” de un vistazo —usando imágenes, color y movimiento en lugar de texto denso—, ¿pueden las personas pensar más rápido, mantenerse más calmadas y aun así tomar la decisión correcta?

Convertir intuiciones en diseño de pantalla

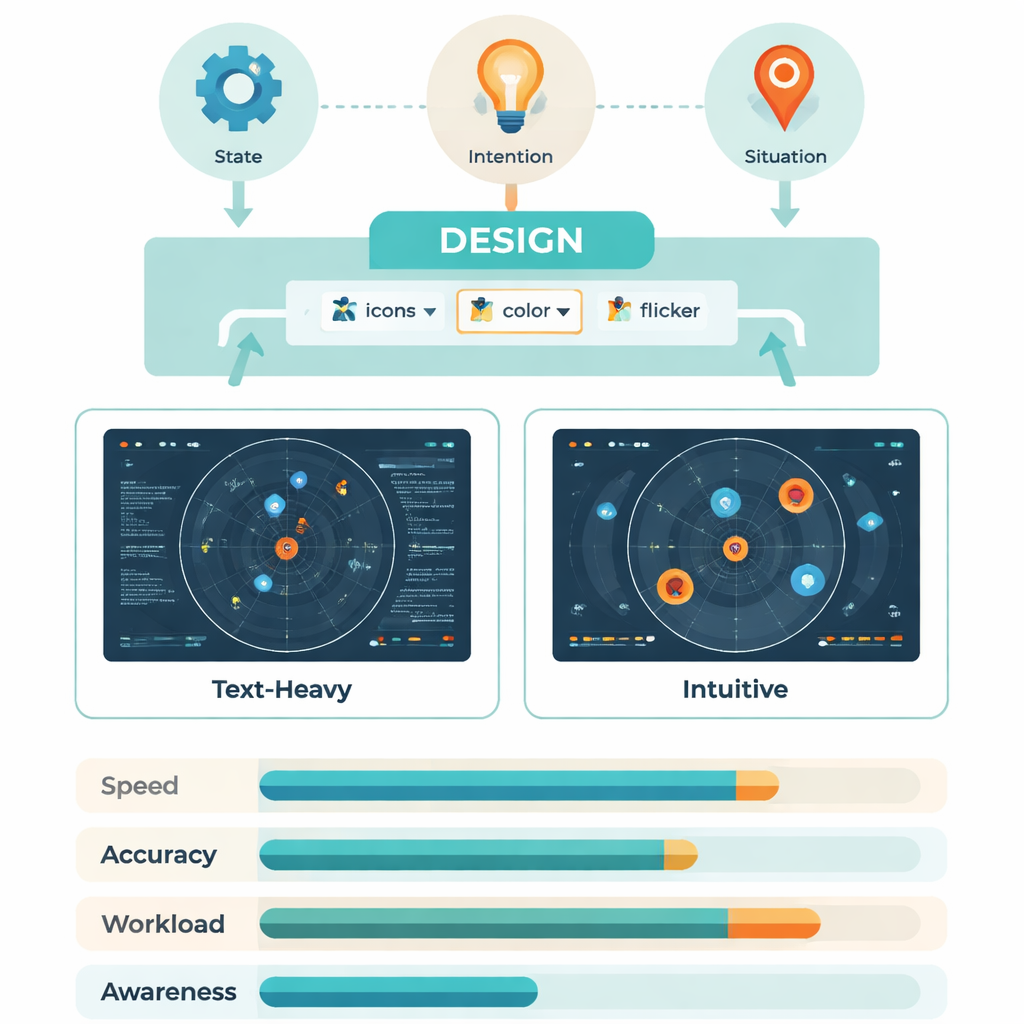

Los investigadores parten de la idea de la “interacción intuitiva”: la forma en que entendemos automáticamente una luz roja como peligro o una cadena rota como una conexión perdida. La psicología y la investigación en factores humanos sugieren que esos patrones incorporados —reflejos corporales, símbolos cotidianos e iconos familiares— pueden aprovecharse para que los usuarios no tengan que decodificar conscientemente cada dato. En este proyecto, esas ideas se aplican a pantallas de gestión de combate que muestran tres tipos principales de información: qué blancos y armas están presentes (estado), qué van a hacer los drones (intención) y cómo se desarrolla el combate en su conjunto (situación). Al mapear cada uno de estos a formas simples, colores y movimiento, el equipo pretendía crear pantallas que se “explicaran solas” en el instante en que aparecen.

De bocetos de expertos a pantallas de combate operativas

Diseñar una interfaz así no fue producto de conjeturas. El equipo entrevistó primero a operadores experimentados y diseñadores de sistemas, preguntando, por ejemplo, “¿qué tipo de símbolo te permite reconocer un dron que hace interferencias sin pensar?”. De estas sesiones destilaron palabras clave como ojo, onda, cadena y zona, y las transformaron en conjuntos de iconos esquemáticos. Un segundo grupo de expertos probó entonces estos prototipos mientras pensaban en voz alta. Cualquier símbolo que no fuera comprendido correctamente por todos se revisó hasta que cada elemento pudo leerse al instante. La interfaz final usó siluetas de aeronaves en lugar de etiquetas de texto, brillo para mostrar el nivel de amenaza, resaltados parpadeantes para señalar dónde se movería un dron a continuación, miras o líneas onduladas para señalar ataques o interferencias, y pequeños marcadores locales bajo cada blanco para mostrar si había entrado en un rango crítico.

Probar las pantallas intuitivas

Para ver si estas ideas funcionaban en la práctica, 30 miembros entrenados de la Fuerza Aérea se sentaron frente a una consola de mando simulada y realizaron tareas de campo de batalla ficticias. A veces usaban una pantalla tradicional pesada en texto; otras, la nueva versión intuitiva, con diseño y color cuidadosamente emparejados para que solo cambiara la forma en que se codificaba la información. Mientras buscaban drones, misiles, niveles de amenaza, fallos de enlace o blancos en alcance, el sistema registró la rapidez y precisión de sus respuestas, hacia dónde movían los ojos y cómo reaccionaba su cerebro mediante señales EEG vinculadas a la carga mental. Tras las pruebas, los participantes valoraron la exigencia de las tareas usando la conocida escala de carga de trabajo NASA‑TLX.

Ojos más rápidos, cerebros más ligeros

Las pantallas intuitivas ayudaron de forma consistente bajo cargas de información bajas y moderadas. Los operadores respondieron más rápido —a menudo cientos de milisegundos antes por consulta— y necesitaron menos fijaciones y saltos oculares para encontrar el elemento correcto. Señales dinámicas como un parpadeo suave fueron especialmente eficaces para resaltar la posición futura de un dron, mientras que símbolos ampliamente comprendidos (como miras para ataque) superaron códigos profesionales más crípticos al describir acciones próximas. Las medidas de la actividad cerebral contaron la misma historia: una señal clave llamada P300, que crece con el esfuerzo y la demora en el procesamiento, fue menor y ocurrió antes con las pantallas intuitivas, mostrando que el cerebro trabajaba con mayor eficiencia. Para tareas densa y de alta carga la ventaja se redujo, lo que sugiere que ninguna interfaz puede anular completamente una complejidad extrema.

Qué significa esto para las personas en el bucle

En una prueba posterior con una versión optimizada de la interfaz intuitiva, un nuevo grupo de operadores mostró mejor conciencia situacional, mayor eficacia y menor fatiga mental autoinformada en todos los ámbitos comparado con el diseño tradicional. En pocas palabras, al convertir números y jerga en imágenes claras, códigos de color y movimiento que se alinean con la experiencia cotidiana, el sistema permitió a las personas detectar amenazas y oportunidades más rápido y con menos fatiga mental. Aunque el trabajo se realizó en laboratorio con un grupo de usuarios limitado, ofrece una receta concreta para diseñar futuras salas de control —militares o civiles— donde los operadores humanos deben seguir el ritmo de máquinas inteligentes sin verse abrumados.

Cita: Qu, J., Chen, S., Dang, S. et al. A study on design and multimodal evaluation of intuitive interfaces for complex information systems in manned/unmanned cooperation. Sci Rep 16, 4746 (2026). https://doi.org/10.1038/s41598-026-35017-3

Palabras clave: interfaces intuitivas, colaboración humano‑máquina, conciencia situacional, seguimiento ocular y EEG, cooperación tripulada‑no tripulada