Clear Sky Science · es

Segmentación submarina de objetos en tiempo real y precisa mediante YOLOv11-UOS dual mejorado con realce adaptativo guiado por la física y potenciación por atención

Buceando más profundo con ojos digitales más nítidos

Nuestros océanos se exploran cada vez más no solo por buceadores y submarinos, sino por cámaras inteligentes transportadas por robots submarinos. Estas cámaras ayudan a buscar naufragios, inspeccionar tuberías marinas y vigilar arrecifes de coral y poblaciones de peces. Sin embargo, las imágenes submarinas suelen ser turbias, azul‑verdosas y estar llenas de ruido visual, lo que dificulta que incluso los humanos —y mucho más los ordenadores— identifiquen objetos. Este artículo presenta un nuevo sistema de visión por computador que limpia las imágenes submarinas y luego detecta y delimita objetos en ellas, lo suficientemente rápido como para guiar misiones robóticas en tiempo real.

Por qué es tan difícil ver bajo el agua

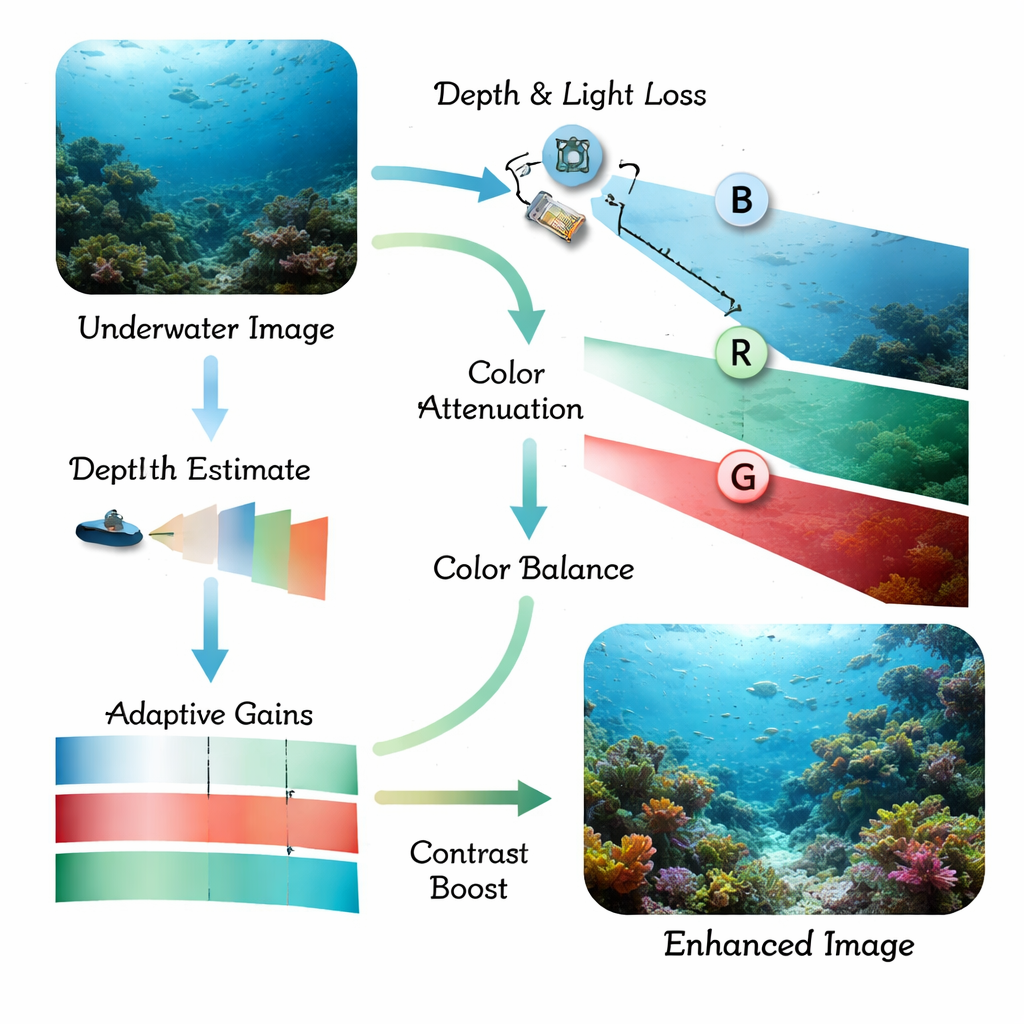

La luz se comporta de forma muy distinta en el agua que en el aire. A medida que la luz solar penetra, los tonos rojos desaparecen primero, luego los verdes, dejando un tinte azulado y escenas apagadas con poco contraste. Las partículas en el agua dispersan la luz, creando niebla que difumina los bordes y oculta detalles pequeños. Los programas tradicionales de detección de objetos, e incluso los modelos modernos de aprendizaje profundo, luchan con estas imágenes distorsionadas: los peces se confunden con el coral, las estructuras artificiales desaparecen en el fondo y las escenas con poca luz resultan casi ilegibles. Investigaciones previas normalmente abordaban o la limpieza de la imagen o la detección de objetos por separado, lo que a menudo dejaba el sistema final demasiado lento, frágil o aún ciego en aguas muy turbias.

Una estrategia en dos pasos: limpiar primero, luego enfocar

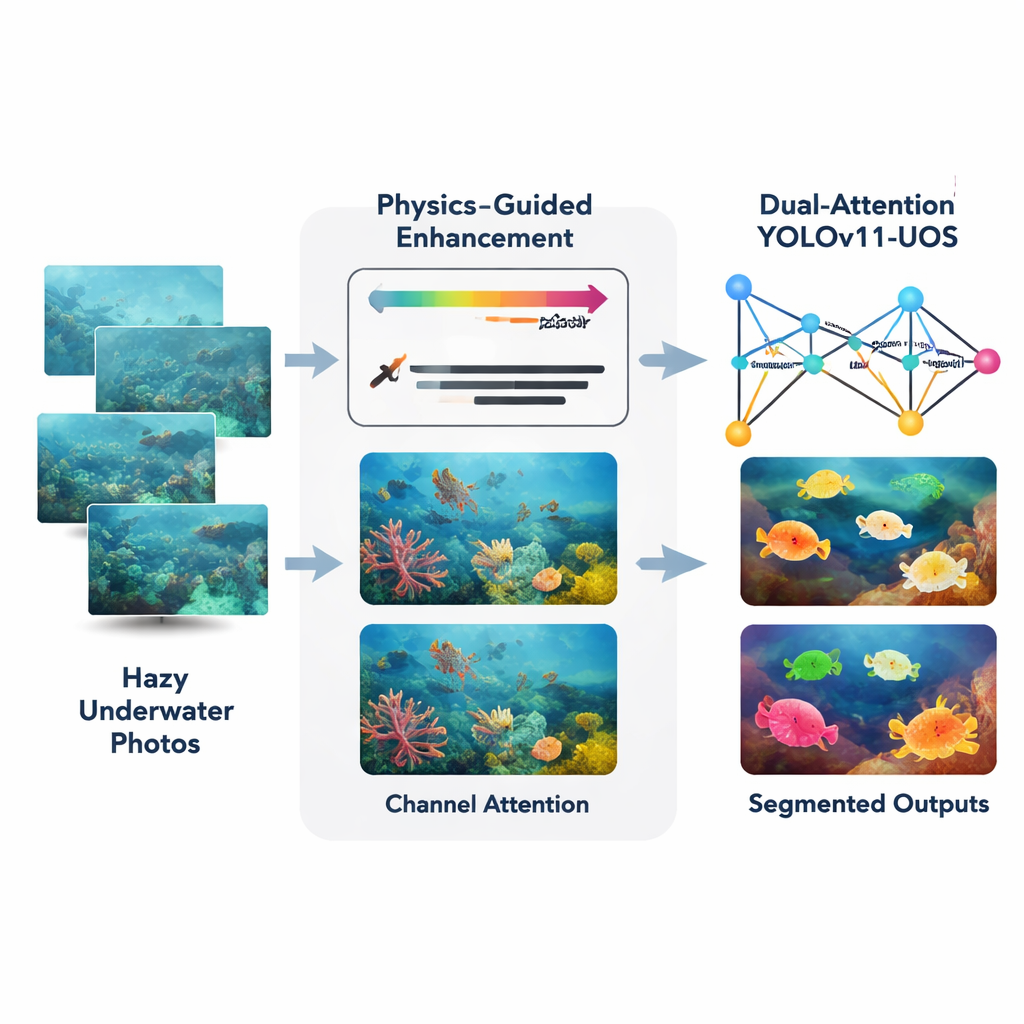

Los autores proponen un enfoque combinado centrado en un detector en tiempo real reciente llamado YOLOv11, adaptado aquí para escenas submarinas y segmentación por instancias (trazado preciso del contorno de cada objeto). Primero, un módulo frontal llamado Realce Adaptativo Guiado por la Física procesa las fotos submarinas crudas y las corrige usando un modelo físico simplificado de cómo la luz se absorbe y dispersa en el agua. Estima la distancia de cada parte de la escena a la cámara y compensa la mayor pérdida de luz roja respecto a la verde y la azul. Esto restaura colores más naturales y aumenta el contraste local, mientras que un paso cuidadoso basado en histograma afila los bordes sin amplificar el ruido, incluso en regiones oscuras o turbias.

Enseñando a la red dónde mirar

Una vez que la imagen ha sido limpiada, se pasa a una columna vertebral (backbone) de YOLOv11 mejorada que incorpora mecanismos de atención. Estos módulos añadidos actúan como una especie de foco y filtro de color. La atención espacial indica a la red que preste más atención a regiones importantes —como el contorno de un pez o el borde de un artefacto sumergido— y que ignore fondos distractores como arena o plantas que se mueven. La atención por canales ajusta la intensidad con la que el sistema pondera distintos patrones de color y textura, de modo que las señales visuales útiles se enfatizan mientras que las irrelevantes quedan atenuadas. Juntas, estas dos etapas de atención ayudan a la red a construir representaciones internas más nítidas antes de decidir dónde están los objetos y qué son.

Pruebas en océanos reales y condiciones difíciles

Para evaluar el rendimiento del sistema en la práctica, los investigadores lo entrenaron y probaron con varias colecciones públicas de imágenes submarinas y con un nuevo conjunto personalizado de más de 7.000 fotos cuidadosamente etiquetadas de aguas costeras con variaciones de profundidad y turbidez. Midieron puntuaciones estándar de detección y segmentación y compararon su método con modelos ampliamente utilizados como U‑Net, DeepLab, segmentadores basados en transformadores y un sistema YOLOv11 de referencia sin los módulos nuevos. El diseño combinado de realce más atención mejoró la precisión media de detección en aproximadamente 6,5 puntos porcentuales sobre el YOLOv11 de referencia, con contornos de objetos visiblemente más limpios y menos elementos omitidos o detectados erróneamente. De forma importante, el sistema sigue funcionando a alrededor de 38 fotogramas por segundo en una GPU moderna, lo bastante rápido para uso casi en tiempo real en plataformas robóticas.

Qué significa esto para los robots oceánicos y la investigación

En términos sencillos, el estudio muestra que un preprocesado inteligente y la atención focalizada permiten que los ordenadores «vean» mucho mejor bajo el agua. Al deshacer primero parte de la física que estropea las fotos submarinas y luego guiar a la red de detección para que se concentre en las regiones y colores más informativos, el método ofrece contornos más nítidos y fiables de peces, corales y estructuras artificiales. Esto puede ayudar a vehículos submarinos autónomos a navegar con seguridad, monitorizar ecosistemas marinos frágiles e inspeccionar infraestructuras submarinas críticas sin supervisión humana. Persisten desafíos en aguas extremadamente fangosas o en escenas muy profundas con escasez de luz roja, pero el marco ofrece un paso práctico hacia una visión submarina robusta y en tiempo real que puede apoyar futuros mapeados 3D y exploraciones multisensor del océano.

Cita: Deluxni, N., Sudhakaran, P., Alroobaea, R. et al. An accurate realtime underwater object segmentation using improved dual-domain YOLOv11-UOS with physics guided adaptive enhancement and attention-boosting. Sci Rep 16, 4804 (2026). https://doi.org/10.1038/s41598-026-35001-x

Palabras clave: visión submarina, robótica marina, mejora de imagen, segmentación de objetos, visión por computador