Clear Sky Science · es

Examinando la dependencia humana de la inteligencia artificial en la toma de decisiones

Por qué importa nuestra confianza en las máquinas inteligentes

Desde recomendaciones de películas hasta selección de personal y justicia penal, la inteligencia artificial (IA) ayuda cada vez más a las personas a tomar decisiones. Muchos asumimos que los ordenadores son menos sesgados y más precisos que los humanos. Pero, ¿qué ocurre realmente cuando las personas reciben un consejo de un sistema de IA: lo usan de forma sensata o dependen demasiado de él? Este estudio explora cómo responden las personas a la orientación de la IA en comparación con la orientación de otros humanos y qué implica eso para el papel creciente de la IA en las decisiones cotidianas.

Probando a personas reales con caras reales y falsas

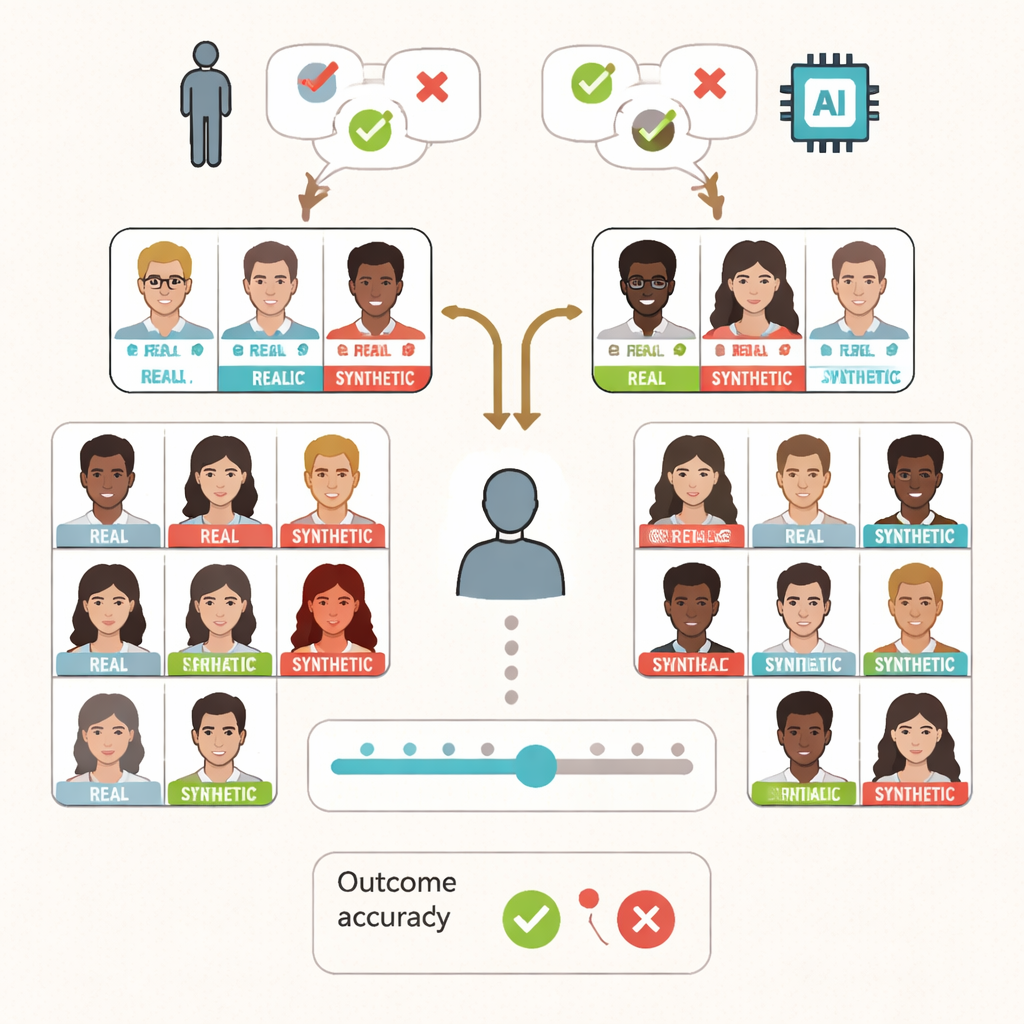

Los investigadores pidieron a 295 adultos que realizaran una tarea aparentemente simple: decidir si una cara en pantalla era la fotografía de una persona real o una falsificación generada por IA. Cada participante vio 80 caras —la mitad reales, la mitad sintéticas— que se habían seleccionado cuidadosamente a partir de trabajos anteriores para que la mayoría de las personas pudiera resolverlas en su mayor parte, pero no de forma perfecta. Junto a cada cara, los participantes vieron un breve consejo que decía si la cara era "real" o "sintética". Les dijeron que ese consejo provenía bien de un grupo de expertos humanos o de un sistema de IA, aunque en realidad todas las recomendaciones estaban preprogramadas y eran correctas solo la mitad de las veces.

Usando el consejo, pero no a ciegas

La cuestión central era si las personas seguirían simplemente el consejo o pensarían por sí mismas. Los resultados muestran que los participantes no se comportaron como simples pulsadores de botones. Siguieron el consejo mucho más cuando resultaba ser correcto y tendieron a ignorarlo cuando era erróneo, independientemente de si supuestamente provenía de humanos o de IA. La exactitud global al distinguir caras reales de sintéticas se mantuvo en torno a dos tercios de aciertos —muy similar a un grupo separado de trabajos anteriores que realizó la misma tarea sin ninguna orientación. En otras palabras, la presencia de un “ayudante” de IA no mejoró ni arruinó el rendimiento de forma drástica en promedio.

Cuando las actitudes positivas hacia la IA se vuelven en su contra

Sin embargo, bajo estos promedios emergió un patrón más sutil. Los participantes también completaron encuestas sobre cuánto confían generalmente en otras personas y cómo se sienten respecto a la IA. Aquellos con actitudes más positivas hacia la IA en realidad empeoraron a la hora de distinguir lo real de lo falso cuando recibieron orientación de la IA. Fueron menos capaces de distinguir caras genuinas de sintéticas que los participantes con opiniones más cautelosas o negativas sobre la IA. Este efecto no apareció cuando la gente creía que la orientación procedía de humanos, lo que sugiere que el consejo de la IA puede moldear, y en ocasiones distorsionar, nuestra toma de decisiones de forma particular. El estudio también encontró que las personas que afirmaron depender siempre del consejo obtuvieron peores resultados que quienes dijeron usarlo solo a veces o no usarlo.

Las personas siguen jugando el papel decisorio

Los investigadores indagaron más en cómo las personas equilibraban su propio juicio con la orientación. De media, los participantes mostraron un sesgo a etiquetar las caras como reales, y ese sesgo creció ligeramente entre quienes declararon una mayor tendencia a confiar en otros humanos. Aun así, la forma en que la gente usó el consejo parecía “estratégica”: parecía recurrir a él especialmente cuando estaban menos seguros. Las valoraciones de confianza coincidieron bastante con el rendimiento: cuando las personas se sentían más seguras, en general eran más precisas, lo que indica que los participantes tenían una idea razonable de cuándo estaban acertando o errando, incluso con la IA en el circuito.

Qué significa esto para las herramientas de IA del día a día

Para un lector no especializado, el mensaje clave es que la IA no elimina mágicamente el sesgo humano, ni tampco domina automáticamente nuestro juicio. La gente suele tratar el consejo de la IA de forma similar al consejo humano y puede ignorarlo cuando parece poco útil. Pero cuando alguien ya piensa muy positivamente de la IA, puede tender más a apoyarse en ella de maneras que reducen su precisión. A medida que los sistemas de IA se extiendan a áreas críticas como la sanidad, la seguridad y la justicia, los diseñadores y los responsables políticos necesitarán comprender estas tendencias humanas. Este estudio sugiere que el uso efectivo de la IA depende no solo de mejores algoritmos, sino de personas informadas que sepan cuándo confiar en la máquina —y cuándo confiar en sí mismas.

Cita: Pearson, J., Dror, I., Jayes, E. et al. Examining human reliance on artificial intelligence in decision making. Sci Rep 16, 5345 (2026). https://doi.org/10.1038/s41598-026-34983-y

Palabras clave: inteligencia artificial, toma de decisiones humana, confianza en la IA, sesgo de automatización, caras deepfake