Clear Sky Science · es

Método de calibración extrínseca LiDAR–cámara de largo alcance para el transporte ferroviario

Mantener los trenes seguros desde lejos

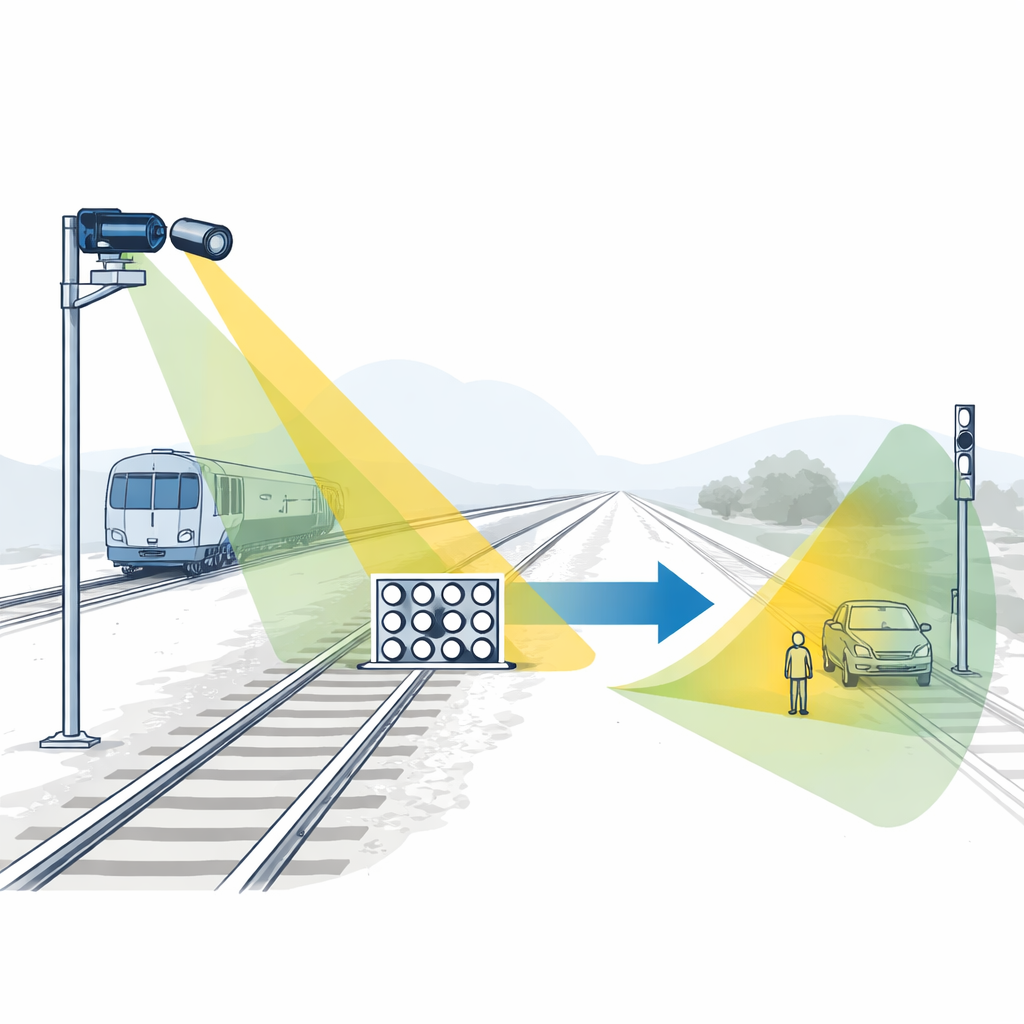

Los trenes modernos sin conductor dependen de “ojos” electrónicos para vigilar las vías en busca de obstáculos mucho antes de lo que podría ver una persona. Dos de los sensores más importantes son las cámaras y los escáneres láser llamados LiDAR, que perciben el mundo de maneras distintas. Para trabajar en conjunto deben alinearse con gran precisión, una tarea que se complica sorprendentemente cuando se vigilan vías a cientos de metros. Este estudio presenta una nueva forma de alinear esos sensores para que puedan proteger los sistemas ferroviarios a larga distancia de manera fiable.

Por qué importa la alineación de sensores

En un tren autónomo, las cámaras capturan imágenes en color detalladas mientras que el LiDAR mide distancias emitiendo pulsos de luz y cronometrando su retorno. Fusionar estas dos visiones permite al sistema detectar y seguir objetos que podrían invadir el área de la vía, desde un coche averiado en un paso a nivel hasta escombros en los raíles. Pero la fusión solo funciona si el sistema conoce exactamente cómo están posicionados la cámara y el LiDAR entre sí. Un pequeño desalineamiento puede desplazar un obstáculo detectado varios centímetros —o incluso metros— a largas distancias, lo que podría hacer que los sistemas automáticos de protección sean más lentos o menos fiables.

El desafío de ver lejos por la vía

Para aplicaciones ferroviarias, los ingenieros suelen usar objetivos telefoto para que la cámara pueda ver claramente objetos a cientos de metros. A esas distancias, sin embargo, los retornos del LiDAR de cualquier objetivo de calibración se vuelven muy escasos: solo unos pocos puntos láser impactan en la cartulina usada para alinear los sensores. La mayoría de las técnicas de alineación existentes asumen una nube densa de puntos LiDAR o bordes ricos en la escena, condiciones que simplemente no se cumplen a larga distancia. Como resultado, se vuelve difícil encontrar características coincidentes entre la imagen 2D y la nube de puntos 3D con la precisión suficiente para soportar un control seguro del tren.

Una cartulina de calibración más inteligente

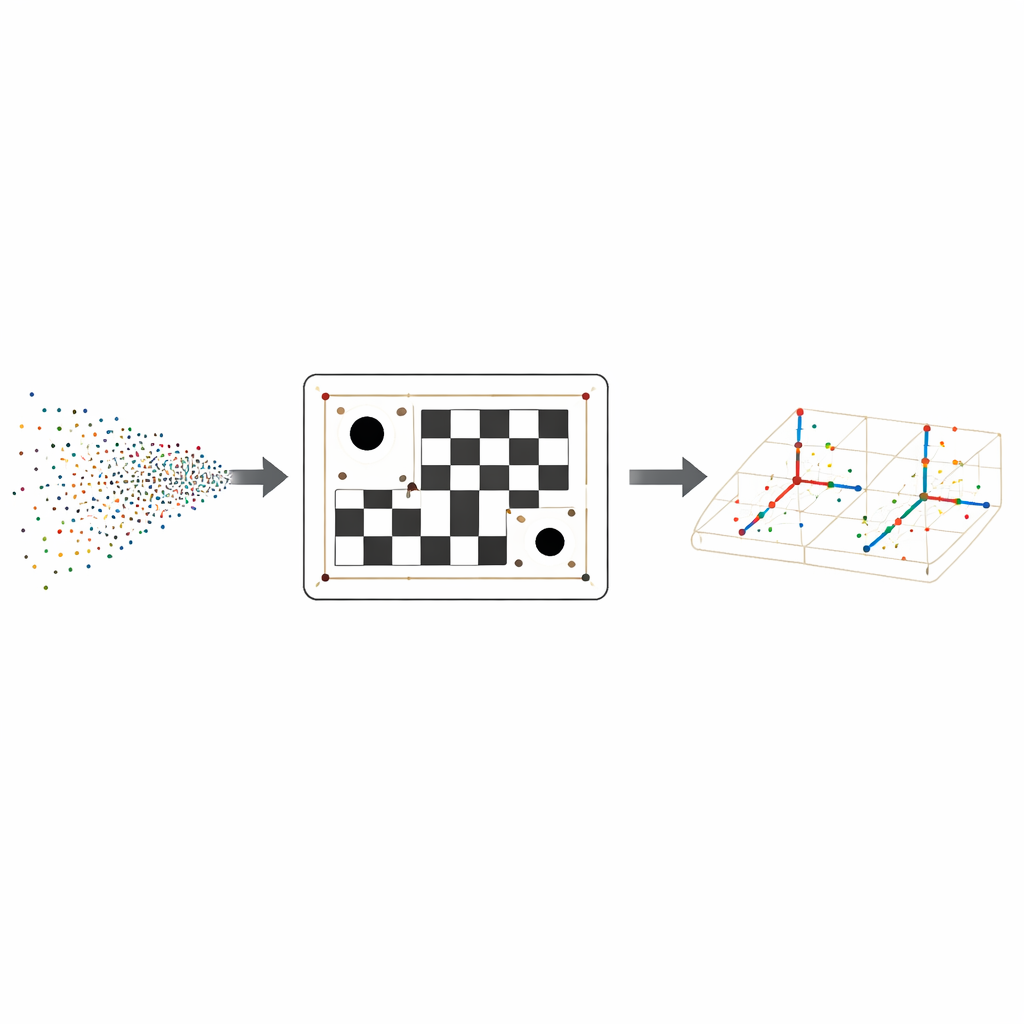

Para superar esto, los autores diseñan una cartulina de calibración especial que combina un conocido patrón de cuadros blanco y negro con tres orificios circulares cuyos centros forman un triángulo irregular. El patrón de cuadros proporciona muchos puntos de esquina precisos en la imagen de la cámara, mientras que los agujeros generan pistas geométricas fuertes para el LiDAR, que puede detectar fácilmente sus bordes redondeados incluso desde lejos. Debido a que los tres agujeros están colocados en un triángulo asimétrico, la orientación de la cartulina en el espacio puede determinarse sin ambigüedad, evitando confusiones por vistas reflejadas o rotadas.

Convertir puntos dispersos en coincidencias fiables

En el lado del LiDAR, el método primero limpia la nube de puntos y ajusta un plano que representa la cartulina. Luego proyecta los puntos sobre ese plano y usa un procedimiento robusto de ajuste de círculos para encontrar el centro de cada orificio, refinando sus posiciones al imponer las distancias físicas conocidas entre los agujeros. Con el triángulo de centros de agujero establecido, el algoritmo construye una cuadrícula de coordenadas local a través de la cartulina, predice dónde debería situarse cada esquina del patrón en 3D y comprueba los puntos LiDAR cercanos en busca de los valores correctos de brillo, o reflectividad. Esta combinación de geometría y reflectividad convierte un puñado de retornos dispersos en un conjunto fiable de ubicaciones 3D de las esquinas que coinciden con las esquinas 2D de la cámara.

Ajuste fino de la relación entre sensores

Una vez que se identifican las mismas esquinas físicas tanto en la imagen de la cámara como en la nube del LiDAR, los autores resuelven la rotación y la traslación exactas que vinculan los dos sensores. Utilizan una técnica de optimización iterativa que ajusta repetidamente esta relación para reducir la brecha entre dónde proyectan los puntos LiDAR en la imagen y dónde la cámara realmente ve las esquinas. Las pruebas en una plataforma ferroviaria real, usando diferentes lentes de cámara desde teleobjetivos moderados hasta fuertes, muestran que el nuevo método mantiene consistentemente errores de proyección en torno a un píxel o menos, y supera a varias alternativas bien conocidas, especialmente en las longitudes focales más largas donde los datos son más escasos.

Qué significa esto para la seguridad ferroviaria

En términos cotidianos, el estudio ofrece una forma más fiable de decirle a la cámara y al LiDAR de un tren autónomo: “estás aquí y miras exactamente en esta dirección”. Al rediseñar la cartulina de calibración y añadir un procesamiento inteligente de los datos LiDAR escasos, el método mantiene una alta precisión incluso cuando los sensores observan escenas a cientos de metros. Esta alineación más ajustada permite al sistema fusionado situar los obstáculos con mayor precisión en el espacio 3D, reforzando la base tecnológica para un transporte ferroviario más seguro y una percepción multisensorial más confiable en el mundo real.

Cita: Liu, X., Wang, H., Ruan, S. et al. A long-range LiDAR–camera extrinsic calibration method for rail transit. Sci Rep 16, 8018 (2026). https://doi.org/10.1038/s41598-025-34547-6

Palabras clave: seguridad del transporte ferroviario, fusión LiDAR cámara, calibración de sensores, trenes autónomos, percepción a larga distancia