Clear Sky Science · es

Enfoque de aprendizaje incremental para la segmentación semántica de imágenes de histología cutánea

Por qué importa enseñar a las máquinas a leer muestras de piel

El cáncer de piel es uno de los cánceres más comunes en todo el mundo, y los médicos con frecuencia dependen de finas láminas de tejido, observadas bajo el microscopio, para evaluar la gravedad de un tumor y decidir el tratamiento. Leer estas láminas es un trabajo lento y exigente que puede variar entre expertos. Este estudio explora cómo construir sistemas informáticos que aprendan a reconocer distintos tejidos y tipos de cáncer en estas imágenes microscópicas y, lo que es importante, sigan mejorando con el tiempo a medida que se incorporan nuevos tipos de imágenes—de modo análogo a un alumno humano que continúa aprendiendo a lo largo de su carrera.

De respuestas simples de sí/no a mapas detallados de tejido

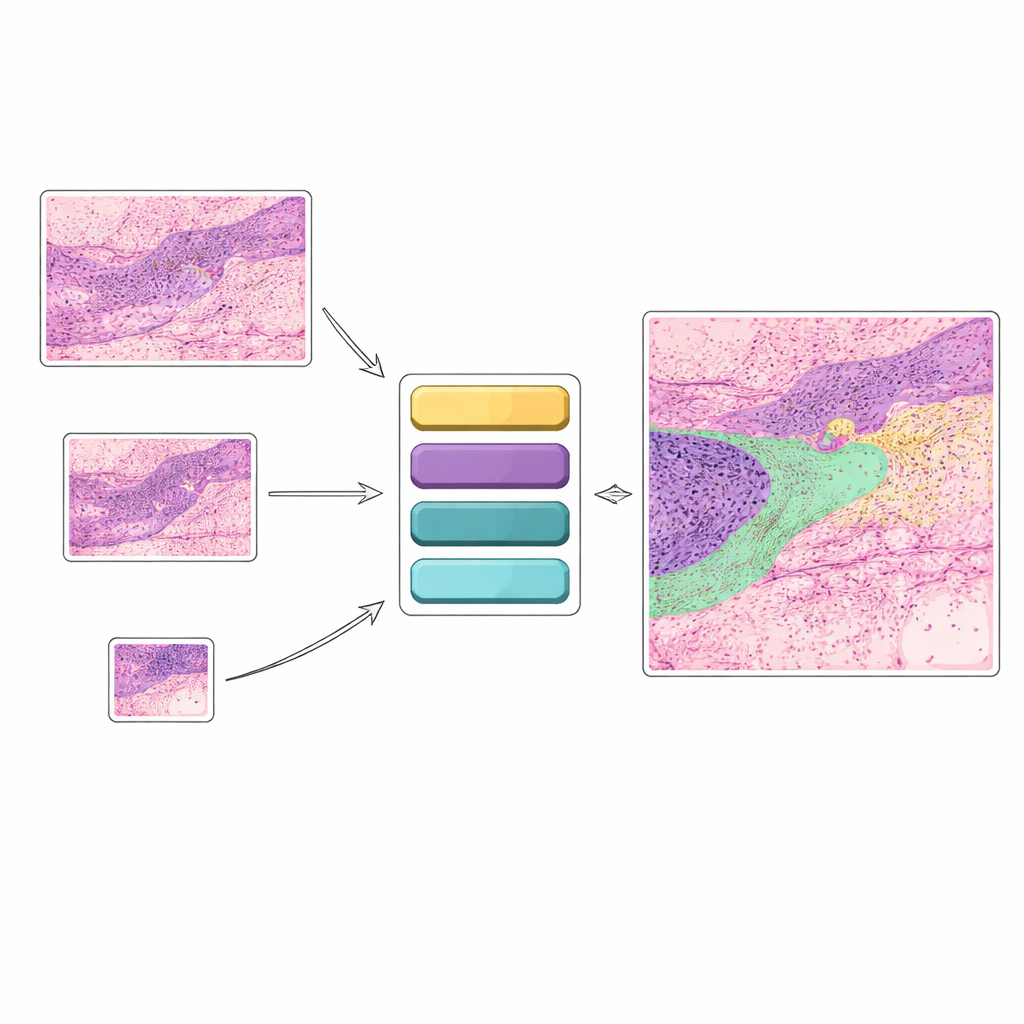

Muchas herramientas de inteligencia artificial existentes para el cáncer de piel analizan una imagen y responden a una pregunta estrecha, como «cáncer» o «sin cáncer». Aunque útiles, ese tipo de decisión binaria no captura el detalle rico que ven los patólogos. En la práctica, los médicos se interesan por muchas estructuras a la vez: distintos tipos de cáncer, capas sanas de la piel, folículos pilosos, glándulas, zonas inflamadas y más. Este estudio se centra en la «segmentación semántica», en la que a cada píxel de una imagen histológica se le asigna una de doce categorías de tejido. Eso produce un mapa codificado por colores que muestra exactamente dónde están los diversos cánceres y tejidos normales, ofreciendo una guía más clara para el diagnóstico y la planificación del tratamiento.

Por qué los sistemas actuales tienen dificultades para adaptarse

Los potentes modelos de aprendizaje profundo de hoy suelen asumir que todos los datos de entrenamiento están disponibles de entrada. Una vez entrenados, tienden a «fijar» su conocimiento. Si más adelante se introducen datos con propiedades distintas—por ejemplo, imágenes a otra magnificación—la opción más segura suele ser volver a entrenar todo el modelo desde cero. Eso es costoso y lento y, además, añadir nueva información puede causar un «olvido catastrófico», donde el rendimiento en tareas anteriores se degrada sin que se note. En entornos clínicos, sin embargo, los datos evolucionan constantemente: los escáneres se actualizan, cambian los parámetros de adquisición y los hospitales recopilan nuevos tipos de muestras. Una herramienta de IA que no pueda absorber esos cambios con gracia resulta difícil de confiar en la práctica diaria.

Una estrategia de aprendizaje por etapas inspirada en cómo aprenden las personas

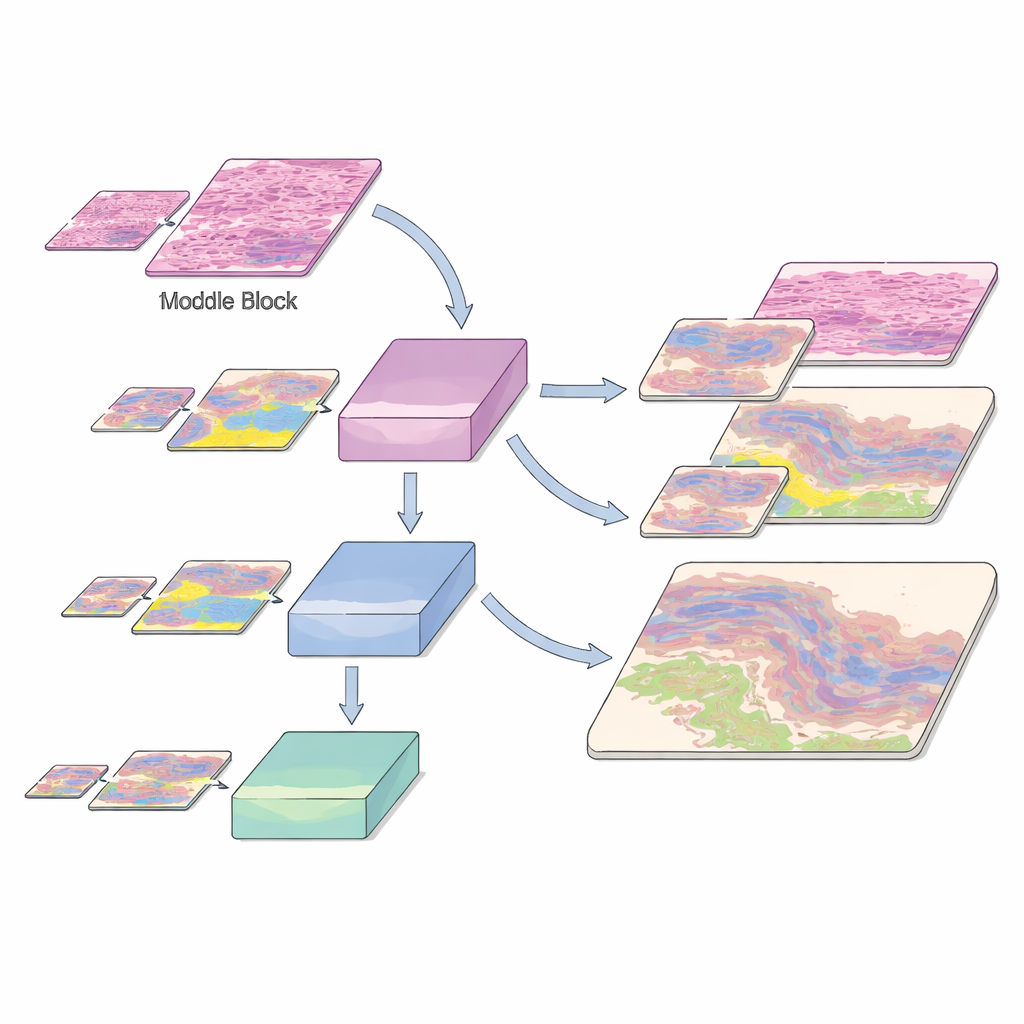

Los autores parten de una arquitectura moderna de transformador de visión llamada SegFormer y la convierten en un sistema de «aprendizaje incremental» para el cáncer cutáneo no melanoma. En lugar de ver todos los datos a la vez, el modelo se entrena por etapas usando láminas histológicas de un conjunto público de la Universidad de Queensland. Primero aprende con imágenes de alta magnificación (10×), donde el detalle fino es claro. Después se añaden imágenes a 5× y luego a 2×, mientras se conserva una porción de los datos iniciales de alto detalle. Funciones de pérdida especiales ayudan a la nueva versión del modelo a retener lo que ya conocía sobre los patrones tisulares, incluso mientras se adapta a vistas más gruesas y con menos aumento. Este «aprender sin olvidar» se guía mediante una técnica llamada destilación de conocimiento, donde un modelo anterior actúa como profesor para el nuevo, y mediante un término de destilación mutua que empuja a las representaciones antiguas y nuevas a mantenerse en armonía.

Aprendizaje a través de niveles de zoom y tipos de tejido raros

Las imágenes histológicas son desafiantes no solo porque hay muchos tipos de tejido, sino también porque algunas estructuras importantes son raras. El conjunto de datos incluye cánceres comunes como el carcinoma basocelular y el carcinoma espinocelular, así como capas normales e inflamadas de la piel, todas anotadas a nivel de píxel por expertos—un proceso minucioso que lleva cientos de horas. Los autores recortan estas enormes láminas en parches pequeños y entrenan su modelo usando una división cuidadosa en conjuntos de entrenamiento, validación y prueba, preservando la mezcla de clases de tejido en cada magnificación. Para ayudar al sistema a reconocer regiones escasas pero clínicamente cruciales, aumentan las clases poco representadas rotando parches y exponiendo al modelo a esos tejidos en múltiples niveles de zoom. Esta exposición multirresolución ayuda a la IA a reconocer la misma estructura biológica tanto si aparece como un primer plano nítido como si se presenta como una forma más suave y alejada.

Lo que el modelo logra en comparación con herramientas anteriores

Por sí solos, los modelos SegFormer entrenados por separado en cada magnificación ya superan a diseños convolucionales previos como U-Net en muchas categorías de tejido. Pero cuando se aplica el esquema de aprendizaje incremental—entrenando primero a 10×, luego a 10× más 5×, y finalmente a 10×, 5× y 2× juntos—las mejoras son notables. La precisión global aumenta aproximadamente del 89 % con solo imágenes a 10× a más del 95 % tras incluir las tres magnificaciones. Las medidas de solapamiento entre regiones predichas y reales también mejoran de forma sostenida, y el rendimiento en cánceres como el carcinoma basocelular y el carcinoma espinocelular, así como en capas normales clave como la epidermis y la dermis papilar, supera al de métodos competidores. Es importante destacar que, a medida que se añade cada nuevo nivel de zoom, el modelo no olvida lo aprendido anteriormente; en su lugar, su comprensión de la estructura tisular se vuelve más robusta y general.

Cómo acerca este trabajo el diagnóstico asistido por IA a la clínica

Para quienes no son especialistas, el mensaje principal es que los autores han creado un «cartógrafo» de tejidos cutáneos que puede seguir estudiando nuevos tipos de imágenes sin perder sus habilidades previas. Diseñando con cuidado cómo el modelo aprende por etapas y cómo reutiliza su propio conocimiento pasado, demuestran que es posible construir herramientas de IA que se adapten a medida que evolucionan las prácticas de imagen médica. Aunque se necesita más validación entre hospitales y tipos de enfermedad, este enfoque incremental basado en transformers apunta hacia sistemas de IA que pueden mantenerse actualizados con datos cambiantes, ofrecer explicaciones visuales detalladas sobre dónde se localizan los cánceres y, en última instancia, ayudar a los patólogos a tomar decisiones de tratamiento con más confianza y consistencia.

Cita: Fatima, S., Salam, A.A., Akram, M.U. et al. Incremental learning approach for semantic segmentation of skin histology images. Sci Rep 16, 9593 (2026). https://doi.org/10.1038/s41598-025-31553-6

Palabras clave: cáncer de piel, imágenes de histología, segmentación semántica, aprendizaje incremental, transformers de aprendizaje profundo