Clear Sky Science · es

Conjunto de vídeos de ultrasonido materno-fetal para biometría intraparto de extremo a extremo y aprendizaje multitarea

Por qué importa medir el progreso del parto

Cuando nace un bebé, médicos y comadronas deben evaluar constantemente cómo progresa el parto y si la madre y el niño están seguros. Hoy esas valoraciones dependen en gran medida de la habilidad del profesional para interpretar en tiempo real imágenes de ultrasonido borrosas. Eso requiere años de formación y aún puede ser lento y subjetivo. Este artículo presenta una nueva colección pública de vídeos cortos de ultrasonido tomados durante el trabajo de parto, cuidadosamente etiquetados por expertos, para ayudar a los investigadores a construir sistemas de inteligencia artificial que puedan seguir automáticamente cuánto ha descendido la cabeza del bebé. A largo plazo, estas herramientas podrían apoyar decisiones más seguras y consistentes en las salas de parto de todo el mundo.

Una nueva ventana al parto en tiempo real

Los autores se centran en un tipo específico de exploración llamada ultrasonido intraparto, realizada mientras el parto está en curso. Estas exploraciones son baratas, ampliamente disponibles y tienen el potencial de reducir muertes durante el parto, un periodo en el que ocurre casi la mitad de todas las muertes maternas y neonatales. Las sociedades profesionales han publicado guías detalladas que describen qué vistas capturar y qué mediciones reflejan mejor cómo se desplaza el bebé por el canal de parto. Dos de las más importantes son el ángulo de progresión y la distancia cabeza‑sínfisis, que juntas describen cuánto y con qué rapidez avanza la cabeza fetal. Hasta ahora, sin embargo, no existía un gran conjunto público de vídeos que muestre estas vistas durante el trabajo de parto y las vincule con las mediciones que importan a los médicos.

De vídeos en bruto a datos ricamente etiquetados

Para cerrar esta brecha, el equipo reunió grabaciones de ultrasonido de 774 mujeres en trabajo de parto, todas con un único bebé en posición cefálica a término o más. Las exploraciones proceden de tres hospitales importantes y de tres máquinas de ultrasonido distintas, lo que hace que los datos sean más representativos de la práctica clínica real. Cada clip corto dura unos dos segundos y consta de decenas de fotogramas que muestran la cabeza del bebé y el hueso pélvico de la madre vistos de lado. Los investigadores convirtieron todos los vídeos a un tamaño común, eliminaron cualquier información identificativa como nombres o fechas y estandarizaron las imágenes para que la escala física se preservara entre dispositivos. Esta preparación cuidadosa permite que la colección sirva como un banco de pruebas justo para nuevos programas informáticos.

Cómo los expertos enseñaron al ordenador qué ver

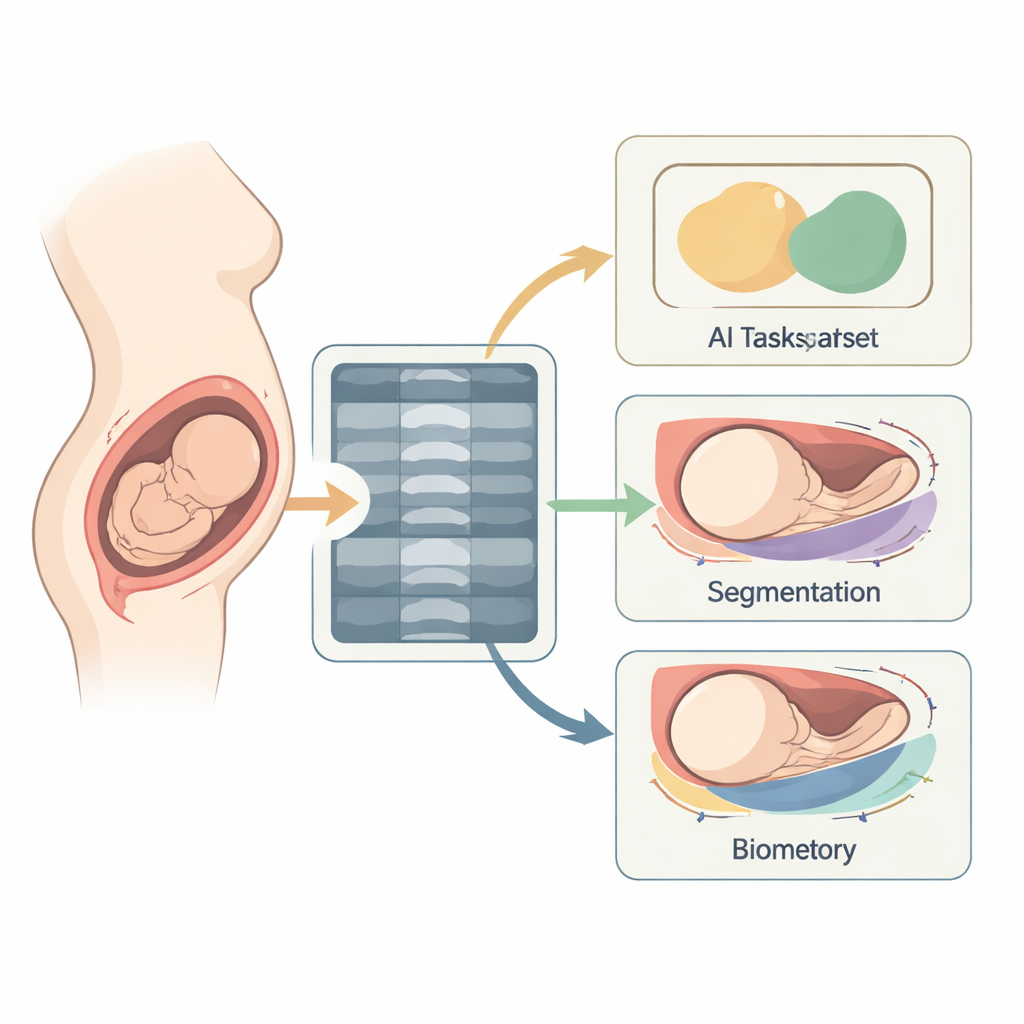

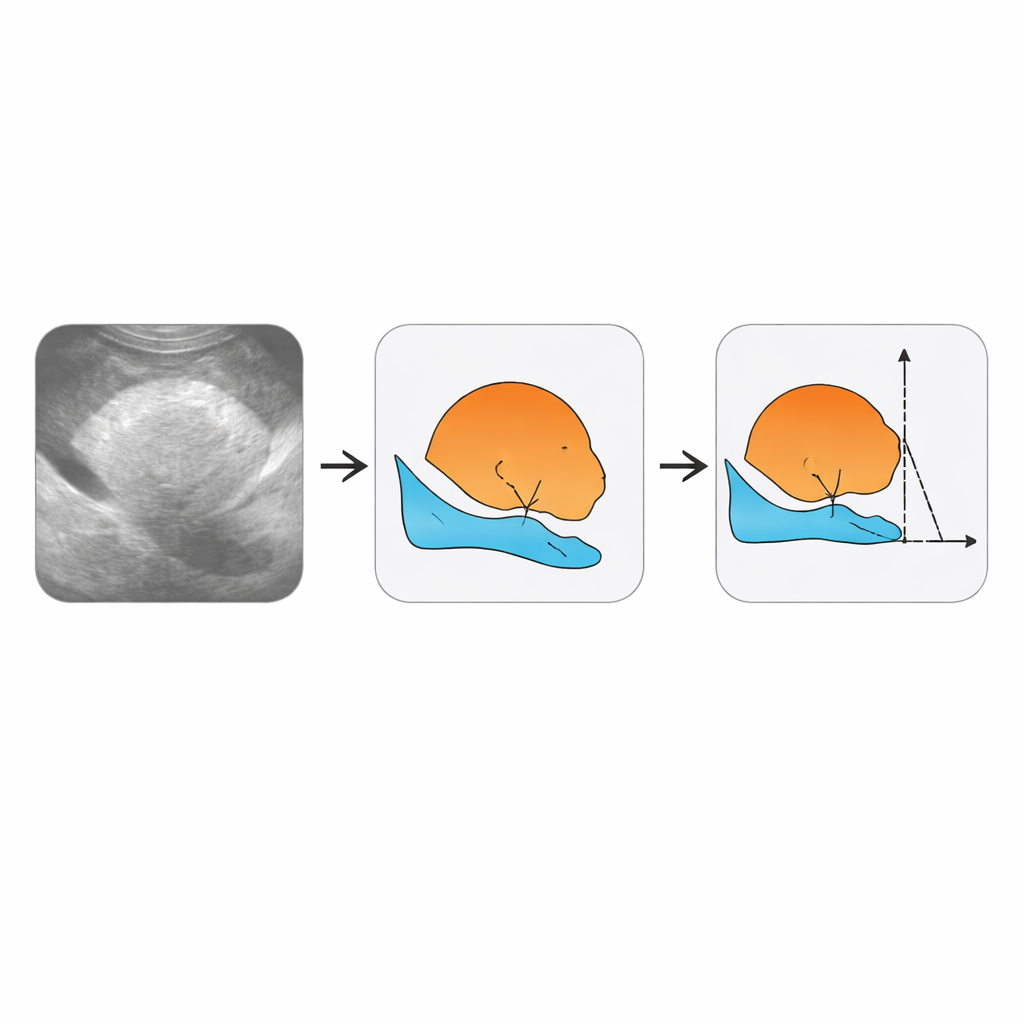

Crear datos de entrenamiento útiles requirió mucho más que guardar archivos de vídeo. Especialistas experimentados en ecografía examinaron los clips cuadro por cuadro. Para fotogramas seleccionados, trazaron el contorno de la cabeza fetal y del hueso púbico materno, creando máscaras coloreadas que muestran dónde se sitúa cada estructura. También señalaron hitos clave a lo largo de esos contornos: cuatro puntos especiales que pueden usarse para reconstruir el ángulo de progresión y la distancia desde el hueso púbico hasta la cabeza del bebé. Además, etiquetaron vídeos enteros según varias preguntas clínicas de sí o no, convirtiendo cada clip en un resumen compacto de lo que debería concluir un sistema automatizado. Los autores organizaron toda esta información en carpetas, tablas y archivos de coordenadas claros para que otros puedan integrarla fácilmente en sus propios algoritmos.

Comprobar que las etiquetas humanas son fiables

Dado que los modelos informáticos sólo pueden ser tan fiables como los ejemplos con los que aprenden, el equipo dedicó un esfuerzo considerable a testar cuán consistentemente distintos expertos etiquetaban los mismos vídeos. Tres anotadores de los hospitales participantes revisaron de forma independiente un conjunto compartido de 150 vídeos. Los investigadores compararon entonces el trabajo de cada persona con un estándar combinado de “consenso”. Para decisiones generales —como si un fotograma mostraba la vista correcta— el acuerdo fue muy alto. Para el trazado del contorno del hueso púbico, la consistencia también fue fuerte. Segmentar la cabeza fetal y derivar medidas exactas de ángulo y distancia resultó más desafiante, reflejando la dificultad inherente de seguir bordes tenues y en sombra en imágenes de ultrasonido ruidosas. Aun así, el nivel de acuerdo fue lo suficientemente bueno como para respaldar el entrenamiento y la evaluación significativos de nuevos métodos.

Un kit de inicio para una monitorización del parto más inteligente

Para ayudar a otros a comenzar, los autores proporcionan un modelo informático de ejemplo que primero resalta la cabeza del bebé y el hueso pélvico de la madre en cada fotograma, y luego usa esas formas para estimar las mediciones clave. Aunque este sistema base está lejos de ser perfecto, muestra cómo el conjunto de datos puede soportar enfoques “de extremo a extremo” que van directamente del vídeo en bruto a cifras clínicamente relevantes. Los autores también discuten limitaciones actuales, como la dificultad de manejar imágenes de calidad especialmente mala y el hecho de que incluso los expertos discrepan en cierta medida sobre dónde termina exactamente la cabeza del bebé. Al poner los vídeos y las etiquetas a disposición gratuita, invitan a la comunidad investigadora a abordar estos retos, con el objetivo último de herramientas más objetivas y accesibles para guiar las decisiones durante el parto.

Cita: Niu, M., Bai, J., Gao, Y. et al. Maternal-Fetal Ultrasouno Video Dataset for End-to-end Intrapartum Biometry and Multi-task Learning. Sci Data 13, 327 (2026). https://doi.org/10.1038/s41597-026-06900-5

Palabras clave: ultrasonido intraparto, monitorización del parto, descenso de la cabeza fetal, IA en imagen médica, conjunto de datos de vídeo clínico