Clear Sky Science · es

Un conjunto de datos de superresolución de vídeo de la ópera tradicional china basado en la fusión de degradación “Real-world+”

Devolver la vida a las antiguas películas de ópera

Muchas grabaciones de ópera tradicional china solo existen en forma de vídeo frágil y de baja calidad. El paso del tiempo, el polvo y las copias repetidas han difuminado rostros, apagado los trajes y llenado las escenas de ruido visual. Este artículo presenta una nueva manera de “limpiar” y agudizar digitalmente esos vídeos, no reparando cada film a mano, sino construyendo una colección de entrenamiento especializada para la inteligencia artificial. El objetivo es ayudar a las máquinas a aprender a convertir metraje borroso y envejecido en imágenes más nítidas y vivas, preservando una parte importante de la memoria cultural mundial.

Por qué los vídeos antiguos de ópera se ven tan mal

La ópera tradicional china, incluidos estilos famosos como la ópera de Pekín y el Kunqu, ha sido reconocida por la UNESCO como parte del patrimonio cultural de la humanidad. Sin embargo, muchos de los vídeos supervivientes de estas actuaciones han pasado por un largo y duro recorrido. Primero, el equipo de filmación original introduce desenfoque y ruido de cámara. Luego, el almacenamiento en película, cinta o discos provoca arañazos, deformaciones y pérdida de datos. Finalmente, las copias repetidas, la compresión para internet y la transmisión en redes inestables añaden artefactos en bloques, parpadeos y pérdida de fotogramas. El resultado no es solo un desenfoque simple, sino una mezcla enmarañada de distintos tipos de daño, lo que dificulta mucho a los métodos de restauración adivinar cómo debía verse la escena original.

Construir pares de fotogramas borrosos y nítidos

Los métodos modernos de “superresolución” de vídeo entrenan a los ordenadores para predecir un fotograma nítido y detallado a partir de uno de baja calidad. Para aprender esta tarea, necesitan muchos ejemplos en los que un fotograma borroso esté perfectamente emparejado con la misma escena en alta calidad. Las colecciones de entrenamiento existentes suelen basarse o bien en daños artificiales simplificados o bien en metraje real que no está alineado con precisión entre las versiones de baja y alta calidad. Los autores crearon un nuevo recurso llamado CTOVSR partiendo de cuatro películas de ópera tradicional que habían sido restauradas profesionalmente desde rollos originales, alcanzando muy alta resolución. A continuación, localizaron versiones en definición estándar de las mismas actuaciones publicadas en línea. Estas copias de menor calidad habían pasado por el proceso de envejecimiento real, por lo que eran ideales como imágenes “antes”.

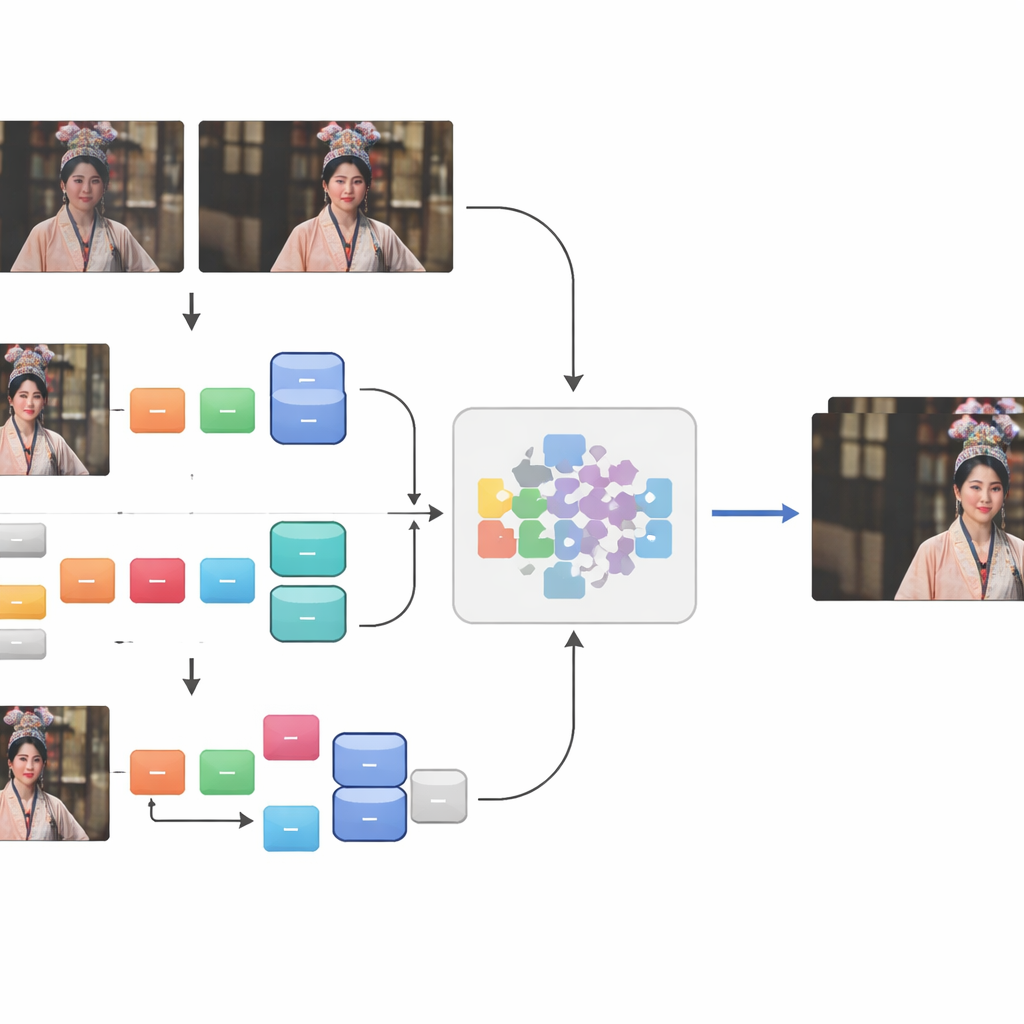

Alinear cada fotograma con cuidado

Emparejar los vídeos restaurados y los envejecidos no fue nada sencillo. Las diferencias en la tasa de fotogramas, los planos perdidos, marcas de agua añadidas, bordes negros y cambios en la relación de aspecto significaban que los métodos automáticos simples no funcionaban. El equipo extrajo segmentos utilizables y luego llevó a cabo una alineación cuidadosa en tres pasos. Primero, emplearon una herramienta personalizada, eye_comparer, para corregir manualmente problemas de sincronización como pérdida de fotogramas, fotogramas fuera de orden y fotogramas “fantasma” en transiciones de escena. A continuación, resolvieron desajustes espaciales superponiendo fotogramas en un software de edición de imágenes, alineando con precisión el contenido y recortando bordes, logotipos y subtítulos mientras conservaban la mayor parte posible de la escena. Finalmente, realizaron una verificación automática usando una medida de similitud, manteniendo solo los pares de fotogramas que eran casi idénticos en estructura. Este proceso produjo 250 pares de secuencias de alta calidad del mundo real, que abarcan cientos de miles de fotogramas.

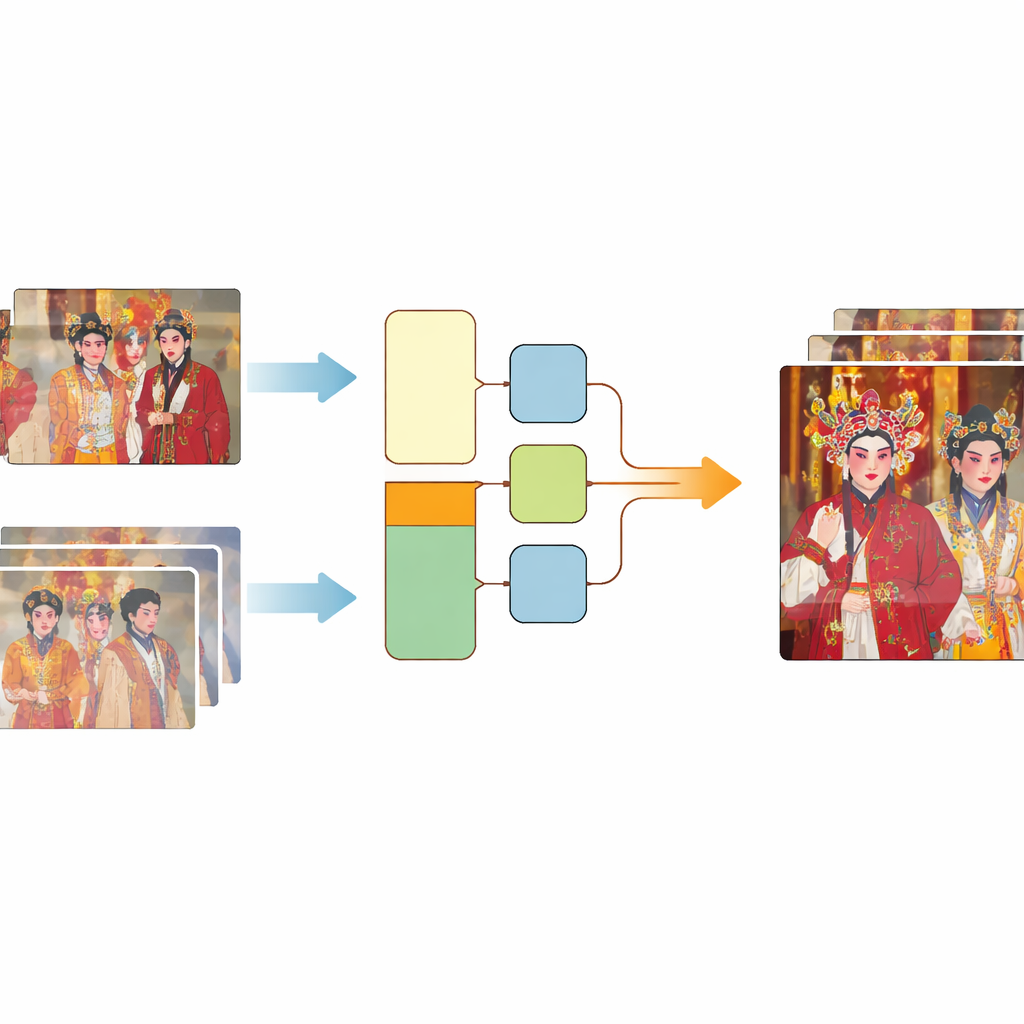

Combinar daños reales con desgaste simulado

Aunque estos pares cuidadosamente alineados capturaban un deterioro real del mundo, seguían siendo insuficientes para cubrir la plena variedad de formas en que el vídeo puede degradarse. Para ampliar el material de entrenamiento, los autores añadieron un segundo ingrediente: daño sintético aplicado a 41 vídeos de ópera adicionales en alta definición. Simularon daños espaciales —como desenfoque y ruido— mediante una cadena de degradación de dos etapas, y daño temporal al comprimir los vídeos con un estándar antiguo muy usado que refleja cómo se codificaron históricamente muchos clips en línea. Al fusionar esta porción sintética con los pares “Real-world+”, ensamblaron el conjunto de datos CTOVSR, que contiene 900 pares de vídeo de baja y alta calidad estrictamente alineados, cada uno de 100 fotogramas de duración y que muestran una amplia gama de óperas, escenas y condiciones de iluminación.

Demostrar el valor de la nueva colección

Para comprobar si CTOVSR realmente ayuda a los ordenadores a restaurar vídeos antiguos, los autores entrenaron varios modelos de superresolución de última generación usando únicamente este conjunto de datos. Compararon los resultados con métodos simples de redimensionado y encontraron que los modelos entrenados producían imágenes mucho más claras, con detalles de vestuario más nítidos, maquillaje facial más legible y menos artefactos visibles. Un estudio de ablación mostró que combinar daños reales y sintéticos era claramente mejor que usar solo uno u otro. Los investigadores también probaron sus modelos entrenados en metraje completamente nuevo: clips envejecidos encontrados en línea e incluso vídeos de actuaciones de otras culturas, como ópera italiana y danza clásica india. Los observadores humanos calificaron las imágenes mejoradas significativamente por encima de las originales o de versiones ampliadas de forma básica, lo que sugiere que los modelos entrenados con CTOVSR pueden generalizar más allá del material específico que contiene.

Salvar el patrimonio mediante datos más inteligentes

En términos sencillos, este trabajo no presenta otro algoritmo de restauración más; en su lugar, ofrece el “material de práctica” meticulosamente preparado que esos algoritmos necesitan para aprender. Al emparejar minuciosamente versiones dañadas y de alta calidad de metraje de ópera tradicional y luego enriquecerlos con desgaste simulado realista, el conjunto de datos CTOVSR da a la inteligencia artificial una mejor comprensión de cómo se degradan los vídeos antiguos y cómo deberían verse cuando se restauran. Este enfoque proporciona una vía práctica no solo para devolver nueva vida visual a la ópera tradicional china, sino también para proteger muchas otras formas de vídeo histórico irreemplazable de desaparecer en el olvido digital.

Cita: Xi, W., Qin, B., Zhang, Y. et al. A Chinese Traditional Opera Video Super-Resolution Dataset Based on the “Real-world+” Degradation Fusion. Sci Data 13, 387 (2026). https://doi.org/10.1038/s41597-026-06776-5

Palabras clave: superresolución de vídeo, preservación del patrimonio digital, ópera tradicional china, restauración de imágenes, conjuntos de datos de vídeo degradado