Clear Sky Science · es

Un conjunto de datos de ecografía mamaria con razonamiento en cadena que cubre todas las categorías histopatológicas

Por qué importa esta investigación

La detección del cáncer de mama recurre cada vez más a la ecografía, especialmente en mujeres jóvenes y en lugares donde la mamografía es menos accesible. Sin embargo, incluso las mejores herramientas de inteligencia artificial (IA) para interpretar estas exploraciones suelen comportarse como cajas negras, dando un veredicto —benigno o maligno— sin mostrar cómo han llegado a él. Este artículo presenta BUS-CoT, un nuevo conjunto de datos de ecografía mamaria de acceso abierto diseñado no solo para ayudar a la IA a detectar el cáncer, sino para enseñarle a “pensar en voz alta” de una forma que refleje cómo los radiólogos expertos razonan en casos complejos.

De exploraciones borrosas a pistas estructuradas

Las imágenes ecográficas son ruidosas y difíciles de interpretar, incluso para especialistas. Los expertos humanos no se limitan a mirar una imagen y saltar a un diagnóstico; buscan una cadena de pistas visuales —si un bulto es ovalado o irregular, si sus bordes son lisos o festoneados, si proyecta sombra, y si pequeñas manchas brillantes sugieren calcificaciones—. Estas pistas se ponderan luego con reglas estandarizadas, como el sistema BI-RADS, para estimar la probabilidad de que una lesión sea cancerosa y decidir si es necesaria una biopsia. Los sistemas de IA existentes suelen omitir este razonamiento paso a paso, yendo directamente de los píxeles a una predicción, lo que hace que sus decisiones sean difíciles de confiar y complicadas de aplicar en casos inusuales o raros.

Una nueva colección rica en casos del mundo real

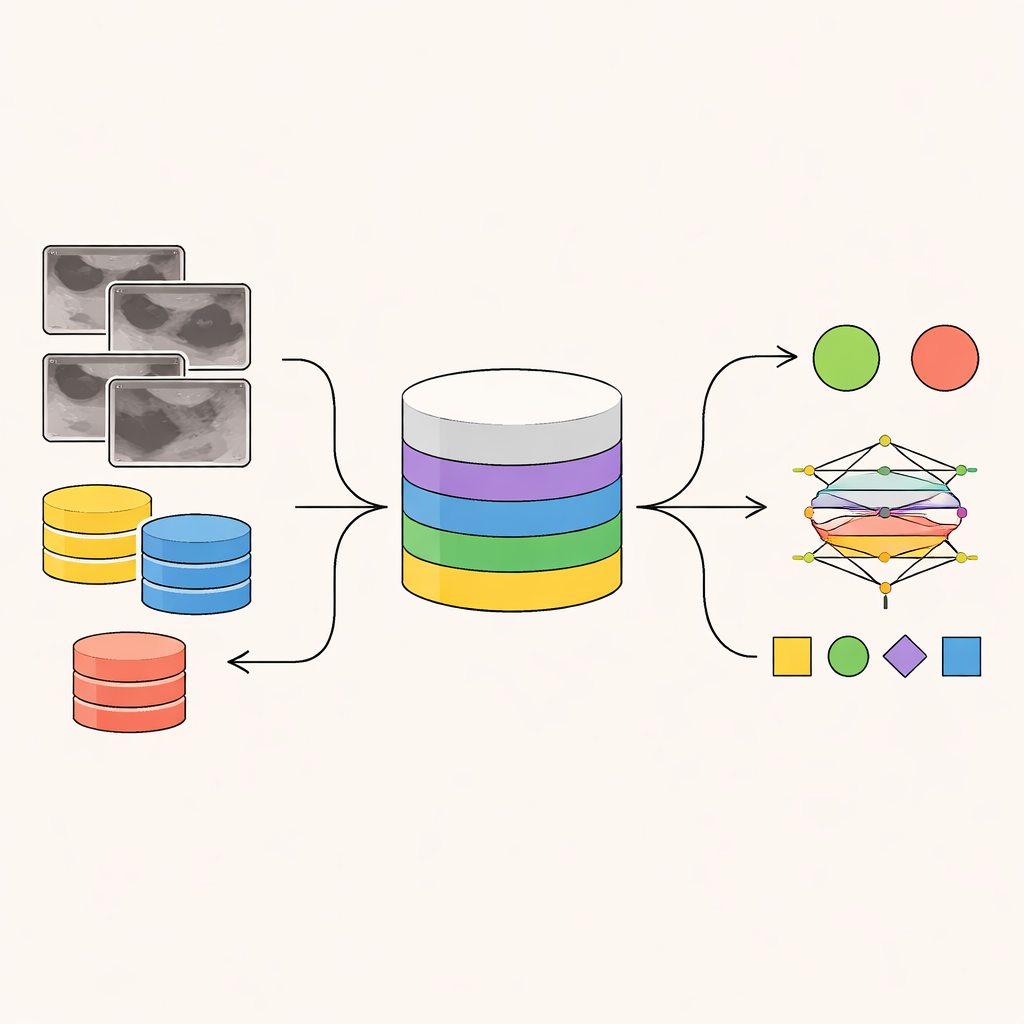

El conjunto de datos BUS-CoT aborda estos problemas reuniendo 11.439 imágenes de ecografía mamaria de 11.850 lesiones en 4.838 pacientes, obtenidas de publicaciones, conjuntos de datos abiertos y repositorios de casos en línea a través de varios continentes y tipos de equipos de ecografía. De manera crucial, la colección abarca las 99 categorías de tejido mamario definidas por la Organización Mundial de la Salud, desde bultos benignos comunes como los fibroadenomas hasta cánceres raros y agresivos. Esta cobertura amplia corrige una debilidad importante de conjuntos de datos anteriores, que tienden a omitir enfermedades raras, dejando a los sistemas de IA poco preparados para precisamente los casos en los que los médicos suelen tener más dificultades.

Enseñar a las máquinas a seguir una traza de razonamiento

Además de las imágenes en bruto, BUS-CoT proporciona múltiples capas de anotación experta. Los radiólogos registran primero observaciones básicas: si hay una masa, si existen calcificaciones y la localización de la lesión. Después anotan características visuales detalladas —forma, márgenes, patrones de eco internos y más— antes de asignar categorías BI-RADS y vincular estos hallazgos de imagen con la patología confirmada por muestras de tejido. Finalmente, convierten esta información estructurada en una cadena de razonamiento narrativa: una breve explicación paso a paso que conecta lo que se ve en la exploración con por qué un diagnóstico concreto es probable. A diferencia de los textos generados automáticamente, estas cadenas de razonamiento están elaboradas y verificadas por especialistas experimentados en imagen mamaria, preservando la lógica clínica real de la que los modelos pueden aprender.

Poner el conjunto de datos a prueba

Para demostrar el potencial de este recurso, los autores entrenaron una variedad de modelos modernos de imagen y de visión–lenguaje con BUS-CoT, centrándose en un subconjunto curado de alta calidad de 5.163 imágenes centradas en lesiones. Las redes de imagen tradicionales aprendieron a clasificar las lesiones como benignas o malignas, mientras que un avanzado modelo de visión–lenguaje se entrenó para ver la imagen y generar una cadena de razonamiento antes de ofrecer su respuesta. Cuando se obligó al modelo a razonar de esta manera estructurada, su precisión mejoró, especialmente en casos ambiguos donde las lesiones benignas y malignas se parecen. En otras palabras, guiar al modelo para que “recorra” las mismas pistas visuales que los radiólogos utiliza les ayudó a tomar decisiones mejores y más seguras.

Cómo este trabajo puede moldear la atención futura

Para pacientes y clínicos, la promesa de BUS-CoT reside en herramientas de IA que no solo igualen la precisión humana sino que además se expliquen de forma clínicamente significativa. Al emparejar miles de imágenes ecográficas con razonamientos cuidadosamente documentados y cubrir todo el espectro de diagnósticos de tejido mamario —incluso los raros—, este conjunto de datos sienta las bases para sistemas de IA capaces de manejar casos difíciles y justificar sus recomendaciones. Aunque todavía no incluye información clínica más amplia, como genética o antecedentes médicos, BUS-CoT supone un paso importante hacia diagnósticos por ecografía más transparentes y confiables, donde las máquinas actúen menos como oráculos misteriosos y más como colegas junior diligentes cuyos procesos de pensamiento pueden ser inspeccionados y perfeccionados.

Cita: Yu, H., Li, Y., Niu, Z. et al. A Chain-of-thought Reasoning Breast Ultrasound Dataset Covering All Histopathology Categories. Sci Data 13, 370 (2026). https://doi.org/10.1038/s41597-026-06702-9

Palabras clave: ecografía mamaria, IA en imagen médica, IA explicable, diagnóstico del cáncer de mama, conjuntos de datos clínicos