Clear Sky Science · es

Un conjunto de preguntas de ciencias para primaria en chino para la generación del proceso de resolución de problemas

Ayudar a los niños a aprender ciencias con IA más inteligente

Padres y docentes ven cada vez más la inteligencia artificial como un posible compañero de estudio, pero los chatbots actuales a menudo ofrecen explicaciones que son demasiado superficiales o demasiados avanzadas para los niños. Este artículo presenta un nuevo conjunto de datos de Preguntas de Ciencias para Primaria en Chino (CSQ) diseñado para enseñar a los modelos de lenguaje a explicar la ciencia como lo haría un buen maestro de primaria: paso a paso, con la dificultad adecuada y estrechamente alineado con lo que los niños aprenden en clase.

Un nuevo banco de preguntas para jóvenes estudiantes de ciencias

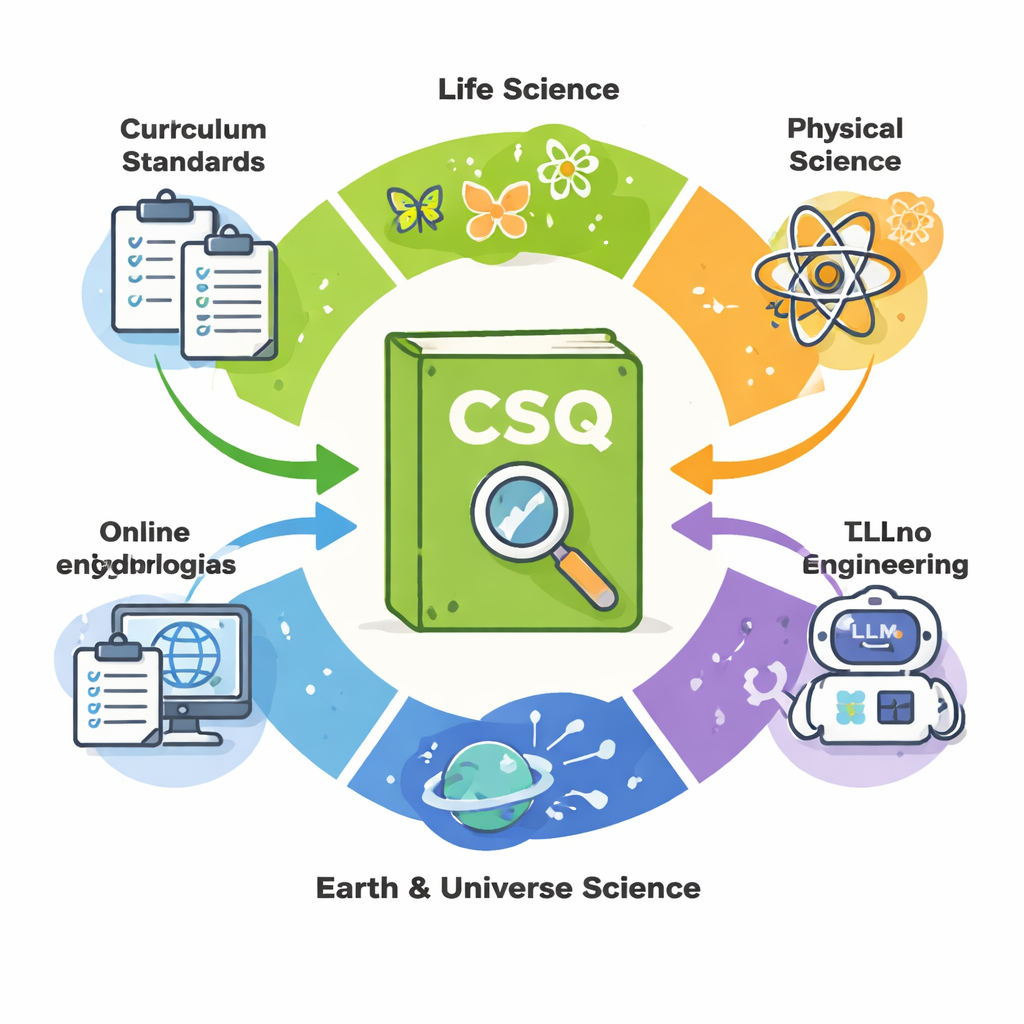

El conjunto CSQ es una recopilación de 12.000 preguntas de ciencias cuidadosamente elaboradas, extraídas del currículo de la escuela primaria china, exámenes escolares y recursos en línea fiables. Las preguntas abarcan cuatro grandes áreas: ciencias de la vida, ciencias físicas, tierra y espacio, y tecnología e ingeniería, para los cursos de 1.º a 6.º grado. A diferencia de muchos bancos de preguntas que solo enumeran una cuestión y su respuesta correcta, cada ítem del CSQ incluye también información sobre el nivel de curso, el tema y qué habilidades científicas se evalúan, además de una explicación completa de la solución adecuada a la edad.

Captar cómo piensan realmente los niños

Una innovación clave del CSQ es su enfoque en el “proceso de pensamiento para resolver el problema” detrás de cada respuesta. Para cada pregunta, los expertos detallan el proceso de razonamiento en un lenguaje y con un nivel de detalle adecuados al grado objetivo. Para los niños más pequeños, las explicaciones se mantienen concretas y basadas en la observación —por ejemplo, describiendo lo que se puede ver o sentir—. Para los alumnos mayores, se introducen gradualmente ideas más abstractas, como sistemas, causa y efecto o modelos simples. Cada ítem también etiqueta las habilidades centrales implicadas, como observar un fenómeno, comparar dos objetos o identificar la función de una herramienta. Esta estructura permite que los modelos de IA no solo den la respuesta correcta, sino que practiquen el tipo de pensamiento que se espera que los alumnos aprendan.

Construir el conjunto de datos con realismo de aula en mente

La creación del CSQ requirió un proceso estructurado y centrado en las personas. Un equipo de 19 investigadores con experiencia en educación científica e IA dividió el trabajo en etapas. Los miembros sénior del equipo recopilaron preguntas de los estándares oficiales del currículo, de exámenes y de enciclopedias, asegurándose de que fueran reutilizables legalmente. Luego, estudiantes de posgrado adaptaron y anotaron las preguntas para que encajaran en formatos de opción múltiple o verdadero/falso y coincidieran con los Estándares del Currículo de Ciencias para la Educación Obligatoria (2022). Su formación enfatizó ceñirse al vocabulario y la profundidad cognitiva apropiados para cada grado. Cada elemento de datos —pregunta, propiedades disciplinarias y solución— fue verificado por otro anotador, y las discrepancias sobre las habilidades correctas o la profundidad de la explicación se resolvieron usando los estándares nacionales como guía.

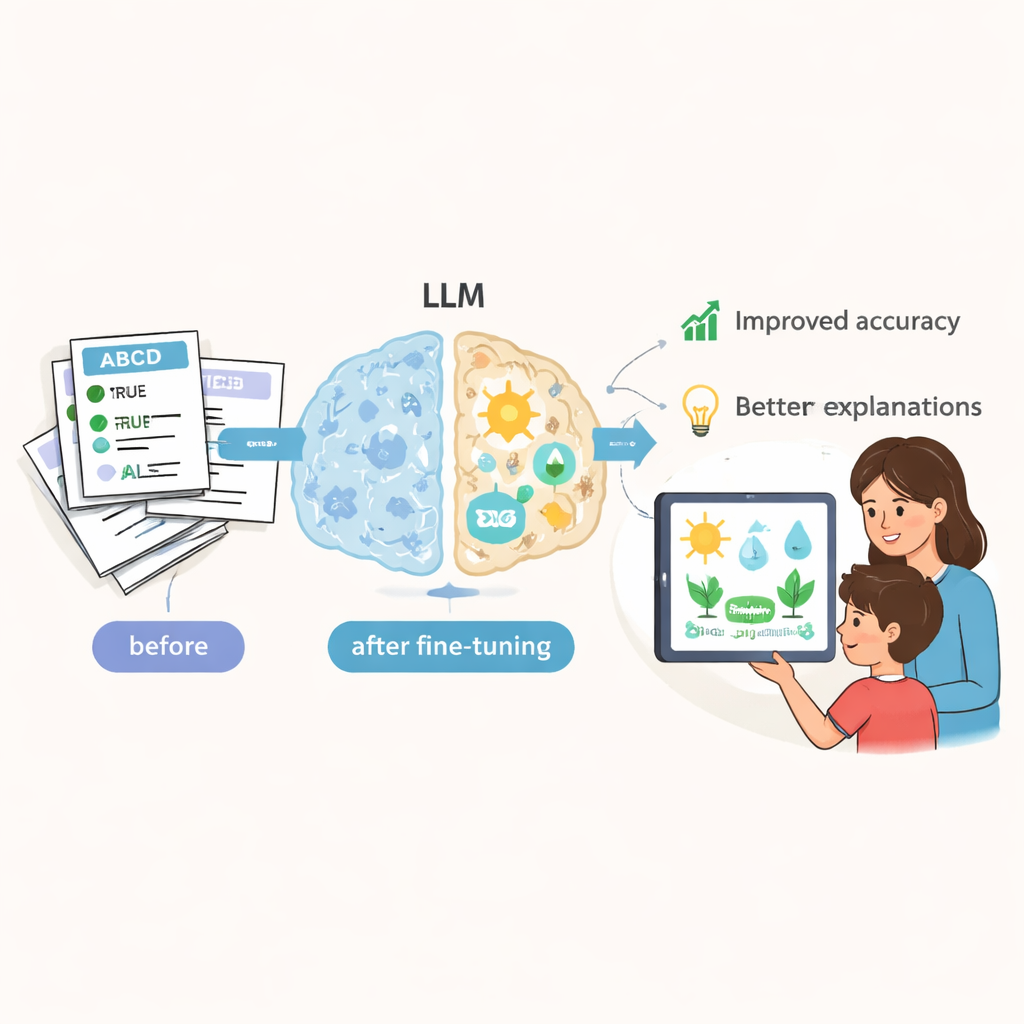

Enseñar a la IA a mostrar su proceso

Para evaluar el valor del CSQ, los investigadores afinieron varios modelos de lenguaje de código abierto y también evaluaron un modelo comercial líder con este conjunto de datos. No solo midieron si los modelos elegían la respuesta correcta en opción múltiple; también evaluaron la calidad del razonamiento generado mediante métricas automáticas de texto y valoraciones humanas de expertos. Tras el entrenamiento con CSQ, los modelos de código abierto mostraron mejoras claras en precisión y en la claridad y completitud de sus explicaciones. Por ejemplo, un modelo que antes respondía a una pregunta elemental sobre el sonido usando teoría avanzada de ondas pasó a una descripción más simple y adecuada a la edad tras el ajuste fino. Los evaluadores humanos observaron que los modelos afinados eran mucho mejores a la hora de mantenerse dentro del nivel de curso del niño, evitando el “exceso de conocimiento” en el que ideas demasiado técnicas confunden en lugar de ayudar.

Límites hoy, modelo para mañana

Los autores reconocen que el CSQ refleja la estructura del currículo de ciencias de China y se centra solo en formatos de pregunta como opción múltiple y verdadero/falso, no en experimentos prácticos ni proyectos abiertos. Las explicaciones fueron redactadas por estudiantes de posgrado capacitados, no por docentes de aula ni por los propios niños, por lo que queda trabajo por hacer para igualar plenamente el lenguaje real del aula. Aun así, el marco detrás del CSQ —vincular cada pregunta con la asignatura, el tema, el grado, habilidades específicas y el razonamiento paso a paso— es lo bastante general como para inspirar recursos similares para otros idiomas y sistemas escolares. En términos simples, este trabajo muestra cómo conjuntos de preguntas diseñados con cuidado pueden ayudar a que la IA se convierta en un tutor de ciencias más fiable y sensible a la edad para los jóvenes aprendices.

Cita: Li, D., Liu, Z., Wen, C. et al. A Chinese Elementary Science Question Dataset in Problem-Solving Process Generation. Sci Data 13, 291 (2026). https://doi.org/10.1038/s41597-026-06618-4

Palabras clave: educación científica primaria, modelos de lenguaje a gran escala, conjunto de datos de preguntas y respuestas, tutoría personalizada, currículo chino