Clear Sky Science · es

CNeuroMod-THINGS, un conjunto de datos de fMRI muestreado densamente para la neurociencia visual

Por qué mirar imágenes puede revelar cómo funciona nuestra mente

Cada día, nuestros ojos captan miles de imágenes —desde tazas de café y teléfonos inteligentes hasta perros, árboles y calles concurridas—. Detrás de escena, nuestro cerebro reconoce rápidamente lo que vemos y con frecuencia lo recuerda más tarde. El proyecto CNeuroMod-THINGS se propuso capturar esta actividad oculta con un detalle extraordinario, creando uno de los conjuntos de datos cerebrales más cuidadosamente medidos jamás recogidos mientras las personas observan imágenes del mundo real. Este recurso está pensado para impulsar la próxima generación de investigaciones sobre el cerebro y la inteligencia artificial.

Construir una biblioteca rica de respuestas cerebrales

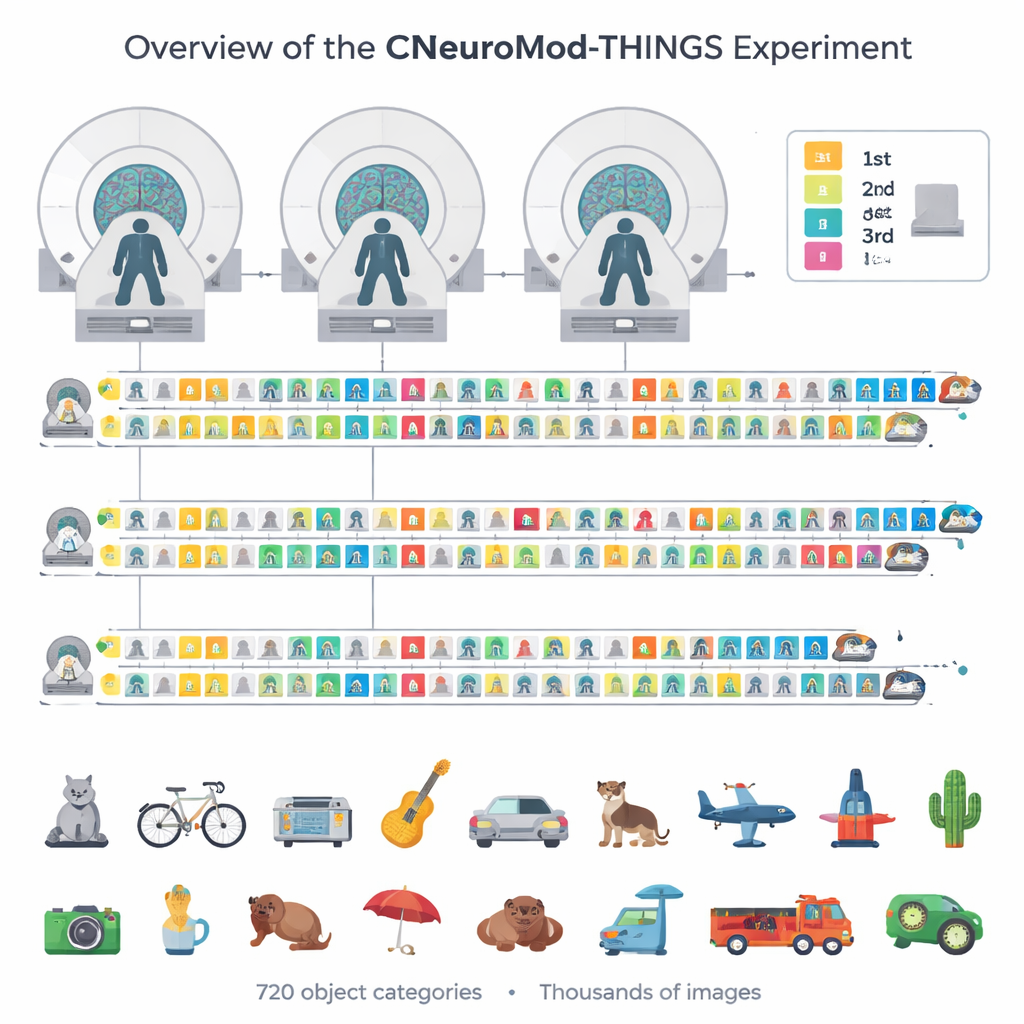

En lugar de escanear a cientos de voluntarios una o dos veces, el equipo escaneó repetidamente a solo cuatro participantes muy comprometidos. Cada persona volvió entre 33 y 36 visitas, sumando alrededor de 200 horas de imágenes cerebrales en el proyecto más amplio CNeuroMod y decenas de horas dedicadas únicamente a las imágenes. Durante estas sesiones, los voluntarios vieron hasta 4.320 fotografías distintas extraídas de la colección de imágenes THINGS, que abarca 720 categorías de objetos cotidianos como herramientas, animales, vehículos y muebles. Esta cuidadosa selección de imágenes asegura que estén representadas muchas facetas de nuestro mundo visual, no solo unos pocos objetos populares.

Un juego de memoria dentro del escáner de resonancia

Para mantener a los participantes involucrados y sondear la memoria, los investigadores convirtieron la visualización de imágenes en un juego continuo de reconocimiento. En cada ensayo, una sola imagen aparecía en el centro de la pantalla mientras la persona yacía en el escáner de resonancia. Usando un controlador personalizado con estilo de videojuego, los participantes informaban si creían que la imagen era nueva o ya la habían visto antes, y cuán seguros estaban de ese juicio. La mayoría de las imágenes se mostraron tres veces: una en el primer encuentro, otra unos minutos después durante la misma visita y una más en una visita posterior, a menudo con aproximadamente una semana de diferencia. Este diseño permitió al equipo comparar la memoria a corto y a más largo plazo para exactamente las mismas imágenes mientras se seguían los cambios correspondientes en la actividad cerebral.

Capturar señales detalladas de visión y memoria

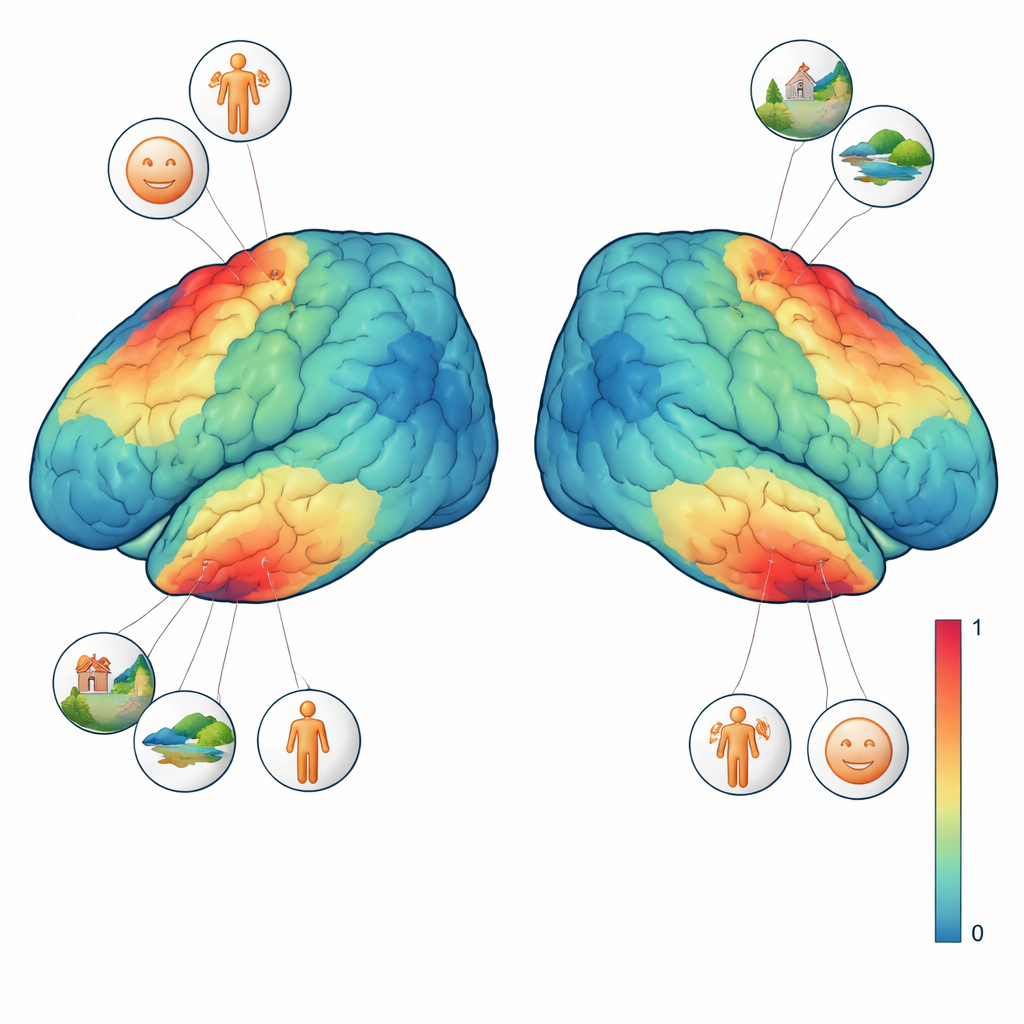

El conjunto de datos va mucho más allá de medidas simples de “encendido/apagado” de la actividad cerebral. Los autores emplearon métodos avanzados de análisis para estimar una respuesta separada para cada ensayo y cada imagen en cada pequeño píxel tridimensional del escaneo cerebral. También registraron dónde miraban las personas mediante cámaras de seguimiento ocular, monitorizaron la respiración y la frecuencia cardíaca, y midieron el movimiento de la cabeza. Los controles de calidad muestran que las señales son notablemente estables: los participantes respondieron en casi todos los ensayos, mantuvieron la mirada cerca del centro de la pantalla y se movieron muy poco. En áreas visuales clave —regiones conocidas por responder con fuerza a caras, cuerpos o escenas— la misma imagen produjo patrones de actividad altamente consistentes cada vez que aparecía. Estos patrones fueron lo bastante fuertes como para que, cuando las respuestas se trazaron en un mapa simplificado bidimensional, las imágenes con significados similares (por ejemplo, animales o vehículos) tendieran a agruparse.

Mapear qué les importa a distintas regiones cerebrales

Para interpretar mejor estas señales, tres de los cuatro participantes completaron pruebas visuales adicionales. En una, formas en barrido se movían sobre un fondo texturizado para revelar qué parte del campo visual “ve” cada región cerebral. En otra, se mostraron bloques cortos de caras, lugares, partes del cuerpo, personajes y objetos genéricos para identificar regiones que prefieren un tipo de imagen sobre otros. Combinando estas tareas localizadoras con el experimento principal, el equipo pudo plantear preguntas precisas como: ¿responde más un solo vóxel cuando hay una cara presente o cuando se ve toda la escena? Encontraron que las regiones selectivas para caras respondían con mayor intensidad cada vez que aparecía cualquier tipo de cara, mientras que una región selectiva para escenas prefería imágenes con fondos ricos como habitaciones, calles o paisajes, incluso cuando no había personas visibles. Estas preferencias de alto detalle emergieron al nivel de imágenes individuales e incluso de vóxeles únicos.

Una base para modelos más inteligentes de la visión

En su núcleo, CNeuroMod-THINGS es un recurso público cuidadosamente curado más que un resultado aislado. Todos los datos cerebrales, el seguimiento ocular, las respuestas conductuales, las anotaciones de las imágenes y el código de análisis se comparten libremente bajo una licencia abierta. Dado que las mismas cuatro personas fueron escaneadas en muchas otras tareas —ver películas, jugar a videojuegos, escuchar historias— los investigadores pueden ahora construir modelos detallados específicos por persona que vinculen experimentos controlados con experiencias más naturales. Para los no especialistas, la conclusión es que ahora disponemos de una “tabla de consulta” de alta resolución que muestra cómo responde un cerebro humano real a miles de imágenes cotidianas. Esto ayudará a los científicos a poner a prueba ideas sobre la percepción visual y la memoria y orientará el diseño de sistemas de visión artificial que perciban el mundo un poco más como nosotros.

Cita: St-Laurent, M., Pinsard, B., Contier, O. et al. CNeuroMod-THINGS, a densely-sampled fMRI dataset for visual neuroscience. Sci Data 13, 141 (2026). https://doi.org/10.1038/s41597-026-06591-y

Palabras clave: fMRI, percepción visual, reconocimiento de objetos, datos cerebrales, memoria