Clear Sky Science · es

Un sensor de imagen coherente 4D a gran escala

Ver el mundo en cuatro dimensiones

Coches autónomos, drones de reparto y cascos de realidad aumentada dependen de máquinas que comprendan en tiempo real el mundo 3D que las rodea. Hoy en día, ese tipo de visión suele ser voluminosa, cara o exigir mucha energía. Este artículo informa de un avance importante hacia una “cámara 4D”: un sensor del tamaño de un chip que no solo cartografía la forma de una escena en 3D, sino que además mide cómo se mueven las cosas, lo que podría llevar la visión compacta a robots, teléfonos inteligentes y otros dispositivos.

De fotos planas a mapas vivos

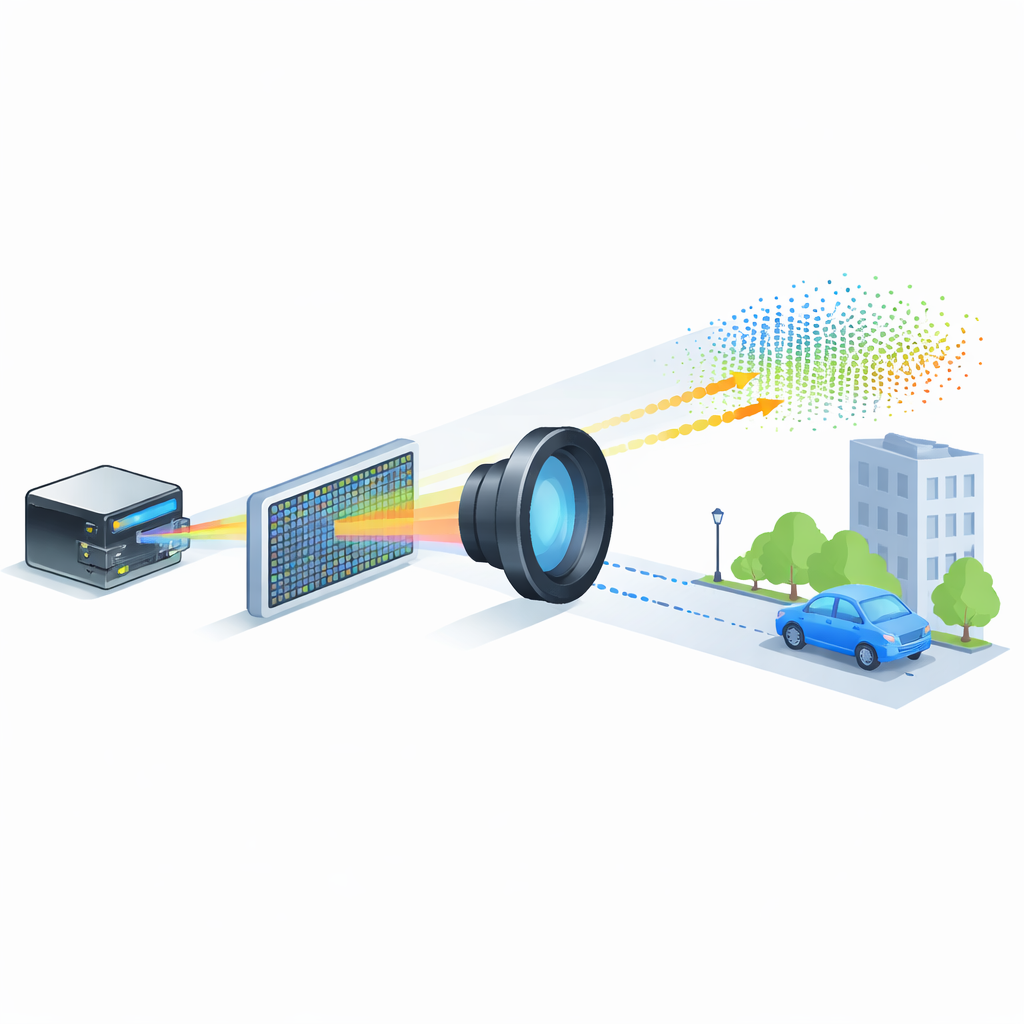

Las cámaras convencionales capturan la intensidad de la luz en una superficie plana, produciendo imágenes 2D hermosas pero sin información directa sobre la distancia. En cambio, los sistemas de detección y medición por luz (LiDAR) emiten pulsos láser y miden el tiempo que tardan en volver, construyendo un mapa 3D del entorno. Los enfoques existentes pueden ver a gran distancia y con alto detalle, pero tienden a requerir piezas móviles, ópticas grandes o mucha energía por punto medido. Eso dificulta crear algo tan pequeño, barato y robusto como la cámara de un teléfono, pero capaz de escanear con seguridad calles, instalaciones industriales o habitaciones concurridas con gran detalle.

Un chip que mide distancia y movimiento

Los investigadores presentan un nuevo tipo de matriz focal LiDAR — esencialmente una versión LiDAR del chip de imagen dentro de una cámara digital. Su dispositivo contiene 352 por 176 píxeles, para un total de más de 60 000 puntos de detección, todos construidos en un único chip de fotónica de silicio junto con su electrónica de control. En lugar de usar pulsos láser cortos, el sistema se basa en luz continua modulada en frecuencia (FMCW), en la que el color del láser se barre en un “chirp” controlado. Cuando la luz rebota en los objetos y regresa al chip, se combina coherentemente con un haz de referencia. Pequeñas diferencias de frecuencia revelan tanto la distancia de cada punto como la rapidez con la que se mueve hacia o desde el sensor, añadiendo la velocidad como una cuarta dimensión medida.

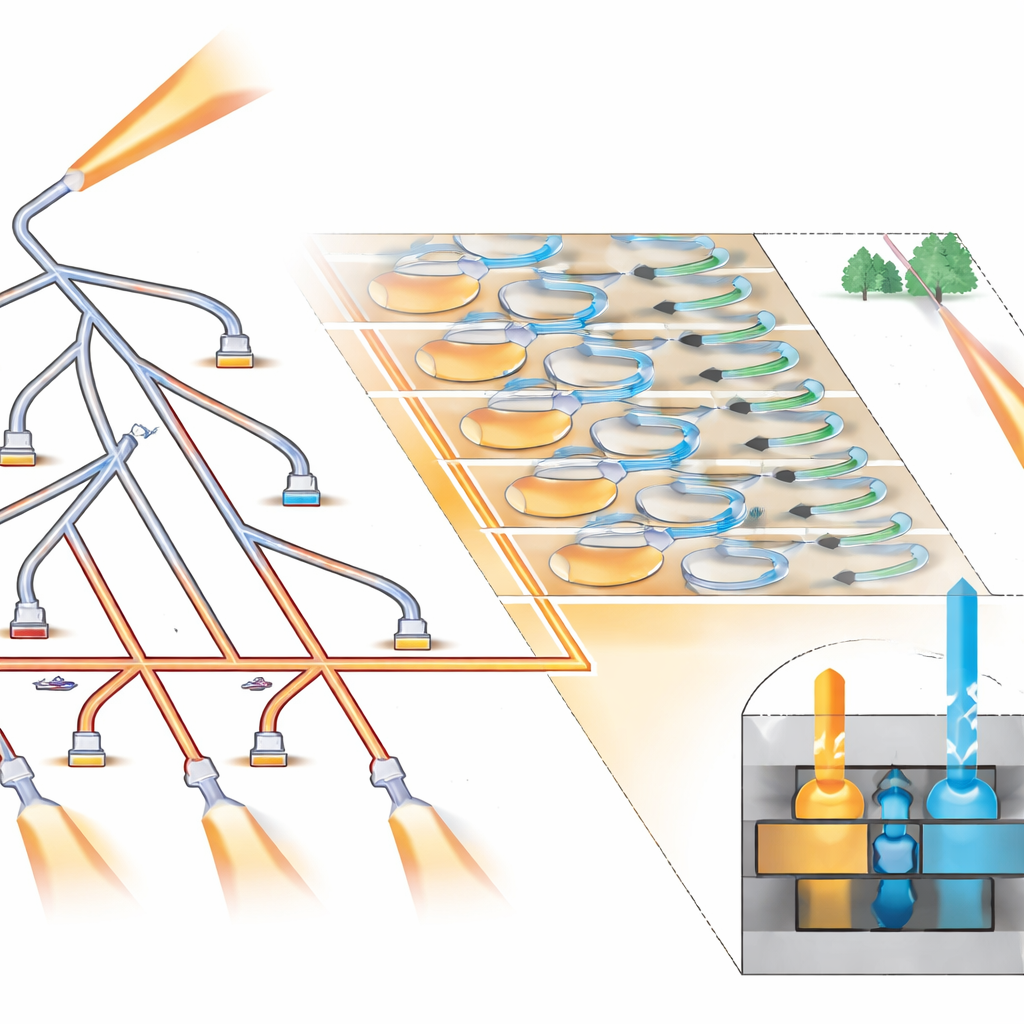

Cómo funciona la pequeña cuadrícula de luz

Para cubrir muchos píxeles sin desperdiciar energía, el chip enruta la luz chirpada a través de un árbol de conmutadores ópticos en miniatura, guiándola de forma secuencial a grupos de ocho píxeles vecinos. Dentro de cada grupo, la luz se divide de manera uniforme para que los ocho actúen simultáneamente como emisores y receptores. Cada píxel utiliza un par de acopladores de rejilla para enviar y recoger la luz, además de un par de fotodetectores balanceados y un amplificador en el píxel para extraer la señal de batido que codifica la distancia y la velocidad. Microlentes diseñadas específicamente y depositadas directamente sobre el chip ayudan a canalizar más luz dentro y fuera, mejorando la eficiencia. Debido a que la misma apertura envía y recibe luz (diseño "monostático"), el sistema evita acoplamientos indeseados entre píxeles y necesita solo una lente externa de imagen, muy parecido a una cámara convencional.

Poniendo a prueba la cámara 4D

Usando lentes de infrarrojo de onda corta disponibles comercialmente, el equipo construyó un módulo parecido a una cámara alrededor del chip y capturó nubes de puntos 3D detalladas de escenas interiores y exteriores. Con una lente, el sensor logró un campo de visión de aproximadamente 33 por 19 grados y una resolución angular de hasta 0,06 grados —suficiente para distinguir muebles en una oficina y detalles arquitectónicos en edificios a decenas de metros—. El sistema midió objetos desde 4 hasta 65 metros usando solo decenas de nanojulios de energía óptica por punto y una potencia promedio sobre el objetivo de alrededor de 178 microwatios por píxel, manteniéndose dentro de los estrictos límites de seguridad ocular. También siguió el movimiento: en un experimento midió la velocidad radial cambiante de un disco giratorio con precisión de milímetros por segundo.

Rendimiento, límites y crecimiento futuro

Mediciones cuidadosas muestran que el rendimiento del sensor se aproxima a los límites físicos fundamentales impuestos por la naturaleza cuántica de la luz, aunque aún no los alcanza por completo. Hoy, la limitación principal es el ruido electrónico de los amplificadores en cada píxel, que reduce ligeramente la relación señal‑ruido en comparación con un detector ideal limitado únicamente por fotones. Los autores describen modificaciones de diseño directas —principalmente aumentar el nivel de luz de referencia interna y refinar el diseño óptico, potencialmente usando mezclas de silicio y nitruro de silicio— que podrían llevar el sistema a un régimen verdaderamente limitado por ruido de disparo y aumentar el alcance utilizable más allá de 200 metros. Mover algunos conmutadores fuera de la matriz de píxeles también eliminaría pequeñas lagunas en la cobertura de campo lejano, produciendo nubes de puntos más limpias.

Hacia la visión 4D cotidiana

Este trabajo demuestra un sensor de imagen 4D compacto e íntegramente integrado que iguala el recuento de píxeles y los rangos exigidos por muchas aplicaciones reales, manteniendo bajo control la potencia y el tamaño. Al reunir emisores de luz, receptores, direccionamiento del haz y electrónica de control en un único chip de silicio, el dispositivo desempeña un papel similar para la detección 3D y de movimiento al que cumplió el sensor CMOS en la fotografía digital. Con más refinamientos, sensores así podrían volverse lo bastante baratos y robustos como para incorporarse en coches, robots, teléfonos y cascos, proporcionando a las máquinas una comprensión precisa y en tiempo real del mundo 3D y de cómo cambia de un momento a otro.

Cita: Settembrini, F.F., Gungor, A.C., Forrer, A. et al. A large-scale coherent 4D imaging sensor. Nature 651, 364–370 (2026). https://doi.org/10.1038/s41586-026-10183-6

Palabras clave: LiDAR, imagen 4D, fotónica de silicio, sistemas autónomos, detección de profundidad