Clear Sky Science · es

Sintetizando la literatura científica con modelos de lenguaje aumentados por recuperación

Por qué es tan difícil mantenerse al día con la ciencia

Cada año aparecen en línea millones de nuevos artículos científicos. Ningún investigador humano puede leerlos todos, y sin embargo tratamientos médicos importantes, hallazgos climáticos y avances tecnológicos pueden estar ocultos en ese torrente de información. Este artículo explora si los sistemas avanzados de IA pueden ayudar a los científicos a rastrear este océano de estudios y convertirlos en resúmenes claros y fiables—sin inventar información.

Un nuevo tipo de asistente de investigación

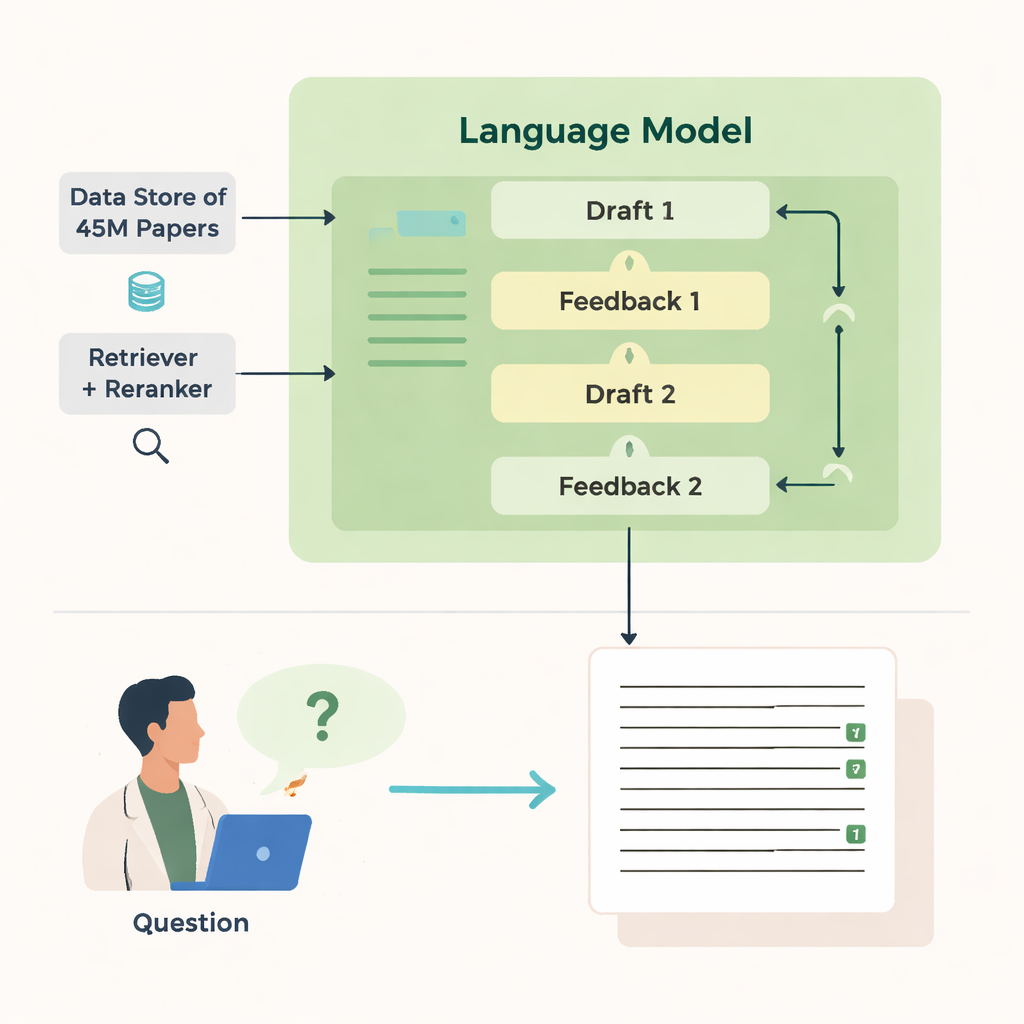

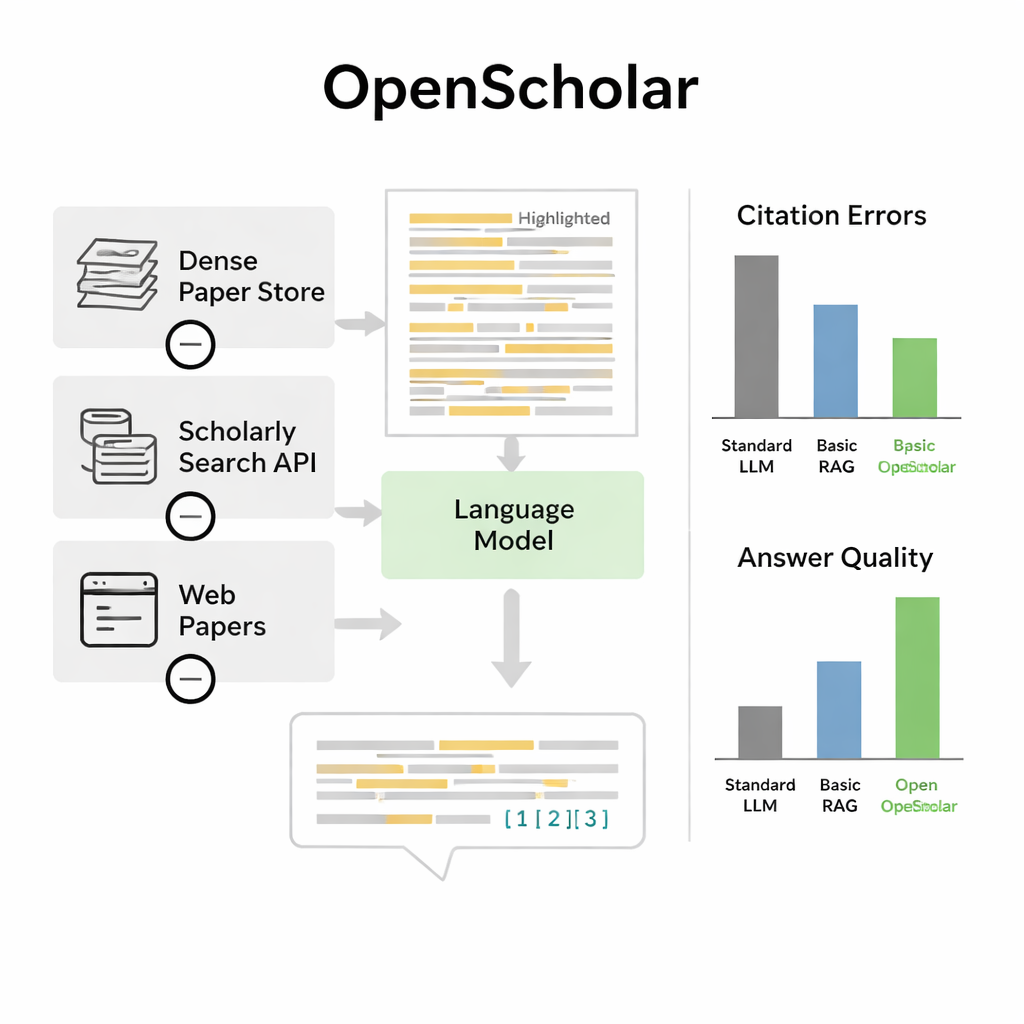

Los autores presentan OpenScholar, un sistema de inteligencia artificial diseñado específicamente para leer y sintetizar la literatura científica. A diferencia de los chatbots generales, OpenScholar está estrechamente conectado a una enorme base de datos abierta de alrededor de 45 millones de artículos de investigación, llamada OpenScholar DataStore. Cuando un científico plantea una pregunta—por ejemplo, cómo enfriar nanopartículas levitadas o qué métodos funcionan mejor para imagen cerebral—el sistema primero busca en esta base de datos pasajes relevantes y luego redacta una respuesta con citas en el texto, al modo de un artículo de revisión escrito por humanos. Repite este proceso varias veces, criticando y refinando sus propios borradores para mejorar la claridad, la integridad y la calidad de las citas.

Cómo busca y escribe

La potencia de OpenScholar proviene de varios componentes coordinados. Un módulo “recuperador” examina incrustaciones de texto precomputadas de millones de artículos para encontrar fragmentos prometedores, mientras que un “reordenador” vuelve a ordenar esos fragmentos para centrarse en los más relevantes. El modelo de lenguaje usa entonces esta evidencia para producir una respuesta extensa con referencias numeradas. Tras el primer borrador, el modelo genera retroalimentación para sí mismo—señalando perspectivas faltantes, estructura débil o evidencia escasa—y, cuando es necesario, activa búsquedas más focalizadas. Luego reescribe la respuesta, integrando nuevos artículos y ajustando las citas. Una verificación final asegura que las afirmaciones que requieren respaldo estén apoyadas por al menos una fuente recuperada.

Poner a prueba las afirmaciones y las citas

Para comprobar si OpenScholar realmente ayuda, los autores crearon ScholarQABench, un gran banco de pruebas diseñado para imitar preguntas reales de revisión de literatura. Incluye cerca de 3.000 preguntas redactadas por expertos y cientos de respuestas largas en informática, física, neurociencia y biomedicina. Es importante: estas preguntas suelen requerir la lectura de varios artículos, no solo de un resumen. El equipo evaluó los sistemas en múltiples ejes: corrección factual, cobertura de puntos clave, claridad de la redacción y precisión de las citas respecto a los artículos subyacentes. Combinaron comprobaciones automáticas con valoraciones detalladas de expertos con nivel de doctorado que compararon las respuestas generadas por la IA con las redactadas por humanos.

Superando a chatbots potentes y equiparándose a expertos

En este banco de pruebas, OpenScholar superó tanto a los modelos de lenguaje estándar como a herramientas anteriores que simplemente añadían recuperación a un chatbot general. Una versión compacta de ocho mil millones de parámetros, entrenada íntegramente con datos abiertos, rindió mejor en una exigente tarea de síntesis de múltiples artículos que GPT-4o y un sistema competidor llamado PaperQA2, a pesar de que estos últimos se basaban en modelos propietarios más grandes. Un hallazgo llamativo fue la frecuencia con que los chatbots ordinarios alucinaban referencias: en el 78–90 por ciento de los casos, sus listas de citas incluían artículos que no existían o que no respaldaban las afirmaciones. En contraste, la precisión de las citas de OpenScholar rivalizó con la de expertos humanos. Cuando los expertos compararon las respuestas directamente, prefirieron OpenScholar-8B frente a respuestas escritas por expertos aproximadamente la mitad de las veces, y una canalización OpenScholar construida sobre GPT-4o en torno al 70 por ciento de las veces, en gran parte porque la IA cubría más estudios relevantes y los organizaba de forma clara.

Límites y mejoras futuras

A pesar de estos avances, los autores subrayan que OpenScholar no sustituye a los científicos. El sistema aún puede pasar por alto los artículos más representativos, sobreenfatizar trabajos menos importantes o introducir inexactitudes factuales, especialmente en modelos más compactos. El propio banco de pruebas también tiene limitaciones: se centra principalmente en informática, biomedicina y física, y las preguntas cuidadosamente anotadas siguen siendo relativamente pocas porque el tiempo de los expertos es caro. Las evaluaciones además luchan por capturar plenamente cualidades más sutiles, como si las citas destacan trabajos realmente seminales o si una respuesta guiaría de verdad un nuevo experimento.

Qué significa esto para la ciencia cotidiana

Para los no especialistas, la conclusión principal es que las herramientas de IA bien diseñadas ya pueden ayudar a los científicos a navegar la literatura científica de forma más eficaz, siempre que estén vinculadas a datos reales y sometidas a estrictos estándares de evidencia y transparencia. OpenScholar demuestra que cuando un sistema de IA se construye desde cero para recuperar, verificar y citar artículos reales—y cuando su rendimiento se evalúa frente a expertos humanos—puede producir resúmenes de la literatura que no solo son legibles sino también verificables. En la práctica, estas herramientas podrían liberar a los investigadores para que se concentren más en diseñar experimentos e interpretar resultados, manteniendo a los humanos firmemente al mando de juzgar lo que es verdadero e importante.

Cita: Asai, A., He, J., Shao, R. et al. Synthesizing scientific literature with retrieval-augmented language models. Nature 650, 857–863 (2026). https://doi.org/10.1038/s41586-025-10072-4

Palabras clave: revisión de la literatura científica, modelos de lenguaje aumentados por recuperación, OpenScholar, precisión de las citas, herramientas de investigación con IA