Clear Sky Science · es

Superando los límites de factorización dimensional en modelos de difusión discreta mediante el aprendizaje de distribución conjunta cuántica

Por qué importa este nuevo giro entre IA y cuántica

Los sistemas de IA modernos son extraordinariamente buenos generando texto, imágenes y otros datos, pero aún enfrentan dificultades cuando muchas partes de los datos están fuertemente interconectadas. Este artículo muestra que una clase importante de modelos generativos, denominados modelos de difusión discreta, tiene una limitación intrínseca: a medida que los datos son de mayor dimensión y más correlacionados, sus errores pueden crecer rápidamente. Los autores proponen un enfoque nuevo que utiliza ordenadores cuánticos para aprender estas relaciones complejas de forma más fiel, lo que podría producir modelos generativos más rápidos y flexibles que las técnicas clásicas actuales.

Cuando descomponer las cosas rompe lo que importa

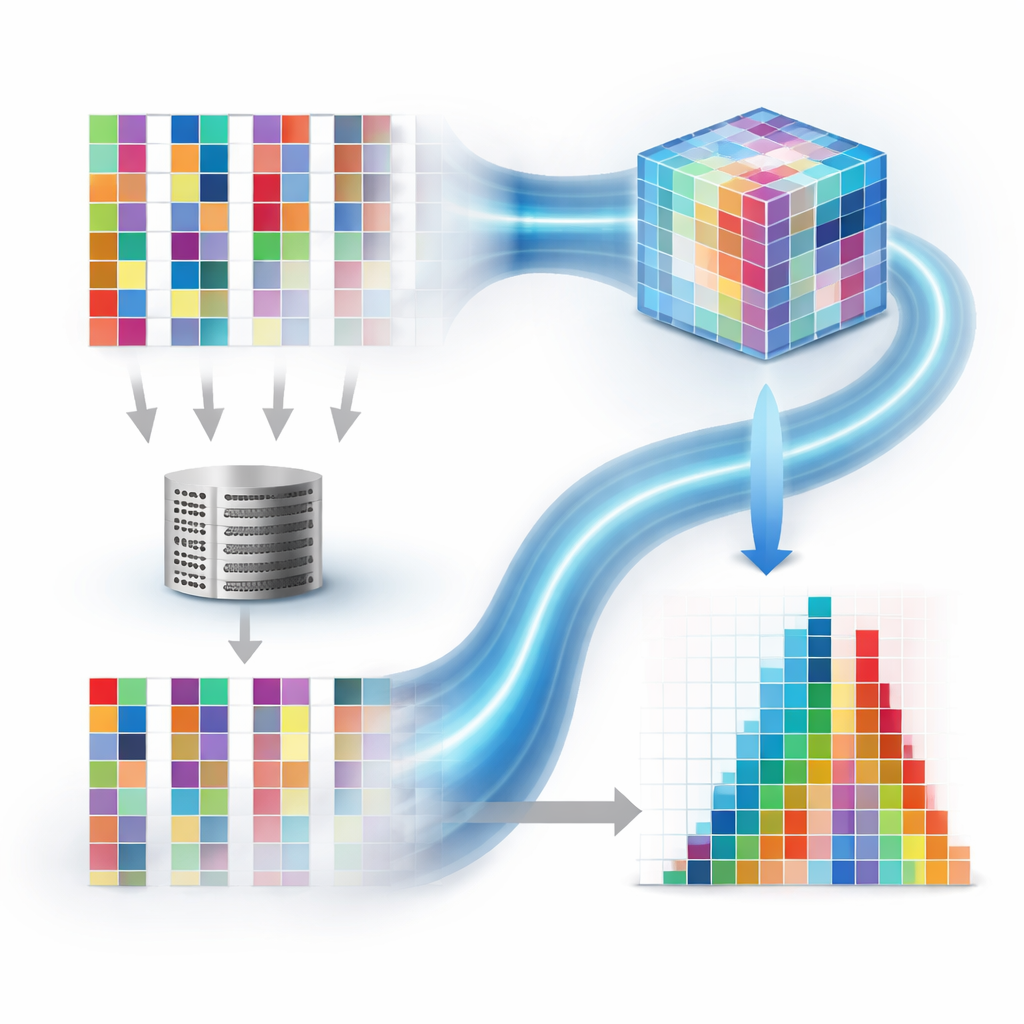

Los modelos clásicos de difusión discreta funcionan corrompiendo gradualmente los datos con ruido y luego aprendiendo a invertir ese proceso, paso a paso, para generar nuevas muestras. Para mantener los cálculos manejables, tratan cada dimensión —como cada píxel de una imagen o cada símbolo en una secuencia— como si cambiara de forma independiente. Esta «factorización» evita una explosión exponencial de la complejidad, pero también ignora las correlaciones entre dimensiones. Los autores analizan un escenario de peor caso en el que cada parte de los datos está fuertemente ligada a todas las demás. Demuestran que, para tales datos, el desajuste entre la distribución real y lo que puede aprender un modelo factorizado puede crecer aproximadamente en proporción al número de dimensiones. En otras palabras, a medida que los datos crecen y se estructuran más, los modelos clásicos de difusión discreta pueden fallar fundamentalmente en capturar cómo dependen unas partes de otras.

Usar estados cuánticos para mantener intactas las correlaciones

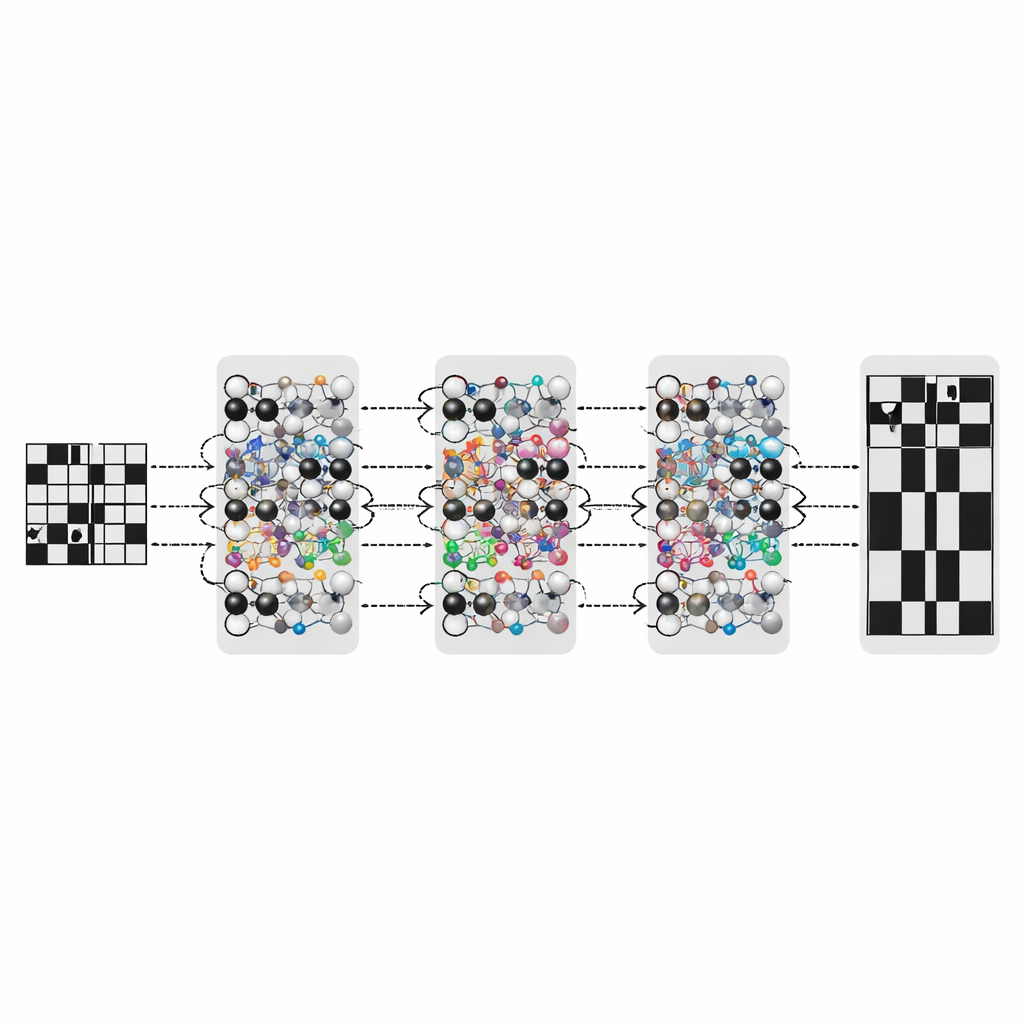

El modelo propuesto, llamado modelo probabilístico cuántico discreto de difusión y denoising (QD3PM), aborda este problema representando los datos como estados cuánticos en lugar de variables clásicas separadas. En un sistema cuántico, una colección de qubits vive naturalmente en un espacio combinado muy grande donde las configuraciones conjuntas y las correlaciones se almacenan juntas. QD3PM codifica datos discretos en este espacio, aplica un proceso controlado de «difusión» que añade ruido mediante canales cuánticos y luego aprende a invertir ese proceso con un circuito cuántico entrenable. De forma crucial, el modelo opera sobre el estado conjunto completo, por lo que la interdependencia entre dimensiones se preserva durante la difusión y el denoising. Usando una versión de la regla de Bayes adaptada a la teoría cuántica, los autores derivan cómo calcular el estado cuántico «posterior» exacto que debe guiar el entrenamiento y diseñan circuitos que implementan físicamente esta actualización.

De muchos pasos lentos a un solo salto cuántico

Los modelos de difusión estándar suelen necesitar muchas rondas de denoising gradual para convertir ruido puro en una muestra realista, lo que los hace costosos computacionalmente. QD3PM se describe primero de esta manera iterativa familiar, pero los autores muestran luego cómo entrenar la misma circuitería cuántica para saltar directamente del ruido a los datos limpios en un solo paso. Lo hacen haciendo que el circuito cuántico aprenda la distribución de los datos originales condicionada a una entrada ruidosa, y luego componiendo cuidadosamente ese mapeo aprendido con las reglas de difusión y actualización cuánticas. Gracias a propiedades de las operaciones y medidas cuánticas, el muestreo final depende solo de ciertos elementos diagonales del estado cuántico, lo que permite simplificar el procedimiento sin cambiar los resultados observables. Esto da lugar a un generador de un solo disparo que, en principio, puede ser mucho más rápido que la difusión clásica de múltiples pasos y aun así modelar la distribución conjunta completa.

Rellenar los huecos sin empezar de cero

Una ventaja práctica de QD3PM es lo natural que resulta para tareas condicionales como el inpainting —rellenar partes faltantes de una imagen dadas las regiones visibles. Debido a que el modelo describe la distribución conjunta completa sobre todas las dimensiones, los autores pueden condicionar en valores conocidos simplemente reiniciando repetidamente esas partes de los datos durante los pasos de denoising mientras permiten que las partes desconocidas varíen. Esto guía suavemente el proceso de muestreo hacia la distribución condicional correcta, sin cambiar el circuito ni volver a entrenarlo. En simulaciones con conjuntos de datos sintéticos que incluyen patrones altamente estructurados de «barras y franjas», QD3PM no solo ajusta la distribución global con mayor precisión que tanto los modelos clásicos de difusión como los modelos cuánticos que dependen de la factorización, sino que también funciona de manera robusta frente a niveles realistas de ruido en hardware cuántico y maneja bien la generación condicional.

Qué significan los resultados de cara al futuro

En conjunto, el análisis y los experimentos muestran que tratar las dimensiones de forma independiente es un cuello de botella serio para los modelos de difusión discreta cuando los datos están fuertemente correlacionados. Al usar en su lugar estados cuánticos para aprender distribuciones conjuntas directamente, QD3PM evita esta limitación y puede, en teoría, reproducir perfectamente distribuciones objetivo complejas en casos donde los enfoques clásicos factorizados no pueden. El trabajo también demuestra cómo los modelos generativos cuánticos pueden ofrecer no solo poder expresivo bruto, sino también beneficios prácticos como muestreo rápido en un solo paso e inferencia condicional flexible sin necesidad de reentrenar. Aunque las demostraciones actuales están limitadas a sistemas relativamente pequeños que pueden simularse en computadoras clásicas, el marco proporciona una hoja de ruta concreta sobre cómo el hardware cuántico emergente podría algún día mejorar la maquinaria central de la IA generativa.

Cita: Chen, C., Zhao, Q., Zhou, M. et al. Overcoming Dimensional Factorization Limits in Discrete Diffusion Models through Quantum Joint Distribution Learning. npj Quantum Inf 12, 49 (2026). https://doi.org/10.1038/s41534-026-01188-0

Palabras clave: modelos generativos cuánticos, modelos de difusión, aprendizaje de distribución conjunta, correlaciones de alta dimensión, generación condicional