Clear Sky Science · es

Representación alineada de las direcciones de movimiento visual y táctil en hMT+/V5 y regiones fronto-parietales

Por qué esto importa en la vida cotidiana

Dar una palmada a un mosquito en el brazo parece effortless, pero el cerebro está resolviendo silenciosamente un problema difícil: debe combinar lo que ves con lo que sientes para averiguar en qué dirección se mueve algo sobre la piel y cómo reaccionar. Este estudio pregunta dónde en el cerebro humano la vista y el tacto se ponen en correspondencia, y cómo el cerebro convierte tipos de señales muy diferentes —luz en los ojos y presión en la piel— en una única sensación compartida de movimiento en el mundo que nos rodea.

Dos maneras de saber dónde se mueven las cosas

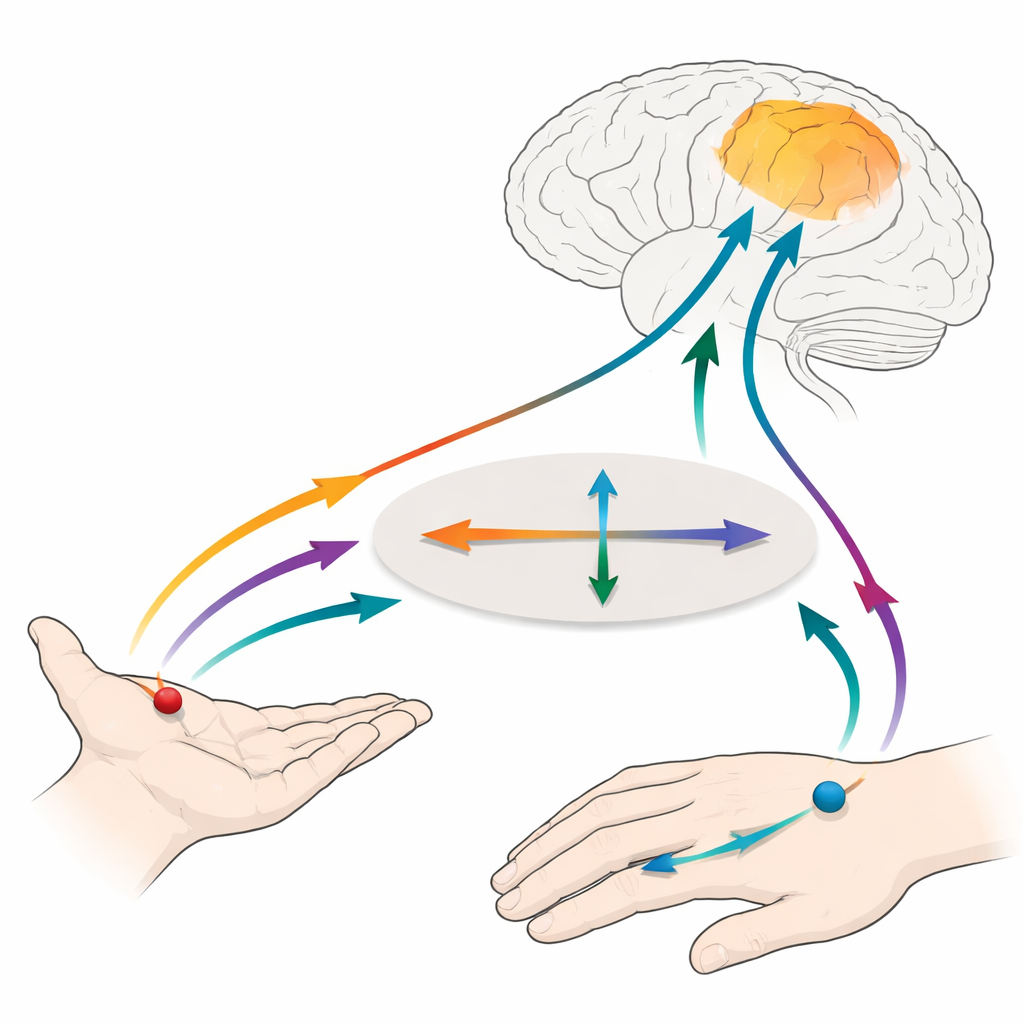

La visión y el tacto empiezan hablando “idiomas espaciales” distintos. El movimiento visual se codifica primero respecto a los ojos: qué parte de la retina se estimula. El movimiento táctil se codifica respecto a la piel: qué parte de la mano es rozada. Sin embargo, nuestras acciones se guían por dónde están las cosas en el mundo exterior, no solo por su posición en los ojos o en la piel. Por tanto, el cerebro debe traducir estos mapas basados en el cuerpo a un marco común, basado en el mundo, para que un objeto en movimiento visto cerca de la mano y una sensación coincidente en la piel se traten como el mismo evento.

Una prueba ingeniosa con puntos en movimiento y pinceles móviles

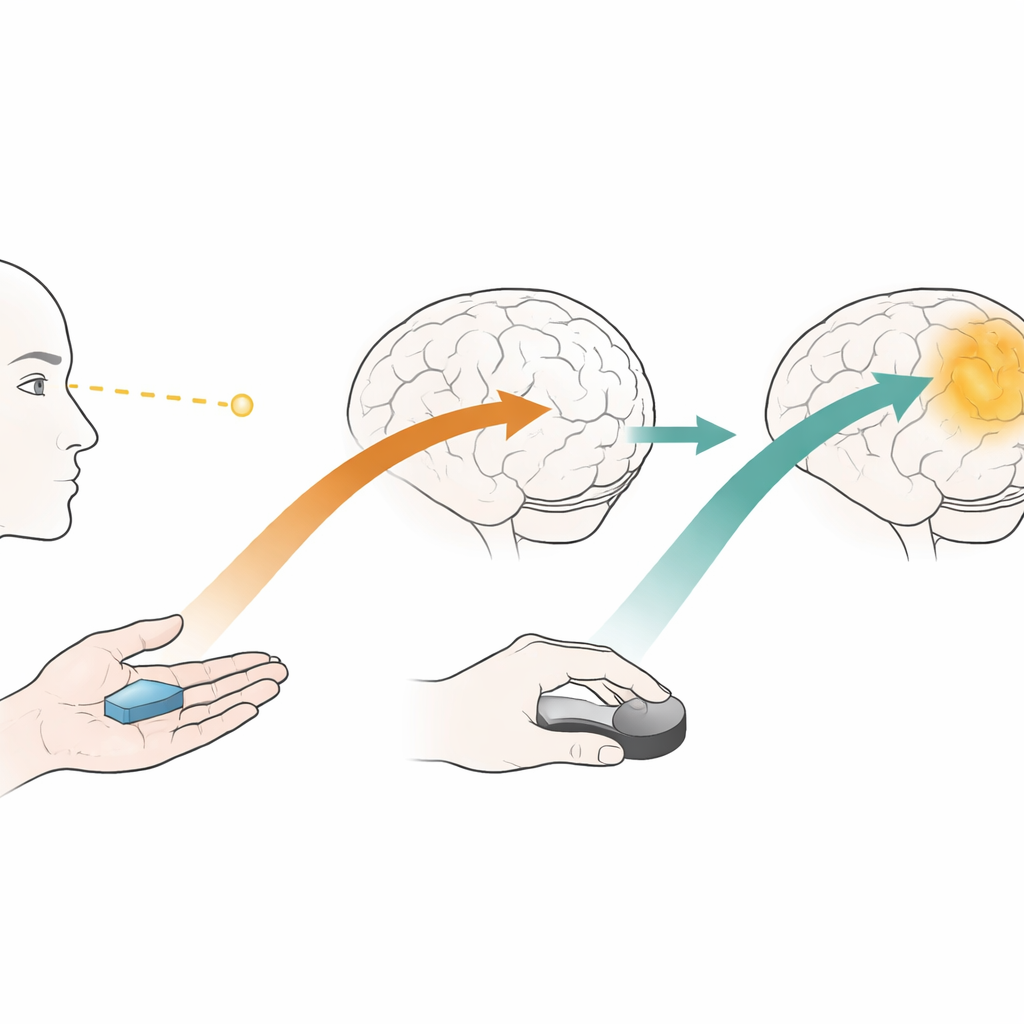

Los investigadores usaron resonancia magnética funcional para monitorizar la actividad cerebral mientras las personas miraban patrones de puntos en movimiento y sentían un pincel barrer su mano derecha. Cambiaron la postura de la mano —a veces con la palma hacia arriba, a veces rotada— de modo que el mismo movimiento físico sobre la piel pudiera apuntar en distintas direcciones en el espacio externo. Comparando patrones de actividad cerebral a lo largo de muchos puntos de medida diminutos, preguntaron si una región podía distinguir direcciones de movimiento y si su “código” para la dirección se mantenía consistente cuando el movimiento se definía en la piel frente a en el espacio exterior.

Un centro del movimiento visual que también siente movimiento

Un objetivo central fue hMT+/V5, una zona de la corteza visual conocida desde hace tiempo por procesar el movimiento. El equipo confirmó primero que esta área se activaba no solo con puntos visuales en movimiento, sino también cuando la mano era rozada, y que podía distinguir direcciones de movimiento en ambos sentidos. Esto fue cierto también para subregiones conocidas como MT y MST. En contraste, las áreas táctiles primarias en el lado izquierdo del cerebro respondieron con fuerza al movimiento táctil pero no al movimiento visual, coherente con su papel clásico como mapa detallado de la superficie corporal.

Del movimiento basado en la piel al movimiento basado en el mundo

La pregunta clave fue cómo estas áreas manejaban distintos “marcos de referencia”. En la corteza táctil primaria, el movimiento a lo largo del eje del meñique al pulgar y el movimiento a lo largo del eje de los dedos a la muñeca se separaron más claramente cuando se definían puramente sobre la piel, mostrando un código dominante basado en el cuerpo. En el hMT+/V5 derecho, sin embargo, las direcciones táctiles se distinguieron con mayor nitidez cuando se definían respecto al mundo exterior —horizontal frente a vertical en el espacio— independientemente de la postura de la mano. De manera crucial, solo en hMT+/V5 derecho un ordenador entrenado con patrones de movimiento visual pudo adivinar correctamente las direcciones del movimiento táctil, y esta decodificación entre sentidos funcionó solo cuando el tacto se describía en coordenadas externas. Los análisis de todo el cerebro mostraron que casar movimiento visual y táctil de esta forma también activó una red de regiones parietales y frontales derechas vinculadas con la atención espacial y la planificación del movimiento.

Un mapa compartido que aún recuerda el sentido

Aunque hMT+/V5 derecho contenía suficiente información compartida para alinear las direcciones de movimiento entre vista y tacto, no borró completamente la diferencia entre los sentidos: los patrones de movimiento visual y táctil aún podían distinguirse. Los autores sostienen que esta región, junto con sus socios fronto-parietales, actúa como un núcleo multisensorial del movimiento. Convierte entradas basadas en la piel y en los ojos en un mapa externo parcialmente común de las direcciones de movimiento, al tiempo que preserva qué sentido proporcionó la información. Esta codificación flexible puede ayudar al cerebro a rastrear eventos en movimiento mientras nuestros ojos y extremidades se desplazan, permitiéndonos coordinar percepción y acción con fluidez en un mundo ocupado y dinámico.

Cita: Shahzad, I., Battal, C., Cerpelloni, F. et al. Aligned representation of visual and tactile motion directions in hMT+/V5 and fronto-parietal regions. Nat Commun 17, 2625 (2026). https://doi.org/10.1038/s41467-026-70537-6

Palabras clave: movimiento multisensorial, hMT+/V5, integración visión-tacto, marcos de referencia espaciales, imagen cerebral