Clear Sky Science · es

Reduciendo la brecha de latencia con un marco de evaluación de flujo continuo en percepción dirigida por eventos

Por qué importa una visión robótica más rápida

Imagínese un coche autónomo detectando un obstáculo repentino o un robot intentando devolver una bola de ping‑pong que viene a toda velocidad. En estas situaciones de fracciones de segundo, ver rápido es tan importante como ver con claridad. Este artículo explora una nueva forma de evaluar cuán rápidos y fiables son realmente las avanzadas "cámaras de eventos" cuando rastrean objetos en movimiento, y muestra que las pruebas de laboratorio habituales pueden sobreestimar de manera importante el rendimiento de estos sistemas en el mundo real.

De instantáneas a flujos

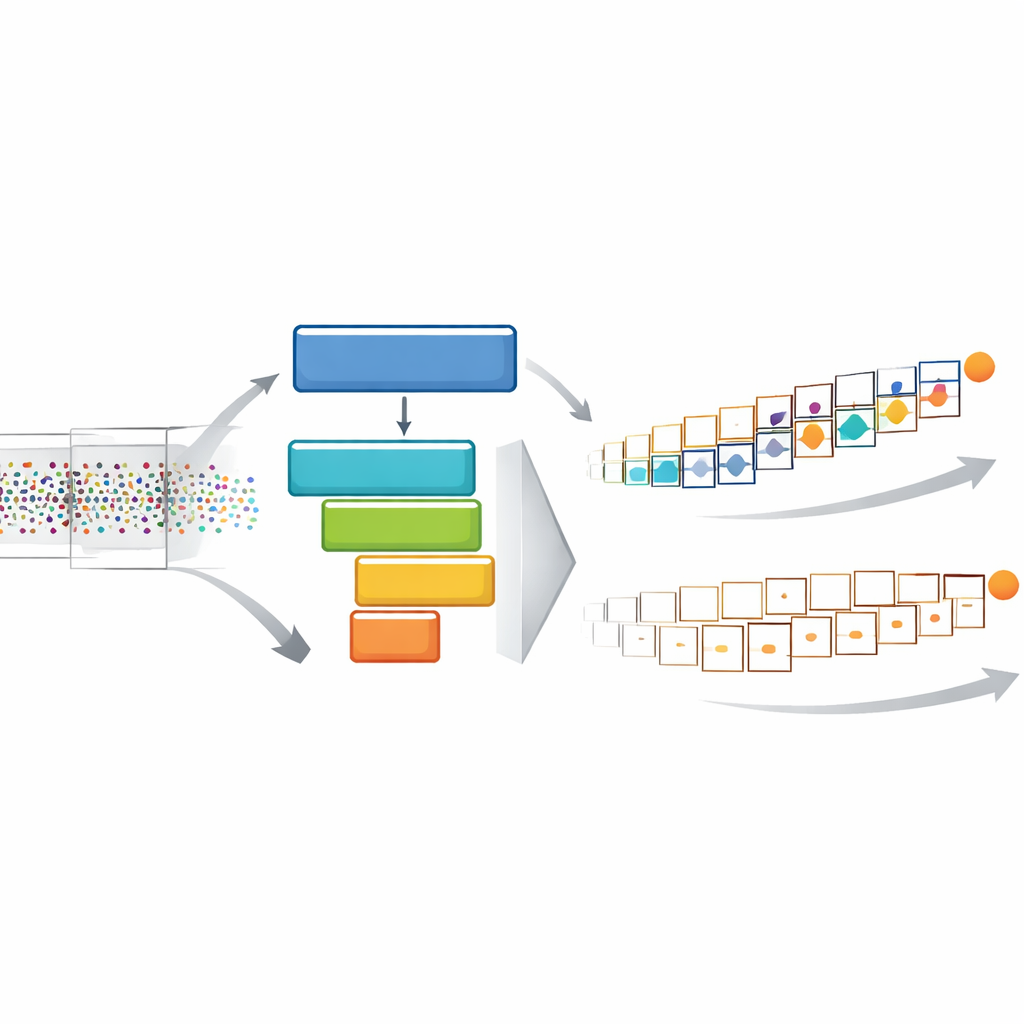

La mayoría de los sistemas de visión por ordenador actuales tratan el mundo como una presentación de diapositivas. Las cámaras convencionales capturan imágenes a intervalos fijos y los algoritmos procesan un fotograma a la vez. Incluso cuando los ingenieros usan cámaras neuromórficas, o basadas en eventos, que detectan cambios de brillo con resolución de microsegundos, a menudo convierten ese rico flujo continuo de nuevo en fotogramas toscos. Esta mentalidad basada en fotogramas oculta un problema crucial: el retraso. Cada vez que el sistema espera el siguiente fotograma y luego lo procesa, se pierden valiosos milisegundos. En tareas de alta velocidad como la conducción autónoma o la interacción humano‑robot, ese retraso significa que el sistema responde siempre al pasado reciente en lugar del presente.

Una nueva forma de puntuar la visión en tiempo real

Para cerrar esta brecha entre las puntuaciones de laboratorio y las necesidades reales, los autores presentan un marco llamado Evaluación Consciente de Latencia basada en Flujo, o STARE (por sus siglas en inglés). En lugar de forzar los datos de eventos en fotogramas fijos, STARE alimenta un modelo con los eventos más recientes tan pronto como éste ha terminado su última predicción. Este "muestreo continuo" mantiene ocupado al modelo y eleva su tasa de salida tanto como lo permita el hardware. Al mismo tiempo, STARE juzga la precisión de una forma nueva: cada posición de referencia (ground truth) de un objeto en movimiento se empareja con la predicción más reciente disponible en ese instante. Si el modelo es lento, la misma predicción obsoleta se reutiliza en muchos puntos temporales y su precisión aparente cae. Esto incorpora directamente el coste del retraso en la puntuación final.

Construyendo un banco de pruebas de alta velocidad

Medir este tipo de temporización fina requiere datos igualmente finos, que los conjuntos de datos existentes de cámaras de eventos no tienen. Normalmente registran la posición de un objeto solo unas pocas decenas de veces por segundo. Por ello, los autores crearon ESOT500, un nuevo conjunto de datos donde los objetos están anotados 500 veces por segundo, tanto en cámaras de eventos de baja como de alta resolución y en escenas variadas como ventiladores girando, aves volando y vehículos en movimiento. Con esta densidad, la referencia temporal sigue movimientos rápidos y complejos con suficiente fidelidad para evitar el "aliasing temporal", donde un muestreo lento hace que una trayectoria sinuosa y acelerada parezca indebidamente simple. ESOT500 actúa así como una prueba de esfuerzo para cualquier método que pretenda manejar dinámicas rápidas e impredecibles.

Lo que realmente ocurre cuando la latencia importa

Equipados con STARE y ESOT500, los autores re‑evaluaron una variedad de rastreadores de objetos de última generación. Bajo las pruebas tradicionales basadas en fotogramas, los modelos más pesados y complejos suelen parecer los mejores. Sin embargo, bajo STARE, muchos de estos sistemas de alta precisión pero lentos pierden más de la mitad de su precisión efectiva una vez que se tiene en cuenta el retraso. Los modelos más ligeros y rápidos suben súbitamente a la cima, porque ofrecen predicciones más frecuentes y actualizadas. El equipo confirmó esto en un experimento de ping‑pong con un robot: el robot usó una cámara de eventos y un rastreador para devolver pelotas entrantes. Una percepción moderadamente más rápida casi duplicó la tasa de aciertos, mientras que un modelo más lento pero fuerte en evaluaciones offline rindió mal. En otras palabras, en tiempo real, la velocidad y la frescura de la información pueden compensar la precisión bruta.

Uso más inteligente de los flujos continuos

Más allá de la evaluación, los autores exploran cómo diseñar mejores sistemas para visión continua. Una estrategia, "Seguimiento Asíncrono", combina un modelo base lento pero cuidadoso con un compañero más pequeño y ágil que sigue actualizando la posición del objeto entre las pasadas completas del modelo base. Esta configuración dual reutiliza características compartidas y explota el flujo constante de eventos, aumentando la tasa de salida casi un 80% y mejorando la precisión consciente de la latencia en alrededor de un 60%. Una segunda estrategia, "Muestreo Consciente del Contexto", vigila cuántos eventos ocurren alrededor del objeto rastreado. Cuando la escena está tranquila y hay pocos cambios, el rastreador reutiliza temporalmente su última buena estimación en lugar de recalcular, ahorrando trabajo innecesario. Luego se reactiva cuando aumenta el movimiento, lo que resulta especialmente útil en condiciones de baja actividad o eventos escasos.

Cerrando la brecha entre laboratorio y vida real

Para los no especialistas, el mensaje clave es simple: en situaciones de movimiento rápido, la rapidez con la que un sistema de visión puede actualizar su comprensión del mundo importa tanto como la exactitud de cada predicción individual. Tratando la salida de la cámara como un flujo verdadero e incorporando el retraso directamente en la puntuación, STARE revela debilidades que las pruebas convencionales no detectan y destaca diseños que realmente funcionan bajo presión. Junto con el conjunto de datos ESOT500 y las estrategias de seguimiento propuestas, este trabajo señala el camino hacia robots, vehículos y máquinas interactivas que no solo ven bien, sino que ven a tiempo.

Cita: Chu, J., Zhang, R., Yang, C. et al. Bridging the latency gap with a continuous stream evaluation framework in event-driven perception. Nat Commun 17, 2441 (2026). https://doi.org/10.1038/s41467-026-70240-6

Palabras clave: cámaras de eventos, seguimiento en tiempo real, visión robótica, evaluación consciente de la latencia, percepción neuromórfica