Clear Sky Science · es

Estimaciones de incertidumbre fiables en aprendizaje profundo con algoritmos Metropolis-Hastings eficientes

Por qué importa una incertidumbre más inteligente

Desde exploraciones médicas hasta vehículos autónomos, la inteligencia artificial moderna a menudo toma decisiones en las que estar equivocada con mucha confianza puede ser peligroso. Los sistemas de aprendizaje profundo estándar son excelentes reconociendo patrones, pero son notoriamente malos para decirnos cuán inseguros están. Este artículo aborda esa brecha: presenta nuevas formas de dotar a las redes neuronales profundas de medidas de incertidumbre fiables, manteniendo bajo control el costoso cálculo de los métodos bayesianos tradicionales.

Del tanteo a la confianza medida

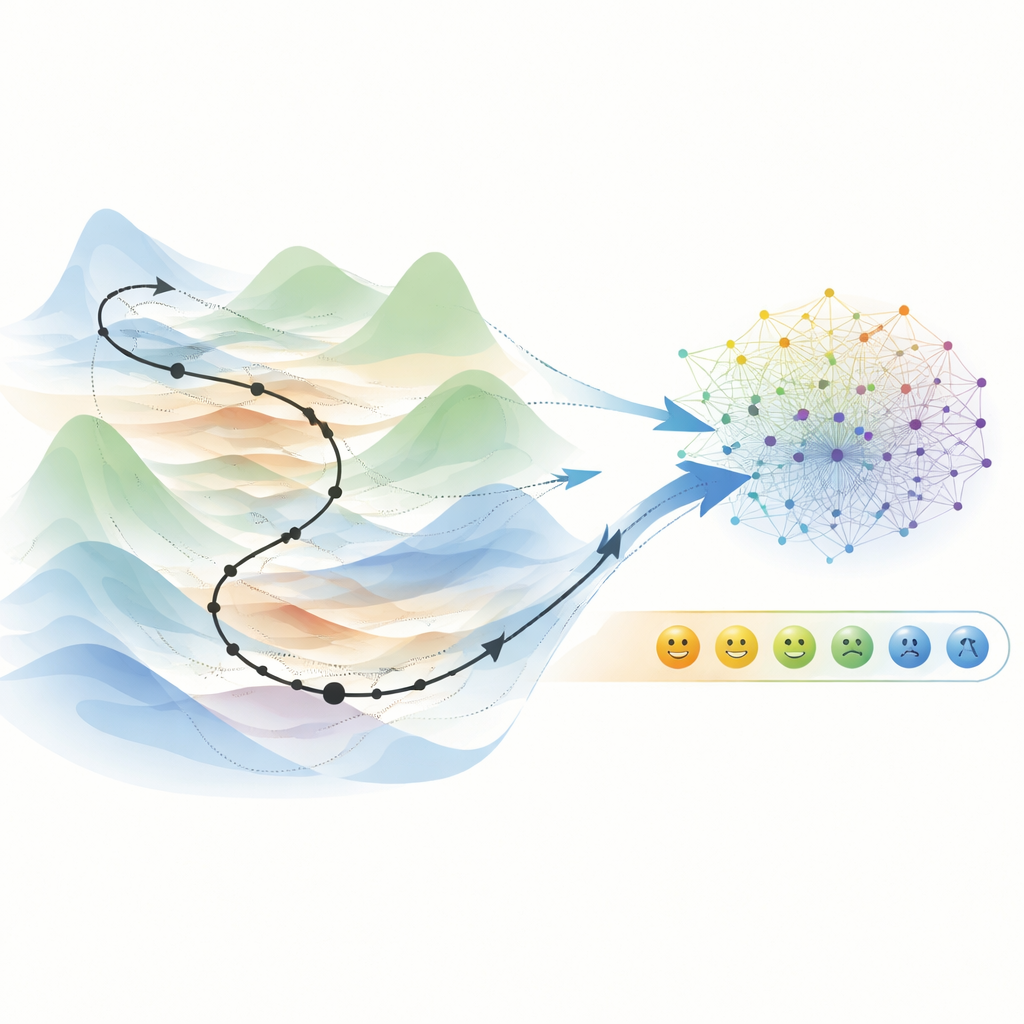

En el aprendizaje profundo habitual, un modelo se entrena una vez y luego se usa tal cual. Devuelve una única mejor conjetura, pero ofrece poca información sobre cuán fiable es esa conjetura. Las redes neuronales bayesianas toman otro camino: en lugar de fijar un único conjunto de parámetros del modelo, tratan los parámetros como variables aleatorias e intentan capturar toda una distribución de modelos plausibles. Promediar predicciones sobre esta colección puede revelar tanto la respuesta más probable como cuánto debería confiar el modelo en sí mismo. El desafío es que muestrear con precisión desde esta distribución con métodos de referencia como Hamiltonian Monte Carlo resulta extremadamente costoso para las redes y los conjuntos de datos grandes de hoy en día.

Muesteo más rápido sin perder la visión global

Los autores se centran en una familia de métodos llamada Hamiltonian Monte Carlo con gradiente estocástico, que ya reutiliza ideas del entrenamiento estándar—mini-batches y gradientes ruidosos—para acelerar el muestreo. El ingrediente que falta es un “filtro” fiable que decida qué actualizaciones tentativas de parámetros conservar. En el Hamiltonian Monte Carlo clásico, este papel lo desempeña un paso de aceptación de Metropolis-Hastings que corrige errores numéricos e impide que el muestreador derive hacia regiones equivocadas. Incorporar este paso de aceptación en el mundo ruidoso y de mini-batches del aprendizaje profundo es difícil, porque normalmente exige evaluaciones sobre todo el conjunto de datos y puede frenar el progreso si las tasas de aceptación son demasiado bajas.

Dos nuevas maneras de recorrer el paisaje

El artículo presenta dos estrategias complementarias. La primera, llamada Hamiltonian Monte Carlo con gradiente estocástico generalizado (GSGHMC), diseña una prueba de aceptación que se ejecuta sobre mini-batches preservando la propiedad importante de que los óptimos genuinos del problema completo siguen siendo correctamente reconocidos. Usa un integrador numérico cuidadosamente elegido para que la aceptación paso a paso se mantenga estable, aunque solo vea una porción de los datos en cada momento. Esto proporciona un muestreador eficiente que se mantiene cerca de la visión bayesiana verdadera y produce conjuntos de modelos con puntuaciones de confianza particularmente bien calibradas.

Recorriendo largas trayectorias para mejores predicciones

El segundo método, el Conjunto de Trayectorias Hamiltonianas (HTE), realiza una compensación deliberada: en lugar de insistir en un comportamiento bayesiano exacto, favorece recorridos largos impulsados por el momento a través del espacio de parámetros que se parecen a ejecuciones de entrenamiento agresivas. Al final de cada trayectoria se aplica una prueba estilo Metropolis para decidir si conservar la instantánea del modelo resultante. Como estos caminos tienden a asentarse en valles amplios y generalizables del paisaje de pérdida, los modelos recopilados forman un conjunto diverso pero focalizado. En benchmarks de clasificación de imágenes como EMNIST y CIFAR-10, HTE mejora la precisión hasta en unos seis puntos porcentuales frente a sólidos referentes bayesianos, y en varios puntos frente al entrenamiento determinista ordinario, al tiempo que sigue ofreciendo información útil de incertidumbre y una fuerte detección de entradas fuera de distribución.

Conjuntos más pequeños, uso más inteligente

Muestrear cientos o miles de modelos suena caro en tiempo de prueba, por lo que los autores también estudian cuántos miembros del conjunto son realmente necesarios. Descubren que, descartando de forma codiciosa los modelos que tienen poco efecto en el rendimiento, a menudo se puede mantener aproximadamente un tercio del conjunto sin perjudicar la precisión, aunque mantener una calibración muy afinada suele requerir más miembros. En tareas de imagen y un problema caótico de previsión temporal, sus métodos consistentemente superan o igualan alternativas populares como la inferencia variacional, Monte Carlo dropout y conjuntos profundos más simples, aunque a un coste de entrenamiento superior al del aprendizaje determinista plano.

Qué significa esto para la IA en el mundo real

Para un no especialista, el mensaje central es que podemos hacer que el aprendizaje profundo no solo sea preciso sino también honesto sobre lo que no sabe, sin necesitar recursos a escala de supercomputadora. Al entretejer cuidadosamente ideas clásicas de muestreo con el entrenamiento moderno basado en mini-batches, las dos aproximaciones propuestas ofrecen mejores predicciones y estimaciones de confianza más fiables que muchas técnicas existentes. Esta combinación de eficiencia, robustez y incertidumbre calibrada es un paso clave hacia el despliegue seguro del aprendizaje profundo en dominios sensibles donde el coste de la confianza excesiva se mide en vidas, no solo en puntos porcentuales.

Cita: Schmal, M., Mäder, P. Reliable uncertainty estimates in deep learning with efficient Metropolis-Hastings algorithms. Nat Commun 17, 2531 (2026). https://doi.org/10.1038/s41467-026-70015-z

Palabras clave: Redes neuronales bayesianas, estimación de incertidumbre, Hamiltonian Monte Carlo, conjuntos en aprendizaje profundo, MCMC con gradiente estocástico