Clear Sky Science · es

Un transformador preentrenado equivariante para un aprendizaje unificado de representaciones moleculares 3D

Enseñar a los ordenadores a ver las moléculas en 3D

El diseño de nuevos medicamentos y materiales depende de comprender cómo son y cómo se mueven realmente las moléculas en tres dimensiones, no solo como fórmulas planas en papel. Este artículo presenta un potente nuevo modelo de inteligencia artificial que puede aprender a partir de las formas 3D de muchos tipos de moléculas a la vez —desde compuestos pequeños similares a fármacos hasta grandes proteínas y sus complejos— y luego emplear ese conocimiento para predecir con qué intensidad interactúan y cuáles podrían convertirse en futuros fármacos.

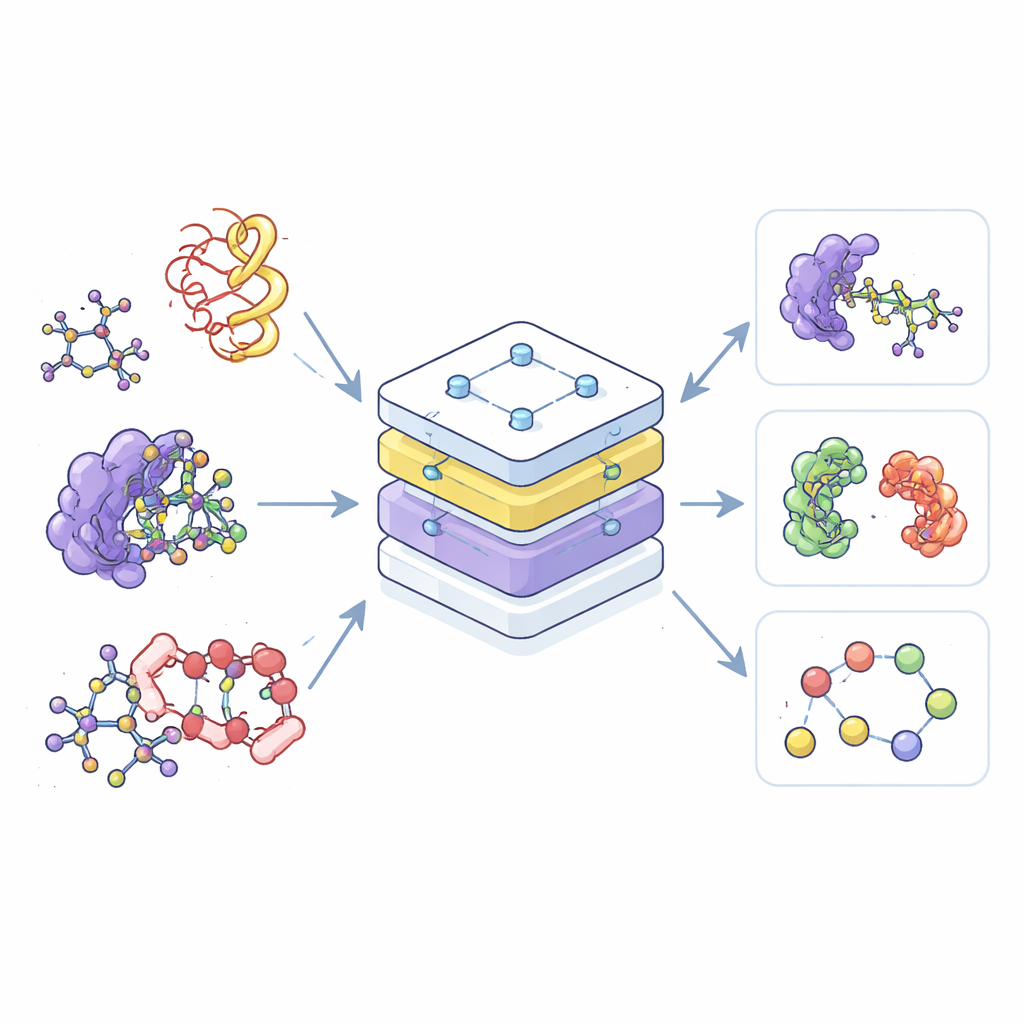

Un único mapa para muchos mundos moleculares

La mayoría de las herramientas actuales de IA para química son especialistas: una se entrena solo con moléculas pequeñas, otra solo con proteínas y una tercera solo con sus complejos. Esta separación desaprovecha datos y dificulta transferir lo aprendido de un ámbito a otro. Los autores, en cambio, construyen un único modelo «fundacional», llamado Transformador Preentrenado Equivariante (EPT), que aprende a partir de una vasta colección de estructuras moleculares 3D extraídas de múltiples bases de datos públicas. Al tratar todas estas estructuras dentro de un marco compartido, el modelo puede reconocer patrones comunes en cómo los átomos se organizan e interactúan, ya pertenezcan a una molécula simple parecida a un fármaco o a un enredo complejo de cadenas proteicas.

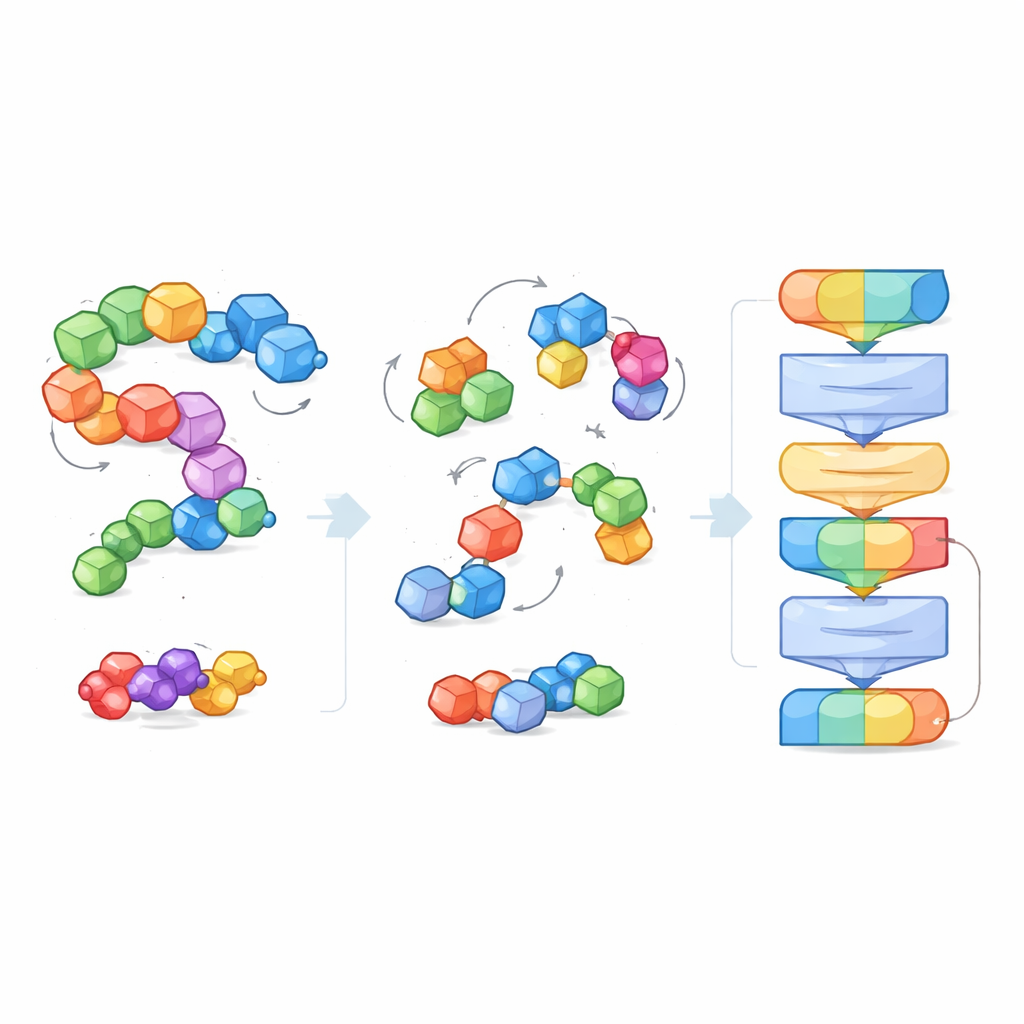

Dividir las moléculas en piezas manejables

Para afrontar la enorme variedad y el tamaño de los sistemas moleculares, los investigadores introducen la idea de «bloques»: fragmentos pequeños y significativos de átomos. Para las moléculas pequeñas, un bloque agrupa un átomo pesado con sus hidrógenos unidos; para las proteínas, cada aminoácido se convierte en un bloque. Durante el entrenamiento, el modelo ve tanto los átomos de detalle fino como la estructura más gruesa de bloques, lo que le permite conectar detalles químicos locales con formas 3D más amplias, como las espinas dorsales de las proteínas o los bolsillos de unión. Esta visión por bloques también crea un lenguaje común que funciona a través de tipos moleculares muy distintos, haciendo posible que un solo modelo los entienda a todos.

Aprender limpiando estructuras ruidosas

En lugar de recibir etiquetas explícitas como «esta molécula es soluble» o «esta se une fuertemente», EPT se entrena de forma auto-supervisada. Los autores perturban deliberadamente cada bloque molecular, desplazándolo y rotándolo aleatoriamente respecto a su posición real, y luego piden al modelo que infiera las fuerzas y giros necesarios para restaurar la estructura original. Porque el entrenamiento respeta reglas geométricas fundamentales —la molécula debería parecer la misma si todo el sistema se rota o se traslada en el espacio—, el modelo aprende una noción físicamente coherente de la forma 3D. Este juego de desruido enseña a EPT cómo los átomos dentro y entre bloques se mantienen unidos y cómo los cambios sutiles en la geometría afectan a la estabilidad.

Poner el modelo a prueba

Tras el preentrenamiento con más de cinco millones de estructuras, EPT se ajusta (fine-tune) para varias tareas científicas reales. Predice con qué fuerza una molécula pequeña se une a un bolsillo proteico, cómo una sola mutación en una interfaz proteica afecta la unión, y propiedades físicas clave de moléculas pequeñas que interesan a los químicos. En diversos puntos de referencia, el modelo unificado iguala o supera a las mejores herramientas existentes, incluidas aquellas diseñadas específicamente para un solo dominio. Notablemente, cuando se entrena con un tipo de datos, como moléculas pequeñas, sigue siendo útil en tareas aparentemente diferentes, como la unión a proteínas, lo que revela que ha capturado principios químicos ampliamente útiles en lugar de trucos estrechos.

Buscar nuevos tratamientos para la COVID-19

Los autores demuestran además el valor práctico de EPT aplicándolo a un reto de reposicionamiento de fármacos. Primero afinan el modelo con complejos proteína–ligando y luego lo usan para clasificar casi 2.000 fármacos ya aprobados según su capacidad prevista para unirse a la proteasa principal del SARS‑CoV‑2, una enzima clave que el virus necesita para replicarse. Fármacos conocidos contra la COVID‑19 ascienden hacia la parte superior de la clasificación, y el modelo destaca candidatos prometedores adicionales. Doce moléculas con puntuaciones altas se examinan más de cerca con simulaciones por ordenador, y dos —incluida una que no fue desarrollada originalmente para la COVID‑19— muestran una unión prevista especialmente fuerte y se confirman experimentalmente como inhibidores de la proteasa viral a niveles micromolares.

Un paso hacia la IA molecular general

En términos claros, este trabajo muestra que un único modelo de IA consciente de la geometría puede aprender una comprensión 3D compartida de muchos sistemas moleculares y luego usarla para responder a un amplio abanico de preguntas científicas. Al organizar las moléculas en bloques y entrenar el modelo para «reparar» estructuras distorsionadas, los autores crean una herramienta que no solo predice números con mayor precisión, sino que también puede acelerar tareas como encontrar nuevos antivirales. EPT señala hacia un futuro en el que sistemas de IA molecular de propósito general ayuden a químicos y biólogos a explorar el espacio químico con más eficiencia, guiando experimentos y acortando el camino desde la estructura atómica hasta terapias y materiales prácticos.

Cita: Jiao, R., Kong, X., Zhang, L. et al. An equivariant pretrained transformer for unified 3D molecular representation learning. Nat Commun 17, 2606 (2026). https://doi.org/10.1038/s41467-026-69185-7

Palabras clave: representación molecular 3D, transformador equivariante, descubrimiento de fármacos, unión proteína–ligando, aprendizaje auto-supervisado