Clear Sky Science · es

Aprendizaje sin retroalimentación en forma cerrada con proyección hacia adelante

Enseñar a las máquinas sin mensajes hacia atrás

La inteligencia artificial moderna aprende en su mayoría usando un método llamado retropropagación, en el que los errores se envían hacia atrás a través de una red para ajustar sus conexiones internas. Pero este proceso difiere del funcionamiento de los cerebros reales y puede ser lento y consumir muchos recursos. Este artículo presenta una nueva forma para que las redes neuronales aprendan, llamada Proyección hacia Adelante, que omite por completo el paso hacia atrás y aun así logra un rendimiento sólido, especialmente en tareas biomédicas difíciles con datos limitados.

Una nueva forma de guiar el aprendizaje

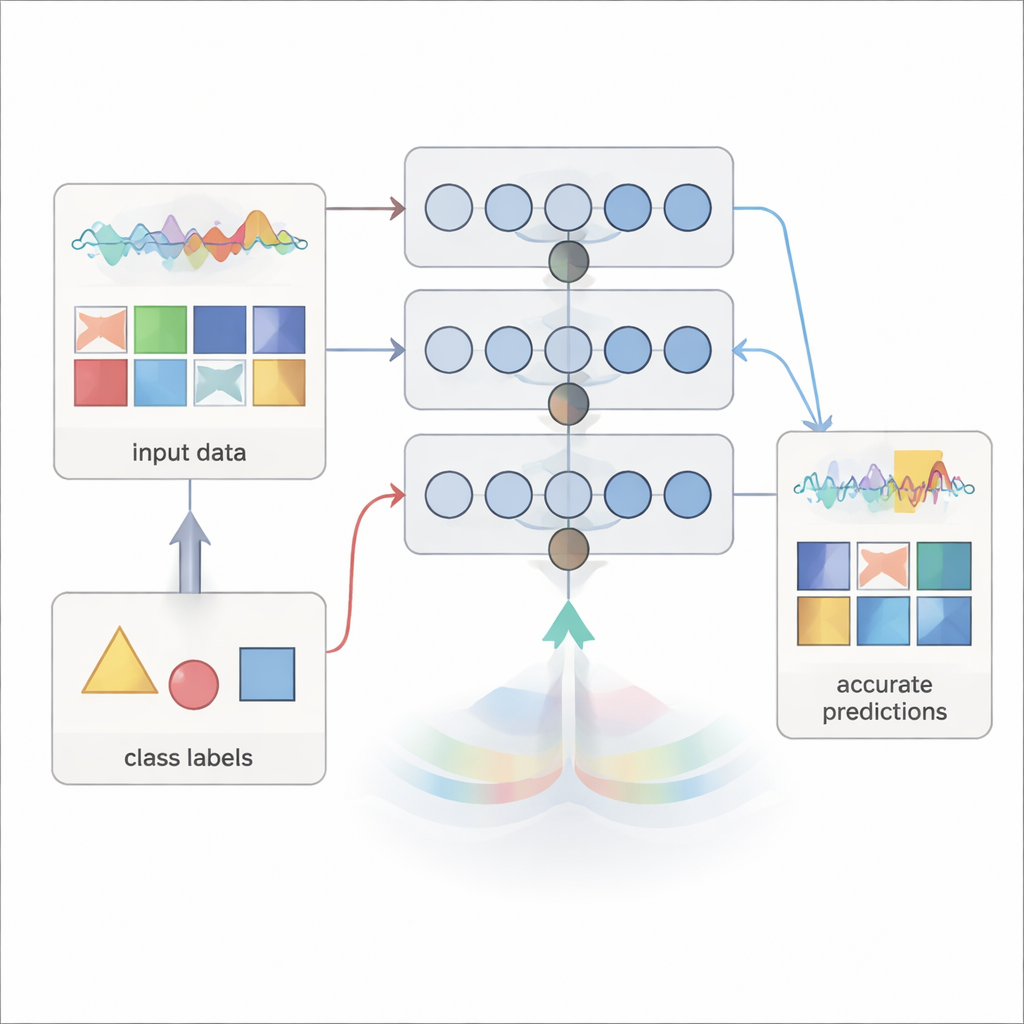

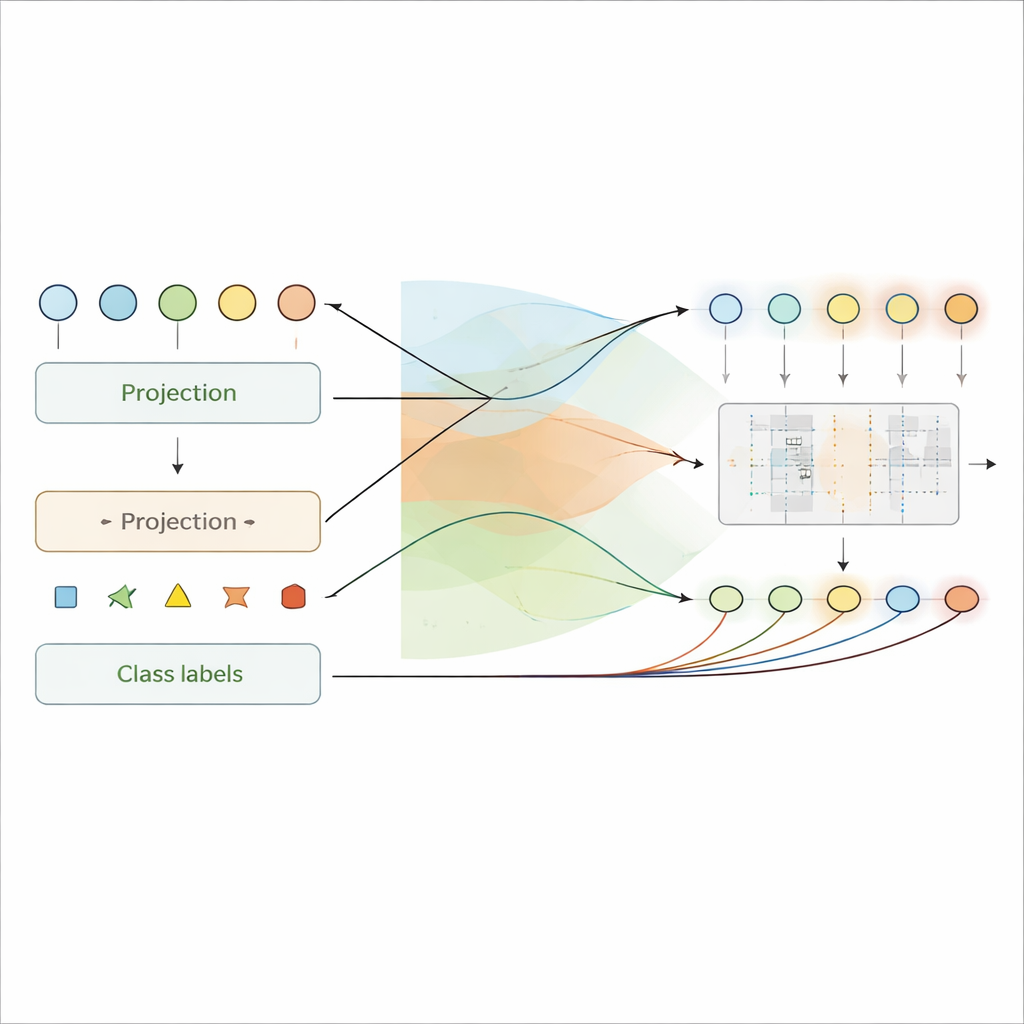

Las redes neuronales tradicionales aprenden comparando sus predicciones con las respuestas correctas y enviando señales de error hacia atrás por cada capa para afinar las conexiones. La Proyección hacia Adelante toma una ruta diferente. En lugar de confiar en esos mensajes de error hacia atrás, usa solo la información disponible cuando las señales avanzan hacia delante: la actividad actual de la capa y la etiqueta objetivo. En cada capa, el método combina la entrada a esa capa y la etiqueta deseada mediante proyecciones aleatorias fijas pasadas por una no linealidad simple. Esto produce una “señal objetivo” interna para esa capa: un patrón de actividad análogo a potenciales que la capa debe intentar reproducir.

Una vez creados estos objetivos, los pesos de conexión de cada capa se resuelven de una vez mediante regresión en forma cerrada, una fórmula estadística estándar en lugar de un descenso de gradiente iterativo. Esto significa que la red puede entrenarse en una sola pasada por el conjunto de datos, sin revisitar repetidamente los mismos ejemplos ni almacenar gran cantidad de activaciones intermedias. Dado que no es necesario enviar información hacia atrás, el método respeta la comunicación unidireccional observada en las neuronas biológicas y podría ser más fácil de implementar en hardware especializado con conexiones de una sola dirección.

Ver significado en la actividad oculta

Una ventaja notable de la Proyección hacia Adelante es que las señales internas en las capas ocultas se vuelven directamente interpretable. Puesto que cada capa se entrena explícitamente para codificar tanto la entrada como la etiqueta en sus potenciales tipo membrana, estos valores internos pueden leerse como predicciones locales de la clase. Los autores muestran cómo “decodificar” aproximadamente estas señales de vuelta al espacio de etiquetas, convirtiendo patrones de actividad en explicaciones por capa de lo que la red considera en cada etapa. En los experimentos, estas explicaciones se vuelven más precisas en capas más profundas, reflejando un aprendizaje progresivo: las capas tempranas captan patrones generales, mientras que las posteriores se centran en detalles críticos para la decisión.

Esta interpretabilidad es particularmente valiosa en medicina, donde entender por qué un modelo tomó una decisión puede importar tanto como la propia decisión. Usando datos de electrocardiogramas, los autores muestran que la Proyección hacia Adelante resalta signos clínicamente conocidos de infarto de miocardio —como cambios en segmentos específicos de la forma de onda— en los momentos temporales adecuados. En escaneos oculares usados para detectar crecimiento anómalo de vasos sanguíneos, el método se centra de forma natural en bolsas de líquido, depósitos brillantes y regiones con apariencia de cicatriz que los especialistas buscan, incluso cuando se entrena con tan solo 100 ejemplos por clase.

Entrenamiento rápido, resultados sólidos

El equipo comparó la Proyección hacia Adelante con varias alternativas que también intentan evitar la retropropagación completa, así como con la retropropagación estándar. En tareas de imagen y secuencia como dígitos de Fashion-MNIST, reconocimiento de promotores de ADN, detección de infarto a partir de electrocardiogramas y reconocimiento de objetos, el nuevo método igualó o superó el rendimiento de otras reglas de aprendizaje locales. En escenarios estándar, la retropropagación aún tenía una ventaja global, pero la precisión de la Proyección hacia Adelante quedó sorprendentemente cerca mientras usaba solo una única pasada de entrenamiento.

Los beneficios fueron más claros en escenarios de “pocos disparos” (few-shot), donde solo hay disponibles unos pocos ejemplos etiquetados, como suele ocurrir en la práctica clínica. Aquí, la Proyección hacia Adelante a menudo generalizó mejor que la retropropagación y que métodos locales competidores en radiografías de tórax, escaneos retinianos y subconjuntos pequeños de imágenes. La retropropagación tendía a sobreajustar los conjuntos diminutos o a no aprender características lo bastante ricas, mientras que la Proyección hacia Adelante produjo representaciones internas más estables y reutilizables. Desde el punto de vista computacional, entrenar una capa grande requirió órdenes de magnitud menos operaciones de multiplicar-y-acumular que ejecutar muchas épocas de retropropagación, lo que se traduce en aceleraciones sustanciales y menor coste energético.

Qué significa esto para la IA futura y la computación inspirada en el cerebro

En términos cotidianos, este trabajo muestra que las redes neuronales no tienen que depender de bucles de retroalimentación pesados y biológicamente implausibles para aprender representaciones internas útiles y comprensibles. Al combinar hábilmente entradas y etiquetas en una sola pasada hacia adelante y resolver los pesos en forma cerrada, la Proyección hacia Adelante ofrece una forma de entrenar modelos rápidamente, interpretar su funcionamiento interno y manejar conjuntos de datos biomédicos pequeños y ruidosos. Aunque la retropropagación sigue siendo el estándar de oro para muchas tareas a gran escala, este enfoque sin retroalimentación apunta hacia estrategias de aprendizaje más parecidas al cerebro y amigables con el hardware que podrían sustentar la próxima generación de sistemas de IA eficientes y explicables.

Cita: O’Shea, R., Rajendran, B. Closed-form feedback-free learning with forward projection. Nat Commun 17, 2414 (2026). https://doi.org/10.1038/s41467-026-69161-1

Palabras clave: aprendizaje sin retroalimentación, redes neuronales, entrenamiento con pocos ejemplos, IA biomédica, aprendizaje profundo explicable