Clear Sky Science · es

Computación cercana al sensor inspirada en la visión de los búhos

Ver en la oscuridad como un búho

Imagínese un dron capaz de localizar a un excursionista perdido o una nave espacial lejana sin usar focos, incluso bajo una luz estelar tan tenue que las cámaras ordinarias casi no perciben nada. Este artículo describe un nuevo hardware de visión inspirado en los búhos que acerca esa idea a la realidad. Imitando cómo los ojos del búho se adaptan a la oscuridad y cómo su cerebro procesa de manera eficiente señales débiles, los investigadores construyen una pequeña "sinapsis" electrónica que tanto detecta luz débil como realiza parte del cálculo necesario para el reconocimiento, directamente en el sensor.

Por qué las máquinas actuales tienen dificultades por la noche

La inteligencia artificial moderna puede reconocer rostros, objetos y escenas con una precisión impresionante, pero hacerlo suele requerir chips potentes que consumen enormes cantidades de energía. Las cámaras convencionales también separan la detección del cálculo: primero la cámara captura una imagen y después procesadores remotos analizan los datos. Con muy poca luz, estas cámaras normalmente fallan a menos que se ayuden con focos brillantes o intensas mejoras digitales. En contraste, el ojo y el cerebro de un búho trabajan conjuntamente: su retina acumula pequeñísimas entradas de fotones a lo largo del tiempo y sus circuitos neuronales se adaptan para que formas débiles se hagan visibles gradualmente. Los autores buscan llevar a la visión artificial una estrategia similar, estrechamente integrada y eficiente en energía.

Un dispositivo diminuto que aprende de la luz

En el núcleo del trabajo está una "sinapsis adaptativa de doble modo inspirada en el búho": un pequeño dispositivo basado en transistores que actúa tanto como sensor de luz como conexión de aprendizaje entre neuronas. El dispositivo se construye en capas: un electrodo inferior transparente, una película dieléctrica capaz de atrapar cargas, una mezcla absorbente de luz especialmente diseñada y un canal semiconductor orgánico en la parte superior. Cuando una luz tenue incide en la capa absorbente, se generan unos pocos portadores de carga que, guiados por un voltaje aplicado, quedan atrapados en el dieléctrico y se acumulan en el canal. Esto aumenta gradualmente la respuesta eléctrica del dispositivo, de forma semejante a cómo las células fotorreceptoras de bastón en la retina de un búho se vuelven más sensibles durante la adaptación a la oscuridad. Los autores demuestran que su dispositivo puede responder a intensidades de luz tan bajas como 0,146 nanovatios por centímetro cuadrado —aproximadamente tres órdenes de magnitud más débil que lo que manejan los chips de cámara estándar—, mostrando además una ganancia fuerte y ajustable que cuantifica su adaptación a la oscuridad.

Actuando como una sinapsis artificial

Más allá de la mera detección de luz, el dispositivo también imita cómo las sinapsis biológicas se fortalecen o debilitan con la actividad. Bajo pulsos de luz repetidos en un amplio rango de colores, desde ultravioleta hasta el cercano infrarrojo, la corriente del dispositivo aumenta en pasos duraderos, guardando una memoria del historial óptico. Con pulsos eléctricos aplicados a su compuerta, muestra potenciación y depresión a largo plazo —cambios graduales y reversibles en la conductancia que codifican "pesos" sinápticos en redes neuronales artificiales. Estos pesos se almacenan de forma no volátil, es decir, el dispositivo los recuerda sin necesidad de alimentación constante, y se pueden ajustar a múltiples niveles como un valor digital de varios bits. Crucialmente, cada evento sináptico consume del orden de 10 femtojulios de energía, comparable o incluso inferior a estimaciones para sinapsis biológicas, y varios órdenes de magnitud por debajo del presupuesto energético del hardware de IA típico.

De una sola sinapsis a un sistema de visión

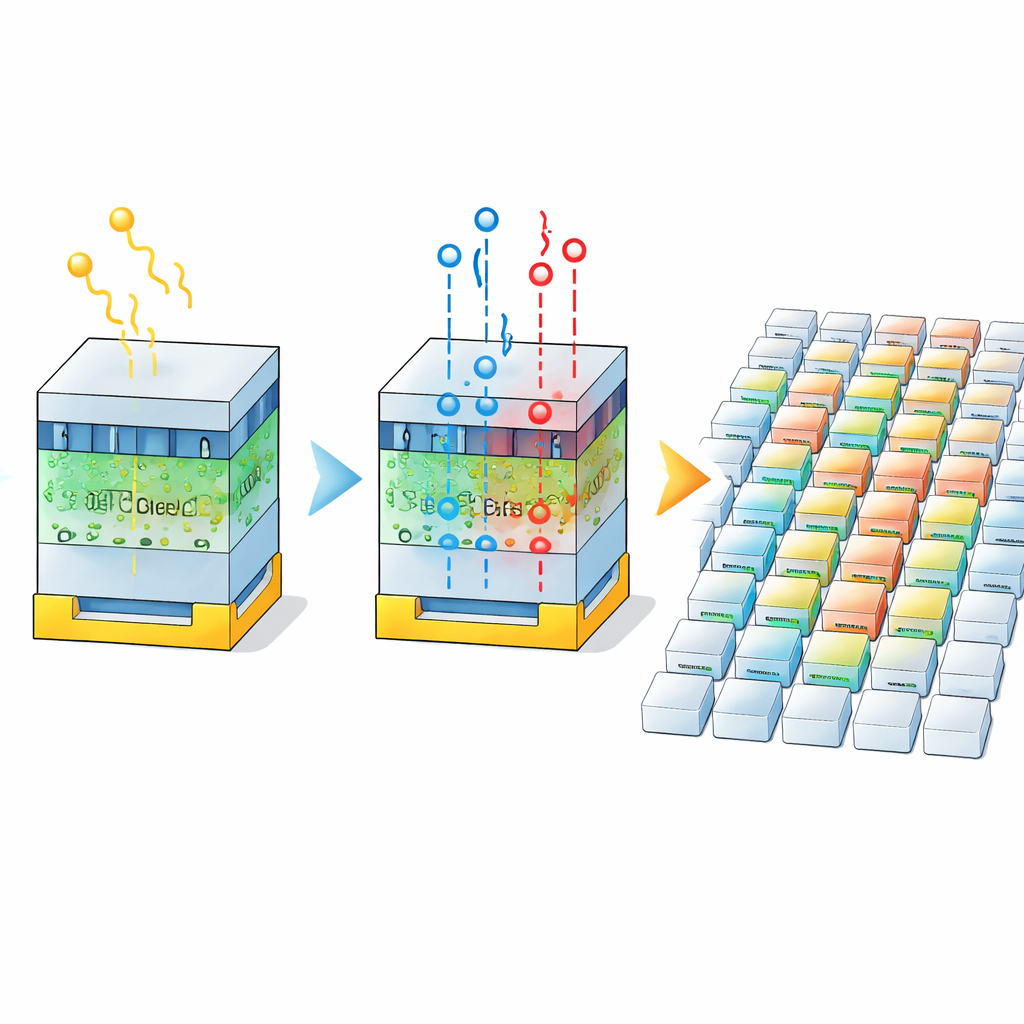

Para confirmar que este comportamiento se mantiene a escala, el equipo fabrica una matriz de 19 por 17 dispositivos y muestra que operan de forma uniforme. Cuando un patrón de luz tenue se proyecta sobre la matriz, las fotocorrientes en los puntos iluminados crecen gradualmente durante la adaptación, revelando formas previamente ocultas bajo una iluminación ultra-baja, de forma similar a como la retina de un búho agudiza una imagen en la oscuridad. Los autores mapean entonces los múltiples niveles de conductancia del dispositivo a pesos en modelos de aprendizaje automático, incluyendo perceptrones multicapa sencillos, redes convolucionales y una arquitectura profunda al estilo VGG. Incluso con pesos discretos relativamente toscos, estas redes simuladas alcanzan más del 90 por ciento de precisión en conjuntos de datos de imágenes estándar, demostrando que los estados sinápticos son suficientes para el cálculo práctico.

Visión nocturna para drones y más allá

Para ilustrar el potencial en el mundo real, los investigadores simulan un sistema de reconocimiento aire‑tierra montado en un pequeño dron, entrenado para detectar un objetivo con forma de prenda a diferentes niveles de brillo que corresponden a condiciones con luz estelar. Relacionando la respuesta temporal del dispositivo con el contraste de las imágenes captadas, construyen una etapa de preprocesado que "adapta" la imagen, aumentando el contraste útil mientras se mantiene dentro del comportamiento realista del sensor. Una red popular de detección de objetos (YOLOv5) entrenada con estos datos adaptados alcanza más del 95 por ciento de precisión incluso en el nivel de luz más bajo probado. En términos sencillos, el trabajo muestra que al combinar la adaptación nocturna al estilo de los búhos con aprendizaje sináptico integrado directamente en el sensor, es posible llevar la visión artificial a condiciones donde las cámaras tradicionales fallan, usando además mucha menos energía. Tal tecnología podría, en el futuro, sustentar drones de búsqueda y rescate, exploradores autónomos o instrumentos astronómicos que ven más sin iluminar tanto.

Cita: Zhao, Z., Cao, Y., Huang, S. et al. Owl-vision-inspired near sensor computing. Nat Commun 17, 2676 (2026). https://doi.org/10.1038/s41467-026-69123-7

Palabras clave: visión con poca luz, sensor neuromórfico, imagen inspirada en búhos, computación cercana al sensor, detección de objetos nocturna