Clear Sky Science · es

Colaboración humano‑IA para mejorar la precisión y la eficiencia del cribado de criterios de elegibilidad en ensayos oncológicos: un ensayo aleatorizado de evaluación usando historiales clínicos electrónicos retrospectivos

Por qué importa encontrar a los pacientes adecuados

Para muchas personas con cáncer, participar en un ensayo clínico puede abrir la puerta a tratamientos de vanguardia y mejores resultados. Sin embargo, solo una pequeña fracción de los adultos con cáncer llega a inscribirse. Un gran cuello de botella ocurre mucho antes de que un paciente firme el consentimiento: el personal debe revisar extensos y desordenados historiales médicos para ver quién siquiera cumple los requisitos. Este estudio plantea si emparejar a expertos humanos con un sistema de inteligencia artificial puede hacer ese cribado inicial más preciso—sin ralentizar el proceso.

Cómo funciona hoy el cribado para ensayos

Antes de que una persona pueda unirse a un ensayo oncológico, el personal de investigación clínica debe decidir si el paciente cumple decenas de reglas detalladas de inclusión, como tipo y estadio del cáncer, resultados de pruebas y su funcionalidad en el día a día. Gran parte de esta información está oculta en notas no estructuradas—informes de radiología, visitas de consulta, resúmenes de laboratorio—que con frecuencia son repetitivas, incompletas o contradictorias. Revisar manualmente estos documentos es lento y agotador, y aun el personal experimentado puede pasar por alto datos clave. Como resultado, algunos pacientes elegibles nunca son identificados y se pierden opciones potencialmente prolongadoras de vida.

Qué probaron los investigadores

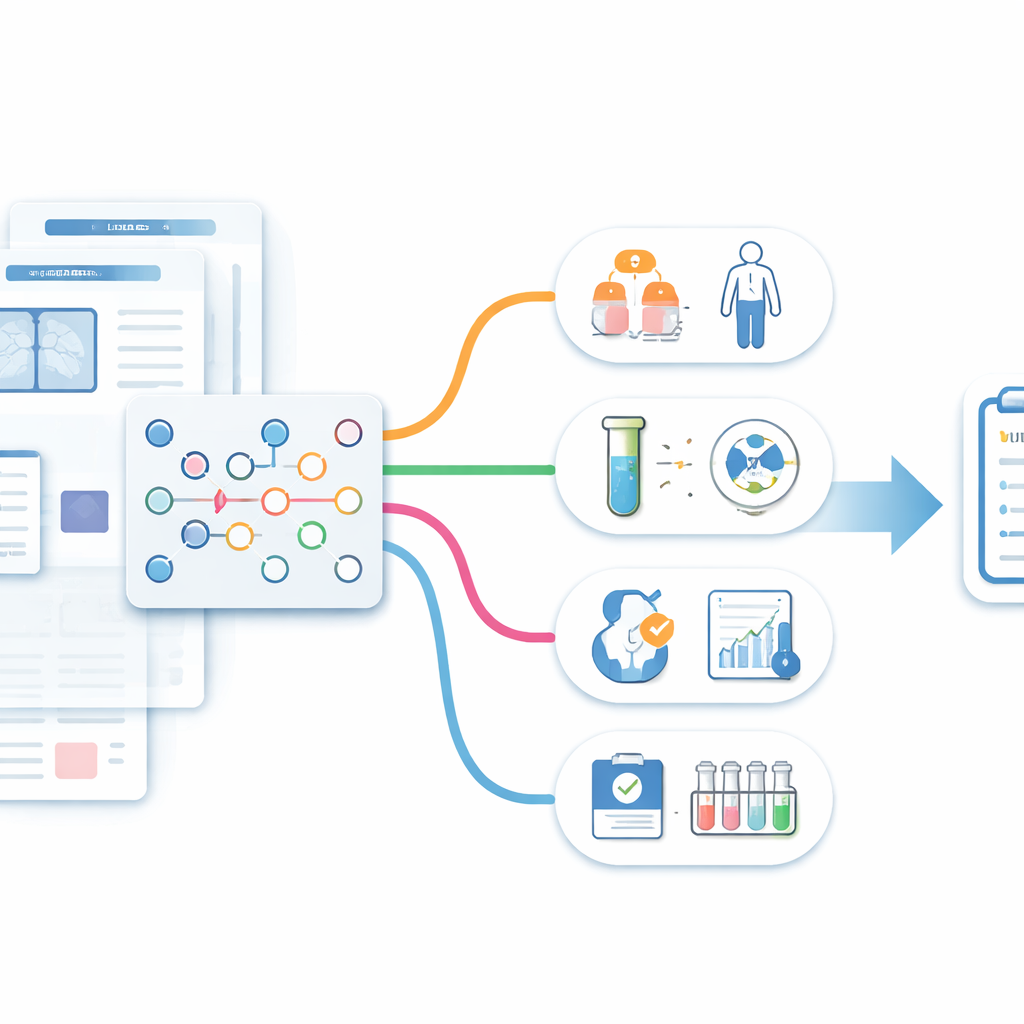

Para ver si la IA podía ayudar, el equipo usó registros electrónicos de 355 personas con cáncer de pulmón o colorrectal tratadas en una práctica comunitaria. Se centraron en 12 criterios comunes de ensayo, incluidos estadio tumoral, biomarcadores específicos, respuesta a tratamientos previos y estado de salud básico. Un sistema de lenguaje “neurosimbólico” especializado convirtió primero los documentos escaneados en texto y luego identificó hechos estructurados como resultados de pruebas y detalles de estadificación. Dos coordinadores de investigación capacitados revisaron cada historial dos veces—una con sugerencias de la IA en pantalla (el enfoque Humano+IA) y otra sin ellas (el enfoque Solo humano), en orden aleatorio. Un grupo separado de clínicos ya había creado una clave de respuestas “estándar de oro” para cada historial con la que juzgar la precisión.

Cómo rindió el equipo humano–IA

Cuando humanos e IA trabajaron juntos, coincidieron con las respuestas estándar de oro con más frecuencia que los humanos que trabajaron solos. En conjunto, el equipo Humano+IA acertó aproximadamente tres de cada cuatro detalles, frente a poco más de siete de cada diez para los revisores humanos solos, y muy por encima del sistema de IA por sí solo. Las mayores mejoras se dieron en áreas complejas como las pruebas y resultados de biomarcadores, la estadificación precisa del tumor y cómo había respondido el paciente a tratamientos previos. En estas categorías, la capacidad de la IA para tamizar grandes volúmenes de texto ayudó a los coordinadores a detectar información que de otro modo podrían pasar por alto, mientras que los humanos corrigieron errores de la IA e interpretaron casos inciertos.

Velocidad, compensaciones y sesgos humanos

Sorprendentemente, agregar IA no aceleró el proceso. Ambos enfoques tomaron poco más de media hora por historial en promedio. Los autores sugieren que, en lugar de ahorrar tiempo, la IA cambió la naturaleza del trabajo de los coordinadores: en lugar de buscar cada detalle por sí mismos, dedicaron más esfuerzo a comprobar e interpretar las entradas sugeridas por la IA. Esto puede ser en realidad una salvaguardia saludable, reduciendo el riesgo de que las personas acepten sin cuestionar las respuestas de la máquina. El estudio también analizó dónde puede fallar la colaboración. En una medida de la funcionalidad del paciente, la IA fue poco fiable, y los revisores humanos que se apoyaron en exceso en su salida rindieron algo peor—una señal de “sesgo de automatización”. En otras áreas, los humanos parecieron subutilizar señales precisas de la IA, lo que sugiere un “sesgo de confirmación”, en el que las personas prefieren información que coincide con sus impresiones iniciales.

Qué implica esto para la atención oncológica futura

En términos simples, este ensayo muestra que una asociación bien diseñada entre personas e IA puede hacer que el cribado inicial de ensayos sea algo más preciso sin ralentizarlo. Las mejoras son modestas, pero se concentran precisamente en los tipos de detalles complejos—como el estado de biomarcadores y la estadificación precisa—que a menudo deciden si un paciente puede unirse a un estudio. Si tales sistemas se refinan y prueban más en flujos de trabajo clínicos en vivo, podrían ayudar a descubrir más pacientes elegibles, ampliar quién tiene acceso a ensayos oncológicos de vanguardia y hacerlo manteniendo a los humanos firmemente a cargo de las decisiones finales.

Cita: Parikh, R.B., Kolla, L., Beothy, E.A. et al. Human-AI teaming to improve accuracy and efficiency of eligibility criteria prescreening for oncology trials: a randomized evaluation trial using retrospective electronic health records. Nat Commun 17, 2306 (2026). https://doi.org/10.1038/s41467-026-68873-8

Palabras clave: ensayos clínicos de cáncer, historiales clínicos electrónicos, inteligencia artificial, elegibilidad del paciente, colaboración humano‑IA