Clear Sky Science · es

Entrenar sensores táctiles para que aprendan la detección de fuerzas entre sí

Robots que pueden sentir y compartir su sentido del tacto

A medida que los robots salen de las fábricas y entran en hogares, hospitales y almacenes, necesitan un sentido que normalmente damos por sentado: el tacto. Así como nuestros dedos se ajustan automáticamente al coger una patata frita frente a una caja pesada, los robots del futuro deben aprender cuánto apretar y cuándo un objeto está a punto de deslizarse. Este artículo presenta una nueva forma para que la «piel» robótica aprenda la detección de fuerzas de otras pieles, reduciendo la costosa calibración y acercando a las máquinas a una destreza más parecida a la humana.

Por qué es tan difícil acertar con el tacto robótico

Los robots modernos ya disponen de muchos tipos de piel artificial. Algunos usan pequeñas cámaras que miran dentro de geles blandos, otros se basan en imanes o en redes electrónicas que detectan presión. Cada diseño sobresale en ciertas tareas, pero todos hablan diferentes «dialectos» del tacto: la misma presión en dos sensores puede producir señales muy distintas. Hoy en día, cada nuevo sensor suele necesitar su propio y laborioso proceso de entrenamiento con medidores de fuerza precisos, repetido miles de veces. Peor aún, los materiales blandos envejecen y se desgastan, por lo que esta costosa calibración debe repetirse cada vez que se reemplaza un sensor.

Tomando una página del cerebro humano

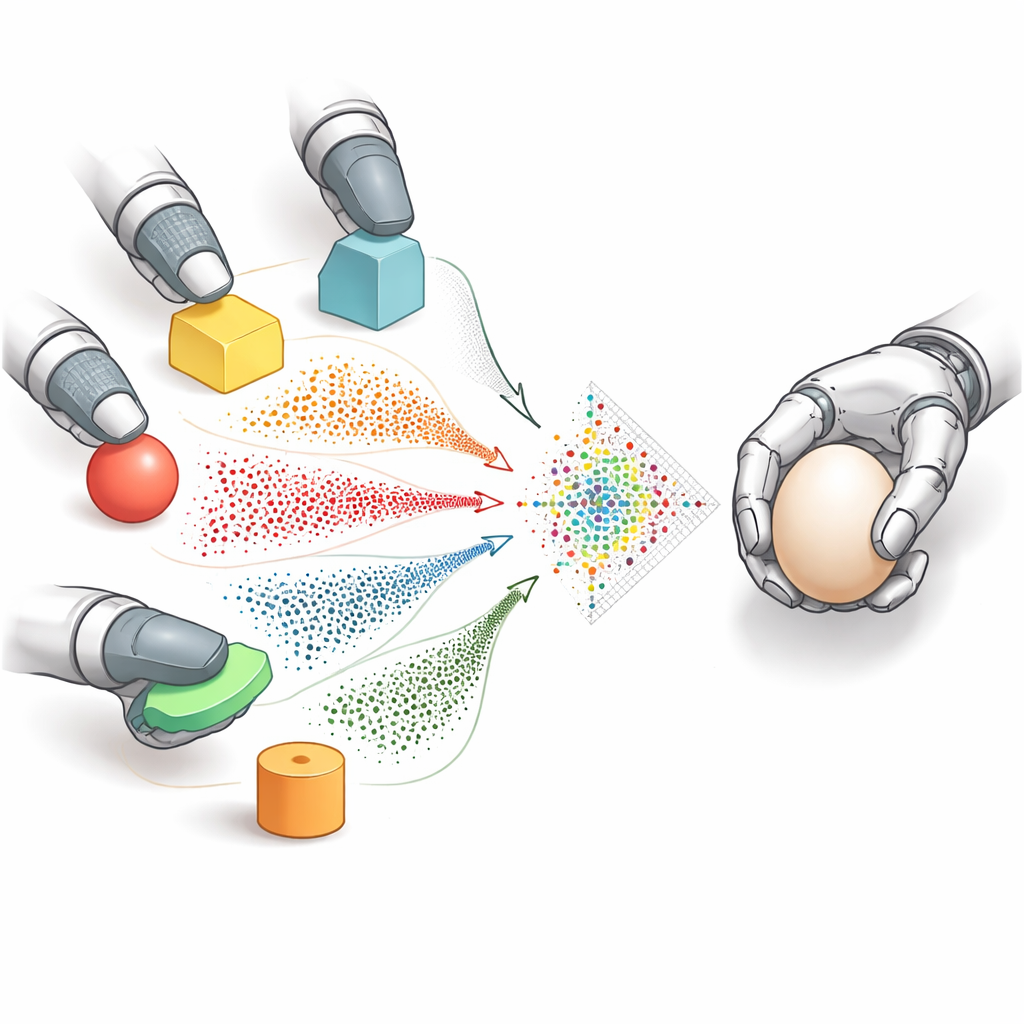

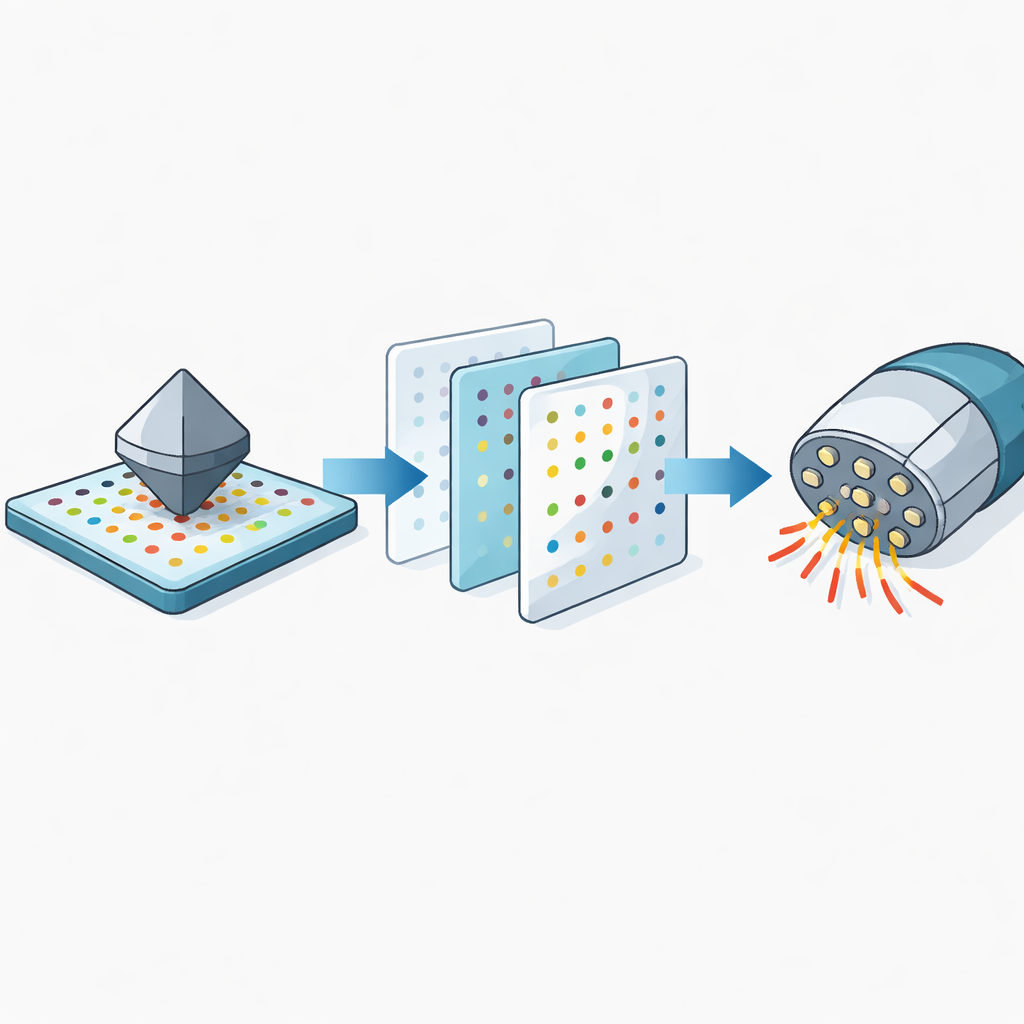

Los humanos resuelven un problema similar sin esfuerzo. Nuestra piel está llena de distintos tipos de receptores táctiles, pero el cerebro convierte todas sus señales en un código interno compartido. Esa memoria táctil unificada nos permite estimar cómo se sentiría algo en una parte de la mano que nunca lo ha tocado antes, simplemente recurriendo a la experiencia previa. Los investigadores detrás de este trabajo imitan esa idea en robots. Convierten todas las salidas de los sensores —imágenes de cámara, lecturas magnéticas o señales electrónicas— en una forma común parecida a una imagen hecha de puntos, que representan cómo se deforma la piel. Esta representación compartida de marcadores actúa como un sencillo «lenguaje del tacto» que cualquier sensor puede usar.

Enseñar a un sensor a imitar a otro

Una vez que todos los sensores hablan este lenguaje basado en puntos, el equipo introduce un paso de traducción llamado traducción marcador-a-marcador. Utilizando potentes modelos generativos, entrenan un sistema capaz de transformar el patrón de puntos de un sensor en el patrón que habría mostrado otro sensor bajo el mismo contacto. Eso significa que un sensor bien calibrado puede efectivamente «imaginar» lo que sentiría un sensor sin calibrar y generar datos sintéticos de entrenamiento para este. Un segundo modelo examina entonces secuencias cortas de estas imágenes de puntos para predecir cómo cambian las fuerzas con el tiempo en tres direcciones, teniendo en cuenta tanto la compresión como el cizallamiento lateral.

Manejar las diferencias reales en piel blanda

En la práctica, las diferentes pieles robóticas no solo tienen formas y conexiones distintas; también están hechas de materiales que pueden ser más blandos o más rígidos, y que cambian con el envejecimiento. Estas diferencias pueden distorsionar las estimaciones de fuerza incluso si los patrones parecen similares. Los investigadores miden cómo se dobla cada tipo de material blando bajo carga y construyen un paso de corrección simple que escala las etiquetas de fuerza hacia arriba o hacia abajo antes del entrenamiento. Esta compensación de material reduce considerablemente los errores, especialmente al transferir conocimiento entre pieles muy blandas y muy rígidas.

Del banco de laboratorio a la manipulación cotidiana

El equipo prueba su método, llamado GenForce, en una amplia mezcla de sensores, desde múltiples copias del mismo panel basado en cámara hasta diseños muy diferentes que usan imanes o formas curvadas tipo yema de dedo. En más de 200 combinaciones en simulación y con hardware, GenForce reduce drásticamente los errores de predicción en comparación con reutilizar simplemente un modelo entrenado en otro sensor. En las demostraciones, una mano robótica equipada con distintas pieles táctiles en cada dedo utiliza modelos transferidos para sujetar con delicadeza objetos frágiles como fruta y patatas, y para detectar y corregir objetos que se deslizan coordinando las lecturas de ambos lados de una presa.

Qué significa esto para el futuro de las manos robóticas

Al permitir que los sensores táctiles aprendan la detección de fuerzas entre sí en lugar de empezar desde cero, GenForce apunta a manos robóticas que sean más fáciles y baratas de desplegar a gran escala. Un único sensor cuidadosamente calibrado podría entrenar a muchos otros, incluso de diseños distintos, y los modelos preentrenados podrían ajustarse con solo una pequeña cantidad de datos nuevos. Para los no especialistas, la conclusión es simple: este trabajo hace más práctico que los robots sientan cuánto aprietan y respondan rápidamente cuando los objetos comienzan a deslizarse, acercándonos a máquinas que manejan el mundo real con el mismo tacto seguro que las manos humanas.

Cita: Chen, Z., Ou, N., Zhang, X. et al. Training tactile sensors to learn force sensing from each other. Nat Commun 17, 2101 (2026). https://doi.org/10.1038/s41467-026-68753-1

Palabras clave: tacto robótico, sensores táctiles, detección de fuerzas, manipulación robótica, aprendizaje por transferencia