Clear Sky Science · es

Percepción visual ultrarrápida más allá de las capacidades humanas habilitada por el análisis de movimiento mediante transistores sinápticos

Por qué importa una visión robótica más rápida

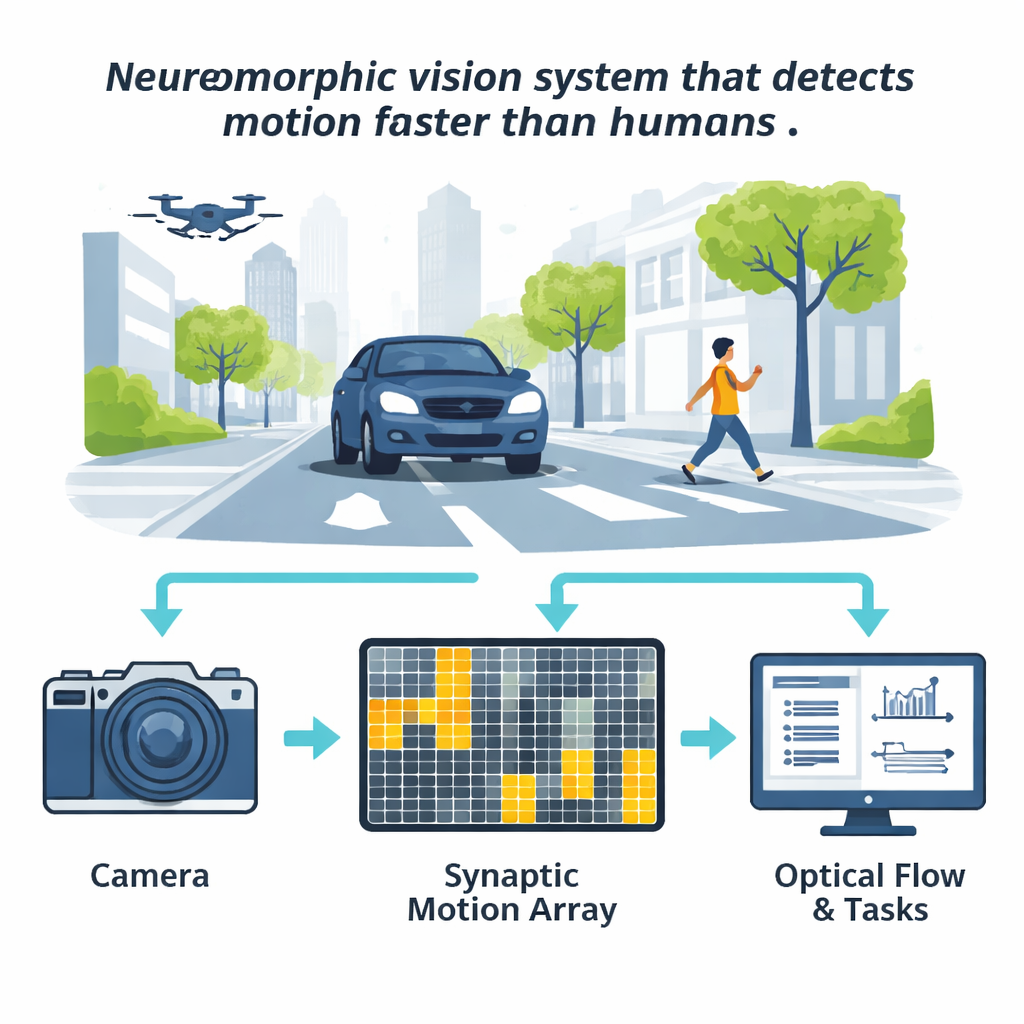

Cuando el sistema de conducción autónoma de un coche o un dron reacciona incluso una fracción de segundo demasiado tarde, las consecuencias pueden ser graves. Los mejores algoritmos de visión por ordenador actuales pueden igualar o superar a los humanos en pruebas estándar, pero aún tardan demasiado en procesar cada fotograma de vídeo en tiempo real. Este artículo presenta un nuevo tipo de hardware visual, inspirado en el cerebro, que permite a las máquinas detectar movimiento mucho más rápido que los humanos, sin sacrificar la precisión.

Cómo enseñamos normalmente a las máquinas a ver el movimiento

El análisis de movimiento convencional se basa en una técnica llamada flujo óptico, que estima cómo se desplaza cada punto de una imagen de un fotograma al siguiente. Funciona bien, pero es computacionalmente costosa: para una imagen de alta definición completa, una potente tarjeta gráfica puede necesitar más de medio segundo para finalizar la tarea. En escenarios de movimiento rápido como la conducción por autopista, ese retraso puede traducirse en decenas de metros recorridos antes de que el sistema reconozca un peligro. A diferencia del sistema visual humano, que rápidamente se centra en las partes más relevantes de una escena, los algoritmos estándar procesan escrupulosamente cada píxel, incluso en regiones de fondo estático que aportan poca información útil.

Tomando prestada una estrategia de las primeras etapas de la visión del cerebro

La biología resuelve este problema usando capas de filtrado tempranas en el ojo y en el tálamo para resaltar dónde ocurre el cambio y atenuar todo lo demás. Los autores imitan esta idea en silicio construyendo un módulo neuromórfico de «atención temporal». Una cámara estándar sigue capturando las imágenes, pero sus cambios de brillo también se alimentan a una cuadrícula compacta de transistores sinápticos: dispositivos electrónicos que se comportan de forma algo parecida a conexiones ajustables en el cerebro. Cada dispositivo acumula localmente cuánto ha cambiado la luz en su región asignada durante una ventana temporal corta. Los parches de la cuadrícula que detectan cambios fuertes se iluminan como regiones de interés, mientras que las áreas más tranquilas pasan a un segundo plano.

Transistores inteligentes que recuerdan el movimiento

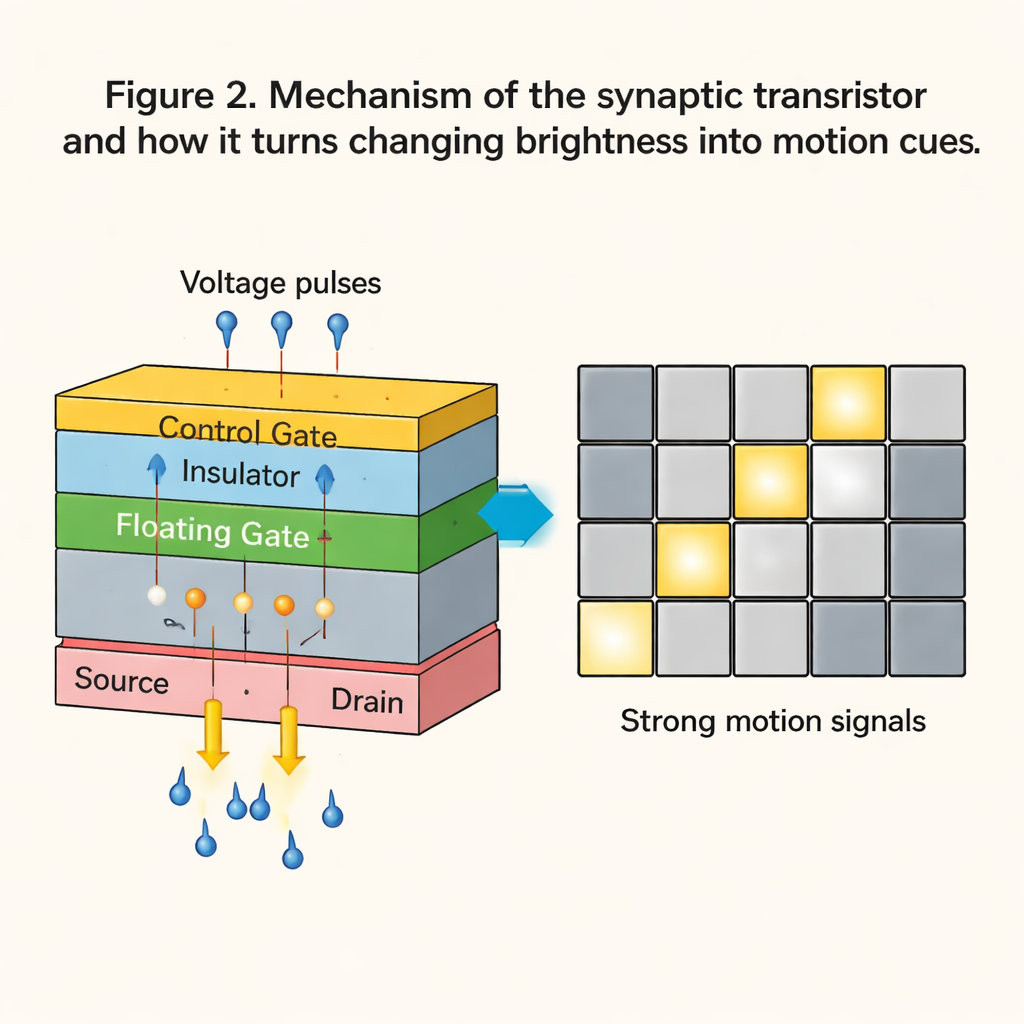

En el núcleo de este sistema hay un transistor sináptico de puerta flotante especialmente diseñado, construido a partir de materiales en capas de grosor atómico. Aplicando pulsos de voltaje breves, se puede ajustar la conductancia del dispositivo y mantenerla durante horas, almacenando efectivamente una memoria de la actividad visual reciente. Los transistores responden en unos 100 microsegundos —lo bastante rápido para vídeo de alta velocidad— y soportan miles de ciclos de actualización sin degradarse. El equipo escaló un único dispositivo hasta una matriz de 4×4 y demostró cómo los cambios de brillo de la cámara se convierten en pulsos de voltaje que empujan selectivamente algunas celdas a estados de alta conductancia «de movimiento» mientras suprimen parpadeos y ruido menores.

Concentrar el cómputo pesado solo donde importa

La salida de la matriz se convierte en un «mapa de calor» grueso del movimiento que marca regiones compactas de interés. En lugar de ejecutar código de flujo óptico costoso sobre toda la imagen, el sistema solo analiza esas áreas resaltadas, con un pequeño margen a su alrededor. Los autores demuestran que este enfoque se integra directamente con varios métodos populares de flujo óptico, desde algoritmos clásicos como Farneback hasta modelos modernos de aprendizaje profundo como RAFT y GMFlow. En pruebas con coches, drones, brazos robóticos y deportes rápidos como el tenis de mesa, el frente neuromórfico reduce de forma rutinaria el tiempo dedicado a la estimación de movimiento y a tareas posteriores —como predecir hacia dónde se moverá un objeto, segmentar objetos en movimiento del fondo o seguir un objetivo— en aproximadamente un factor de cuatro.

Superar la reacción humana sin perder precisión

De forma crucial, esta aceleración no compromete la fiabilidad. Al proporcionar información adicional sobre dónde es probable que haya movimiento, las señales temporales suelen mejorar la precisión, especialmente en el seguimiento de objetos y la segmentación en escenas congestionadas. En escenarios con vehículos y drones pequeños, las métricas de rendimiento de las tareas más que se duplicaron en comparación con las canalizaciones convencionales, mientras que los tiempos totales de procesamiento cayeron a decenas de milisegundos —a la par o mejor que los tiempos de reacción humanos típicos de unos 150 milisegundos. Los autores sostienen que este frente de detección de movimiento neuromórfico puede combinarse con muchos algoritmos de visión existentes, e incluso con detectores de objetos más allá del flujo óptico, para ofrecer a robots, vehículos y máquinas interactivas una forma mucho más rápida y focalizada de entender entornos dinámicos.

Cita: Wang, S., Zhao, J., Pu, T. et al. Ultrafast visual perception beyond human capabilities enabled by motion analysis using synaptic transistors. Nat Commun 17, 1215 (2026). https://doi.org/10.1038/s41467-026-68659-y

Palabras clave: visión neuromórfica, flujo óptico, transistores sinápticos, percepción robótica, conducción autónoma