Clear Sky Science · es

Computación analógica en memoria para la factorización de matrices no negativas

Por qué importa dividir los grandes datos en partes

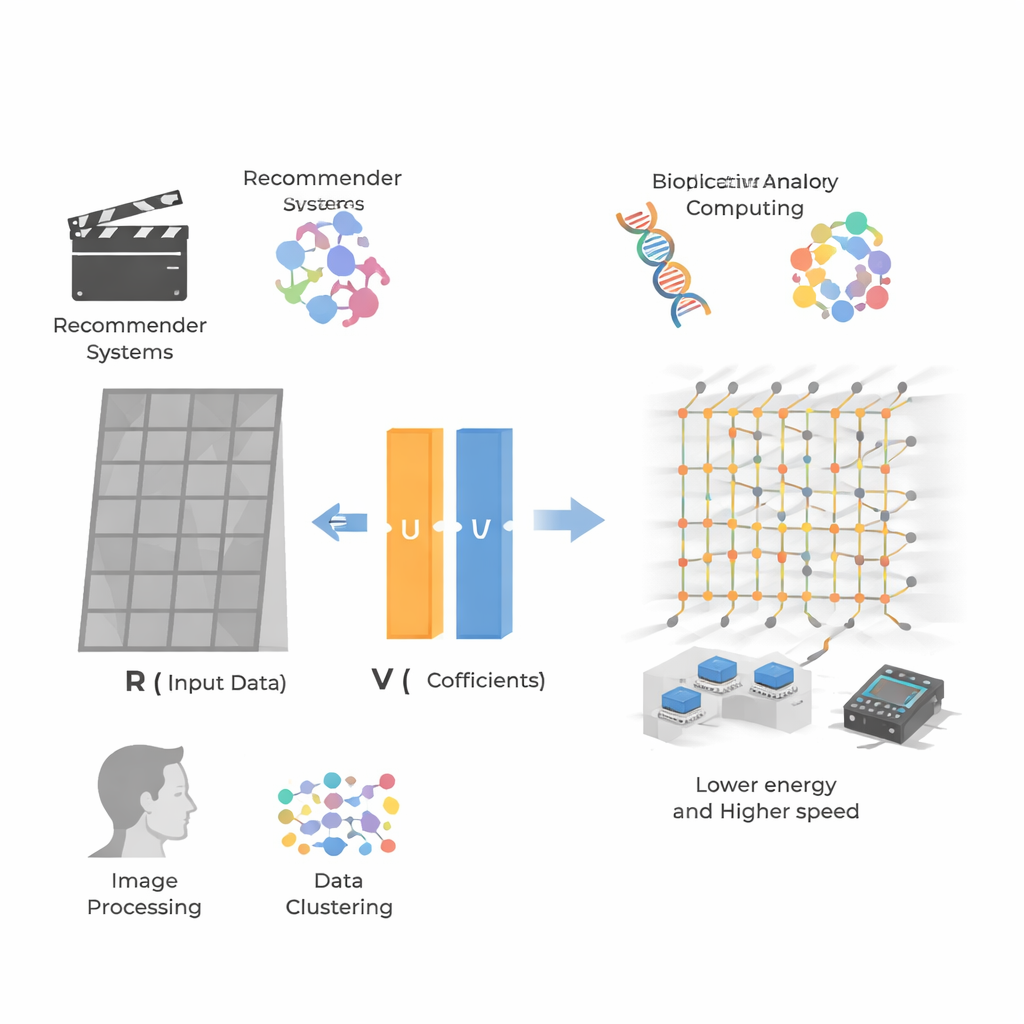

Servicios cotidianos como las recomendaciones de películas, las aplicaciones fotográficas y el análisis genético dependen de encontrar patrones ocultos dentro de enormes tablas de números. Una técnica popular para ello es la factorización de matrices no negativas, que descompone una gran tabla de datos en bloques más simples que resultan más fáciles de interpretar. Pero a medida que los conjuntos de datos crecen hasta abarcar millones de usuarios, elementos o píxeles, los chips digitales actuales pueden tener dificultades para mantener el procesamiento en tiempo real. Este artículo muestra cómo un enfoque analógico de computación en memoria puede realizar este pesado trabajo matemático mucho más rápido y con mucha menos energía, abriendo la puerta a servicios impulsados por IA más receptivos y eficientes.

Extraer patrones de tablas gigantes

En el núcleo del trabajo está la factorización de matrices no negativas (NMF), un método que toma una gran matriz de números no negativos —como las valoraciones usuario‑película o los valores de píxeles de una imagen— y la reescribe como el producto de dos matrices más pequeñas. Una matriz representa características ocultas (por ejemplo, la preferencia de un usuario por la acción frente al romance) y la otra representa la intensidad con la que cada elemento o píxel exhibe esas características. Como todos los valores permanecen no negativos, estas características tienden a parecer piezas intuitivas: componentes faciales en imágenes o perfiles de preferencia en datos de recomendación. Esto hace que la NMF sea popular en sistemas de recomendación, bioinformática, procesamiento de imágenes y clustering, pero también la vuelve muy exigente computacionalmente para conjuntos de datos muy grandes y dispersos.

Por qué los chips digitales se topan con un límite

Los procesadores tradicionales —CPUs, GPUs e incluso FPGAs— tratan las operaciones matriciales como largas secuencias de pasos básicos, moviendo datos de un lado a otro entre la memoria y las unidades de cálculo. Para problemas modestos esto funciona bien, pero para conjuntos de datos modernos con millones de filas y columnas el coste en tiempo y energía se vuelve enorme. La desaceleración de la ley de Moore y el llamado cuello de botella de von Neumann, donde el acceso a memoria domina el consumo y la latencia, hacen cada vez más difícil escalar la NMF a aplicaciones en tiempo real como recomendaciones en directo o análisis rápido de imágenes. Incluso los algoritmos digitales ingeniosos siguen enfrentando complejidad en tiempo polinómico y un intenso tráfico de memoria siempre que las matrices deben actualizarse repetidamente.

Calcular dentro de la memoria con señales analógicas

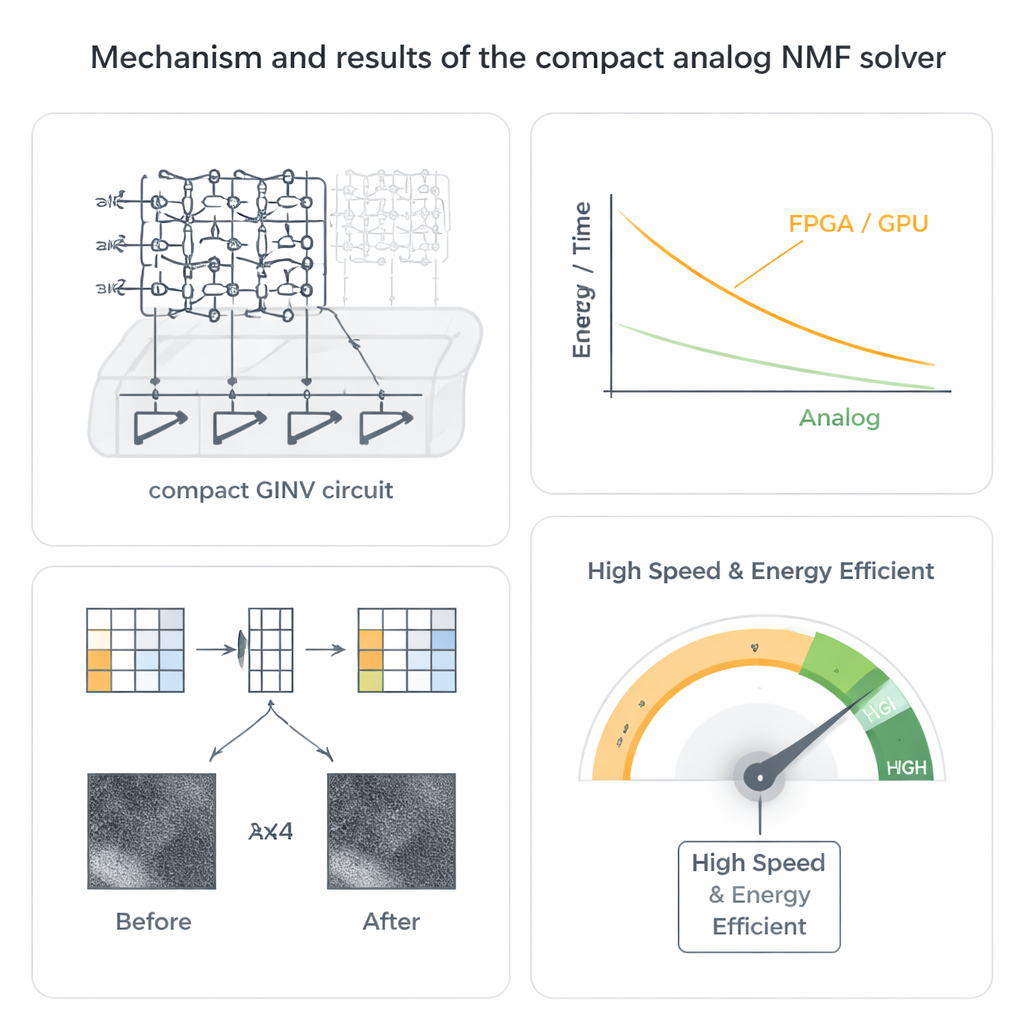

Los autores toman una ruta distinta usando computación matricial analógica basada en dispositivos de memoria resistiva conocidos como memristores. Estos dispositivos pueden disponerse en arreglos cruzados densos donde cada cruce almacena un valor de conductancia. Cuando se aplican voltajes a un lado de la matriz, las corrientes que fluyen por el otro lado realizan naturalmente muchas operaciones de multiplicar y sumar en paralelo. Al conectar estas matrices en un bucle cerrado con un pequeño número de amplificadores operacionales, el equipo construye un circuito inverso generalizado compacto (GINV) que resuelve problemas de regresión completos en esencialmente un paso analógico, en lugar de en muchas iteraciones digitales. Refinan el diseño con un esquema de compensación de conductancia que mantiene el circuito estable mientras reduce drásticamente el número de amplificadores, ahorrando área del chip y energía.

Del truco matemático al hardware funcional

Para hacer esto práctico en NMF, los investigadores emparejan su circuito GINV compacto con una estrategia bien conocida llamada mínimos cuadrados no negativos alternos. En lugar de intentar resolver ambas matrices de factores a la vez —un problema no convexo y difícil— el método mejora alternadamente una matriz mientras mantiene la otra fija, dividiendo la tarea en una cadena de problemas de regresión no negativa más simples que el circuito analógico puede resolver. Fabrican arreglos de memristores de óxido de hafnio y construyen una plataforma con placa de circuito impreso, y después demuestran dos aplicaciones clave. Para la compresión de imágenes, una fotografía de una nebulosa se divide en pequeños parches que se factorizan, reduciendo a la mitad el almacenamiento mientras se reproduce la imagen con solo una ligera pérdida en la calidad visual. Para sistemas de recomendación, factorizaron datos de valoraciones usuario‑ítem como el conjunto MovieLens 100k, prediciendo con precisión valoraciones faltantes aunque la matriz sea extremadamente dispersa.

Velocidad, eficiencia y robustez en el mundo real

Más allá de la corrección básica, el solucionador analógico muestra notables ventajas en velocidad y energía. Dado que la corriente a través de la matriz cruzada representa muchas operaciones realizadas a la vez, el tiempo para resolver un problema de regresión se vuelve casi independiente del tamaño de la matriz, en marcado contraste con los métodos digitales. Estimaciones a nivel de sistema sugieren aceleraciones que van desde cientos hasta miles de veces frente a implementaciones avanzadas en FPGA y GPU, junto con mejoras de varios órdenes de magnitud en eficiencia energética. Tal vez sorprendentemente, la naturaleza analógica del hardware no es una debilidad sino una fortaleza: el algoritmo NMF tolera naturalmente el ruido del dispositivo y errores de programación, y en simulaciones la calidad final de las imágenes y las recomendaciones se mantiene alta incluso cuando los valores subyacentes de los memristores son bastante imprecisos o derivan con la temperatura.

Qué significa esto para la tecnología cotidiana

En términos sencillos, el estudio muestra que un nuevo tipo de “calculadora en memoria” puede manejar una de las herramientas de trabajo fundamentales de la ciencia de datos moderna mucho más rápido y de manera más eficiente que los chips digitales actuales. Al integrar la factorización matricial directamente en circuitos analógicos compactos, servicios como recomendaciones en streaming, clasificación personalizada de contenidos y procesamiento de imágenes en el dispositivo podrían finalmente ejecutarse en tiempo real consumiendo mucha menos energía. El trabajo proporciona tanto un plano de circuito como una prueba experimental de que dicha computación analógica en memoria puede abordar conjuntos de datos realistas con precisión cercana al software de precisión completa, apuntando a hardware futuro que pueda cribar flujos masivos de datos tan fácilmente como la luz atraviesa el vidrio.

Cita: Wang, S., Luo, Y., Zuo, P. et al. In-memory analog computing for non-negative matrix factorization. Nat Commun 17, 1881 (2026). https://doi.org/10.1038/s41467-026-68609-8

Palabras clave: computación analógica en memoria, factorización de matrices no negativas, matriz cruzada de memristores, compresión de imágenes, sistemas de recomendación