Clear Sky Science · es

La memoria mosaico de los modelos de lenguaje grandes

Por qué importan las copias casi idénticas

Los modelos de lenguaje grandes como ChatGPT aprenden a partir de océanos de texto y, a veces, memorizan fragmentos de ese texto. Eso plantea preocupaciones sobre la privacidad, los derechos de autor y la equidad a la hora de evaluar lo que realmente saben estos sistemas. Este artículo muestra que la memorización no se limita al copia‑pega literal. En cambio, los modelos pueden reconstruir pasajes a partir de muchas versiones ligeramente diferentes, como si ensamblaran un mosaico. Entender este tipo oculto de memoria es crucial para quien se preocupe por una IA segura y fiable.

Una nueva manera de pensar la memoria de las máquinas

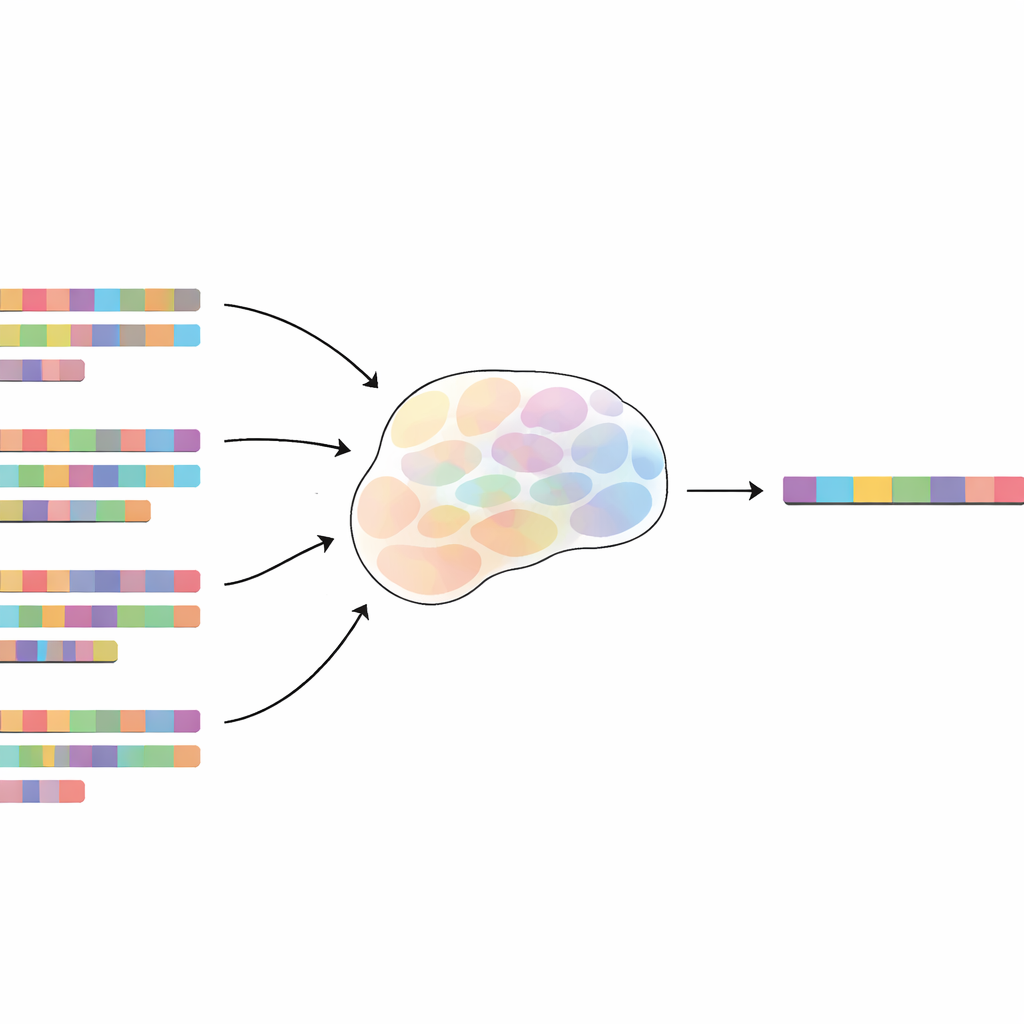

La mayoría presupone que un modelo de lenguaje solo memoriza algo si ve exactamente la misma frase repetidamente. Los autores cuestionan esa visión al introducir la “memoria mosaico”. Según este enfoque, un modelo puede memorizar un pasaje de 100 palabras no solo por repeticiones exactas, sino también por muchas duplicaciones difusas, versiones en las que faltan, cambian o se reordenan algunas palabras. Para estudiar esto con rigor, insertan frases de prueba artificiales, llamadas canarios, en los datos de entrenamiento del modelo, junto con muchas versiones alteradas. Tras el entrenamiento, miden lo fácil que es determinar si un canario concreto estuvo en el conjunto de entrenamiento, usando una especie de prueba de privacidad llamada ataque de inferencia de membresía.

Cómo las copias difusas siguen dejando una huella clara

Al comparar duplicados difusos con repeticiones exactas, los investigadores definen un “equivalente de duplicado exacto”: cuánto contribuye una copia difusa a la memorización en comparación con una copia perfecta. Hallan que incluso cambios muy leves apenas debilitan la memorización. Si solo alrededor del 10% de las palabras en cada duplicado se reemplazan al azar, una sola copia difusa todavía contribuye aproximadamente entre el 60% y el 65% de lo que aporta una copia exacta. Incluso cuando la mitad de las palabras se cambian, cada versión alterada sigue contando en torno al 15–20% de una copia completa. El efecto es robusto: añadir palabras de relleno aleatorias entre frases clave o barajar fragmentos de la oración reduce la memorización, pero no la elimina. El modelo parece capaz de saltarse el ruido, centrarse en fragmentos superpuestos y coserlos de nuevo.

La forma por encima del significado en lo que los modelos almacenan

Dado que los modelos modernos pueden resolver problemas matemáticos, seguir instrucciones y traducir entre idiomas, podría esperarse que sus memorias se basen en el significado. Sorprendentemente, el estudio encuentra lo contrario. Cuando los autores reemplazan palabras por alternativas que conservan el sentido de la frase, la memorización mejora solo ligeramente en comparación con reemplazarlas por palabras aleatorias. Las paráfrasis generadas por otros sistemas de IA —que preservan la idea pero cambian muchos detalles superficiales— contribuyen relativamente poco a la memorización a menos que aún compartan muchas secuencias cortas de tokens con el pasaje original. En una batería de pruebas, lo que realmente impulsa la memoria es la superposición en tokens exactos (las unidades básicas del modelo), no las ideas compartidas. En otras palabras, la memoria mosaico del modelo se refiere principalmente a la forma, no al significado.

Duplicados ocultos en datos de entrenamiento del mundo real

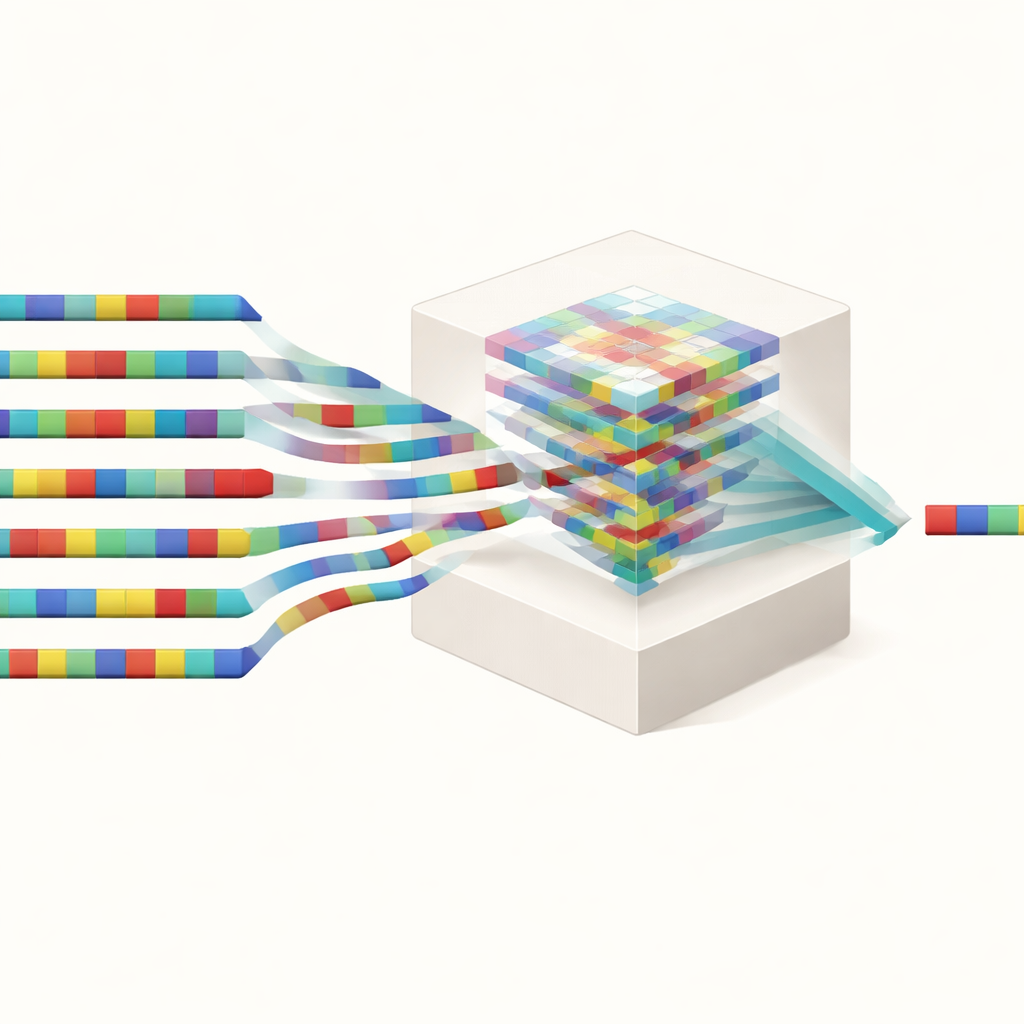

Los autores se preguntan entonces cuán comunes son los duplicados difusos en un conjunto web popular y muy limpiado usado para entrenar modelos, conocido como SlimPajama. Aunque este conjunto ya ha tenido documentos casi idénticos eliminados, el equipo descubre que muchas secuencias de 100 tokens que aparecen exactamente 1.000 veces también tienen miles de versiones casi fallidas. Para pequeñas distancias de edición —aproximadamente el 10% de caracteres cambiados— hay de media unas 4 veces más duplicados difusos que exactos, y decenas de miles más a distancias mayores pero aún influyentes. Importa que las técnicas estándar de “desduplicación” usadas en la industria, que suelen eliminar solo solapamientos largos y exactos, dejan intactas la mayoría de estas copias difusas. Eso significa que los modelos aún pueden memorizar material sensible o con derechos de autor ensamblándolo a partir de muchas fuentes ligeramente alteradas.

Por qué esto importa para la privacidad, la equidad y el control

Estos hallazgos tienen implicaciones de gran alcance. Para la privacidad, muestran que simplemente eliminar repeticiones exactas de los datos de entrenamiento no basta: información personal o confidencial puede memorizarse a través de familias de pasajes similares. Para el derecho de autor y la evaluación de benchmarks, los duplicados difusos pueden llevar a que los modelos reproduzcan textos protegidos o inflen artificialmente las puntuaciones en pruebas que en la práctica han visto disfrazadas. Para los esfuerzos de “desaprendizaje” de datos específicos, no es suficiente borrar un ejemplo ofensivo si quedan muchas variantes. En conjunto, el trabajo revela que la memoria de los modelos de lenguaje es un mosaico complejo construido a partir de muchos pequeños solapamientos, lo que desafía las herramientas de seguridad actuales y pide formas más inteligentes y finas de limpiar y auditar los datos de entrenamiento.

Cita: Shilov, I., Meeus, M. & de Montjoye, YA. The mosaic memory of large language models. Nat Commun 17, 2142 (2026). https://doi.org/10.1038/s41467-026-68603-0

Palabras clave: memorización de modelos de lenguaje, duplicados difusos, privacidad de los datos, desduplicación de datos de entrenamiento, contaminación de benchmarks