Clear Sky Science · es

Reconocimiento de características en imágenes SEM de grabado por plasma profundo mediante un autoencoder variacional con restricciones físicas

Chips más nítidos gracias a una imagen más inteligente

Cada smartphone, sensor de airbag de un coche y microneedle médico depende de diminutas estructuras tridimensionales talladas en profundidad en silicio. Fabricar estas características limpias, lisas y reproducibles es complicado, y comprobar su calidad con un microscopio electrónico lo es aún más. Este artículo presenta una nueva herramienta de inteligencia artificial capaz de leer estas imágenes microscópicas de forma automática y con mucha más precisión que los humanos, lo que promete una producción de microdispositivos avanzados más rápida, barata y fiable.

Por qué es tan difícil grabar ranuras profundas y pequeñas

Los sistemas microelectromecánicos modernos (MEMS) dependen de zanjas profundas y estrechas grabadas en silicio mediante un proceso llamado grabado por plasma reactivo profundo. Los ingenieros desean paredes casi perfectamente verticales y lisas, pero en la práctica las paredes laterales desarrollan ondulaciones, protuberancias y otras deformaciones a medida que el plasma alterna entre ciclos de tallado y de recubrimiento. Pequeños cambios en el tiempo de los ciclos, el flujo de gas, la temperatura o el envejecimiento de la herramienta pueden convertir una receta buena en una mala, y esos cambios se manifiestan como diferencias sutiles en el perfil de la zanja que sólo son visibles en secciones transversales realizadas con microscopía electrónica de barrido (SEM).

El cuello de botella de la lectura humana de imágenes

Hoy, la evaluación de estas estructuras grabadas es mayoritariamente un oficio manual. Los ingenieros cortan obleas, toman cientos de imágenes SEM y luego trazan bordes y miden profundidades y anchuras en el ordenador con gran detalle. Cada imagen puede llevar una hora o más de análisis, y distintas personas suelen discrepar entre un 15 y un 20 por ciento sobre la misma característica. Métodos automáticos simples y herramientas de aprendizaje automático anteriores, como redes neuronales convencionales, pueden acelerar el proceso, pero tienen dificultades con las imágenes ruidosas y de bajo contraste típicas de zanjas profundas y con frecuencia no captan cómo cambia la estructura con la profundidad. Como resultado, el análisis de imágenes se ha convertido en un serio cuello de botella para la fabricación de alto rendimiento y para el uso de la IA en la optimización del propio proceso de grabado.

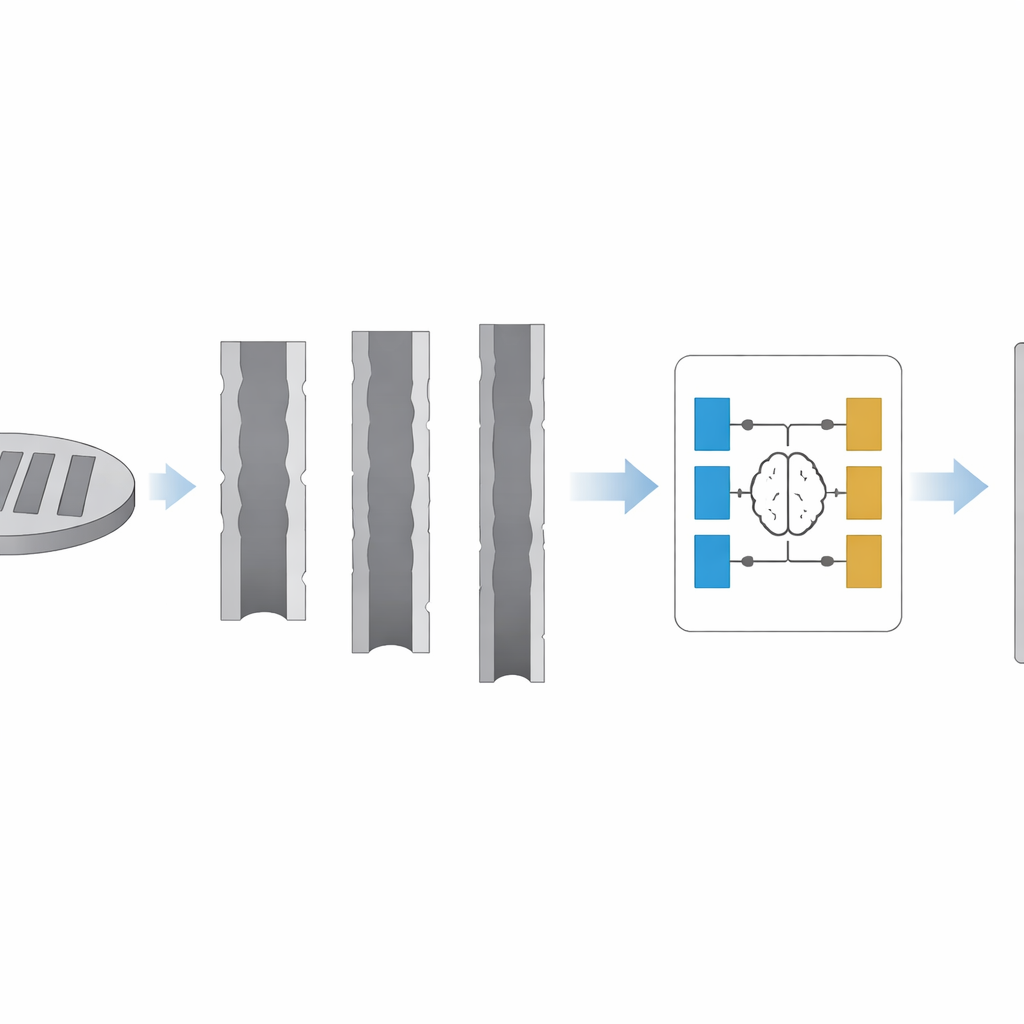

Una IA que respeta la física

Los autores proponen un nuevo enfoque llamado autoencoder variacional de conjuntos de nivel con restricciones físicas, o VLSet‑AE. En su núcleo, este sistema de IA “comprime” una imagen SEM en un código interno compacto y luego “reconstruye” la forma de la zanja a partir de ese código. En lugar de tratar el borde de la zanja como un mero conjunto de píxeles brillantes, modela la frontera como una interfaz en movimiento que crece hacia fuera hasta encontrarse con el material real, algo parecido a una burbuja que se expande y se detiene en las paredes. El movimiento de esta interfaz está guiado por ecuaciones que describen cómo debería evolucionar en el tiempo una superficie grabada, por lo que la IA se orienta no solo por los datos sino también por la física conocida del proceso de grabado.

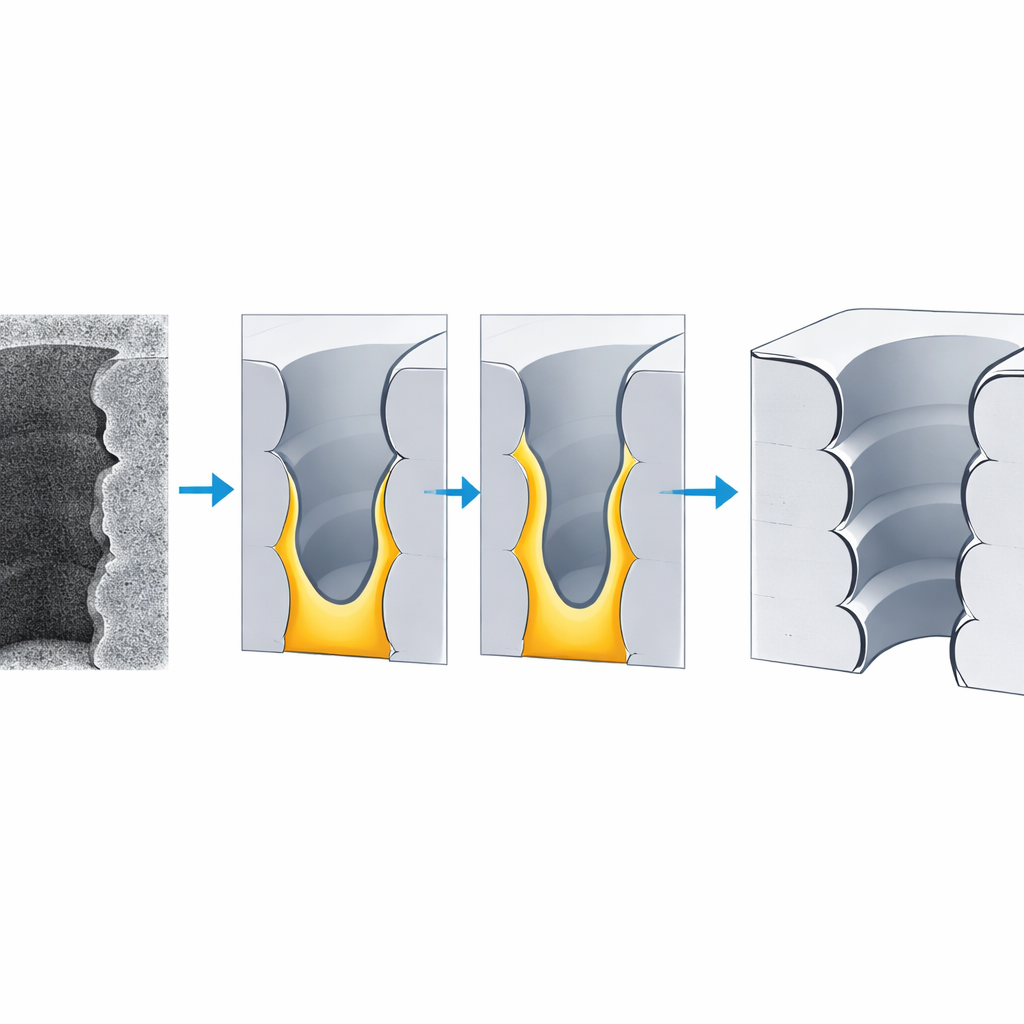

Ver la zanja completa en espacio y tiempo

Para entrenar y probar este sistema, el equipo diseñó un conjunto cuidadoso de 16 recetas de grabado, varió los tiempos de ciclo clave que controlan cuánto tiempo el plasma talla y cuánto tiempo protege, y recopiló 1.000 imágenes SEM en sección transversal. Cada imagen de zanja se cortó en muchas capas delgadas a lo largo de su profundidad, cada una representando un ciclo de tallado y recubrimiento. VLSet‑AE sigue cómo evoluciona el contorno capa por capa y luego recompone estas rebanadas en una vista tridimensional completa. A partir de ello calcula automáticamente nueve medidas cruciales: la profundidad y la anchura de las ondulaciones en la pared, el radio local de curvatura, cuán vertical es el perfil y la anchura de la zanja en la parte superior, media e inferior, junto con la profundidad global y la curvatura de las paredes.

Más rápido, más preciso y listo para la fábrica

En comparación con mediciones humanas y otros siete modelos de IA populares, VLSet‑AE resulta vencedor. De media discrepa de las mediciones manuales solo en torno a un 3,7 por ciento —mejor que la variación entre humanos— y alcanza una precisión global de reconocimiento alrededor del 94–96 por ciento. También es eficiente: el entrenamiento con el conjunto de datos completo requiere del orden de decenas de segundos, y el análisis de una imagen nueva toma aproximadamente un segundo. Incluso cuando se prueba con menos imágenes de entrenamiento, su precisión apenas se degrada, lo que muestra que puede manejar datos limitados, una situación común en la fabricación de alta gama.

Lo que esto significa para la tecnología de uso diario

En términos sencillos, este trabajo convierte la inspección SEM de una tarea artesanal en una tarea industrial. Al leer automática y de forma fiable detalles estructurales finos en imágenes de microscopio ruidosas, VLSet‑AE hace práctico recopilar los grandes volúmenes de datos necesarios para que la IA ajuste y supervise recetas de grabado en tiempo real. Esto, a su vez, puede conducir a zanjas más suaves, sensores más precisos y chips más consistentes, todo producido con menos ensayo y error y a menor coste. El método también ofrece una hoja de ruta general para combinar la física y el aprendizaje automático para entender otros pasos complejos de fabricación, apuntando a un futuro en el que los dispositivos micro y nano sean diseñados y perfeccionados por fábricas integradas y dirigidas por IA.

Cita: Wang, F., Yu, H., Miao, Y. et al. AI-driven feature recognition of SEM profiles in deep reactive ion etching based on physics-constrained variational autoencoder. Microsyst Nanoeng 12, 82 (2026). https://doi.org/10.1038/s41378-025-01105-z

Palabras clave: grabado por plasma reactivo profundo, microscopía electrónica de barrido, IA informada por la física, autoencoder variacional, microfabricación