Clear Sky Science · es

Computación en memoria óptica de espacio libre a alta frecuencia de reloj

Por qué importa esto para la tecnología inteligente cotidiana

Desde coches autónomos y drones de reparto hasta trading de alta frecuencia y cirugía a distancia, cada vez se deben tomar más decisiones en fracciones de segundo, a menudo lejos de grandes centros de datos. La electrónica actual lucha por mantener el ritmo sin sobrecalentarse o agotar las baterías. Este artículo presenta un nuevo tipo de motor de cálculo basado en luz que puede ejecutar tareas clave de inteligencia artificial con gran rapidez y bajo consumo energético, con el potencial de transformar cómo funcionan los dispositivos inteligentes en el “borde” de la red.

Convertir la luz en una calculadora

La IA moderna depende en gran medida de una operación básica: multiplicar y sumar grandes rejillas de números, similar a deslizar repetidamente una pequeña plantilla sobre una imagen y contabilizar lo que se ve. Hacer esto con electrones en chips es potente pero ineficiente, porque los datos deben trasladarse constantemente entre la memoria y los procesadores. Los investigadores construyen en su lugar un sistema llamado FAST‑ONN que permite que la luz realice gran parte del trabajo en el aire. Usan pequeños láseres semiconductores ordenados en una cuadrícula para codificar los píxeles de la imagen como intensidad lumínica, y dejan que esos haces viajen a través de componentes ópticos que aplican los “pesos” de una red neuronal directamente en el espacio, antes de aterrizar en detectores de luz que convierten los resultados de nuevo en señales eléctricas.

Cómo está construido el motor óptico

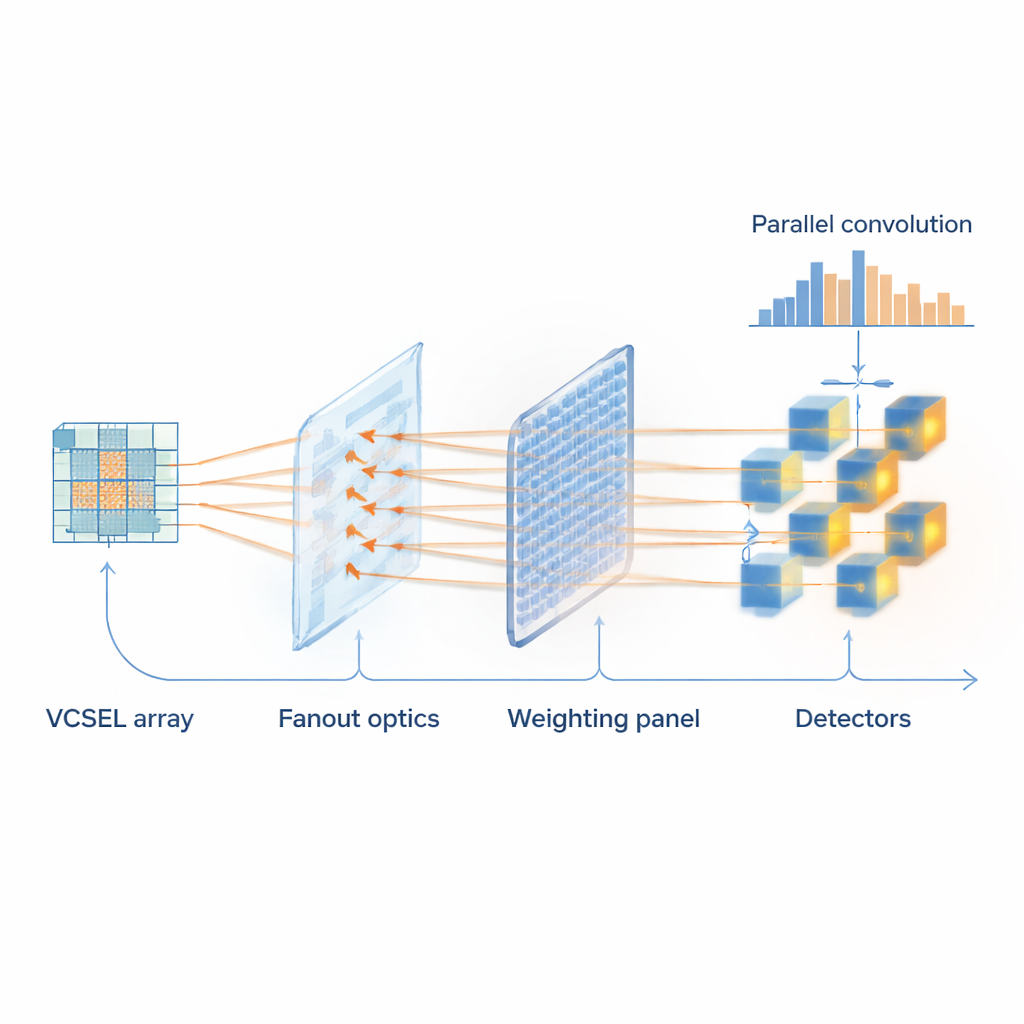

En el corazón del sistema hay una densa matriz de láseres microscópicos conocidos como láseres emisores de superficie con cavidad vertical (VCSEL). Cada dispositivo en una cuadrícula de 5×5 representa un píxel de un pequeño parche de imagen y puede conmutarse a velocidades de gigahercios—miles de millones de veces por segundo. Un elemento de vidrio con patrón divide esta cuadrícula de haces en múltiples copias, de modo que el mismo parche puede ser procesado en paralelo por varios filtros distintos. Un modulador espacial de luz programable, similar en espíritu a una pantalla de alta resolución, actúa como almacenamiento en memoria para los valores de los filtros: sus millones de diminutos píxeles atenúan o dejan pasar la luz para representar un peso de la red neuronal. Los haces convergen luego en detectores acoplados a fibra que suman la luz para cada filtro, completando efectivamente un lote de operaciones de convolución en un único paso óptico.

Manejo de “pensamientos” positivos y negativos

Los modelos de IA no sólo deben reforzar ciertos patrones; también deben suprimir otros, lo que requiere pesos tanto positivos como negativos. Dado que la intensidad de la luz jamás es negativa, esto ha sido un desafío de larga data para la computación puramente óptica. Los autores lo resuelven dividiendo la luz en una ruta de señal que transporta los haces ponderados y una ruta de referencia que queda sin ponderar. Ambas se alimentan a detectores emparejados especiales que restan una señal de la otra, de modo que menos luz puede representar una contribución negativa. Esta ingeniosa lectura diferencial permite que el hardware óptico imite el comportamiento completo de las redes neuronales estándar, manteniéndose a la vez robusto frente al ruido y a pequeñas imperfecciones en los dispositivos.

Poner el sistema a prueba

Para demostrar que FAST‑ONN no es solo una demostración física, el equipo lo conecta a tareas reales de reconocimiento. Vinculan el motor óptico a una red de visión estándar entrenada con el conjunto de imágenes COCO, ampliamente usado para evaluar detección de objetos. En un experimento que reproduce un escenario de coche autónomo, se analizan regiones recortadas de escenas de tráfico para decidir si cada una contiene un vehículo. La capa de convolución más exigente se descarga al hardware óptico, mientras que el resto de los pasos se ejecutan digitalmente. Las versiones óptica y puramente electrónica del modelo coinciden estrechamente, logrando un rendimiento casi idéntico al distinguir automóviles del fondo. También demuestran clasificación de dígitos manuscritos y de ropa, e incluso realizan entrenamiento donde el sistema óptico calcula pasadas hacia delante mientras un ordenador actualiza los pesos, que luego se vuelven a cargar en el modulador de luz.

Velocidad, eficiencia y qué sigue

En su forma actual, el prototipo procesa 100 millones de pequeños parches de imagen por segundo usando láseres 5×5 y nueve filtros a la vez, alcanzando ya cerca de mil millones de operaciones de convolución por segundo con tiempos de decisión a escala de microsegundos. Un análisis detallado sugiere que, utilizando matrices más grandes y láseres comerciales más rápidos, este enfoque podría escalarse para realizar decenas de miles de billones de operaciones por segundo mientras consume mucho menos energía que los aceleradores electrónicos líderes. Dado que los componentes clave son compactos y aptos para fabricación en masa, FAST‑ONN podría finalmente habilitar coprocesadores ópticos diminutos y de bajo consumo dentro de cámaras, drones y otros dispositivos de borde, permitiéndoles “pensar con luz” y responder al mundo casi tan rápido como este cambia.

Cita: Liang, Y., Wang, J., Xue, K. et al. High-clockrate free-space optical in-memory computing. Light Sci Appl 15, 115 (2026). https://doi.org/10.1038/s41377-026-02206-8

Palabras clave: redes neuronales ópticas, hardware de IA en el borde, matrices de VCSEL, computación en memoria, convolución de alta velocidad