Clear Sky Science · es

3DSynBrush, un marco de reconstrucción 3D de alta calidad para murales de Dunhuang a partir de una sola imagen

Arte antiguo y herramientas modernas

Las cuevas pintadas de Dunhuang, en el oeste de China, albergan algunos de los murales budistas más notables del mundo, pero muchas de estas obras frágiles se están desvaneciendo, agrietando y desprendiendo. Este estudio presenta una nueva forma de convertir una sola fotografía de un detalle del mural en un modelo tridimensional fotorrealista, ayudando a historiadores, conservadores y al público a explorar estas obras desde todos los ángulos sin tocar los originales.

Un tesoro en riesgo de desaparecer

Las grutas Mogao de Dunhuang se describen a menudo como una biblioteca en piedra, con murales que registran historias religiosas, arquitectura, indumentaria, música y la vida cotidiana a lo largo de mil años. El tiempo, la arena, la sal y la actividad humana han dejado su huella, provocando el apagado de pigmentos y el derrumbe del yeso. La preservación tradicional se basa en fotografías y reparaciones físicas minuciosas, pero estas no capturan plenamente la profundidad, los matices de color y la sensación espacial de los murales, ni pueden evitar nuevas pérdidas. En contraste, los modelos digitales 3D pueden congelar un instante en el tiempo, permitiendo a los conservadores analizar detalles, simular iluminación y compartir las obras ampliamente sin poner en peligro los originales.

Por qué es difícil convertir pinturas planas en 3D

Crear un modelo 3D convincente suele requerir muchas fotografías tomadas desde distintos puntos de vista alrededor del objeto. Sin embargo, los murales de Dunhuang son pinturas planas en paredes de cuevas y a menudo solo está disponible una imagen de alta calidad de una figura, animal o motivo arquitectónico en particular. El estilo artístico añade complicaciones: el trazo puede ser delicado, los colores pueden estar empastados por la edad y formas como cintas finas o aureolas son extremadamente sutiles. Los algoritmos 3D existentes se entrenan mayoritariamente con fotografías de objetos cotidianos y edificios, por lo que a menudo interpretan mal estas imágenes estilizadas, produciendo formas distorsionadas o inventando detalles que rompen el espíritu de la obra original.

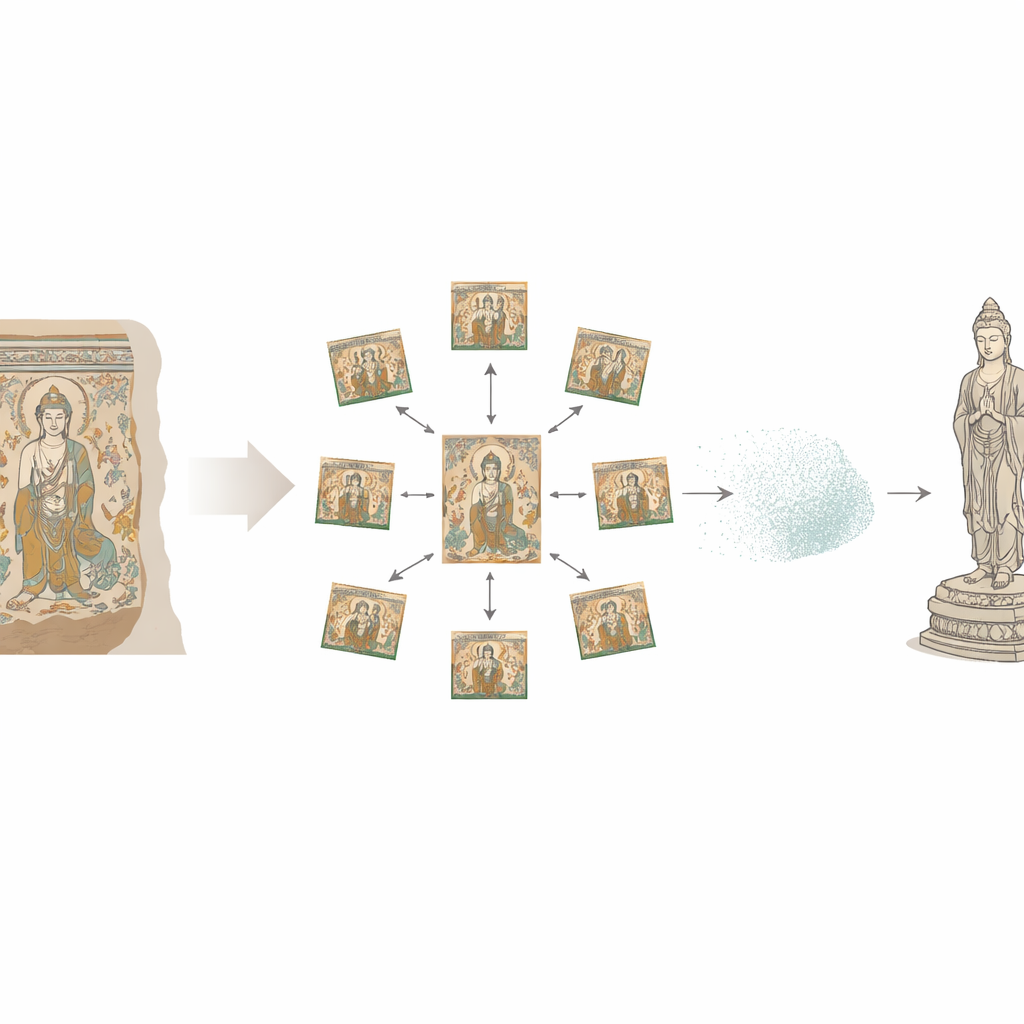

Un pincel digital inteligente paso a paso

Los autores proponen un marco llamado 3DSynBrush que encadena de forma ingeniosa varias técnicas avanzadas de imagen y 3D, cada una resolviendo una parte del problema. Primero, ensamblan un conjunto especializado llamado Chinese Mural Elements (CME): miles de figuras, animales y plantas cuidadosamente recortados de fotografías muralistas de alta resolución. Una herramienta de segmentación separa limpiamente cada elemento de su fondo complejo, dejando un contorno transparente que preserva bordes y estructuras finas. A continuación, un módulo de síntesis de perspectiva imagina cómo se vería esa figura pintada desde varios puntos de vista estándar, usando un poderoso modelo de “difusión” que ha aprendido relaciones 3D típicas a partir de grandes conjuntos de entrenamiento. Esto produce un anillo de vistas coherentes alrededor del elemento, aun cuando solo se dispone de una imagen original.

De las vistas imaginadas a las formas sólidas

Esas vistas sintetizadas se pasan luego a un sistema de renderizado neuronal que las entreteje en un “campo de luz” 3D continuo, esencialmente una descripción matemática de cómo la luz y el color se comportan en cada punto alrededor del elemento. Esta etapa está afinada para manejar las texturas suaves y el aspecto no fotográfico de los murales, suavizando pequeñas inconsistencias entre las vistas generadas sin borrar rasgos artísticos. Finalmente, un módulo de construcción de malla convierte ese campo de luz invisible en una superficie 3D estándar formada por triángulos, refinando automáticamente las zonas densas donde los bordes y detalles finos importan, y simplificando las regiones más lisas que no necesitan muchos puntos. De forma notable, los modelos resultantes usan solo alrededor del 40 % de puntos y caras que las alternativas líderes, y aun así igualan las imágenes originales más de cerca tanto en forma como en textura.

Diseñado para resistir ruido, sombras y huecos

El equipo probó 3DSynBrush bajo condiciones difíciles para imitar la fotografía del mundo real: imágenes granuladas, iluminación desigual y partes del elemento ocultas por manchas oscuras. Incluso cuando aumentaban el ruido y las oclusiones, la forma 3D principal se mantenía estable y las texturas superficiales seguían siendo reconocibles. Comparado visual y numéricamente con varios métodos de 3D desde una sola imagen de primer nivel, 3DSynBrush produjo reconstrucciones más limpias y fieles de sujetos en estilo mural, evitando errores comunes como cuerpos deformados, superficies rotas o texturas que parecen objetos no relacionados.

Devolver la vida a mundos perdidos

Para los no especialistas, el resultado clave es que una fotografía solitaria de un ciervo, bailarín o templo pintado en Dunhuang puede ahora transformarse en un modelo 3D compacto y preciso que se puede explorar en realidad virtual, usar en exposiciones digitales o servir como guía para restauraciones cuidadosas. Aunque el sistema sigue dependiendo de la calidad del recorte inicial y está limitado por las resoluciones de imagen actuales, ofrece una vía práctica para preservar la apariencia y la sensación espacial de pinturas murales frágiles. En esencia, 3DSynBrush actúa como un escultor digital que respeta el estilo original del artista, convirtiendo fragmentos vulnerables del arte mural en “estatuas” interactivas y duraderas para que las generaciones futuras las estudien y disfruten.

Cita: Peng, X., Wang, J., Hu, Q. et al. 3DSynBrush a high quality 3D reconstruction framework for single Dunhuang murals. npj Herit. Sci. 14, 154 (2026). https://doi.org/10.1038/s40494-026-02424-8

Palabras clave: murales de Dunhuang, digitalización del patrimonio cultural, reconstrucción 3D desde una sola imagen, renderizado neuronal, museos de realidad virtual