Clear Sky Science · es

DCADif: fusión difusa temporal adaptativa condicional desacoplada para la restauración por inpainting de murales tradicionales chinos

Devolver la vida al arte mural antiguo

En toda China, las paredes de templos y los techos de grutas están cubiertos de murales centenarios que se desvanecen, se descascarillan y agrietan. Estas pinturas no solo son bellas; son registros visuales de creencias, relatos y la vida cotidiana de tiempos pasados. Restaurarlas a mano es difícil, lento y a veces arriesga las superficies frágiles. Este estudio presenta un nuevo método de inteligencia artificial (IA), llamado DCADif, que ayuda a los expertos a "inpaintar" digitalmente las partes faltantes o dañadas de los murales conservando tanto el dibujo como el estilo fieles a la obra original.

Por qué los murales antiguos son tan difíciles de reparar

Los murales tradicionales chinos son mucho más que imágenes coloreadas en una pared. Entretejen composiciones complejas, líneas delicadas y texturas sutiles creadas por pigmentos y herramientas antiguas. Cuando el tiempo, la humedad y la contaminación dejan huecos y manchas, los conservadores deben conjeturar qué ocupaba esos espacios. Las herramientas de inpainting digital intentan hacer lo mismo, pero la mayoría de los métodos existentes confunden dos tareas cruciales: reconstruir las formas subyacentes y preservar el estilo artístico único. Como resultado, las zonas reparadas pueden verse estructuralmente incorrectas, o pueden conservar las formas pero perder el aire histórico del trazo y el color originales. El reto es recuperar al mismo tiempo tanto los “huesos” como el “alma” de la pintura.

Enseñar a la IA a ver la estructura y el estilo por separado

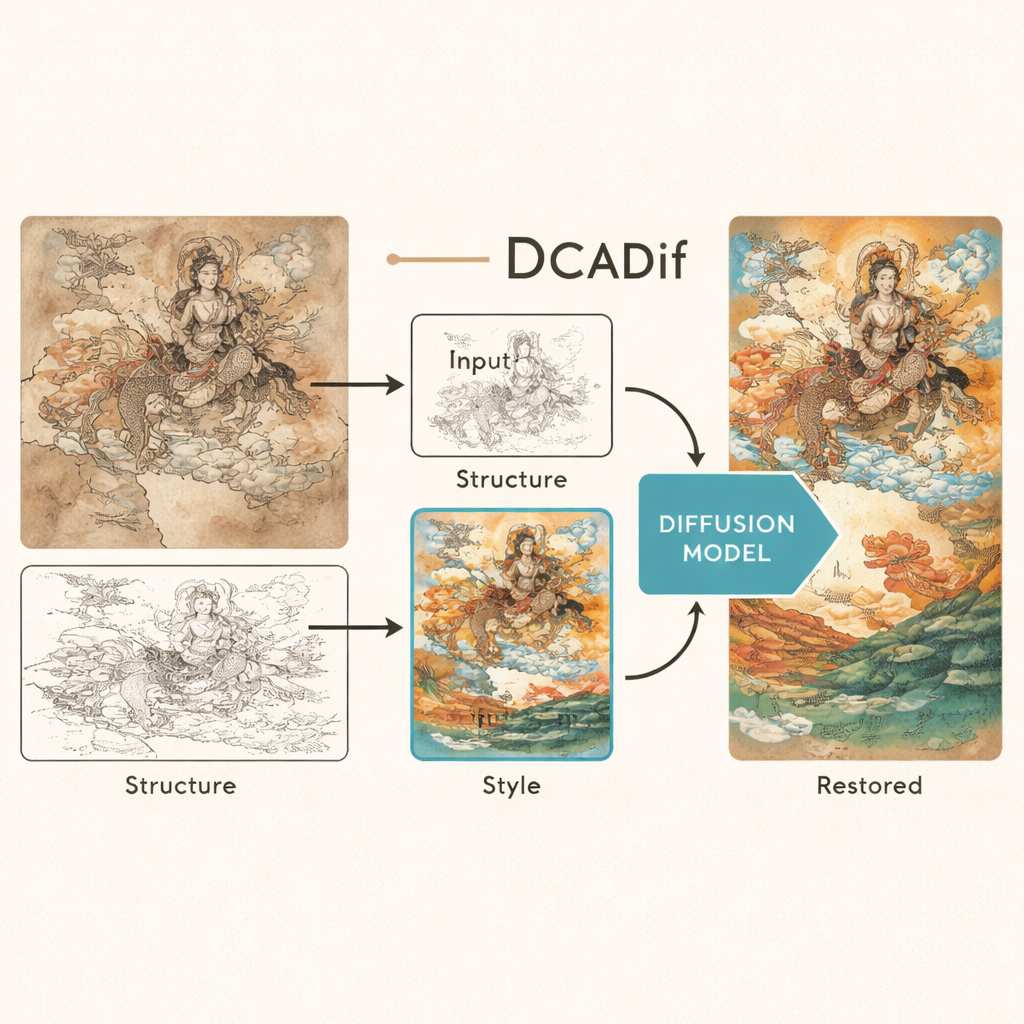

El sistema DCADif aborda este reto dividiendo el problema en dos vías. Primero, los investigadores convierten un mural en un arte lineal simple, similar a un contorno de tinta. Esta versión despojada captura dónde están las figuras, los objetos y los bordes, sin distraerse con color o textura. Un potente modelo de visión (adaptado a partir de una herramienta entrenada originalmente con millones de imágenes) interpreta este arte lineal y lo destila en una descripción compacta de la estructura del mural. En una vía separada, un nuevo codificador "SwinStyle" estudia la pintura dañada original para aprender su huella estilística: cómo se mezclan los colores, cómo curvan los trazos y cómo se agrietan o desvanecen las superficies. Al mantener estas dos descripciones —estructura y estilo— por separado, DCADif puede controlarlas de forma independiente durante la restauración.

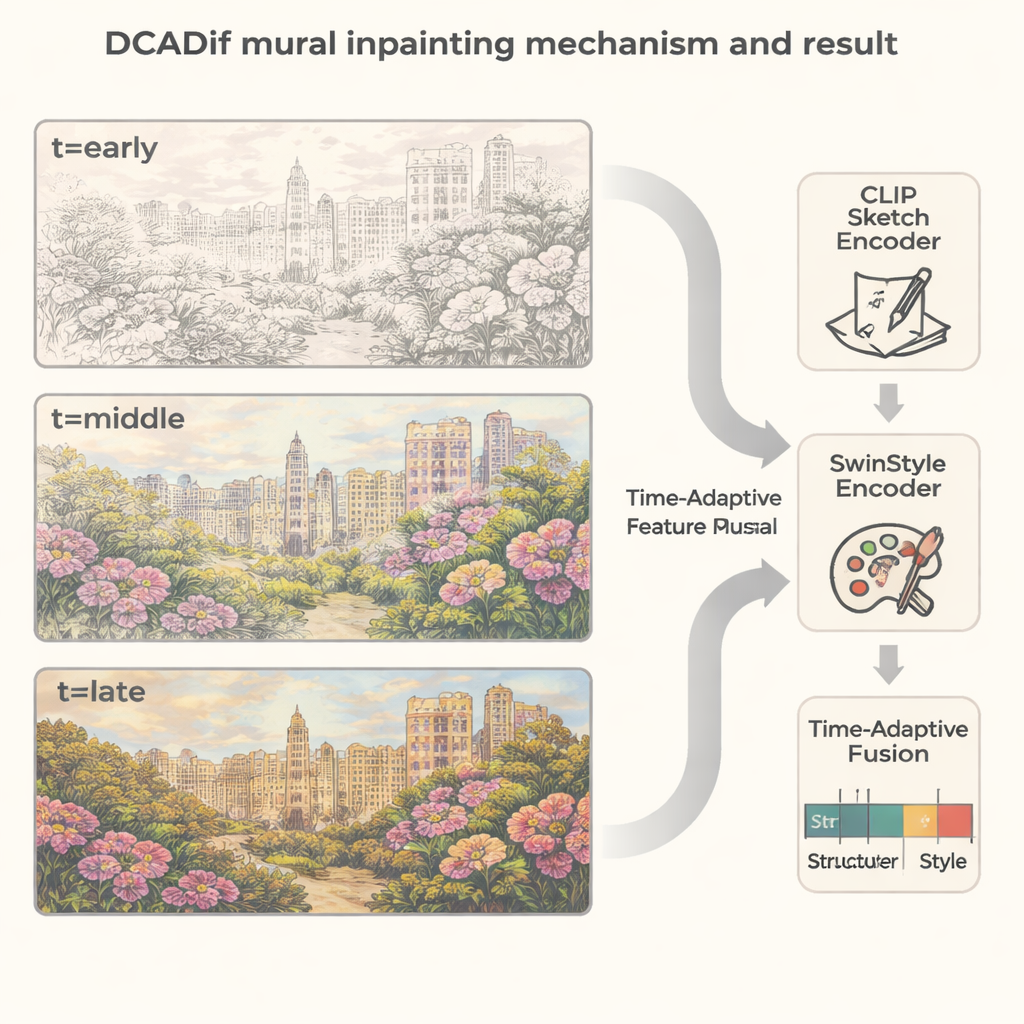

Dejar que la imagen emerja desde el ruido

En el corazón de DCADif está un modelo de difusión, un tipo de IA que crea imágenes empezando desde ruido aleatorio y "desruidos" de forma gradual hasta obtener una imagen realista. Este proceso ocurre en muchos pasos pequeños, un poco como ver una imagen borrosa que se va enfocando lentamente. Los autores diseñaron un módulo de Fusión de Características Adaptativa en el Tiempo que actúa como una perilla inteligente entre estructura y estilo mientras la imagen emerge. En las etapas iniciales, muy ruidosas, el modelo se apoya fuertemente en la estructura, usando el dibujo lineal para establecer formas y contornos correctos. A medida que el ruido se atenúa y la imagen se aclara, la perilla gira hacia el estilo, permitiendo que fluyan colores ricos, texturas y detalles históricos sin deformar el dibujo subyacente.

Pruebas en una nueva librería de murales y pinturas

Para juzgar si DCADif mejora realmente la restauración digital, el equipo recopiló un nuevo y amplio conjunto de datos llamado MuralVerse-S, creado a partir de murales de regiones como Dunhuang, Gansu, Hebei y Mongolia Interior, junto con máscaras realistas que imitan grietas y descascarillado reales. Compararon DCADif con nueve métodos de inpainting líderes, abarcando redes convolucionales más antiguas, modelos basados en transformadores y otros enfoques de difusión. A través de múltiples niveles de daño simulado, DCADif produjo imágenes con estructuras más nítidas, disposiciones globales más coherentes y texturas que observadores humanos juzgaron más cercanas a los originales. El método también funcionó bien en una colección separada de pinturas de paisaje chinas, reconstruyendo con éxito trazos sutiles de tinta y contornos montañosos, lo que sugiere que puede generalizar más allá de los murales.

Qué significa esto para el patrimonio cultural

Más allá de números y gráficos, los investigadores pidieron a 50 especialistas en arte y estudiantes de posgrado que puntuaran distintos resultados de restauración. Los participantes valoraron consistentemente a DCADif como el mejor en precisión del contenido, fidelidad estilística y calidad global. Ejemplos reales, incluidas obras famosas como Damas de la Corte con tocados florales, mostraron que el sistema puede rellenar rostros, vestimentas y motivos decorativos faltantes de manera que se integran sin fisuras con la pintura circundante. Aun así, los autores reconocen límites: cuando se destruyen regiones enormes, cualquier conjetura digital corre el riesgo de ser históricamente inexacta, y el método sigue siendo computacionalmente exigente. Pese a ello, DCADif ofrece a los conservadores una herramienta nueva y no invasiva: una que puede proponer reconstrucciones cuidadosas y de alta fidelidad dejando la pared original intacta, ayudando a museos e investigadores a estudiar, visualizar y salvaguardar mejor tesoros culturales irremplazables.

Cita: Peng, X., Li, C., Hu, Q. et al. DCADif: decoupled conditional adaptive time-dynamic fusion diffusion inpainting of traditional Chinese mural paintings. npj Herit. Sci. 14, 61 (2026). https://doi.org/10.1038/s40494-026-02327-8

Palabras clave: restauración digital de murales, inpainting de imágenes, modelos de difusión, patrimonio cultural chino, tecnología para conservación del arte